思路:主要是调整分区数量、缓冲的大小、拉取次数重试重试次数与等待时间、内存比例分配、是否进行排序操作等等...

spark.sql.shuffle.partitions

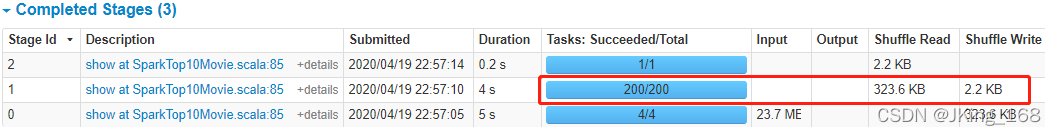

参数说明:SQL 语句中的 group by、join、distinct、partition by 都会触发 shuffle,当在 SparkSQL 中的 Job 中产生 Shuffle 时,默认的分区数 spark.sql.shuffle.partitions = 200,而在实际项目中要合理设置,可以适当降低,建议为申请核数的 2 ~ 3 倍。

对 SparkSQL 中的 Job 中产生 Shuffle 的调优,有 2 种方式:

- 既可以在创建 SparkSession 时中设置

spark=SparkSession.builder.appName('test').master('local[*]').config('spark.sql.shuffle.partitions','6').getOrCreate() - 也可以在 SQL 会话中设置

spark.sql('set spark.sql.shuffle.partitions=6')

本文探讨了Spark Shuffle过程中的性能优化,重点关注参数如`spark.sql.shuffle.partitions`,建议设置为核数的2~3倍。此外,通过调整`spark.shuffle.file.buffer`、`spark.reducer.maxSizeInFlight`以减少磁盘IO和网络传输,以及`spark.shuffle.io.maxRetries`和`spark.shuffle.io.retryWait`来改善网络异常的处理。同时,`spark.shuffle.memoryFraction`和`spark.shuffle.manager`的选择也是关键,对于SortShuffleManager,可通过`spark.shuffle.sort.bypassMergeThreshold`避免不必要的排序操作,提升效率。

本文探讨了Spark Shuffle过程中的性能优化,重点关注参数如`spark.sql.shuffle.partitions`,建议设置为核数的2~3倍。此外,通过调整`spark.shuffle.file.buffer`、`spark.reducer.maxSizeInFlight`以减少磁盘IO和网络传输,以及`spark.shuffle.io.maxRetries`和`spark.shuffle.io.retryWait`来改善网络异常的处理。同时,`spark.shuffle.memoryFraction`和`spark.shuffle.manager`的选择也是关键,对于SortShuffleManager,可通过`spark.shuffle.sort.bypassMergeThreshold`避免不必要的排序操作,提升效率。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?