下面开始介绍部署的流程:

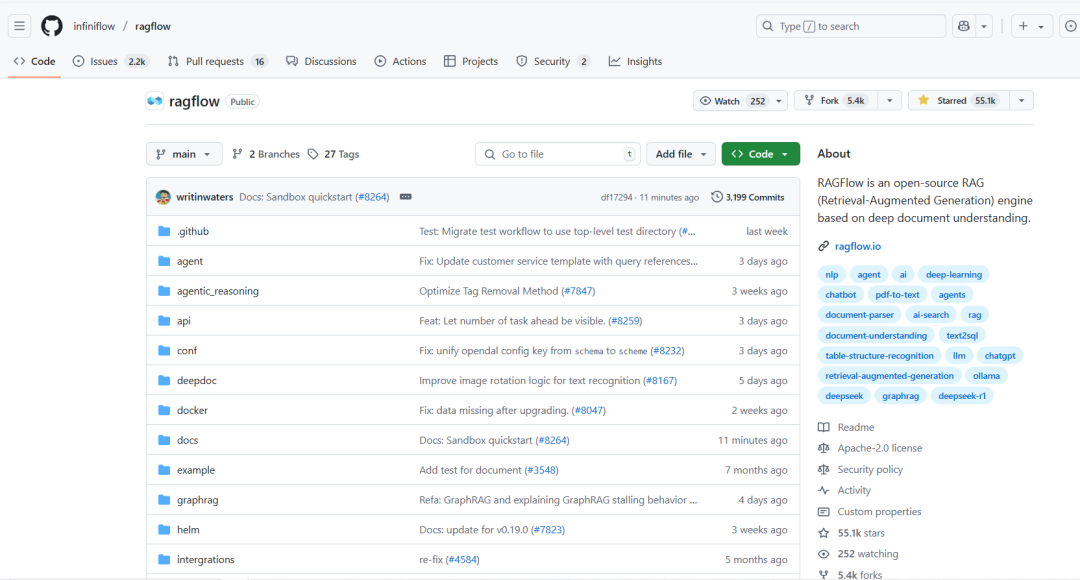

官方GitHub:

https://github.com/infiniflow/ragflow

试用 Demo

访问demo体验:

https://demo.ragflow.io

私有化部署RAGFlow的 极简教程

一、获取项目代码与部署文件

推荐docker部署

- CPU >= 4 核

- 内存 >= 16 GB

- 磁盘 >= 50 GB

- Docker >= 24.0.0 & Docker Compose >= v2.26.1

1. 克隆 RAGFlow 仓库

git clone https://github.com/infiniflow/ragflow.git

cd ragflow

2. 进入 Docker 部署目录

cd docker

二、选择部署版本(根据需求选其一)

1. 部署标准版cpu版本

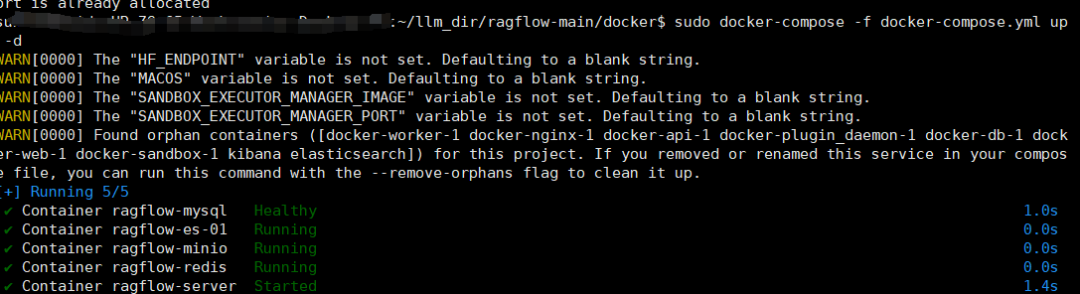

# 方法一,若命令不对则用方法二

sudo docker compose -f docker-compose.yml up -d

# 方法二

sudo docker-compose -f docker-compose.yml up -d

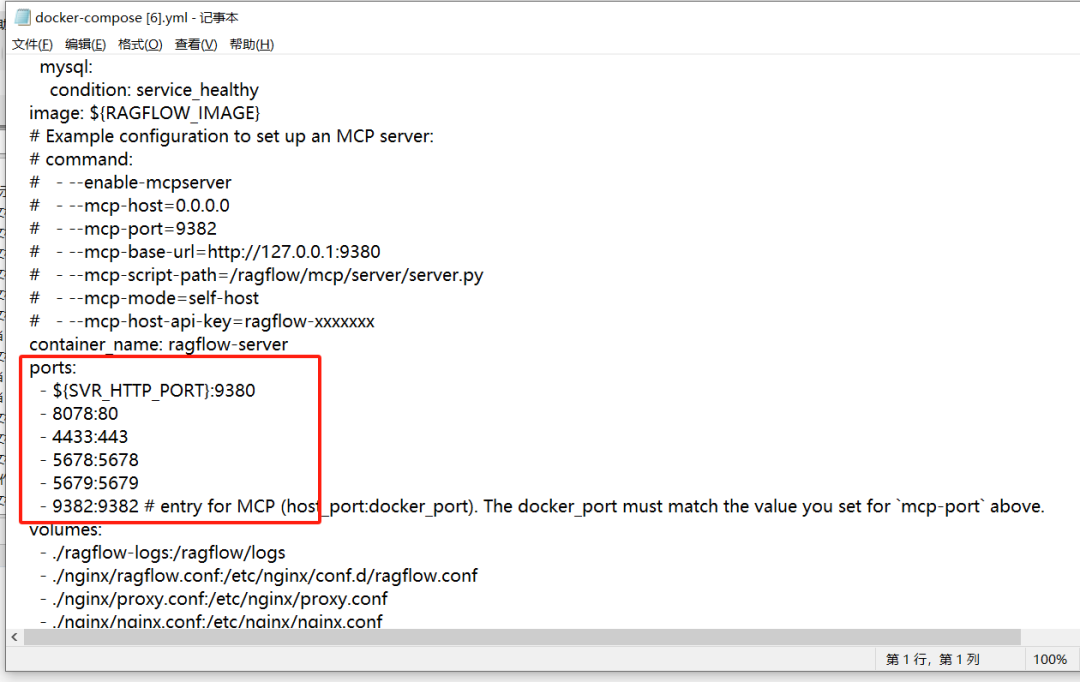

需要注意一点,下面列出来的端口号,可能会存在冲突:

例如默认的80,我改为了8078;

默认的443,我改为了4433;

你们如果遇到端口冲突,可以像我这样修改即可;

主要修改的文件为:.env 和 docker-compose.yml 两个文件;

2. 查看服务启动日志

# 实时查看日志(等待服务初始化完成)

docker logs -f ragflow-server

# 当看到以下输出时,说明服务启动成功

____ ___ ______ ______ __

/ __ \ / | / ____// ____// /____ _ __

/ /_/ // /| | / / __ / /_ / // __ \| | /| / /

/ _, _// ___ |/ /_/ // __/ / // /_/ /| |/ |/ /

/_/ |_|/_/ |_|\____//_/ /_/ \____/ |__/|__/

* Running on all addresses (0.0.0.0)

3. 访问 Web 界面

在浏览器中输入服务器 IP 地址(默认端口 80,无需添加端口号):http://你的服务器IP

本文由于80端口被占用了,我改为了8078;

所以我就访问

http://你的服务器IP:8078

首次使用,先注册一个账号;

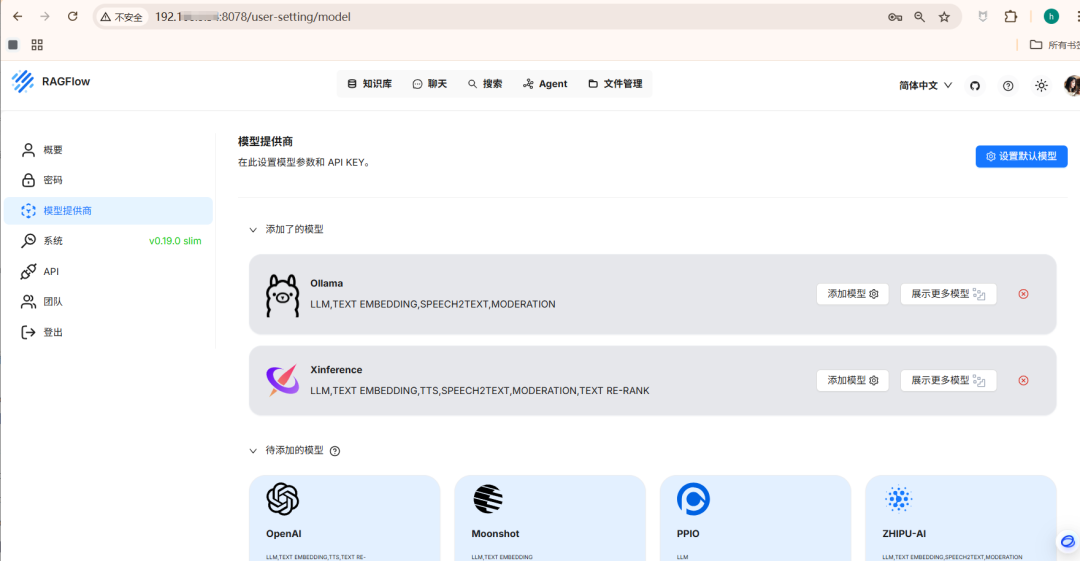

4、配置默认模型

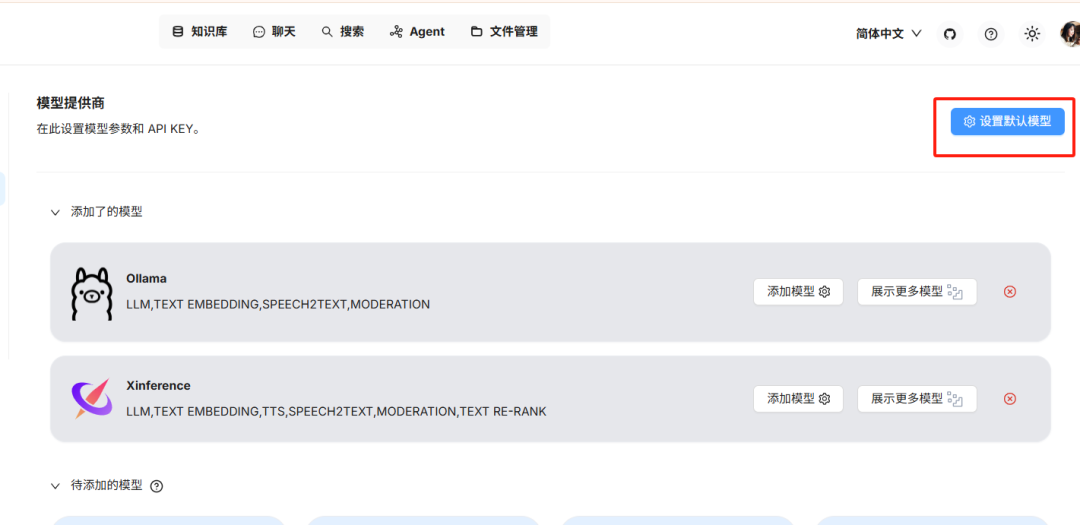

你可以选择ollama,或者 Xinference 来部署大模型和向量模型;

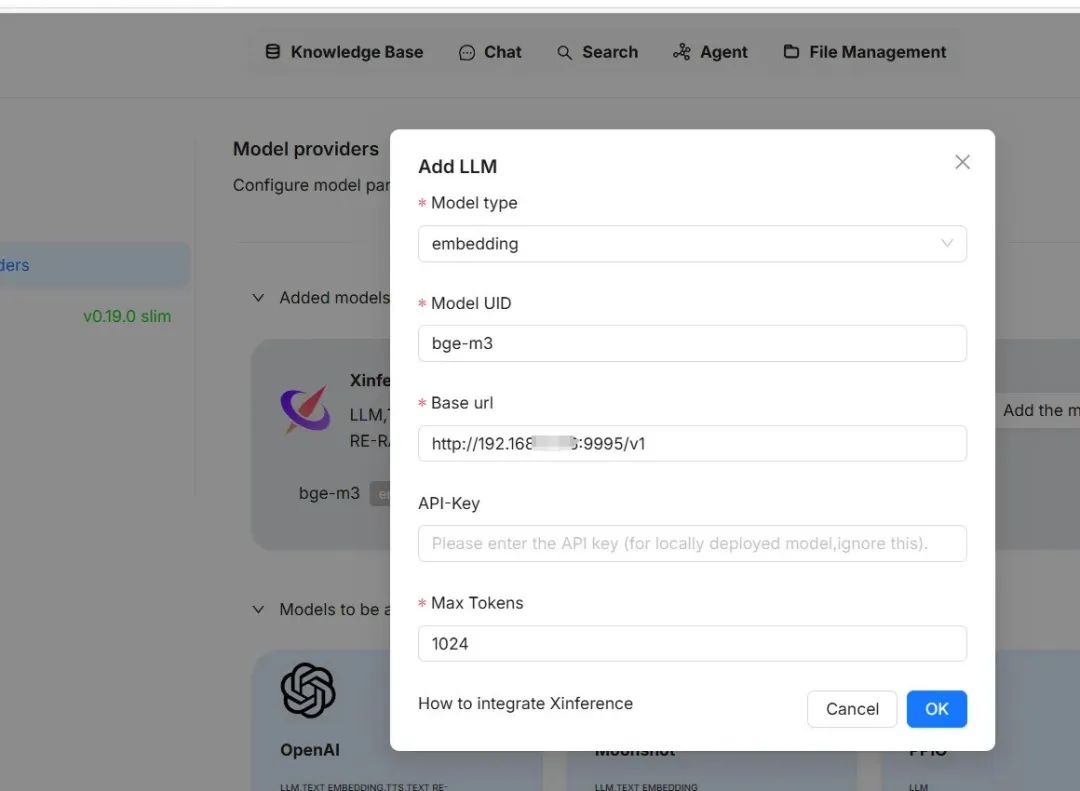

例如Xinference的配置

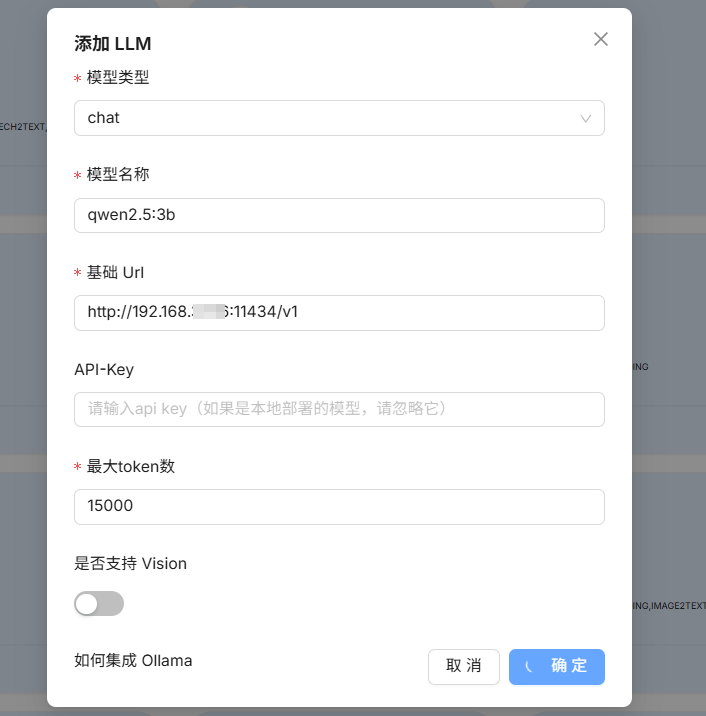

例如 ollama 的配置

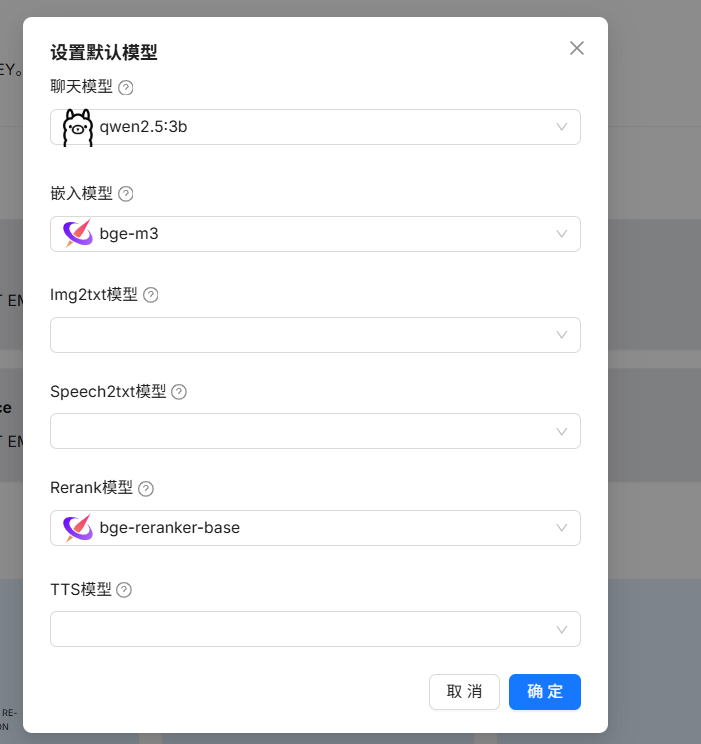

设置默认的模型:

5、创建知识库+问答

上传一个倚天屠龙记小说,作为数据源;然后点击解析,等待解析完成!

点击搜索,选择刚才创建的知识库,即可进行问答:

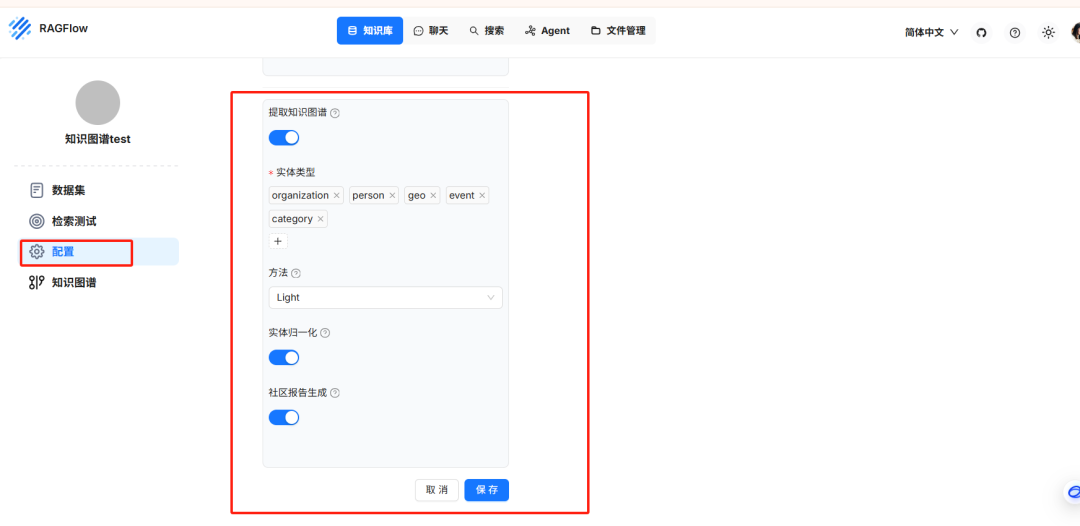

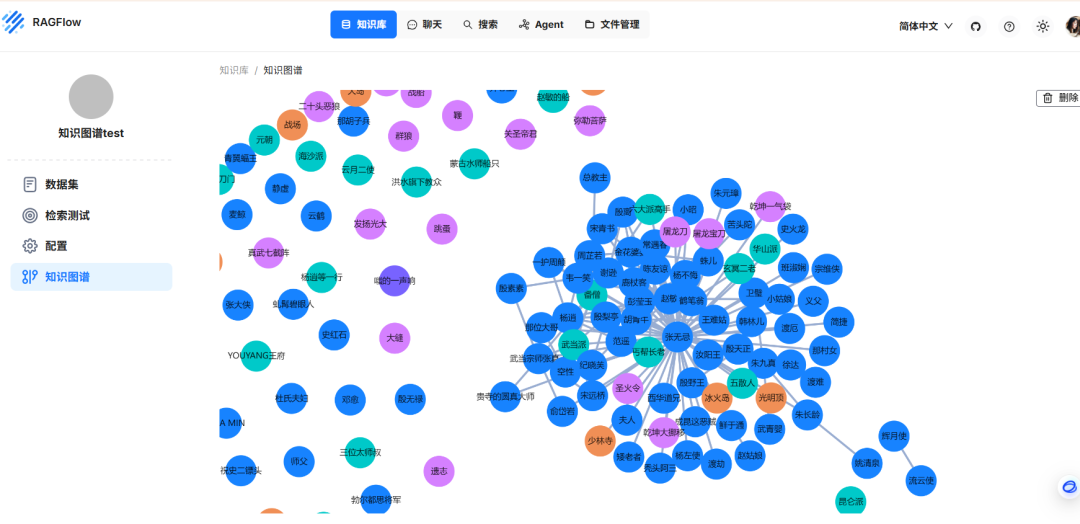

最后-进阶使用,构建知识图谱:

知识库里进行配置,提取实体信息,

构建的效果:

最后来个演示效果视频:

技术文档与支持

如果你在使用 RAGFlow 的过程中遇到问题,或者想深入了解它的技术细节,可以参考以下技术文档:

- [Quickstart] (https://ragflow.io/docs/dev/)

- [Configuration] (https://ragflow.io/docs/dev/configurations)

- [Release notes] (https://ragflow.io/docs/dev/release_notes)

- [User guides] (https://ragflow.io/docs/dev/category/guides)

- [Developer guides] (https://ragflow.io/docs/dev/category/developers)

- [References] (https://ragflow.io/docs/dev/category/references)

- [FAQs] (https://ragflow.io/docs/dev/faq)

总之,RAGFlow 作为一款开源的 RAG 引擎,为企业和个人提供了强大的信息处理和问答解决方案。它的出现,将有助于提升人们在信息获取和利用方面的效率和质量。如果你正在寻找一款优秀的 RAG 工具,不妨尝试一下 RAGFlow。

我们该怎样系统的去转行学习大模型 ?

很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习门槛,降到了最低!

在这个版本当中:

第一您不需要具备任何算法和数学的基础

第二不要求准备高配置的电脑

第三不必懂Python等任何编程语言

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:我们会去了解大模型的基础知识,以及大模型在各个行业的应用和分析;学习理解大模型的

核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段是我们的AI大模型RAG应用开发工程,我们会去学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,我们会去学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造我们自己的Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,我们会更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调;并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

1218

1218

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?