开始今天这篇文章之前,先来问大家一个问题:你有没有被AI气到过呢?

先来看看一下这几个场景:让AI改合同,你就像是教三岁小孩?让AI分析数据报表,却对陈旧的数据自说自话?让它创作文案,内容空洞无物?这些场景你们是不是都有遇到过?

虽然AI工具的确给我们的工作带来了不少便利,但是有时候,AI工具还是不够懂我们,没有办法迅速给出我们想要的答案。除了用好AI提示词之外,还有没有方法能够解决以上问题呢?

还有的!就是我今天标题所说的:搭建个人知识库。今天我将会给大家分享如何用DeepSeek搭建个人知识库的三种方法,手把手教大家怎么让DeepSeek读懂你的需求。

继续往下看之前,先来点个关注叭!别错过我后面的内容啦!

开始搭建“个人知识库”之前,先来了解一下它的概念是什么?

如果把DeepSeek比作我们的脑子,跟它对话就是考试,那么DeepSeek做出的回答就是基于它学过的知识,也就是用于训练的数据做出回答。而个人知识库的存在,就可以让这场考试变成开卷的形式。

DeepSeek在我们搭建的知识库里面“学一学”、“找一下”,它给出来的答案会更加准确,也会更符合我们的需求。

这篇文章,我就来教大家三个搭建个人知识库的方式,满足大家在不同场景下的使用需求,让大家玩转DeepSeek!

本地部署DeepSeek搭建知识库

在电脑本地部署DeepSeek,去搭建个人知识库,咱么需要用到Ollama和AnythingLLM。我们需要用Ollama下载DeepSeek。在下载好DeepSeek后,进入系统的**环境变量设置,**进入路径为:右键单击我的电脑-高级系统设置。

新建用户变量:点击打开环境百年变量后,在WIN的用户变量里,点击新建一个用户变量

在弹出的输入框内输入变量名和变量值:变量名:OLLAMA_HOST;变量值:0.0.0.0:11434,之后点击确定即可。

需要注意的是:在搭建知识库和后续使用的时候时,都需要让Ollama在运行状态,不能退出!如果不小心关闭了,可以在任务栏搜索PowerShell,单击打开。

下载系统对应的LLM:在完成上述操作后,可以百度搜索打开AnythingLLM官网,选择对应的系统版本进行下载。

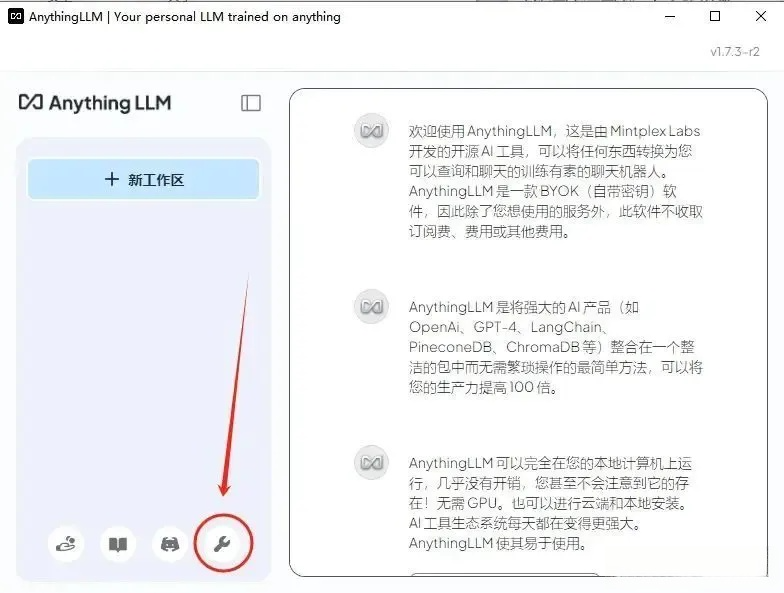

进入安装程序:下载完成后,便直接进入安装程序,接下来就是创建个人知识库的重点了!点开AnythingLLM的设置图标。

在AnythingLLM中选择对应的提供商及DeepSeek模型:在AI提供商-LLM首个选项里,选择已经安装好的Ollama作为大模型提供商,在Ollama Base URL里输入**http://0.0.0.0:11434,**之后选择本地已部署好的DeepSeek大模型,点击右上角的保存即可。

在知识库里上传内容:回到AnythingLLM的首页,点击添加**新工作区,**接下来我们就可以在知识库里上传内容啦。

它有两种资料上传方式,分别是本地文件以及网页链接上传。所以不管是我们总结撰写的文件,还是在网络上看到的有用的信息,都可以用来丰富咱们的个人知识库。

上传之后的文件会暂存到下图左边区域,如果你有知识库共用的情况下,最好是在暂存区域新建文件夹进行分类管理,右方工作区域就是知识库的全部内容,你可以随时对它进行调整。

开始新体验喽:返回对话的界面后,选择对应的工作区(即知识库),DeepSeek就会根据你上传的资料内容,生成更加准确且符合你需求的内容。

基于硅基流动

用API+Cherry Studio****搭建知识库

当遇上个人电脑配置不够,但是又想用DeepSeek满血版+个人知识库,怎么办呢?这时候我们可以选择用API调用DeepSeek,再来搭建个人知识库。在操作的时候,选择DeepSeek大模型即可。怎么操作呢?

打开硅基流动官网:打开硅基流动官网:https://account.siliconflow.cn/,点击API密钥,点击新建API密钥,单击复制密钥进行备用。

打开Cherry Studio官网:打开网址:https://cherry-ai.com/,按相应的提示下载对应的应用。

设置AI大模型:在Cherry Studio安装完成后进入应用,依次点击左****下角的“设置”和左上方“模型服务”,在AI模型服务里选择“硅基流动”,输入我们刚才在硅基流动里面新建的密钥,点击检查。

检查是否连接成功:在检查之后,页面如果弹出“**连接成功”**的提醒,便说明可以正常使用DeepSeek-R1满血版;如果连接不成功,就需要点击页面中的“管理”按钮,手动添加一下DeepSeek-R1满血版。

配置嵌入模型:之后,我们需要回到硅基流动官网,配置一个嵌入模型。嵌入模型可以将我们上传的知识库文件转换成计算机(即AI大模型)容易理解的数字,然后储存到它的向量数据库中,在模型广场,选择嵌入。

点击复制模型名称:BAAI/bge-m3,如下图。

回到Cherry Studio界面嵌入模型:在硅基流动官网复制完毕后,回到Cherry Studio界面,点击“管理”。

在Cherry Studio界面内操作:点击页面中的“+”号,添加嵌入模型,如下图。

在Cherry Studio内添加知识库:之后,我们在Cherry Studio界面进入知识库,点击“添加”按钮。

填写知识库名称并嵌入模型:填写知识库名称并选择嵌入模型为BAAI/bge-m3,点击“确定”按钮,之后就可以上传个人知识库的文件啦,它支持的文件形式有文件、目录、网址、网站、笔记等。

知识库功能:Cherry Studio有一个特别的功能:它支持在知识库内搜索,而且显示内容占比,可以让我们很方便地查看和修改知识库中的内容。

如何使用我们的知识库:在完成知识库的设置之后,回到****Cherry Studio对话界面,在最下方的对话框选择“DeepSeek-R1模型和刚才创建好的知识库”,就可以开始使用了,页面中生成的回答会在最后显示引用的内容及文档信息。

用ima.copilot

打造DeepSeek-R1满血版+知识库

如果你还是觉得前面的本地部署、API调用等方式很复杂,那最后这个工具肯定很适合你。那就是用ima.copilot一键创建知识库,它是由腾讯打造的知识库管理工具,内嵌了DeepSeek满血版,不需要搭配其他工具进行使用。

创建共享知识库:在下载ima.copilot安装并登录之后,点击“**我创建的共享知识库”**创建知识库,输入知识库名称和描述,进行自定义设置。

上传个人文件:在设置完知识库的基础信息之后,就可以直接在ima.copilot上传你的知识库文件。

使用ima.copilot的优势:ima.copilot有一个优势,就是它可以和小程序端通用,当我在手机上看到一篇特别好的公众号文章的时后,可以页面点击右上角的“…”选择更多打开方式,一键存入我的ima.copilot知识库。

如何使用ima.copilot知识库:在上传文件完成后,在知识库的界面,我们就可以直接和DeepSeek-R1满血版进行对话。ima.copilot最强大的地方在于,就算你不知道怎么搭建知识库,你也可以使用别人共享给你的知识库,这对于团队使用非常友好。

除了以上我提到的优势之外,ima.copilot还能快速提取所上传文档的核心观点,将碎片化的文档、公众号文章转化为结构化知识体系,通过标签、双向链接构建“DeepSeek最强外挂”,让你超快速获得准确、满意的答案。

——

好啦!这就是三种搭建个人知识库的方式啦!

难度从难到易,我个人比较推荐的方式是最后一个,因为它简单快捷。当然,如果你的文件和个人知识涉及到企业机密信息且电脑配置足够的话,我的建议是使用第一种方式,因为是本地部署,不上传你的机密信息。

同时,我觉得搭建个人知识库是个好习惯,在平时看到好的内容,都可以进行整理归档,逐步搭建个人知识库,然后让DeepSeek调用个人知识库进行回答,可以在无形之中对其所生成的答案进行了个性化优化。

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

基于此,我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近70次后,终于把整个AI大模型的学习门槛,降到了最低!

在这个版本当中:

第一您不需要具备任何算法和数学的基础

第二不要求准备高配置的电脑

第三不必懂Python等任何编程语言

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型教程已经给大家整理并打包,现在将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

五、AI产品经理大模型教程

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

6万+

6万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?