前言

ollama 的本地 api base url :http://localhost:11434

maxKB 运行docker run -d --name=maxkb -p 2000:8080 -v ~/.maxkb:/var/lib/postgresql/data 1panel/maxkb

刚开始的用户名: admin 密码: MaxKB@123… ,登录上去了会要求你该密码

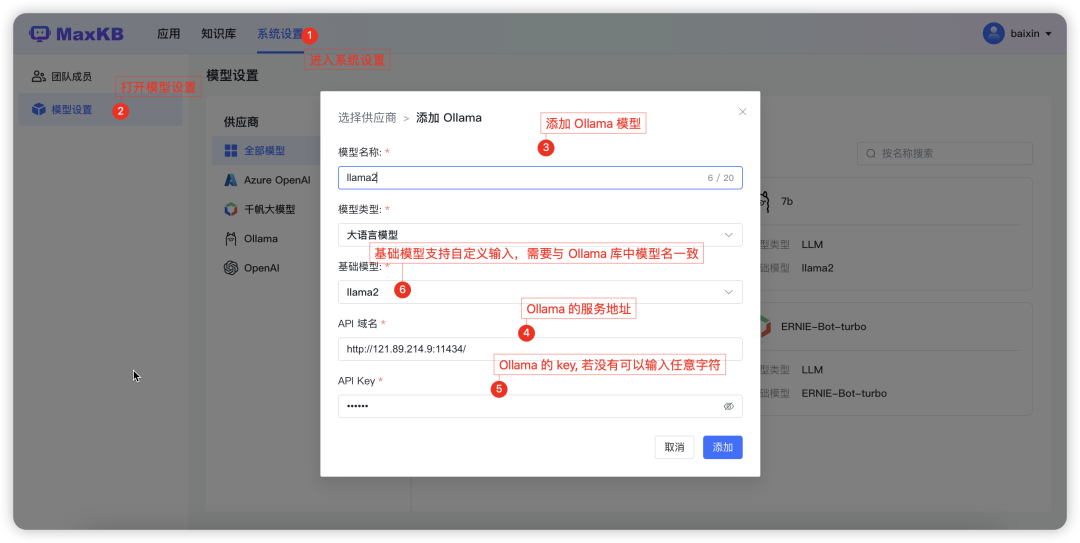

maxKB 中添加ollama模型

ollama settings in MaxKB

ollama 本地地址需要终端运行ollama serve,显示下图已经 in use 浏览器打开地址会显示ollama is running

ollama serve

Error: listen tcp 127.0.0.1:11434: bind: address already in use

ollama服务默认是http://127.0.0.1:11434,目前在macOS上修改ip和端口无效,官方暂未解决

linyu@LinyudeMBP ~ % lsof -i:11434

COMMAND PID USER FD TYPE DEVICE SIZE/OFF NODE NAME

ollama 15577 linyu 3u IPv4 0xc60ad1ae44036ad5 0t0 TCP localhost:11434 (LISTEN)

ollama 15578 linyu 6u IPv4 0xc60ad1ae43a7df55 0t0 TCP localhost:63205->localhost:11434 (ESTABLISHED)

linyu@LinyudeMBP ~ % kill -9 15577

linyu@LinyudeMBP ~ %

[2] - killed ollama serve

linyu@LinyudeMBP ~ % kill -9 15578

linyu@LinyudeMBP ~ %

[3] + killed ollama run mixtral:8x7b

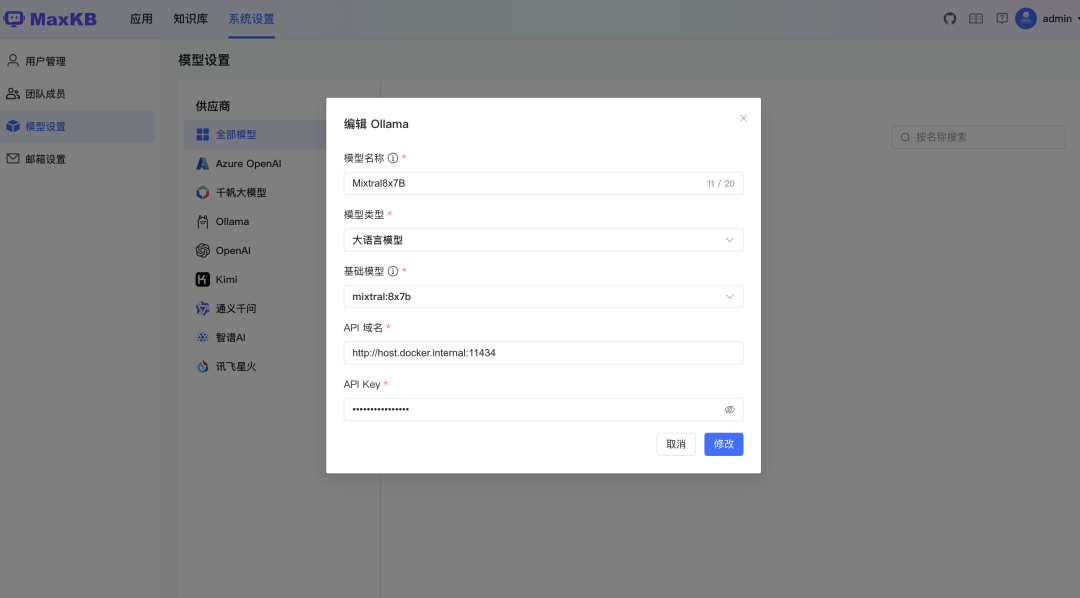

ollama 域名不能用上面本地域名,改成http://host.docker.internal:11434,不然会显示 api base无效,配置里 ollama 模型名称要跟你在终端ollama run mixtral:8x7b名称一样

ollama settings

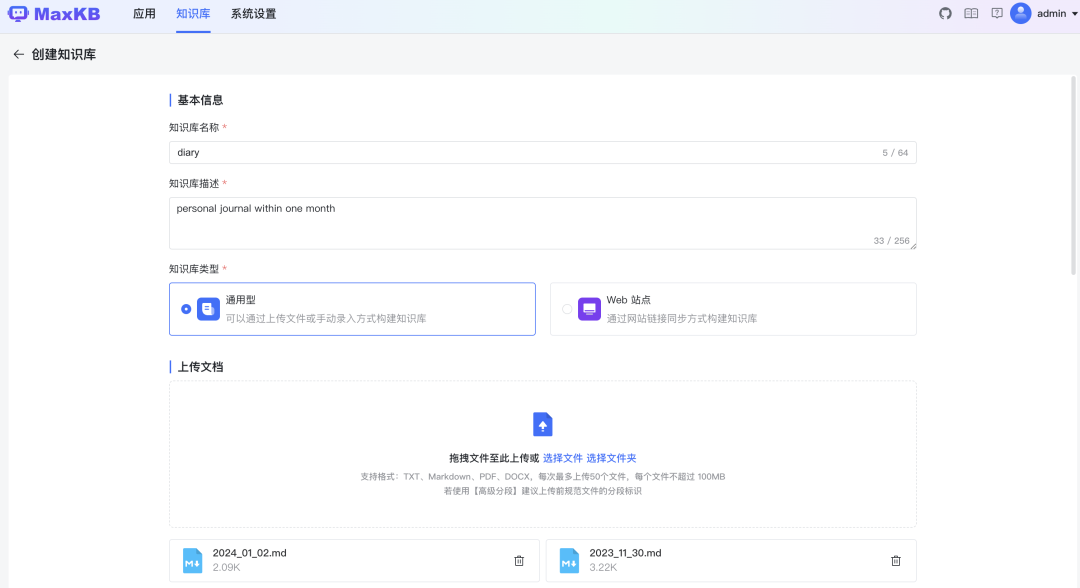

支持格式:TXT、Markdown、PDF、DOCX,每次最多上传50个文件,每个文件不超过100MB,也就是一次性可以上传 5G 大小的文档

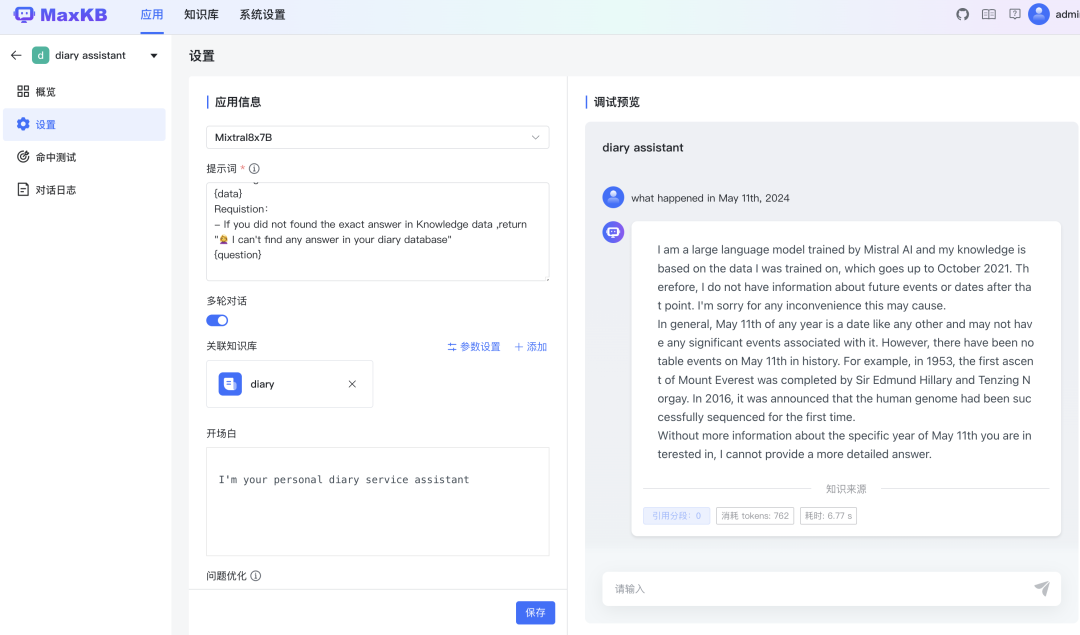

用 mixtral8x7b问答测试结果并不好,不能准确回答知识库的内容,也不按提示词回答

test

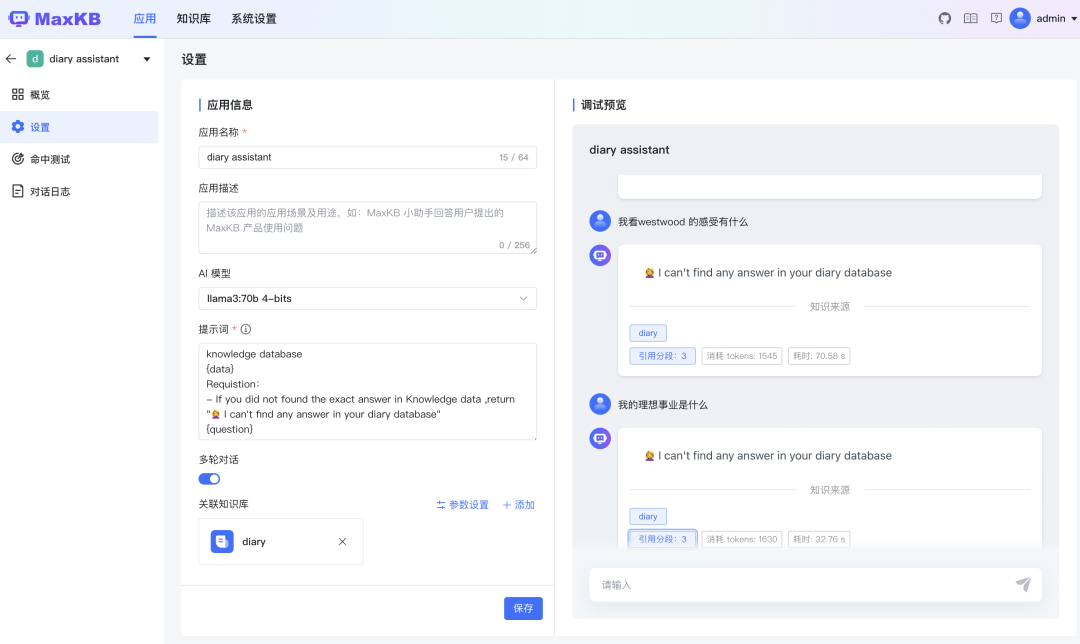

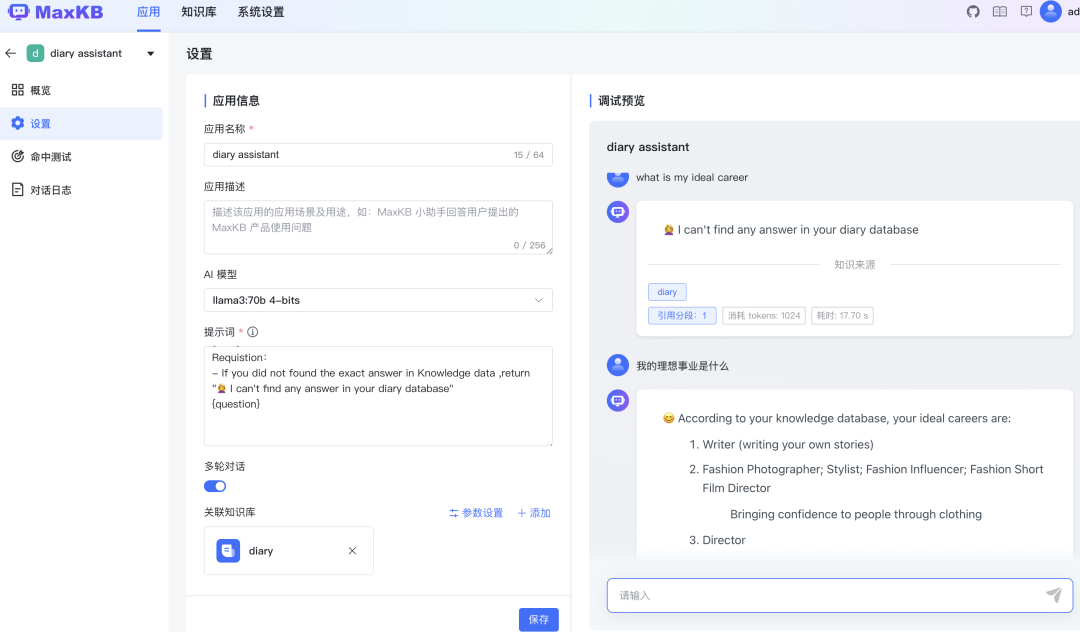

换成 ollama 4 位量化过的 llama3:70b,同样的提示词,llama 找不到就会按照提示词的回复 mixtral 生成速度可以秒出, llama3:70b需要等 2-3s

llama毕竟是英文预料训练出来的,中文处理不太好, 没有明确指示的情况下(比如写个 llama3),默认回复语言都是英语,对英语的处理理解能力也更好

MaxKG 数据库建议直接把问题和答案整理出来, 现成的 QA 问答对不管在哪个平台上都比直接塞预料让模型自己理解分段效果好

llama 模型建议数据库都是英文的,包括英文问题和答案;要中文,在 ollama 可以部署 qwen72B 的模型,要回答质量准确还是建议 CSV 问答对

就 MaxKB和 FastGPT部署知识库,MaxKB 部署更方便简单,不需要在 config文件修改,但功能没有 fastGPT 多,无法高级编排自定义 Ai workflow ,上传的知识库也不能直接是 CSV 问答对或 excel 文件,知识库创建不方便,问答对只能自己去问题详情一个个匹配

相比 MaxKB创建个人知识库,个人建议还是 FastGPT

如何学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

那么我作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,希望可以帮助到更多学习大模型的人!至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

👉 福利来袭优快云大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

全套AGI大模型学习大纲+路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉 福利来袭优快云大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

1619

1619

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?