LLaMA Factory 是一个开源的大语言模型微调框架,它提供了一套高效、易用的工具集,支持多种主流大语言模型(如 LLaMA、ChatGLM、Qwen 等)的微调与部署。该框架具有以下突出特点:

·支持模型丰富:兼容 100+ 种大语言模型,涵盖 LLaMA、Baichuan、ChatGLM、Qwen 等主流架构

·训练效率高:集成多种高效微调技术(LoRA、QLoRA 等),大幅降低显存需求

·界面友好:提供直观的 Web UI,支持零代码操作的模型训练与推理

·功能完整:覆盖模型预训练、指令微调、奖励模型训练等全流程

无论您是研究者、开发者还是企业用户,LLaMA Factory 都能帮助您快速构建和定制专属的大语言模型应用。

环境配置与LLaMA Factory安装

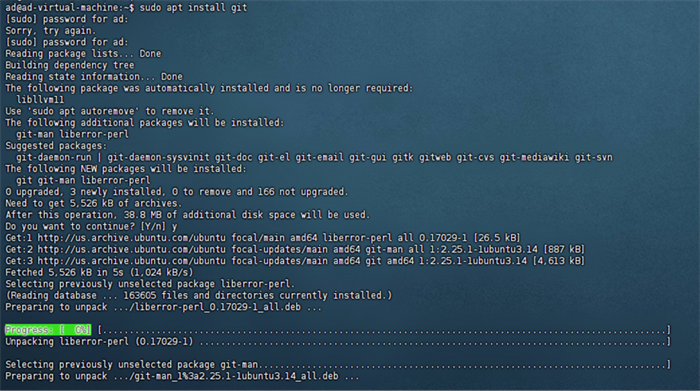

一、 安装git

在终端中执行以下命令,安装 Git 版本工具:

sudo apt install git

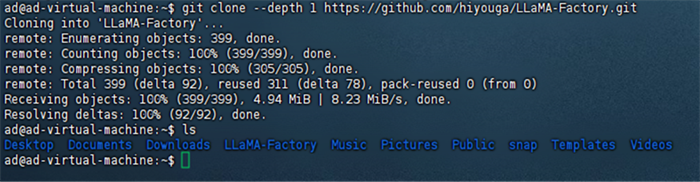

二、下载LLama-factory

二、下载LLama-factory

使用 Git 克隆 LLaMA Factory 项目仓库:

git clone --depth 1 https://github.com/hiyouga/LLaMA-Factory.git

三、安装conda

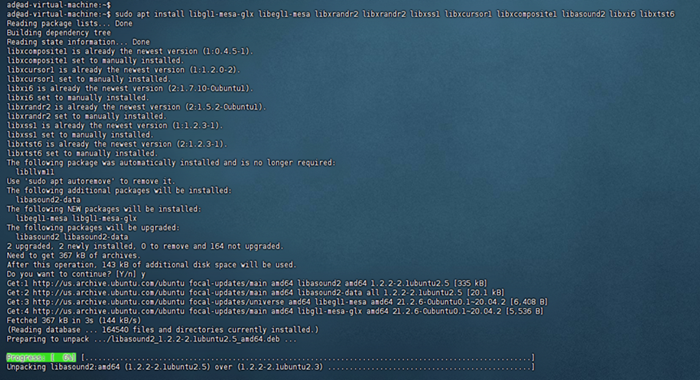

1、安装Conda 所需依赖:

sudo apt install libgl1-mesa-glx libegl1-mesa libxrandr2 libxrandr2 libxss1 libxcursor1 libxcomposite1 libasound2 libxi6 libxtst6

2、下载conda 安装包

wget https://repo.anaconda.com/archive/Anaconda3-2024.10-1-Linux-x86_64.sh

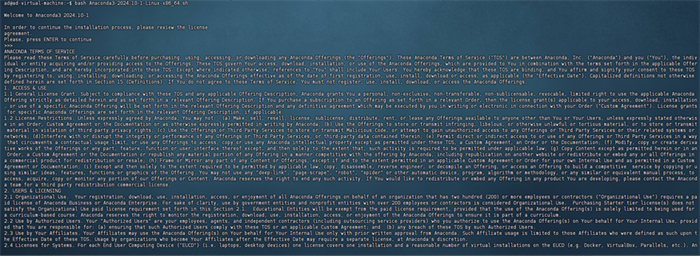

3、安装conda

bash Anaconda3-2024.10-1-Linux-x86_64.sh

一路回车和yes,注意: 终端出现Anaconda3 will now be installed into this location:可输入自定义路径进而支持自定义conda安装路径(直接回车会默认安装到HOME目录)。

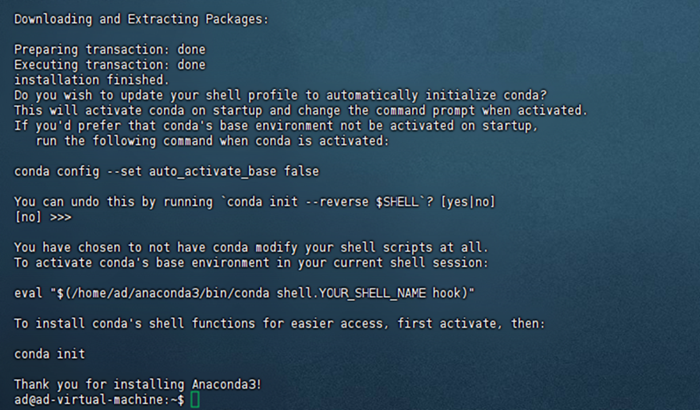

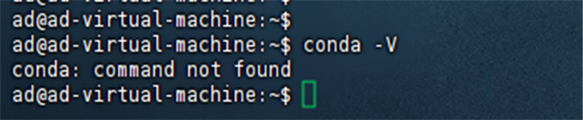

4、conda配置环境,默认没有配置环境(如下图)

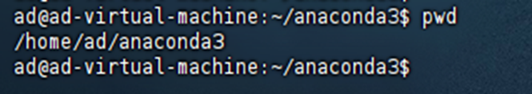

查看conda安装位置

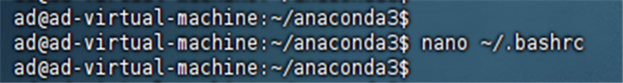

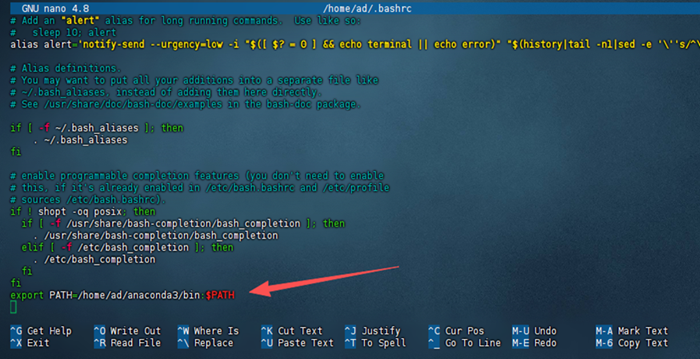

输入 nano ~/.bashrc

在bashrc文件的最后一行加入:export PATH=/home/ad/anaconda3/bin:$PATH (ad是自己的用户名)。按Ctrl+x 保存并退出编辑

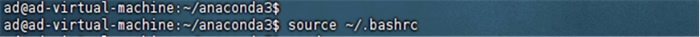

配置生效

用conda -V查看版本正常了

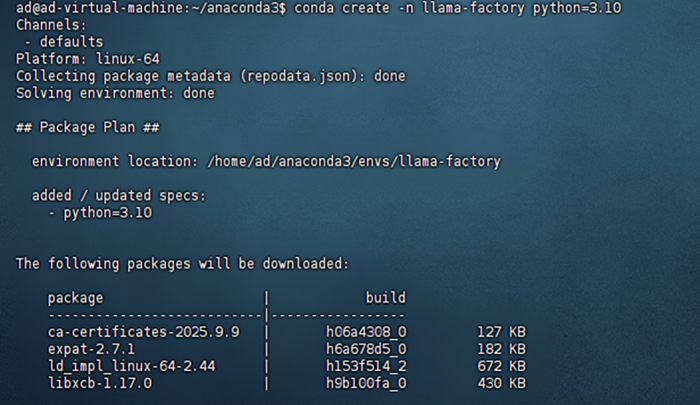

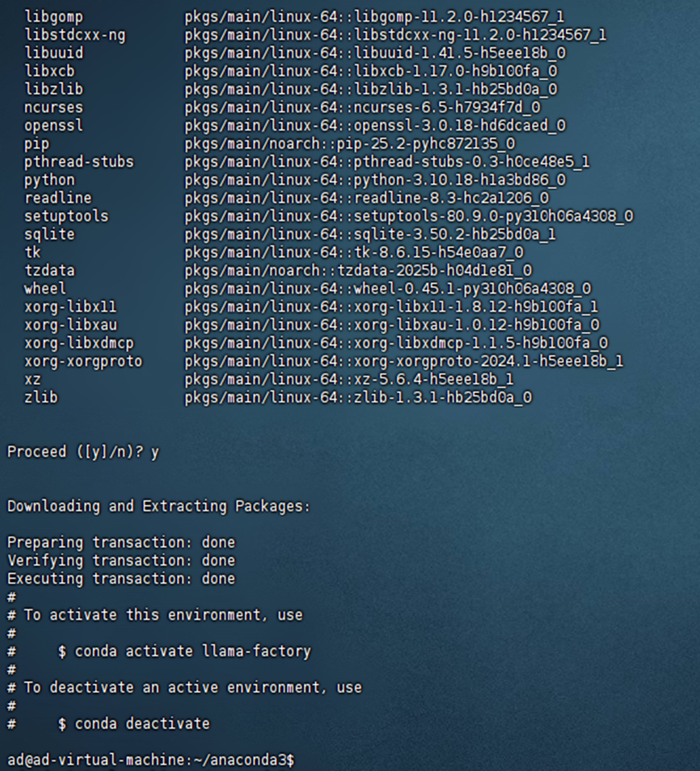

四、创建环境

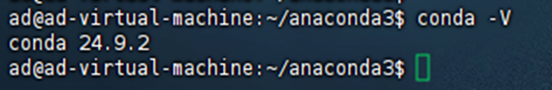

1、创建llama-factory微调环境

conda create -n llama-factory python=3.10

激活环境

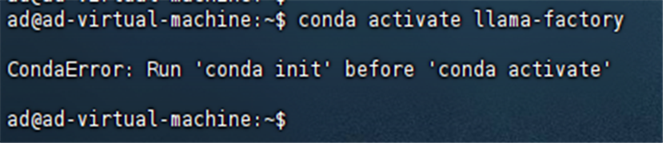

conda activate llama-factory

我这里配置环境后直接进入激活环境报错(要先初始化)

解决:

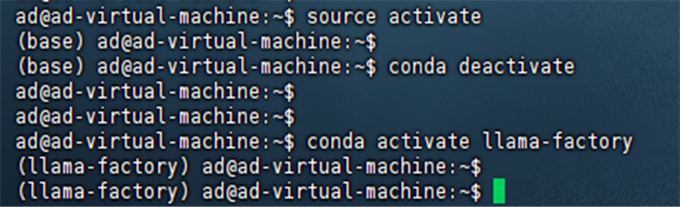

source activate(重新进入虚拟环境)

conda deactivate (退出性能环境)

conda activate llama-factory(重新激活虚拟环境)

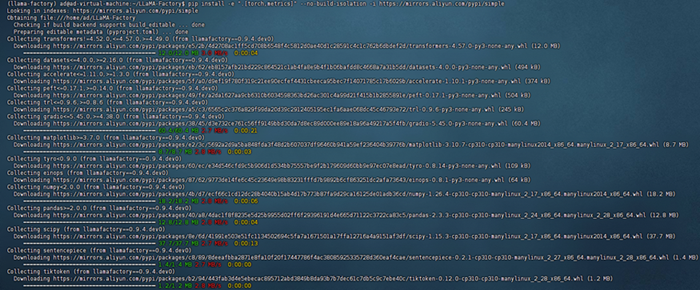

2、进入llama-factory环境后,进入到LLama-Factory文件下,安装相关依赖

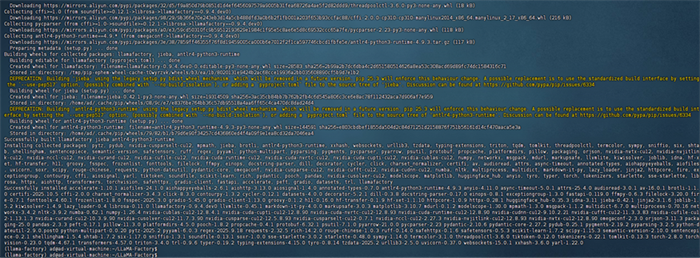

pip install -e “.[torch,metrics]” --no-build-isolation -i https://mirrors.aliyun.com/pypi/simple

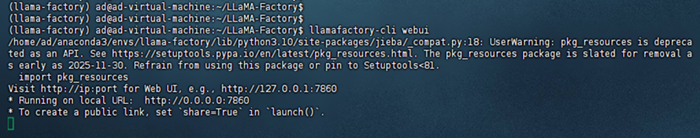

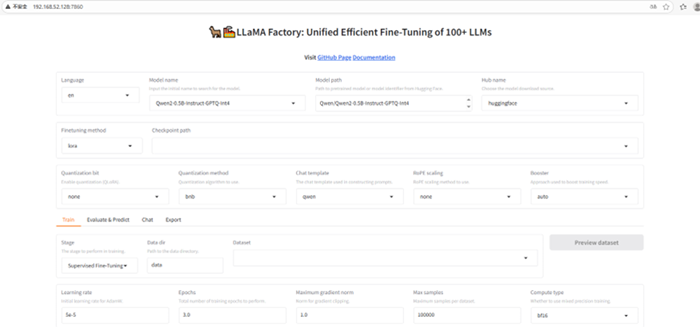

3、启动LLama-Factory

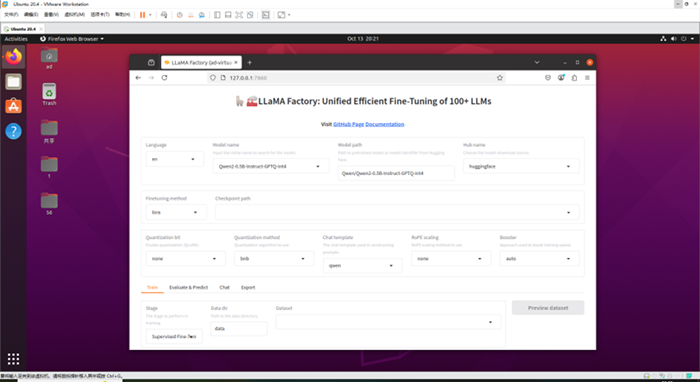

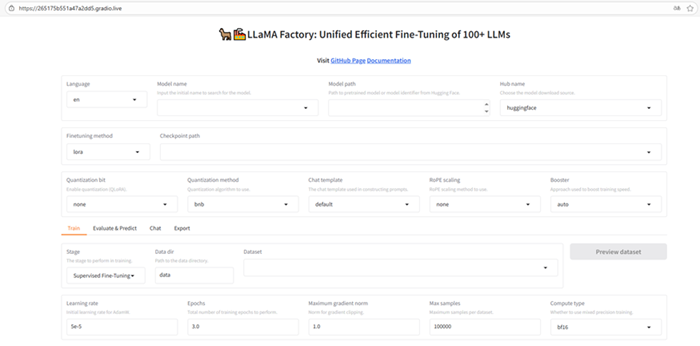

(这里我用的是虚拟机ubuntu20.4安装LLama-Factory,可以在win系统下通过虚拟机IP地址访问LLama-Factory界面)

ubuntu可视化系统也能访问LLama-Factory

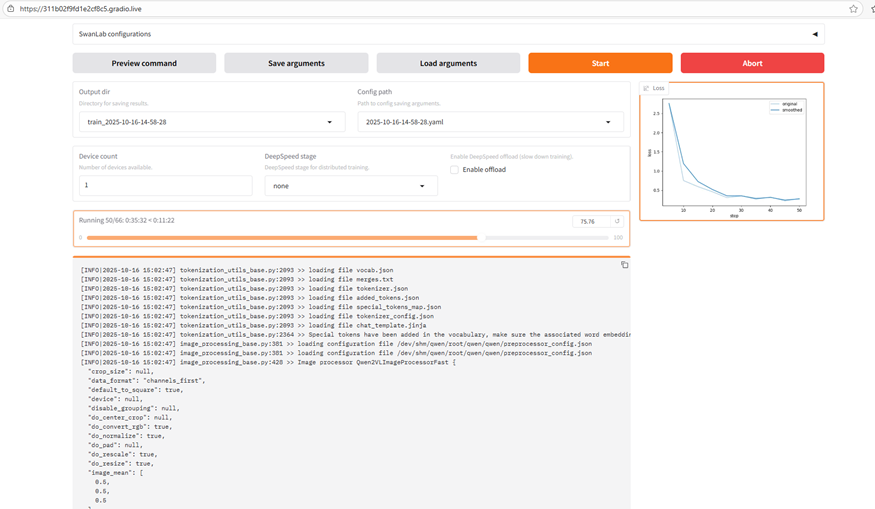

五、gradio公开域名微调

如果ubuntu是服务器版本没有桌面的,你又想使用图形化微调,可以通过gradio创建公开域名链接进行微调

0表示第一张显卡:CUDA_VISIBLE_DEVICES=0

1表示创建1个域名链接:GRADIO_SHARE=1

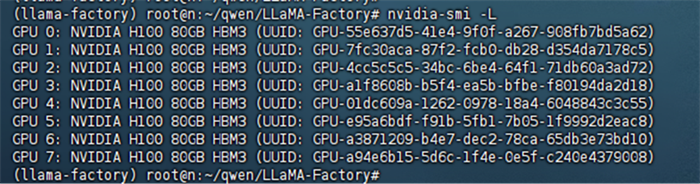

查看有多少张卡:

nvidia-smi -L

1、启动命令行:

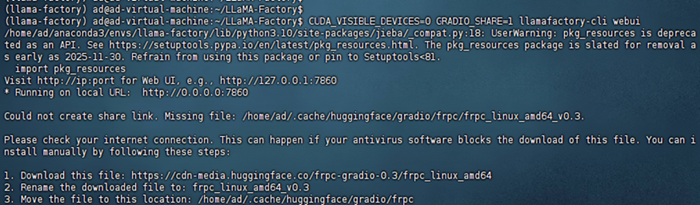

CUDA_VISIBLE_DEVICES=0 GRADIO_SHARE=1 llamafactory-cli

gradio报错:

解决:

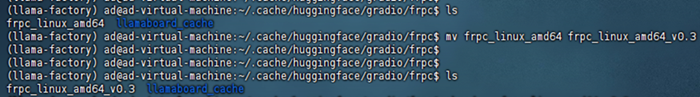

创建目录:mkdir -p /home/ad/.cache/huggingface/gradio/frpc

进入目录:cd /home/ad/.cache/huggingface/gradio/frpc

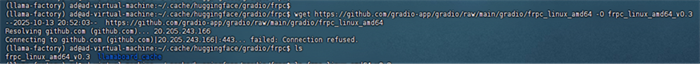

这个下载方式可能有问题:

wget https://github.com/gradio-app/gradio/raw/main/gradio/frpc_linux_amd64-O frpc_linux_amd64_v0.3

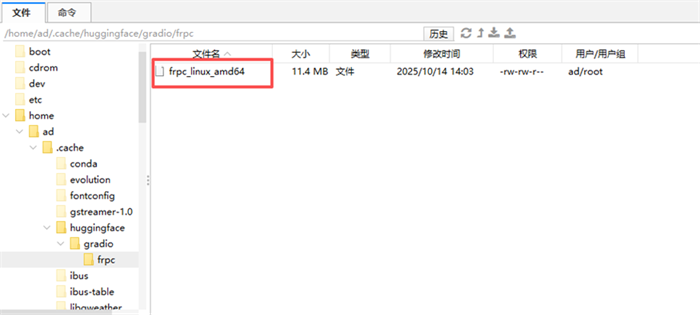

我用win浏览器下载,然后手动上传到frpc文件下:

链接:https://cdn-media.huggingface.co/frpc-gradio-0.3/frpc_linux_amd64

上传进frpc文件里,然后重命名 mv frpc_linux_amd64 frpc_linux_amd64_v0.3

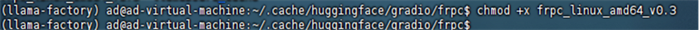

添加权限 chmod +x frpc_linux_amd64_v0.3

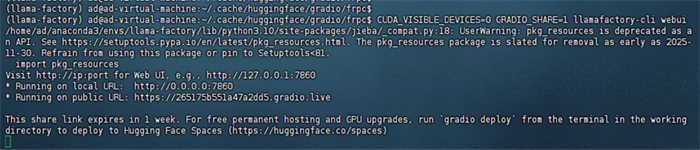

启动 CUDA_VISIBLE_DEVICES=0 GRADIO_SHARE=1 llamafactory-cli webui

这样就生成了一条公开域名,你也可以分享给其他人用:

https://265175b551a47a2dd5.gradio.live/

至此你已经部署好了LLaMA Factory

(如果你还不知道大模型数据集怎么制作、模型怎么下载,请在本公众号搜索相关文章学习。)

训练效果展示

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

17万+

17万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?