今天我们将探讨大模型微调的最新进展,总结微调过程的7个关键阶段,包括数据准备、模型初始化、训练环境配置、模型微调、模型评估与验证、模型部署,以及模型的监控与维护。大模型微调在现代人工智能应用中扮演着至关重要的角色,尤其是在需要提升模型在特定任务表现的场景中。

什么是大模型微调?

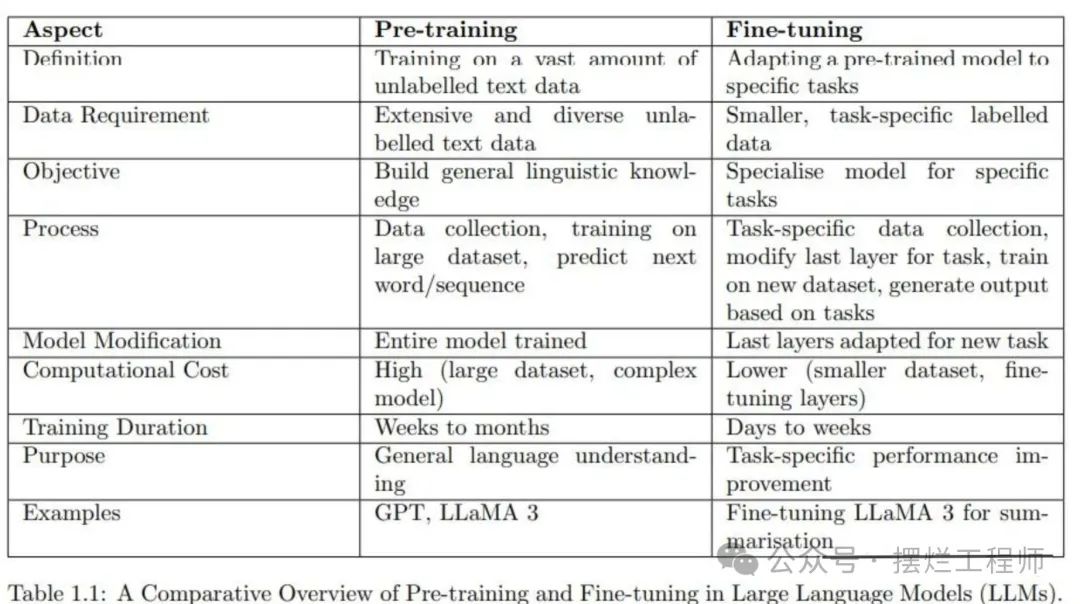

模型微调(Fine-Tuning)是基于预训练模型,通过较小的特定数据集对模型进行进一步训练的过程。它通过在预训练过程中获取的知识,结合任务相关的数据,减少了训练时间和计算成本,显著提升了模型在特定任务中的表现。

大模型微调的优势

- 迁移学习:微调过程利用了预训练模型所积累的知识,通过较少的计算资源和时间,将模型调整为适合特定任务的状态。

- 减少数据需求:微调往往只需要较少的标注数据,重点是将预训练的特征调整为适应目标任务的需求。

- 改善泛化能力:通过微调,模型在特定领域中的泛化能力得到增强,更好地捕捉通用的语言特征并加以定制化。

- 高效模型部署:微调后的模型计算效率更高,适用于实际应用中的特定任务。

- 适应多任务能力:微调模型可以适应广泛的任务类型,在各种应用中都表现出色。

- 特定领域的优异性能:通过调整模型对特定领域的词汇和细微差别的理解,微调模型在领域任务中的表现更加精准。

- 更快收敛:由于微调基于通用的语言特征权重,训练过程收敛速度更快。

尽管通过提示工程或检索增强生成(RAG)技术能够解决许多任务,但如果需要模型更好地调整行为、写作风格,或融入某些特定领域的知识,微调仍然是不可或缺的步骤。

大模型微调的7个阶段

- 数据准备

准备适合目标任务的数据集,包括数据清洗、标注和格式转换,以确保模型能够高效学习任务相关的特征。 - 模型初始化

选择并加载一个合适的预训练模型,为微调提供强大的基础。选择正确的初始化方式能够大大提升后续的微调效果。 - 训练环境配置

配置适合训练的硬件环境,例如高效利用GPU或TPU,设置超参数,并确保环境兼容模型和数据的需求。 - 微调技术

通过少量特定任务的数据,对模型进行进一步训练,调整模型的参数以适应新的任务要求。常见技术包括学习率调节、正则化方法和混合精度训练。 - 评估与验证

使用验证集对微调后的模型进行评估,确保其在目标任务上的效果优异。验证阶段通常还包括性能分析和错误分析,以进一步优化模型。 - 模型部署

将微调后的模型集成到生产环境中,确保其稳定高效地执行任务。这一阶段需要考虑模型的规模、响应速度以及与其他系统的集成。 - 模型监控与维护

持续监控模型的表现,包括性能监控、准确性监控、错误率分析和日志分析等。同时设置反馈循环和警报机制,以便在模型出现问题时及时采取措施。此外,还需要定期进行模型的知识更新,确保其与最新数据保持一致。

结语

大模型的微调不仅能够提升模型在特定任务中的表现,还为实现高效的模型部署和持续维护提供了可能。通过优化微调流程,开发者可以构建出更具泛化能力和特定领域表现的模型,满足广泛的应用需求。

如何学习大模型

现在社会上大模型越来越普及了,已经有很多人都想往这里面扎,但是却找不到适合的方法去学习。

作为一名资深码农,初入大模型时也吃了很多亏,踩了无数坑。现在我想把我的经验和知识分享给你们,帮助你们学习AI大模型,能够解决你们学习中的困难。

下面这些都是我当初辛苦整理和花钱购买的资料,现在我已将重要的AI大模型资料包括市面上AI大模型各大白皮书、AGI大模型系统学习路线、AI大模型视频教程、实战学习,等录播视频免费分享出来,需要的小伙伴可以扫取。

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,我下面分享的这个学习路线希望能够帮助到你们学习AI大模型。

二、AI大模型视频教程

三、AI大模型各大学习书籍

四、AI大模型各大场景实战案例

五、结束语

学习AI大模型是当前科技发展的趋势,它不仅能够为我们提供更多的机会和挑战,还能够让我们更好地理解和应用人工智能技术。通过学习AI大模型,我们可以深入了解深度学习、神经网络等核心概念,并将其应用于自然语言处理、计算机视觉、语音识别等领域。同时,掌握AI大模型还能够为我们的职业发展增添竞争力,成为未来技术领域的领导者。

再者,学习AI大模型也能为我们自己创造更多的价值,提供更多的岗位以及副业创收,让自己的生活更上一层楼。

因此,学习AI大模型是一项有前景且值得投入的时间和精力的重要选择。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?