加速生成式人工智能: 训练计划与方案

关键字: [Amazon Web Services re:Invent 2024, 亚马逊云科技, 生成式AI, SageMaker HyperPod Recipes, Training Large-Scale Models, Hyperpod Training Plans, Foundation Model Customization, Hyperpod Recipes, Distributed Training Optimization]

导读

Amazon SageMaker HyperPod 专为开发基础模型(FM)而设计,可将训练时间缩短多达40%。为了进一步加速生成式AI创新,SageMaker HyperPod 现在允许用户创建灵活的训练计划,包含多个加速计算资源块,使他们能够在预算和时间范围内训练基础模型。此外,用户可以使用现成的 SageMaker HyperPod 配方快速上手,以最先进的性价比在数小时内(而非数周)训练和微调流行的公开可用基础模型。

演讲精华

以下是小编为您整理的本次演讲的精华。

大规模AI模型的构建和训练需求在过去几年里显著增加。随着模型规模的扩大,纳入更多数据和计算资源,它们可以取得更好的结果,并在现有用例中实现改进,同时还能实现以前无法实现的全新应用。然而,训练这些庞大的模型并非易事,存在诸多挑战。

其中一个主要挑战是需要利用最新最先进的硬件,如配备最新Nvidia GPU或Trillium芯片的新型实例。采用尖端硬件可以显著加快训练过程,使公司能够更快地将产品推向市场,并在竞争对手之前抢占新兴用例。

另一个关键挑战是应对大规模训练过程中不可避免的故障。在如此大规模的训练中,故障难免会发生,因此能够快速从这些故障中恢复并继续训练而不会过多延迟至关重要。如果做不到这一点,可能会导致重大挫折和错失机会。

满足可预测的时间线也是一个关键考虑因素。公司通常努力成为首个推出新产品或实现最新基准的公司,从而使模型训练的可预测时间线成为必需。训练延迟可能会导致错失机会和失去竞争优势。

通过有效地在用于训练的大型集群中分发数据和模型来优化性能也是一个关键因素。适当的分发可以确保训练过程尽可能快速进行,从而最大限度地缩短实现预期结果所需的时间。

成本是训练大规模模型时另一个重大挑战。这些工作很容易耗费数十万美元或更多,因此确保集群得到高效利用以最大限度地提高投资回报率至关重要。如果做不到这一点,可能会导致重大财务损失。

最后,还需要考虑负责训练过程的数据科学团队的生产力和效率。许多客户将此列为最高优先事项,只要他们的团队在快速有效地训练模型方面不受阻碍,他们就愿意投入更多资源。

为了应对这些挑战,亚马逊云科技去年推出了SageMaker Hyperpod。Hyperpod旨在通过提高弹性和性能优化,将训练时间缩短高达40%。Hyperpod的弹性功能使其能够通过分析发生在大规模训练过程中的错误类型并采取适当行动(如替换实例并自动恢复训练)来自动缓解这些错误。与手动调试、诊断和解决问题相比,这可以节省大量时间。

此外,Hyperpod有助于以高效的方式在集群中分发模型和数据,从而加快大规模训练。尽管功能强大,但Hyperpod仍然高度可定制,允许用户利用Amazon EKS或Slurm进行调度,集成自己的框架和库,并使用各种工具来观察训练过程。

然而,即使使用Hyperpod,由于需求量大,客户在获取所需的最新加速器实例容量方面仍面临挑战。仅依赖按需实例存在无法获得所需容量的风险,可能会延迟时间表。另一方面,通过长期预留来预留容量可以提供可预测的时间线,但如果训练不是连续进行,可能会导致集群利用率低下,从而浪费资源和增加成本。

为了解决这个问题,亚马逊云科技在几天前的re:Invent活动上宣布了Hyperpod的灵活训练计划。训练计划由EC2容量预留提供支持,使客户能够消除获取所需计算容量时所涉及的不确定性和手动流程。

使用训练计划,客户可以指定需求,如所需的实例类型、实例数量、训练的最早开始日期和预期持续时间。亚马逊云科技将为训练计划提供建议报价,客户可以预先购买以预留容量。

训练计划可与Hyperpod以及SageMaker的全托管训练作业一起使用。例如,如果客户需要10个P5实例类型的实例,持续时间为14天,从12月10日开始,亚马逊云科技可能能够提供一个连续的容量段来满足这些要求,或者提供两个单独的7天容量段,让客户可以尽快完成训练。

购买训练计划后,客户可以将其与Hyperpod集群及集群中的特定实例组相关联。当训练计划在指定的开始日期开始时,Hyperpod将自动扩展关联的实例组以利用预留的容量。Hyperpod还将运行任何必需的生命周期脚本并执行深度健康检查,以确保实例和连接正常运行。

如果在训练过程中发生故障,Hyperpod将自动缓解故障并尽快恢复训练。如果容量段之间有间隙,Hyperpod将处理关闭集群并在下一个容量段可用时重新启动集群。

使用训练计划和Hyperpod的好处包括更容易获得最新计算资源、通过Hyperpod的故障缓解功能实现弹性、可预测的时间线、通过Hyperpod的分布式训练库实现高性能,以及预先知道预留容量的成本。

虽然训练计划有助于客户在预期时间线和预算内获得可预测的加速计算实例访问权限,但公司在使用生成式AI和大型基础模型时也面临其他挑战。一个常见问题是使用哪些模型以及如何轻松定制它们以适应特定任务或领域。

定制基础模型通常涉及诸如在标注数据集上进行微调以训练模型用于特定任务(如文本摘要或问答),或在未标注数据上进行预训练以保持模型在特定领域(如使用医学期刊和研究论文来增强模型对医疗术语的了解)的准确性等技术。

然而,对基础模型进行定制和执行微调或预训练是一项复杂的任务。它需要选择合适的模型、为所选基础设施上的分布式训练配置框架,以及优化训练过程的各个方面,如并行技术、内存利用率、检查点频率和超参数调优。

这个迭代实验过程涉及导航众多配置选项和可调参数,往往会导致项目延迟、模型性能不佳和预算超支,即使对于经验丰富的团队也是如此。

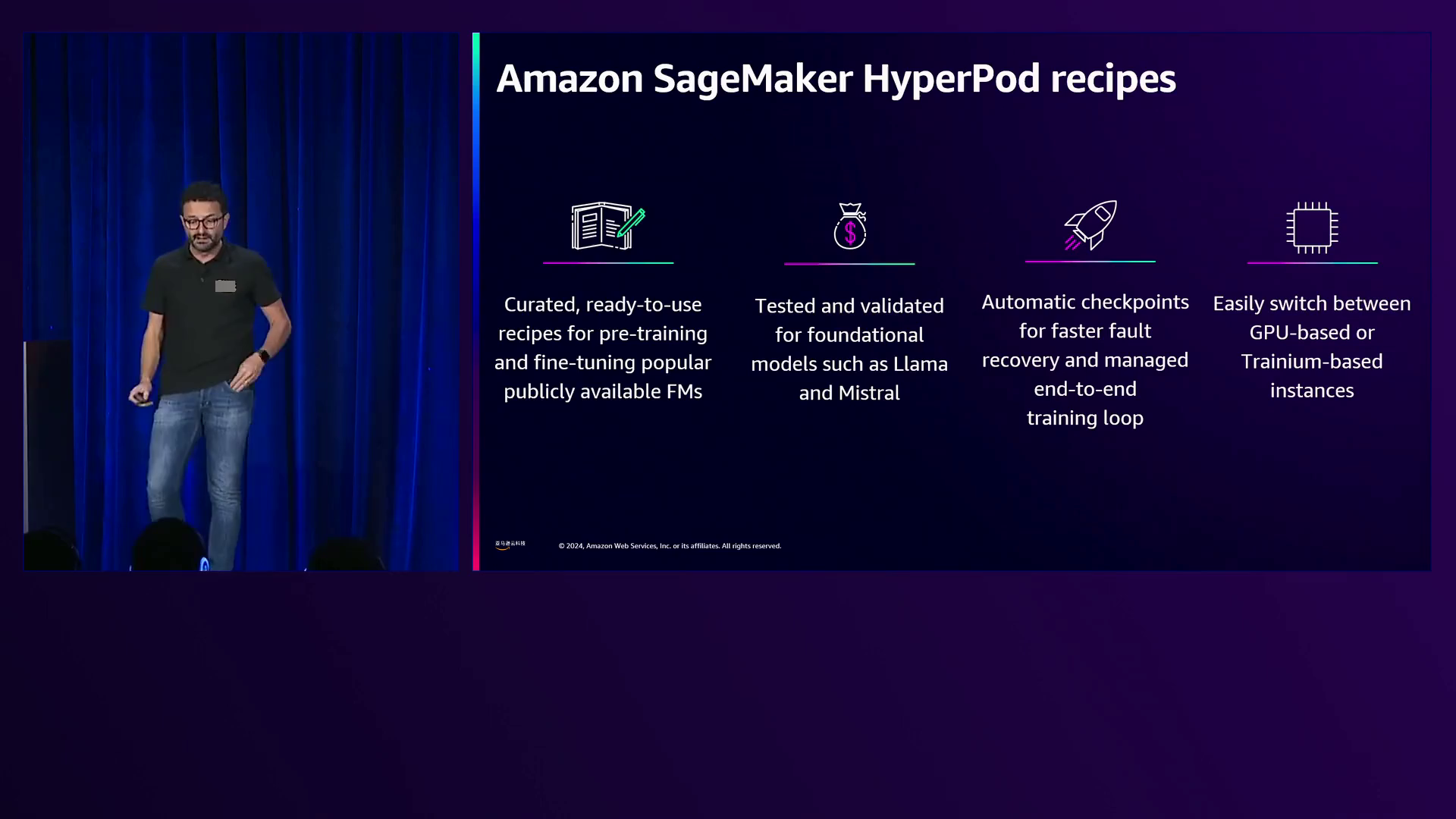

为了简化配置和优化基础模型训练的过程而不牺牲性能,亚马逊云科技推出了SageMaker Hyperpod Recipes。这些配方提供了用于预训练和微调流行的公开可用基础模型(如LLaMa、Mistral和Mixture)的经过精心策划的现成配置。

这些配方旨在让数据科学家和机器学习工程师能够加速使用基础模型的工作。它们自动化了端到端的训练循环,包括高效的资源利用和自动模型检查点技术,使用户能够以高频率保存正在进行的模型结果,并在无需额外代码更改的情况下快速从故障中恢复。

这些配方可以轻松定制以适应不同的序列长度、模型大小和实例类型,只需简单的配置更改即可在GPU实例和其他加速器(如Trainium实例)之间切换。

亚马逊云科技构建了各种启动器来促进这些配方的执行,包括对熟悉Nvidia Nemo框架的用户来说很熟悉的Nemo风格的启动器、自动为使用Slurm协调的Hyperpod集群设置参数的启动器脚本,以及用于EKS协调的Hyperpod集群的Hyperpod CLI扩展。此外,SageMaker Python SDK已经更新,支持使用新的ModelTrainer类或现有的Estimator类运行配方训练。

这些配方包含在一个公共GitHub存储库中,其中包括启动器脚本、配方集合以及执行训练的实际实现代码。有超过30个配方可供开始使用,支持SageMaker GPU优化模型、用于Trainium实例的Neuron优化模型、原生Nemo模型,以及引入自定义模型的能力。

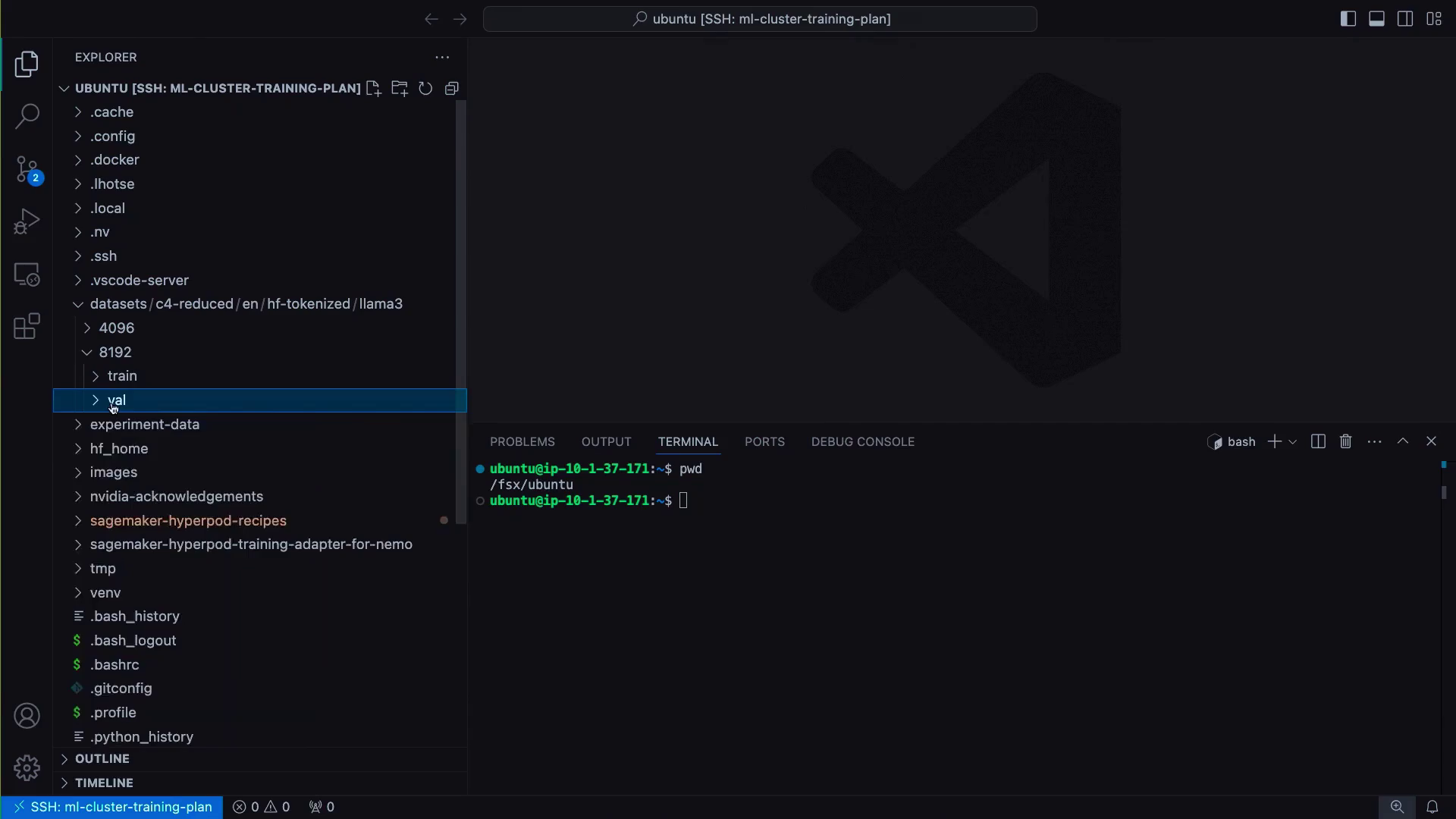

Giuseppe Vietri演示了如何使用其中一个配方在AllenAI C4数据集上对3B参数LLaMa模型进行微调,运行在配备了活跃训练计划预留的Hyperpod集群上。这些配方简化了启动多节点分布式训练作业的过程,展示了Hyperpod Recipes提供的易用性和性能优化。

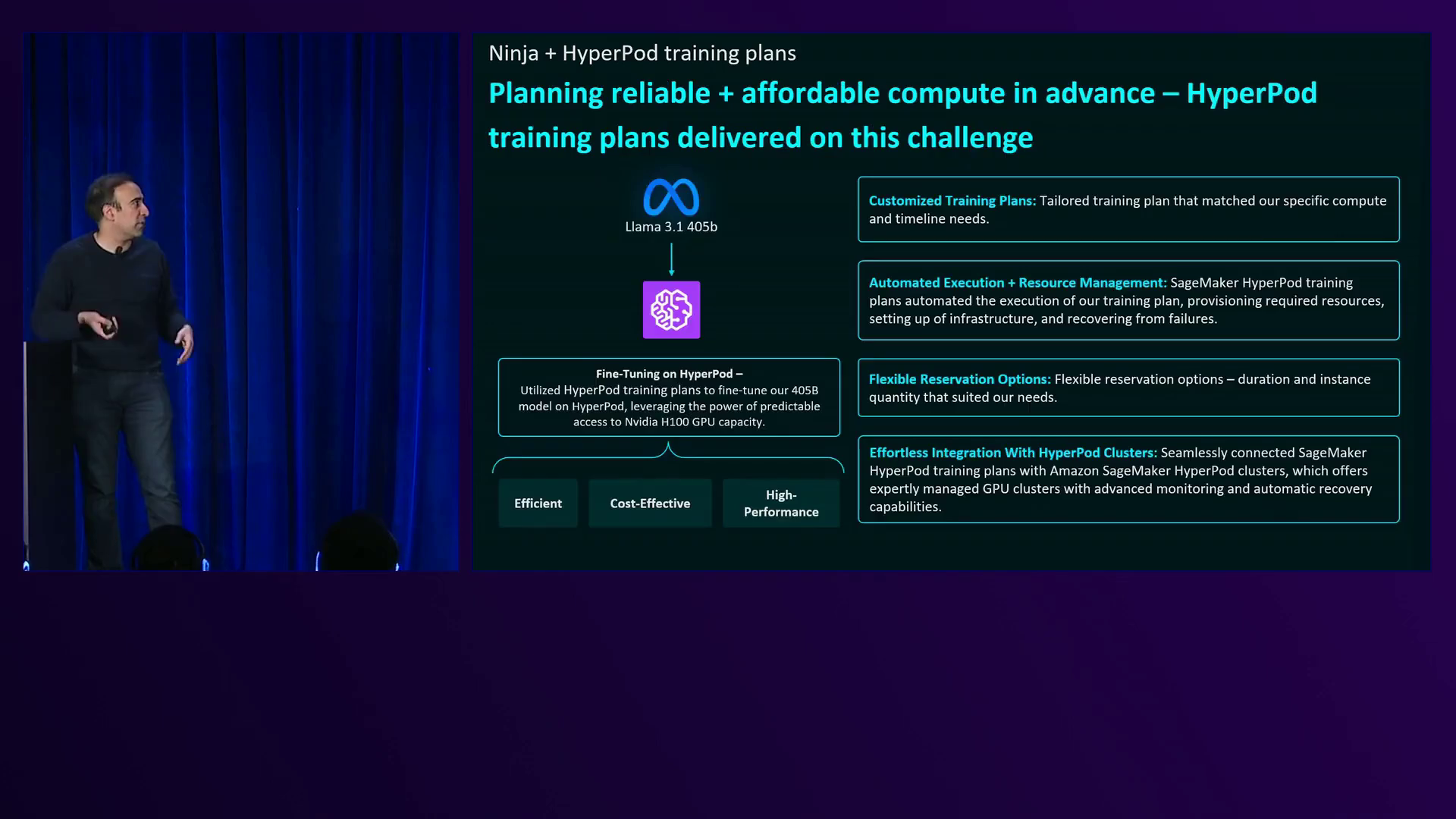

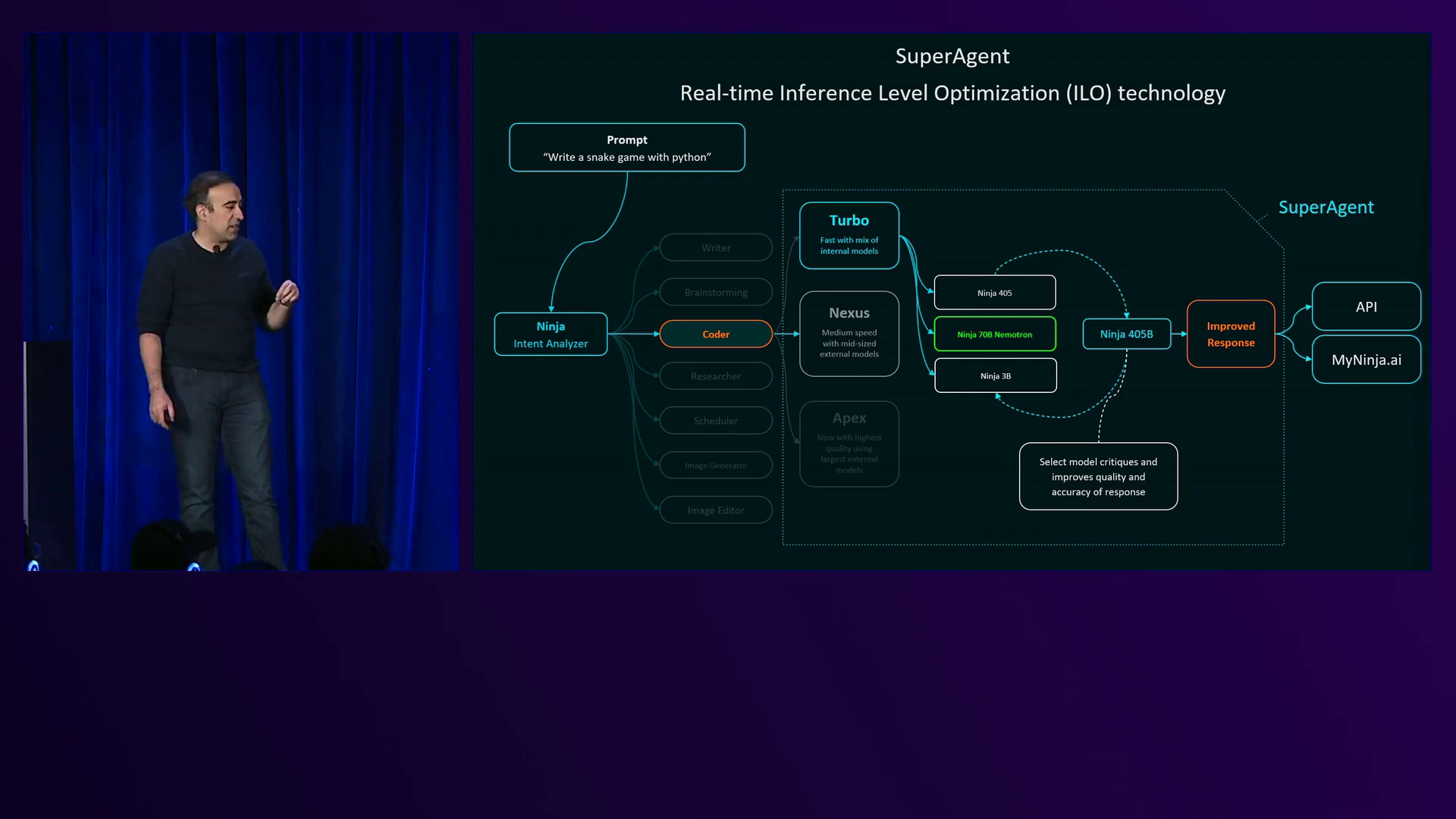

Babak Hodjat,Anthropic spin-out Ninja Tech AI的创始人,分享了他的初创公司如何利用Hyperpod Training Plans和Recipes在生成式AI领域进行创新。Ninja Tech AI是一款“全能AI代理”产品,旨在成为“生成式AI的Netflix”,提供简单的订阅服务,无限制地访问最佳AI代理、模型和技能。

Ninja Tech AI的核心技术是能够自动检测用户意图,并根据查询激活适当的AI代理或模型。这使得该平台能够支持广泛的任务,包括写作、头脑风暴、编码、研究、多步在线调度、图像生成、图像编辑,以及即将推出的视频、音乐和音频功能。

然而,为了实现如此多样化的功能并持续提高其AI代理的性能,Ninja Tech AI需要能够快速高效地微调其模型。每天有数万名用户产生超过50,000个任务,这家初创公司可以获得大量数据来进一步完善其模型。

在有限资源的情况下,以这种规模进行微调是一个重大挑战。Ninja Tech AI的核心引擎由40B参数的开源模型LLaMa驱动,微调需要大量计算资源。之前,该公司不得不依赖手动检查点和恢复过程,经常需要工程师通宵监控节点以确保成功训练。

Hyperpod Recipes的引入为Ninja Tech AI带来了革命性的变化,使他们能够执行以前对于初创公司来说是不可行的训练任务。Babak Hodjat将Hyperpod Recipes比作他们运营的“盘尼西林”,提供了无可否认的价值主张。

Hyperpod Recipes对Ninja Tech AI的一大优势是能够进行具有自我恢复能力的多节点训练。这使得该初创公司能够以经济高效的方式微调大型模型,无需大量人工干预或专门的MLOps和训练管理团队。

Babak演示了一个由Ninja Tech AI使用Hyperpod Recipes的多节点配置训练的语音对话AI模型。这个从LLaMa模型微调而来的模型能够理解语音标记,仅用了14个小时和不到5,000美元的成本就完成了训练——这对于一家初创公司来说是难以做到的,如果没有Hyperpod Recipes。

这个语音模型的成功使Ninja Tech AI能够将其纳入核心的“超级代理”技术中,该技术实时组合和优化多个AI模型以提高性能。这种方法使该初创公司在某些任务上的表现超过了OpenAI的旗舰模型,如推理和数学。

Ninja Tech AI的“超级代理”技术已在其产品中上线,展示其能力的基准测试结果已在其网站上发布。Babak自豪地表示,即使是他们使用完全内部微调模型的“turbo”版本,在某些基准测试中也优于旗舰模型。

Babak强调的一个显著成就是Ninja Tech AI在评估聊天互动质量的ArenaHard基准测试中的出色表现。据Babak称,他们的“超级忍者”层级已超过了OpenAI模型的表现,包括未发布的GPT-4。

Ninja Tech AI在生成式AI创新方面的成功可归功于Hyperpod Training Plans和Recipes的结合。Training Plans通过容量预留提供了负担得起的高性能GPU访问,而Recipes则简化了微调大型模型的复杂过程,使这家初创公司能够取得以前无法企及的成果。

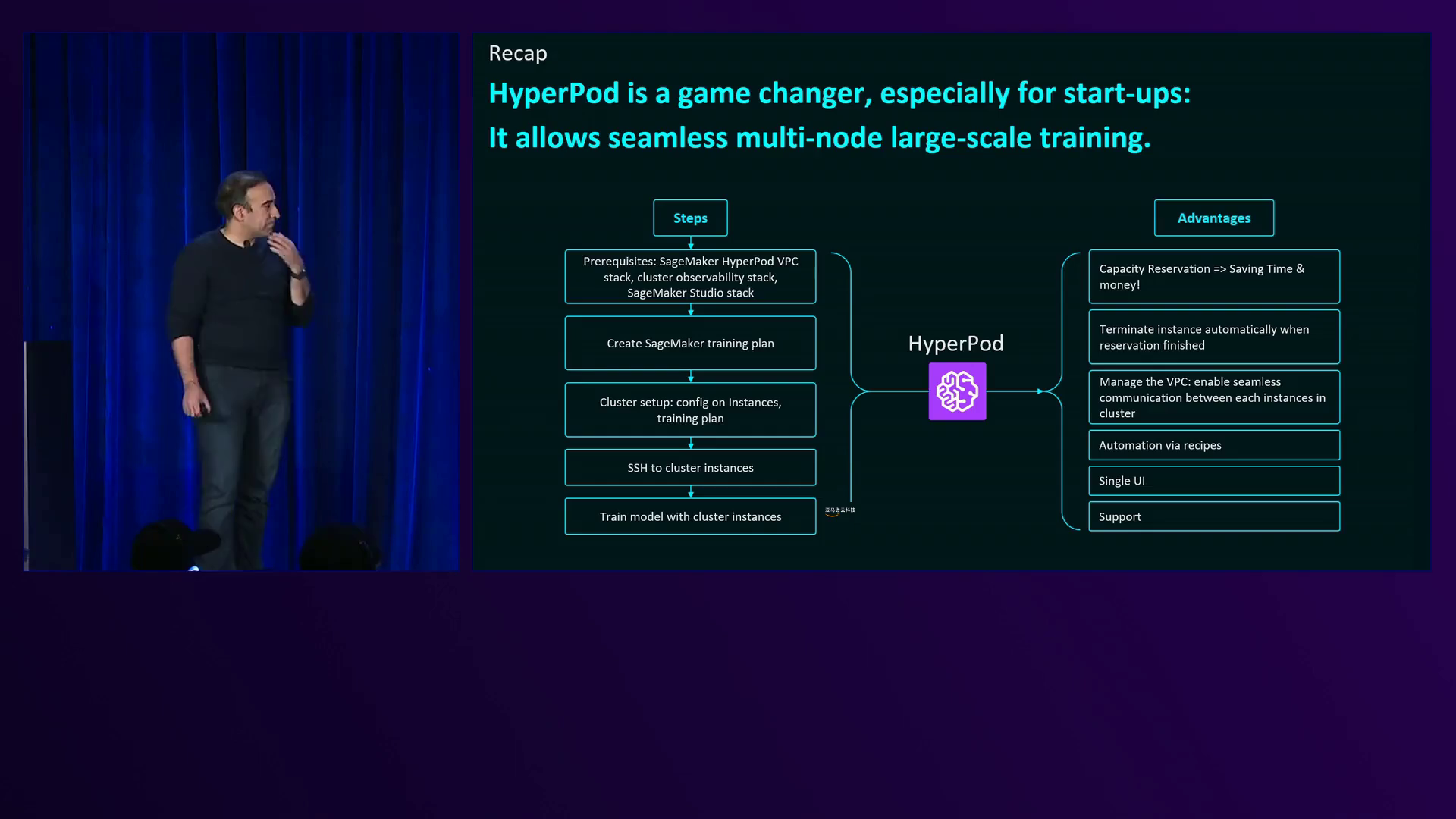

Babak强调了Hyperpod Recipes的优势,包括容量预留和折扣、训练后自动终止实例、无缝管理GPU以及由食谱本身提供的精心优化配置。统一的UI和亚马逊云科技团队的支持也对Ninja Tech AI采用这些技术至关重要。

总之,这段视频展示了亚马逊云科技的SageMaker Hyperpod、Training Plans和Recipes如何解决训练大规模AI模型的挑战,并推动生成式AI的创新。Training Plans提供了可预测、负担得起的最新计算资源访问,而Hyperpod Recipes则简化了大规模定制和优化基础模型的复杂过程。这些功能使得Ninja Tech AI等公司能够突破生成式AI的界限,设立新的基准并为客户提供前沿产品。

下面是一些演讲现场的精彩瞬间:

演讲者讨论了训练大规模模型的挑战,并介绍了训练计划和配方,随后进行了一次演示,展示了这些功能,以及来自Ninja Tech的客户案例。

Amazon SageMaker HyperPod配方能够高效且成本优化地进行大型语言模型的预训练和微调,具有自动模型检查点和故障恢复功能。

演示了使用预构建的enroot镜像在SLURM集群上运行分布式训练,并使用HyperPod配方。

HyperPod配方使该公司能够进行大规模多节点训练,具有自我恢复能力,节省时间和资源,作为一家初创公司,开启了新的可能性。

介绍了一种突破性的人工智能系统,可以直接理解和响应语音输入,无需依赖语音转文本转换,实现无缝语音交互,在对话式人工智能领域开启新的可能性。

演讲者强调了使用HyperPod配方的优势,包括易于设置、价格实惠、容量预留、GPU管理以及与单一用户界面和支持的无缝集成,从而实现高效且经济的人工智能模型训练和微调。

总结

在这个引人入胜的叙述中,我们探索了通过在亚马逊云科技 HyperPod上的训练计划和配置加速生成式人工智能的领域。演讲者们揭示了训练大规模模型的挑战,例如利用最新硬件、缓解故障、确保可预测的时间线、优化性能和管理成本。他们介绍了HyperPod训练计划,这使用户能够提前预留计算能力,确保在指定预算内按时训练模型。

此外,他们还揭示了HyperPod配置,这些精心设计的配置简化了对基础模型(如LLaMA)的定制和优化。这些配置简化了微调和预训练的过程,实现了高效的资源利用和成本优化。现场演示展示了使用HyperPod配置无缝执行微调任务的过程,彰显了这些工具的强大功能。

NinjaTechAI的创始人Baba分享了他的公司利用HyperPod配置实现变革性进展的经历。通过利用这些工具,NinjaTechAI取得了突破性的里程碑,例如训练了一个对话式LLaMA模型,并在人工智能能力(如推理和数学)方面创造了最新水平的基准。这个叙述以号召行动作为结尾,邀请观众体验HyperPod训练计划和配置为加速生成式人工智能努力所带来的力量。

亚马逊云科技(Amazon Web Services)是全球云计算的开创者和引领者。提供200多类广泛而深入的云服务,服务全球245个国家和地区的数百万客户。做为全球生成式AI前行者,亚马逊云科技正在携手广泛的客户和合作伙伴,缔造可见的商业价值 – 汇集全球40余款大模型,亚马逊云科技为10万家全球企业提供AI及机器学习服务,守护3/4中国企业出海。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?