文章目录

1. Adam优化器,BN的作用,为什么能加快收敛速度?

Adam优化器主要是在计算梯度的时候采取了随机梯度的方式,但是这样容易陷入局部最优。因此在此基础上又使用梯度的一阶矩来动态调整模型的学习率。起始就是类似于惯性。

优点在于经过偏置校正后,每一次迭代学习率都有一个确定范围,使得参数比较平稳。

BN的作用是模型在训练过程中由于每一个batch样本差别很大,直接训练的话输入网络的数据波动大,不利于收敛。因此,采用“减均值,除以方差”的归一化操作。之后经过线性变换y=scale*x+shift反归一化。

2. 解释一下BN

主要解决深度神经网络调参复杂,收敛速度慢以及优化困难的问题。

对于训练数据,可以计算均值和方差;但是对于测试数据就无法计算,因此这个时候使用的是全量数据的均值和方差。在训练完成之后,会保存全量数据的均值和方差以处理测试数据。

3. BN的gama labada意义是什么

因为减均值,除以方差之后数据的分布变了,因此gama labada参数提供的线性尺度变换会恢复它原本的分布。

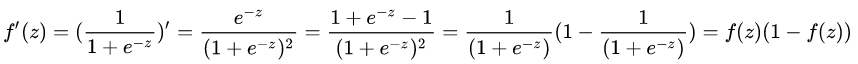

4. Sigmoid求导是什么

5.当你选择模型考虑哪些因素

模型效果;模型复杂度;模型优化的可能性性

6. 什么是wide&deep

模型考虑的主要是拟合能力和泛化能力,对应到推荐系统中就是记忆性和泛化性。wide&deep的思想和这个差

文章探讨了Adam优化器和BN层如何加速模型收敛,解释了BN的归一化作用。还涉及Sigmoid函数的导数、模型选择的因素、wide&deep模型在推荐系统中的应用,以及NLP的基本概念和推荐系统的召回与排序策略,特别提到了YouTube的召回模型设计。

文章探讨了Adam优化器和BN层如何加速模型收敛,解释了BN的归一化作用。还涉及Sigmoid函数的导数、模型选择的因素、wide&deep模型在推荐系统中的应用,以及NLP的基本概念和推荐系统的召回与排序策略,特别提到了YouTube的召回模型设计。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

414

414

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?