(超爽中英!) 2024公认最好的【吴恩达深度学习】教程!附课件代码 Professionalization of Deep Learning

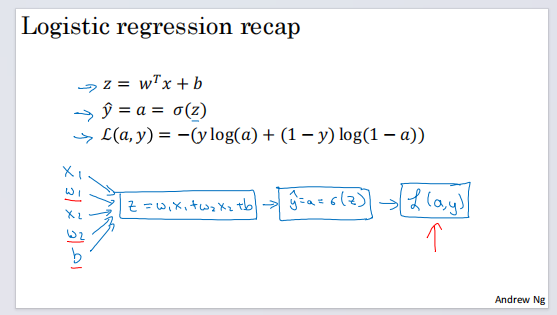

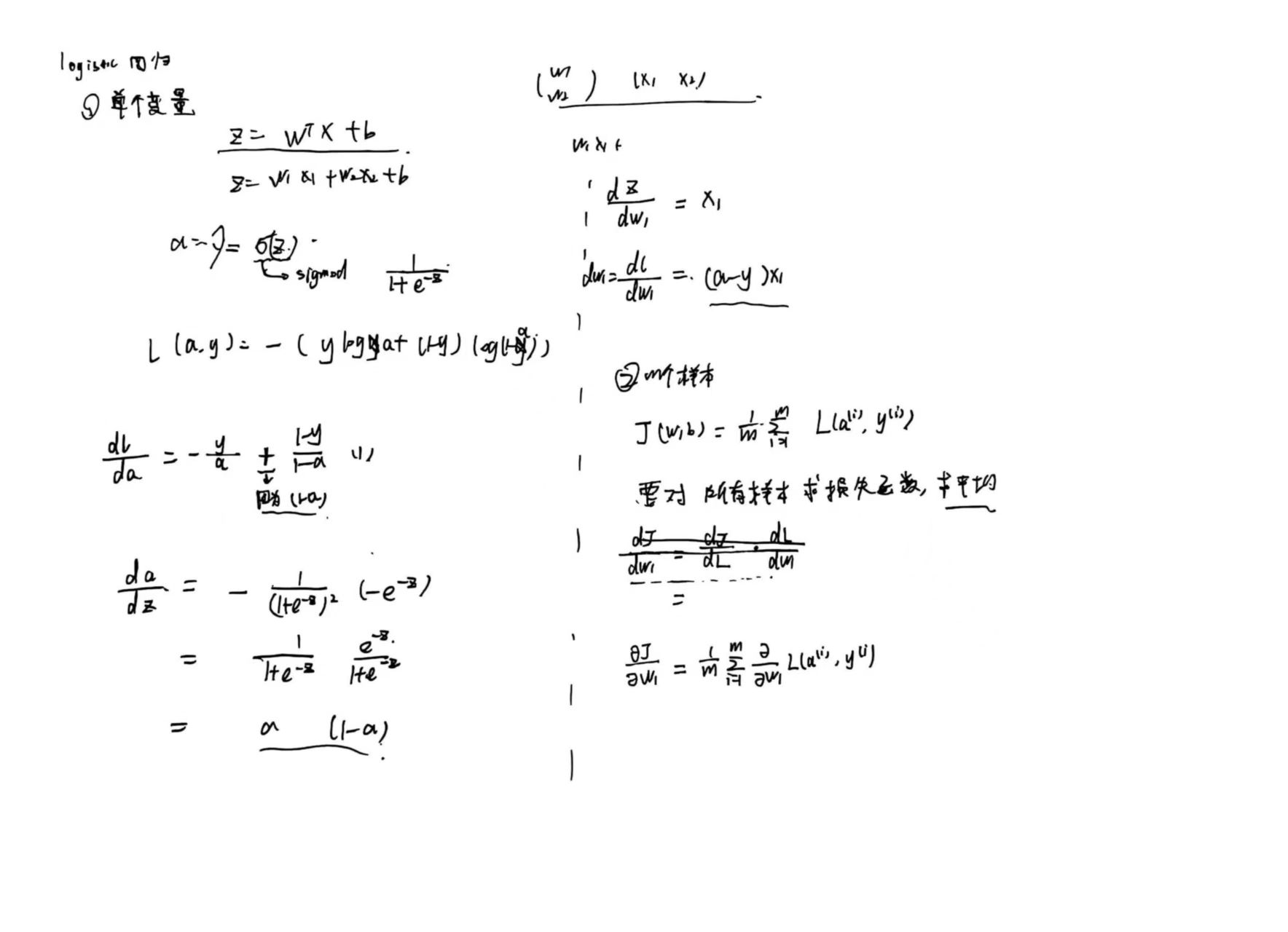

单个变量

用a表示y帽,因为代码中没法打出 y帽 这个符号

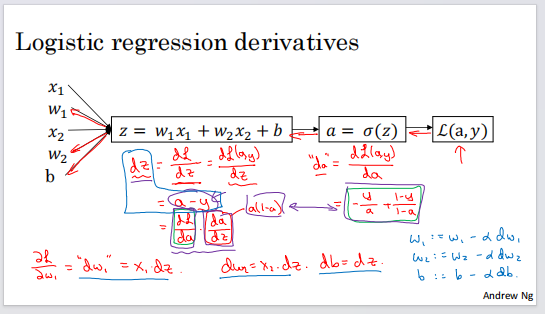

这是计算导数的完整过程,注意da/dz这个导数,要记得sigmod函数的原型

计算出来最终值对某一个变量的导数后,根据之前讲过的迭代方法,设置学习率更新变量

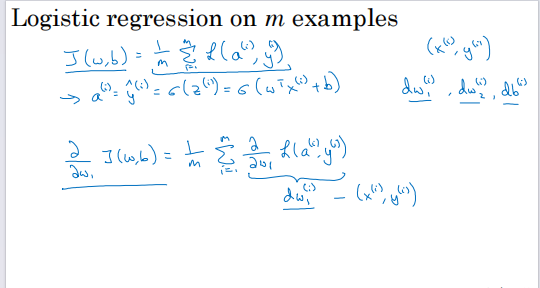

m个样本的梯度下降

成本函数J对w1求导数,就是各损失函数对w1导数的平均值

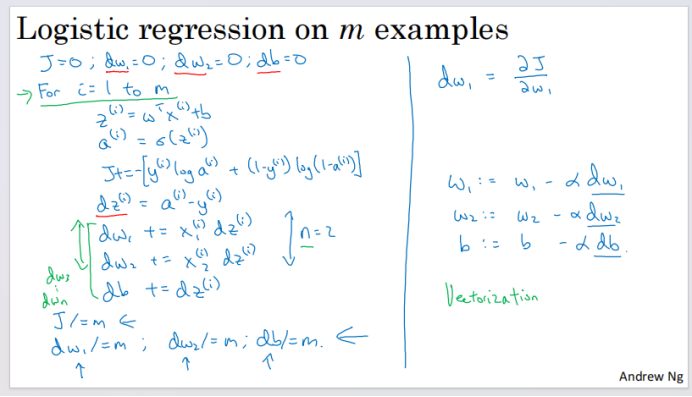

左边展示了如何编程实现求成本函数的导数

注意dw1等,使用了每个循环累加的策略,因此它代表总和,所以不需要上标i

之后进行更新,就完成了迭代

上图方法的缺点:

循环降低了代码运行效率,这里有两个循环。

循环1:样本从1到m;循环2:x,w是多维的,要循环计算每一行的值,才能得到向量

所以,需要使用矢量化技术!

自己的演草

77

77

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?