批归一化解决的问题是:面临网络层较深的神经网络时,会导致上层梯度较大,下层梯度较小。这一现象就导致了上层梯度对下层的特征变化极敏感,会导致上层频频重新学习,神经网络收敛速度太慢。

批量归一化

把数据分布特征不统一的数据特征,统一按层归一化为符合(0,1)的正态分布

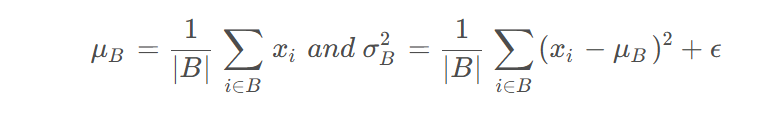

B代表mini-batch(特征样本量),μ B 代表均值,σ B 代表方差,ϵ 是一个很小的数(用于调节方差不为0)。

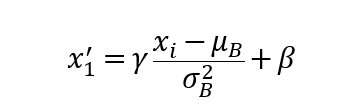

x i是我们的小批量中的某个输入,减去均值再处以方差得到输出。μ B 和σ B 是根据批量算出来的。这里的γ和β是机器可以学习的参数

434

434

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?