1.安装Ollama

Ollama的官网:https://ollama.com/

可以使用命令安装

curl -fsSL https://ollama.com/install.sh | sh

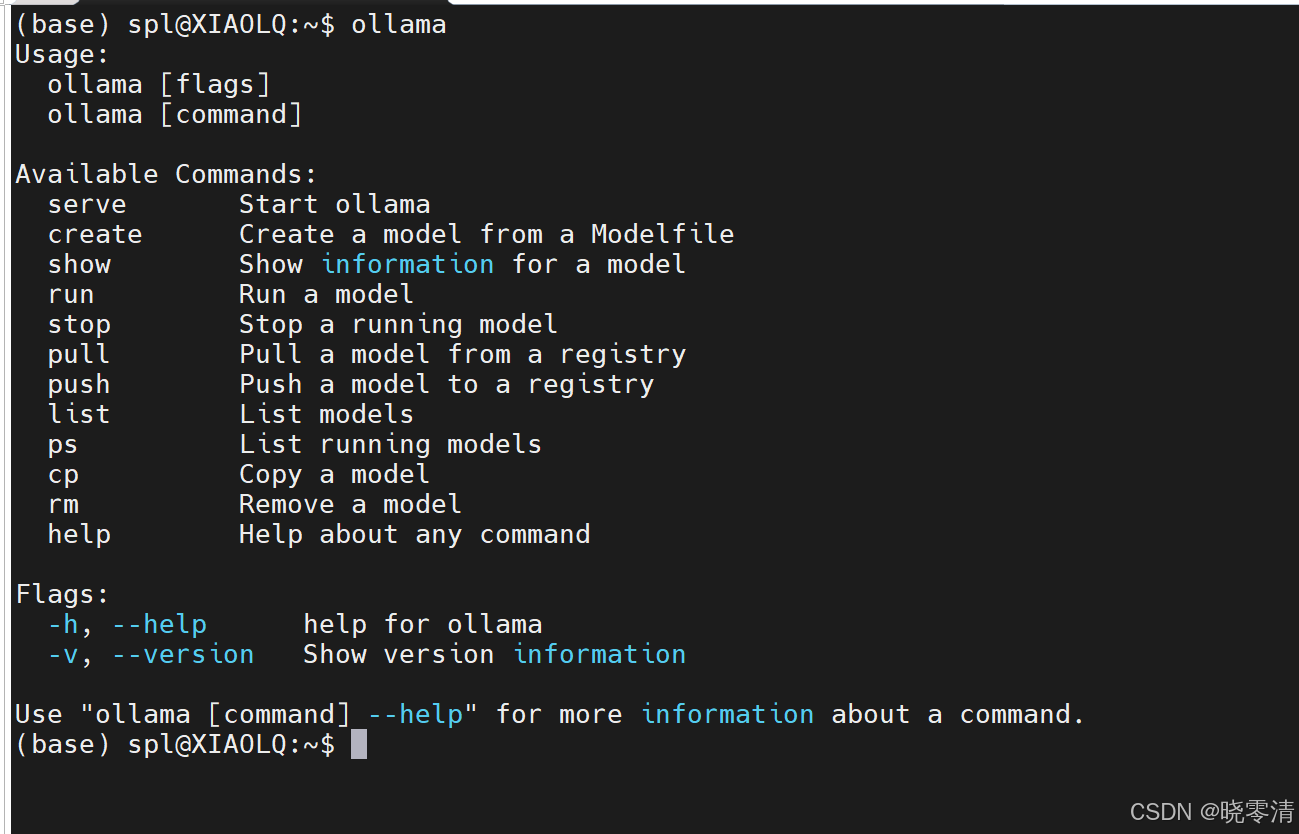

安装完成后,终端输入ollama出现如下说明安装成功

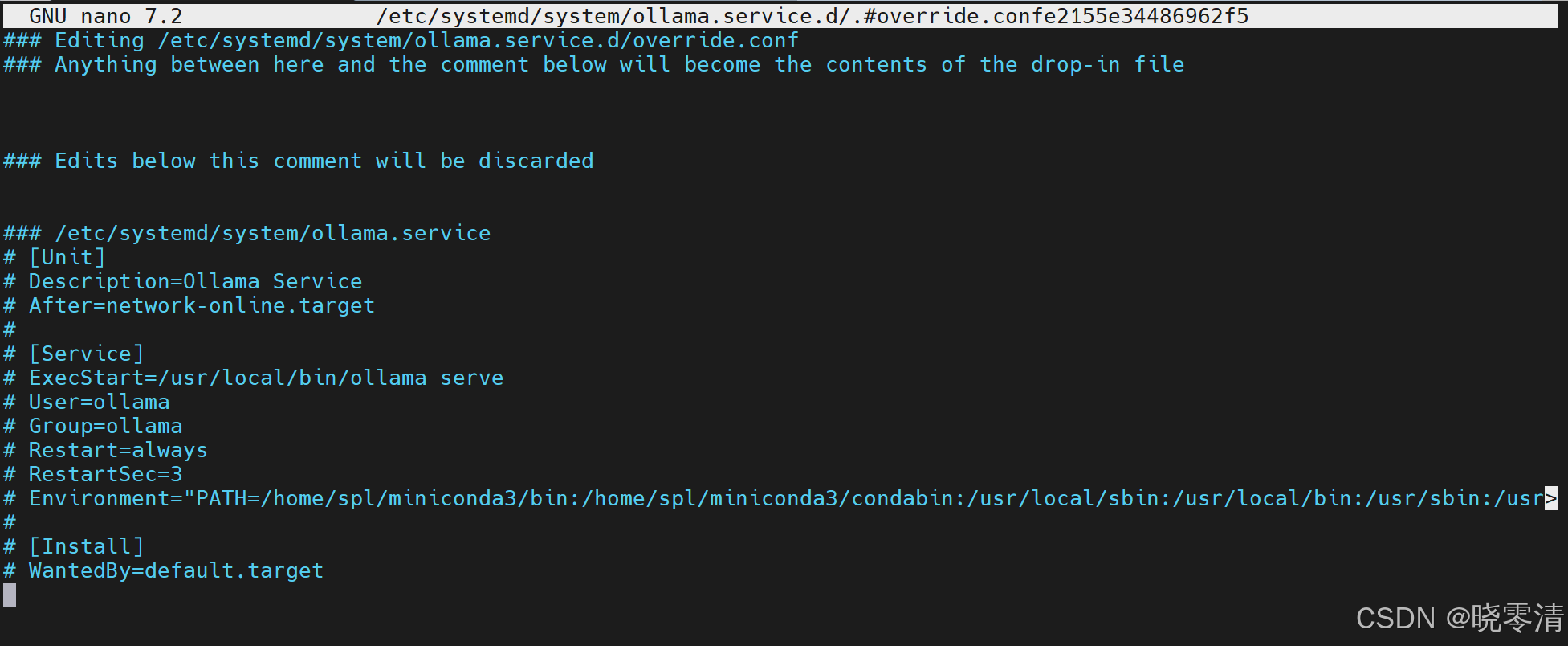

如果想要修改ollama模型下载的位置

systemctl edit ollama.service

出现

修改环境变量

[Service]

Environment="OLLAMA_MODELS=/home/<username>/ollama_models"

然后退出编辑

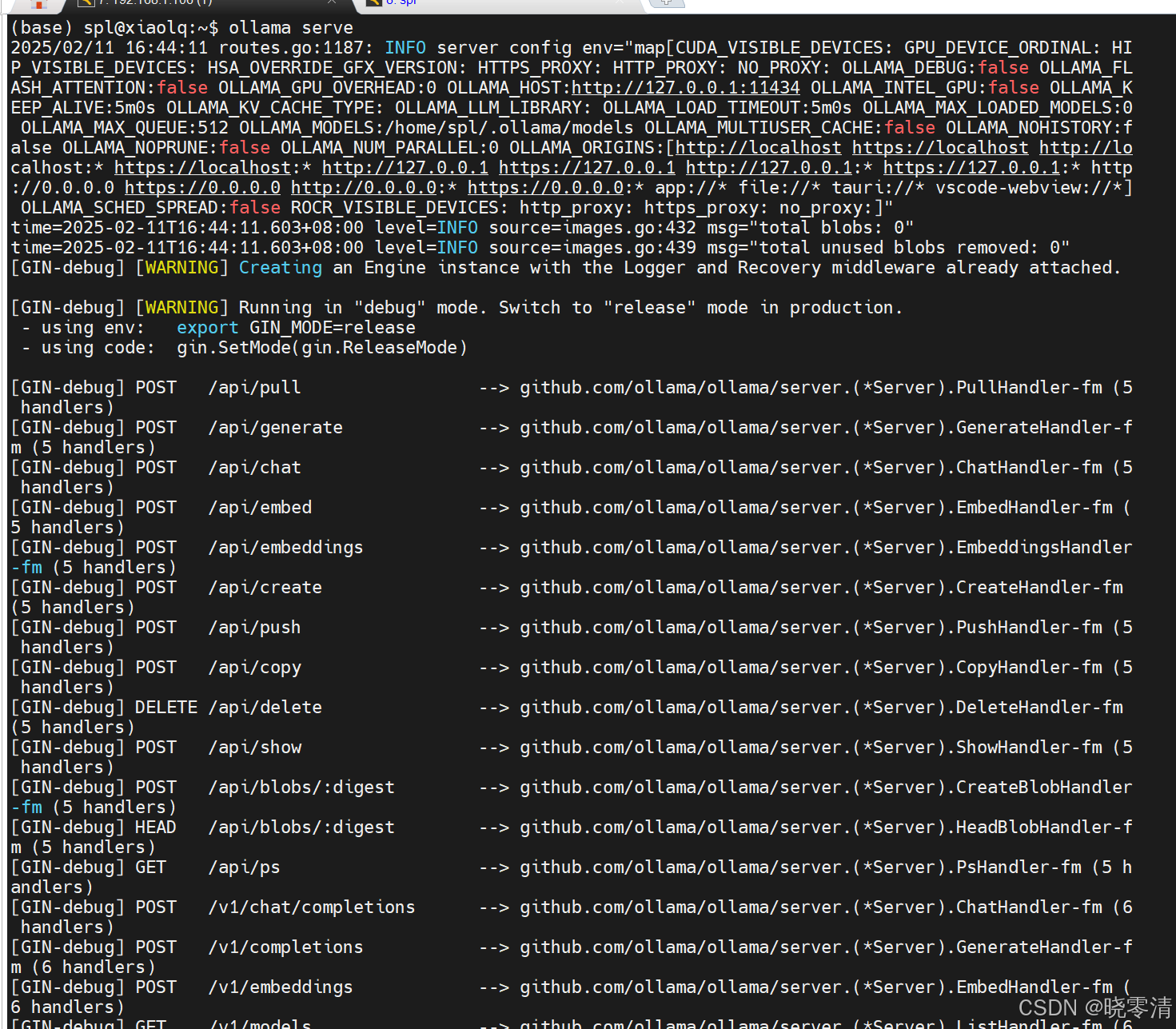

运行ollama

ollama serve

看到如下输出则表明运行成功

2.部署open-webui

使用命令安装,注意保证python版本在3.11以上,安装时间可能比较久可以休息一下吧!🤗

pip install open-webui

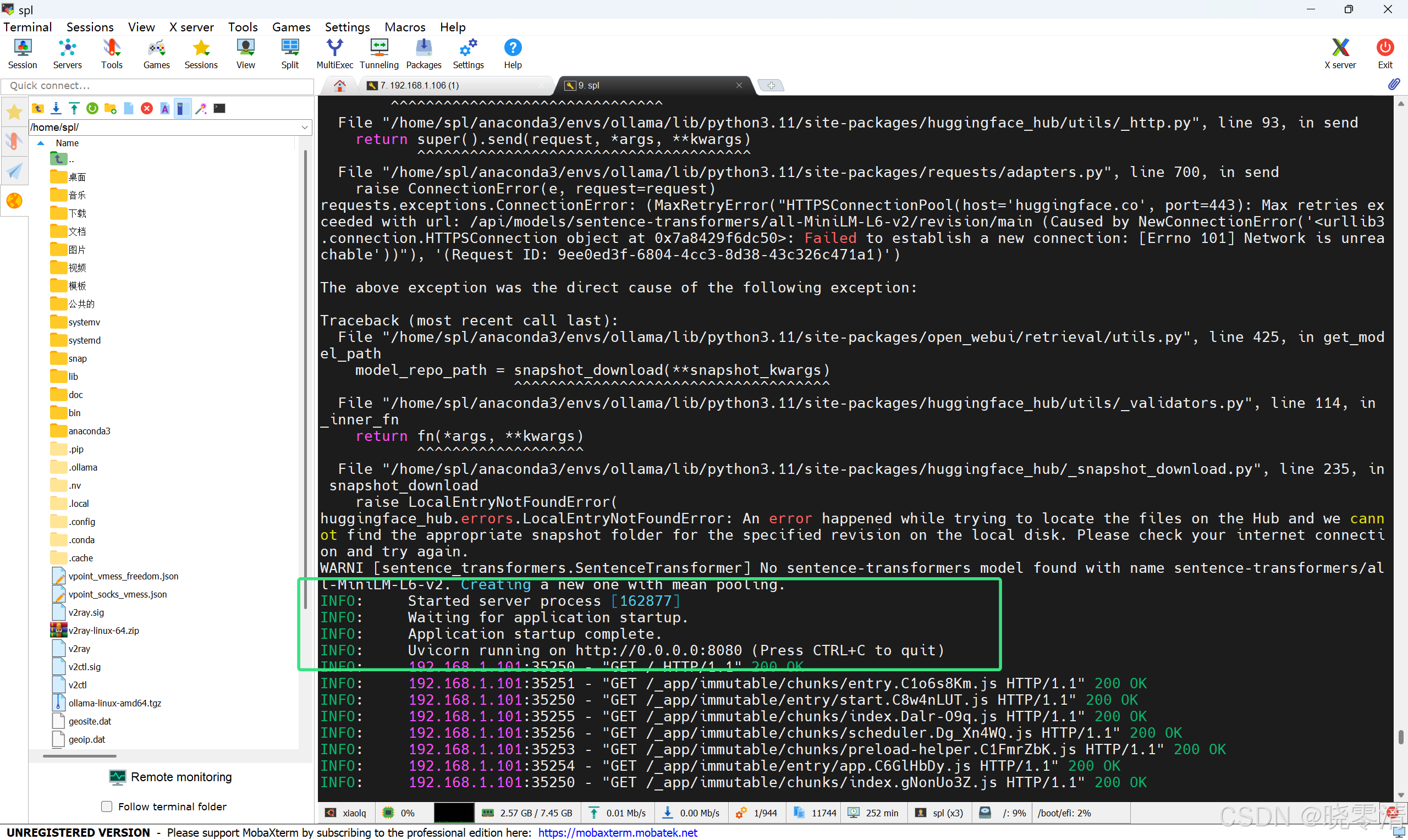

启动open-webui

open-webui serve

下载模型与使用

启动open-webui后访问网址 http://127.0.0.1:8080

第一次进有点慢,因为国外有些东西被墙了。

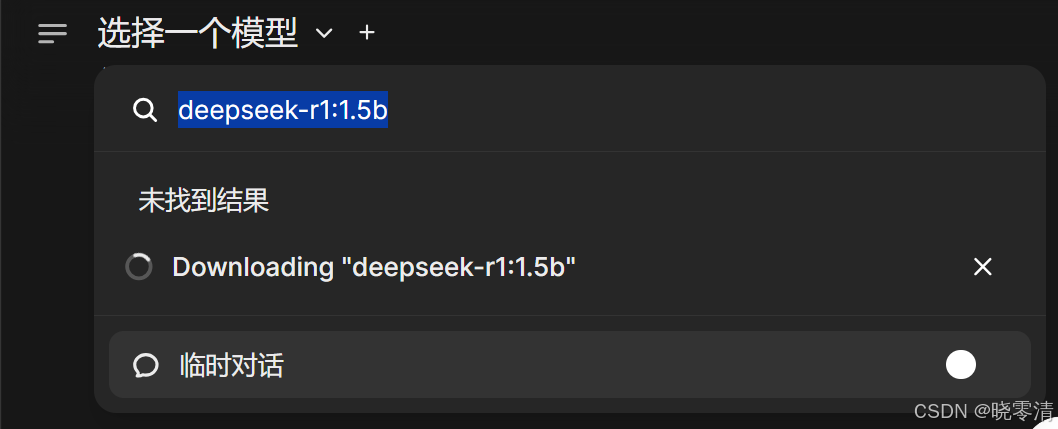

在左上角可以选择拉取的模型,注意要全称,可以去ollama官网查看

等待拉取完成后对话

8331

8331

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?