学习资源:大模型研讨课第一期:Why LLMs?、模型结构1(共10期)_哔哩哔哩_bilibili

本期就是课堂笔记。

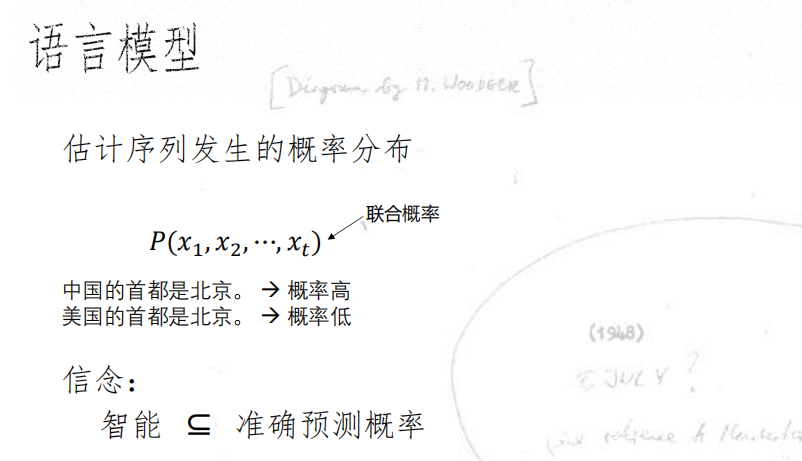

1.什么是大语言模型?

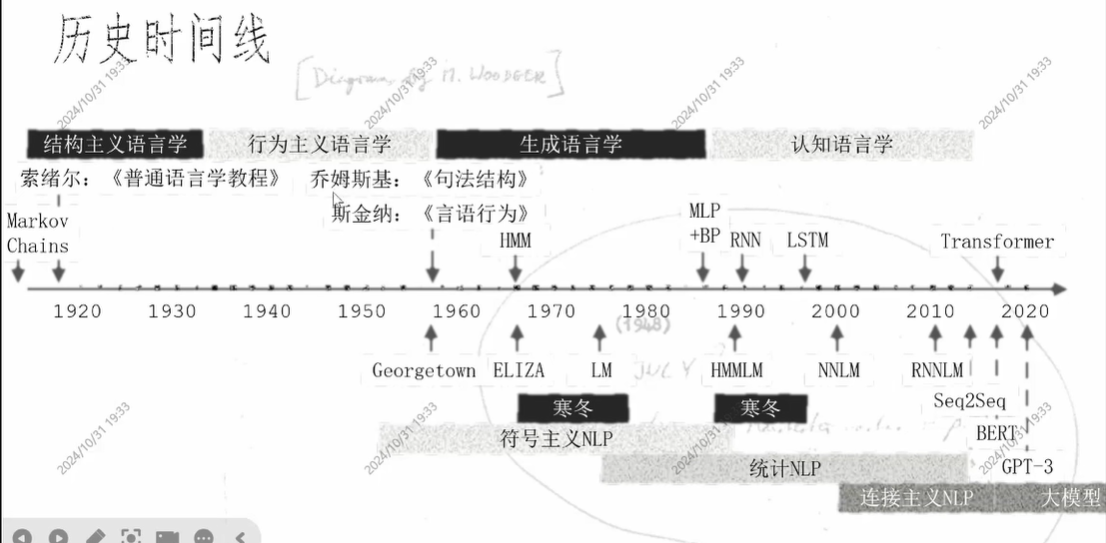

刚开始是基于规则的,后期是基于概率的

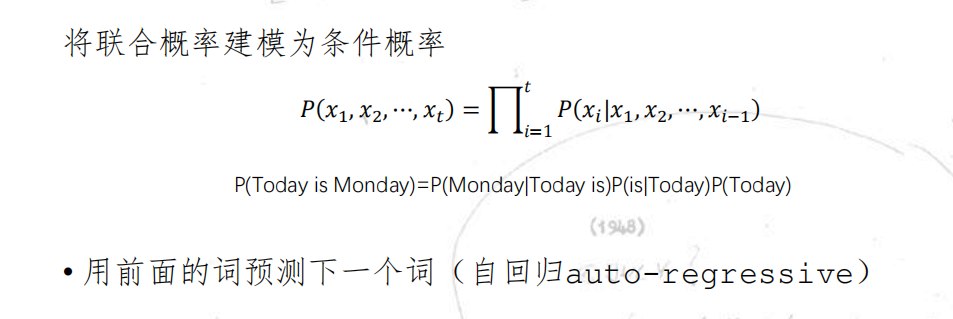

然后呢,我们要把这些概率建模成条件概率,然后就知道这个词后边可能是哪个词了。

理解:

将联合概率,建模成条件概率,然后计算,也就是用前面的词预测下一个词。

比如 是句子(Today is Monday)的概率=P(today)×P(以today为条件 下一个词是 is 的概率)×P(出现 today is 下一个词是Monday的概率)

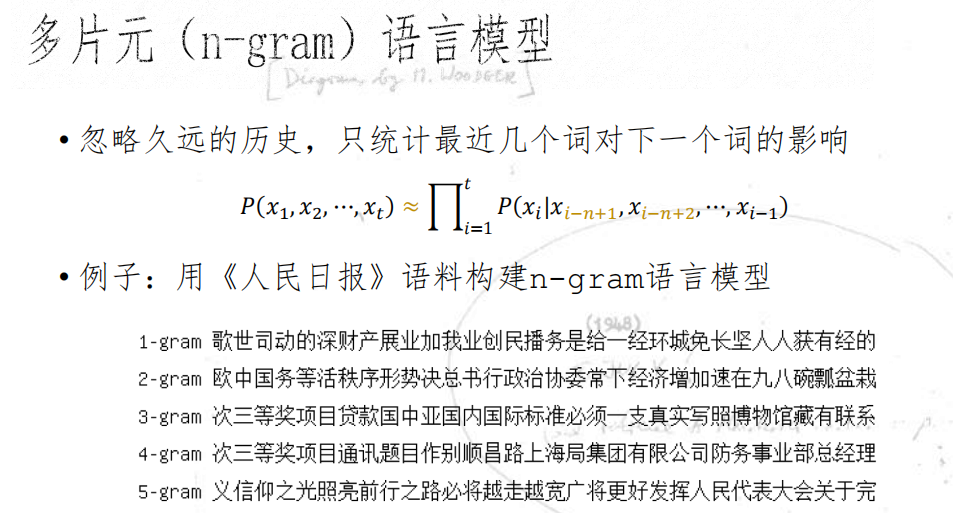

然后就发展出来了多片元(n-gram)语言模型。

多片元语言模型,它忽略久远的历史,只统计最近几个词对下一个词的影响。

比如 1-gram :只考虑前一个词对后一个词的影响。

但是n越大,需要的语料也就越大。

后面逐渐出现了各种模型。

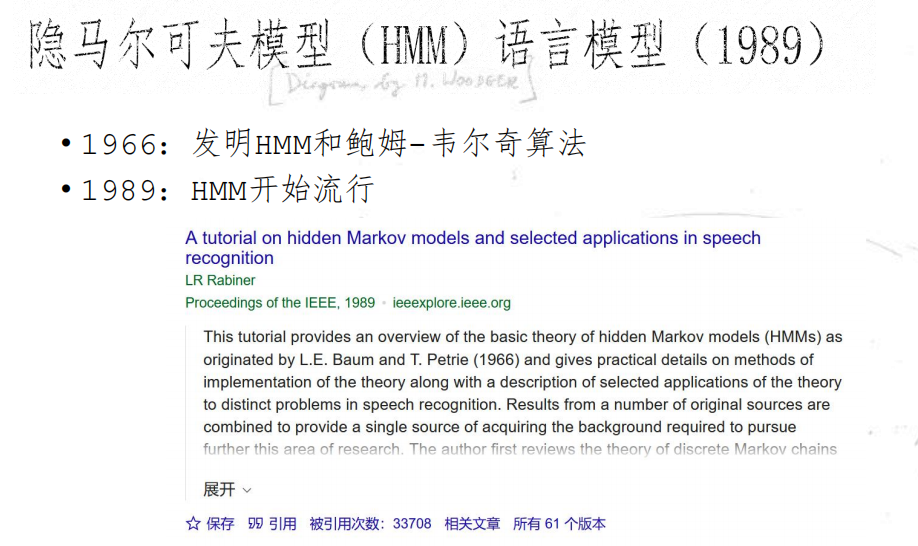

隐马尔可夫模型

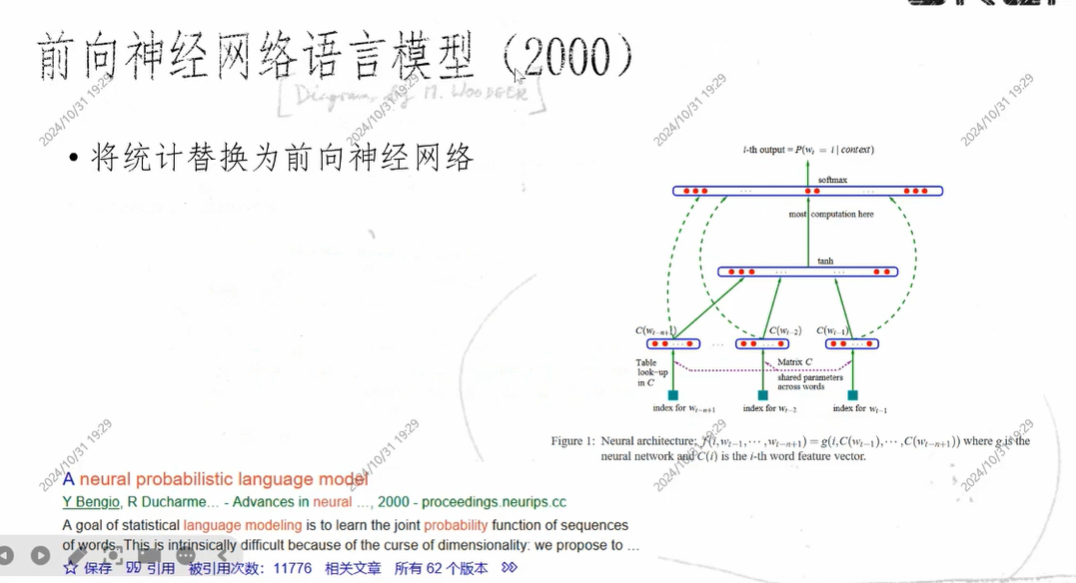

前向神经网络语言模型

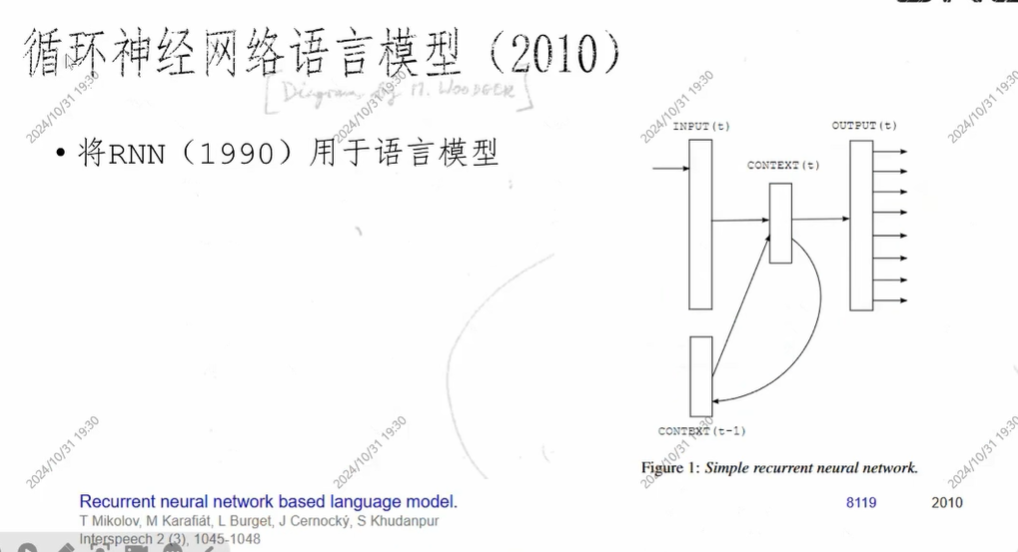

循环神经网络语言模型

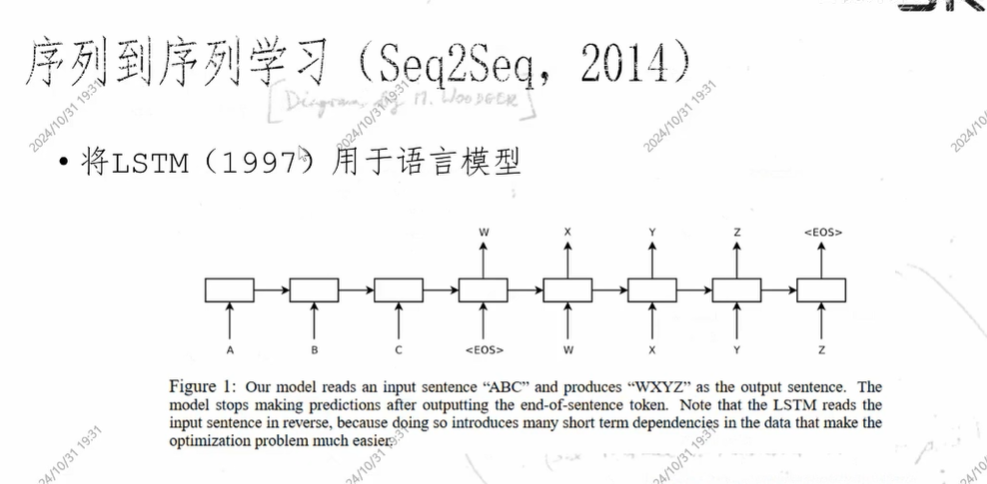

序列到序列学习

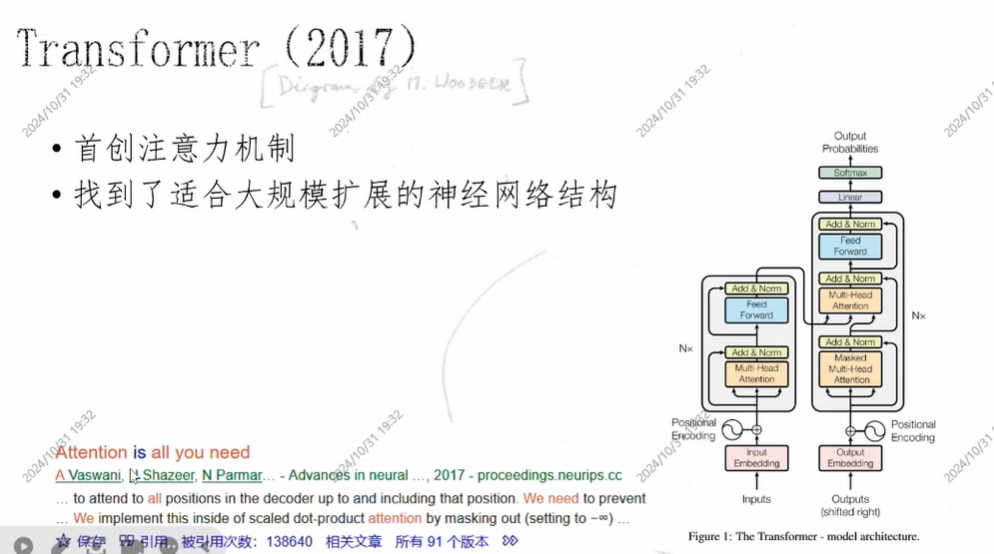

Transformer

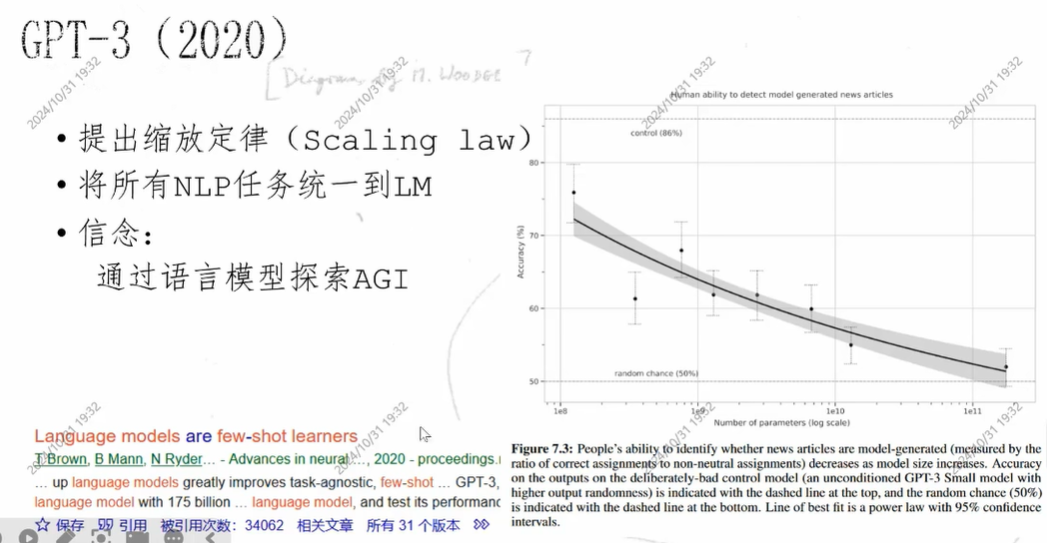

GPT3

缩放定律:参数越多,越准确。

2.为什么要研究大语言模型呢?

大语言模型:拿到一个很复杂的数据集,然后用一个算法去压缩它,得到一个相对较小的模型,然后针对任务再用一点点数据集来调整。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?