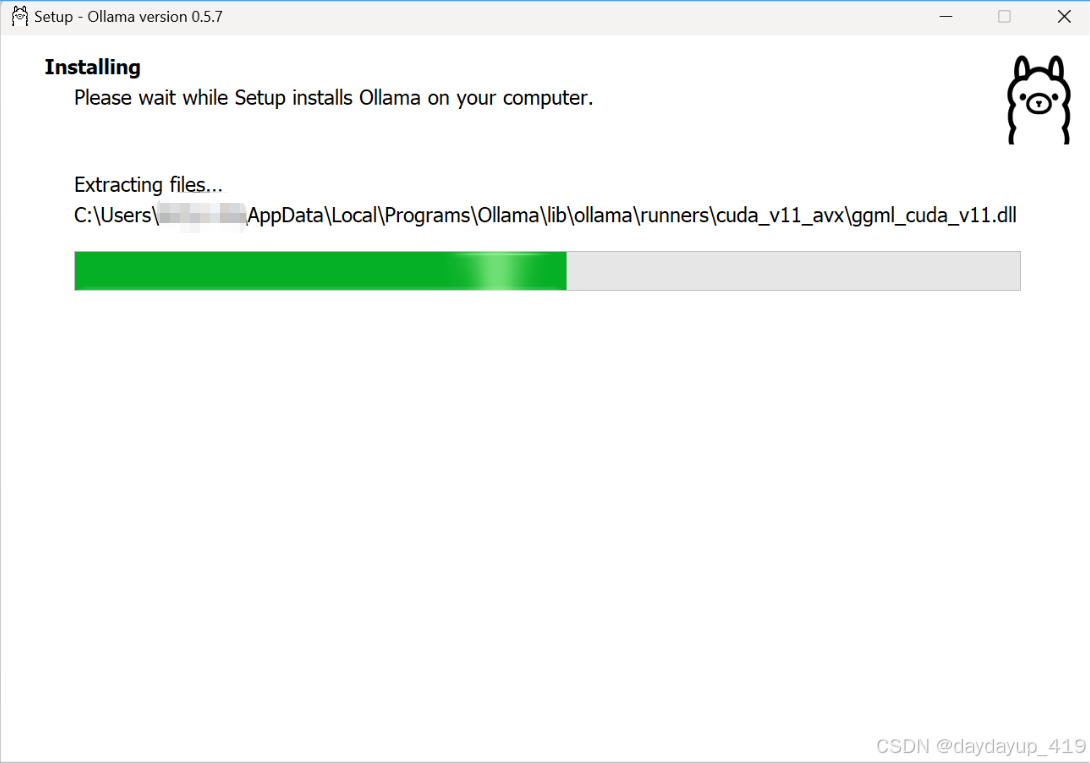

1、下载OllamaDownload Ollama on Windows

DeepSeek-V3和DeepSeek-R1都是非常优秀的国产大模型,如果需要在本地部署,则需要借助Ollama。Ollama是一个开源框架,专为在本地机器上便携部署和运行大模型而设计。

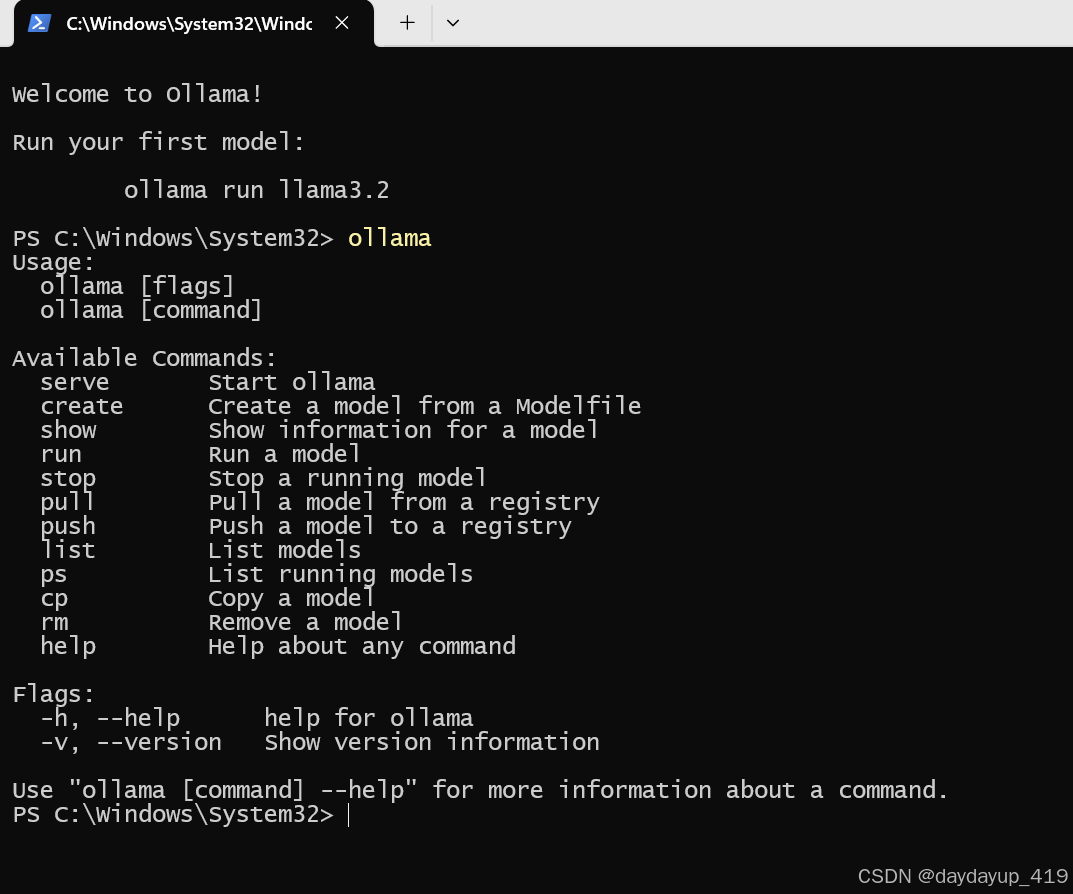

等待安装成功后,打开windows power shell,如下图所示,即为安装成功。

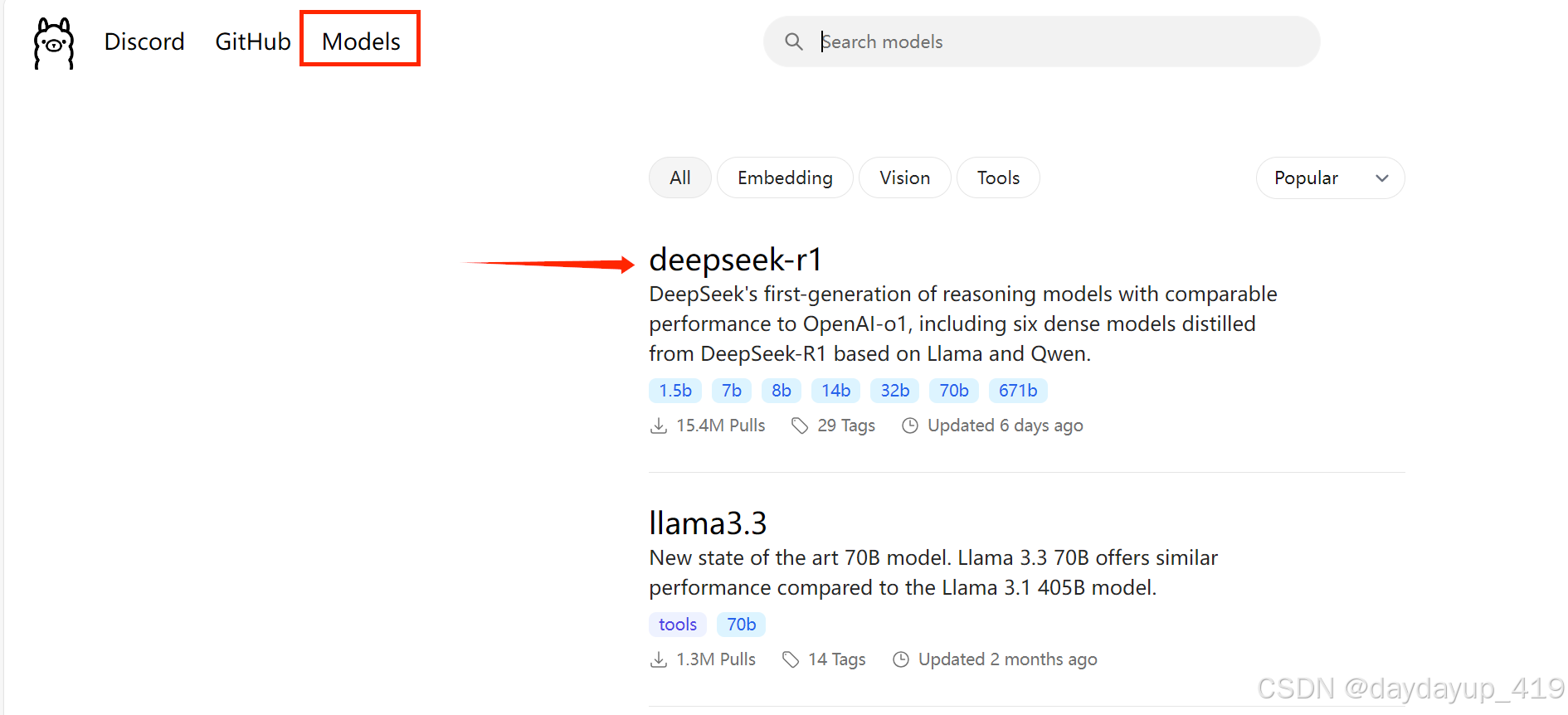

2、本地部署DeepSeek大模型

回到Ollama,点击Model,选择DeepSeek-R1。

在DeepSeek-R1中,可以看到有1.5b、7b、8b、14b、3

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2169

2169

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?