第四课主要介绍了model-based问题的求解方法,第五课主要介绍了model-free问题的求解方法

第四课 值迭代与策略迭代

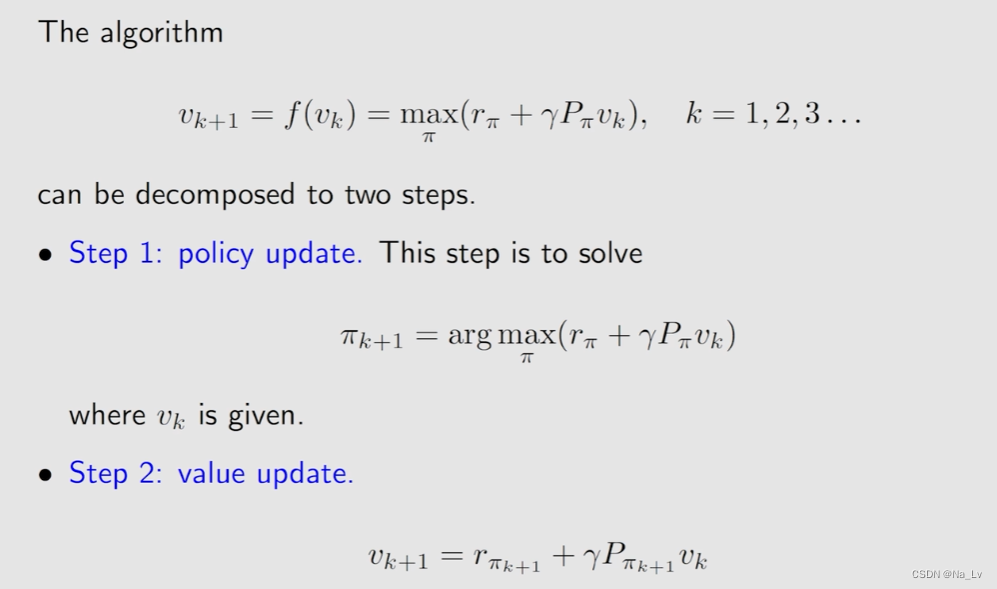

值迭代value iterative

需要注意的是,这里vkv_kvk和vk+1v_{k+1}vk+1都不是state value,在此过程中策略π\piπ也还是变化的,vkv_kvk和vk+1v_{k+1}vk+1只是迭代过程中还未收敛的值,只有收敛后得到的才是给定初始状态下最优策略π∗\pi^*π∗的state value。

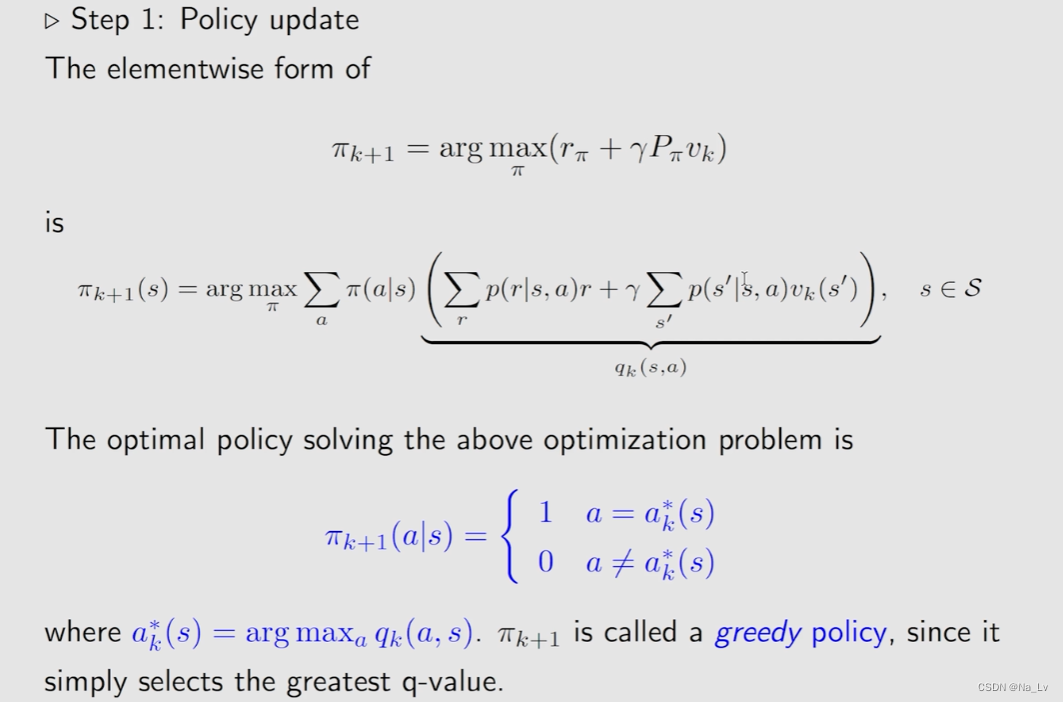

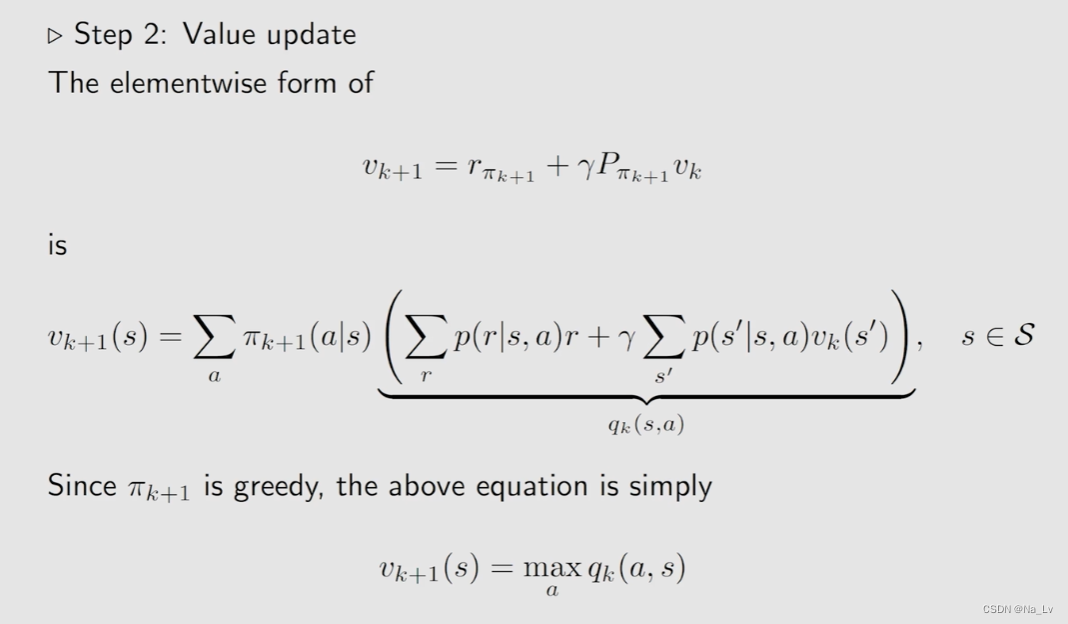

对上述迭代过程进行详细说明:

策略更新的时候遵守贪婪策略,因此在每个状态选择动作时都直接选择对应action value最大的动作(注意这里不止一个方程,是一组方程,所以是每个状态都选择一个对应动作)

值更新是在当前最优策略的基础上求更新的值,由于此时最优策略满足贪婪性(每个状态下发生动作的概率分布值只有0或1),所以此时更新后的v就等于每个状态下最大的action value。

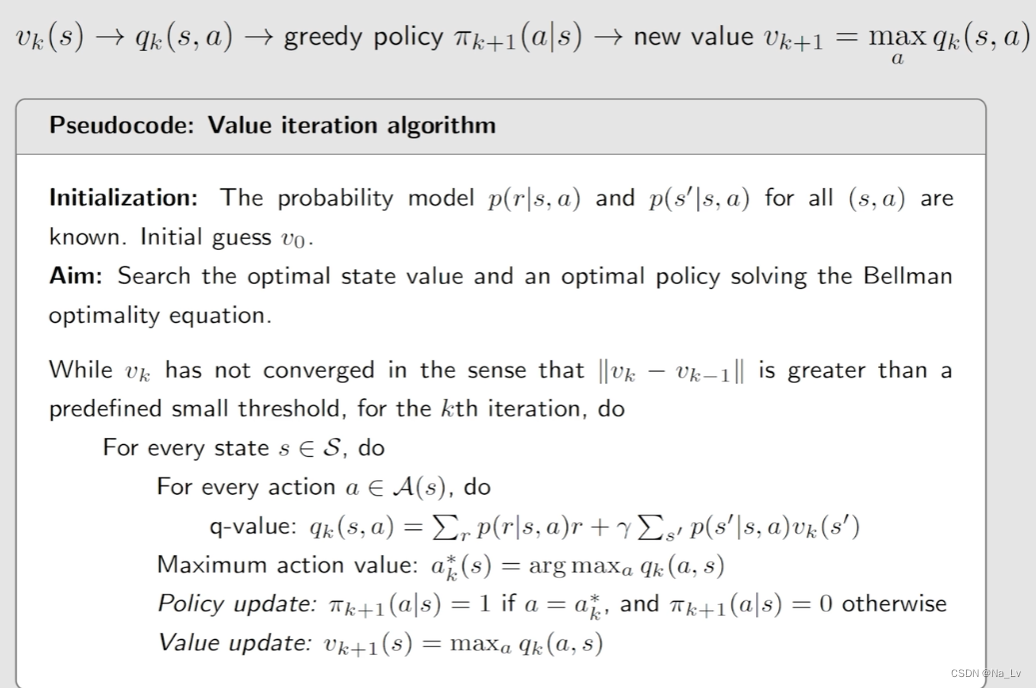

因此,将上述过程的伪代码写为:

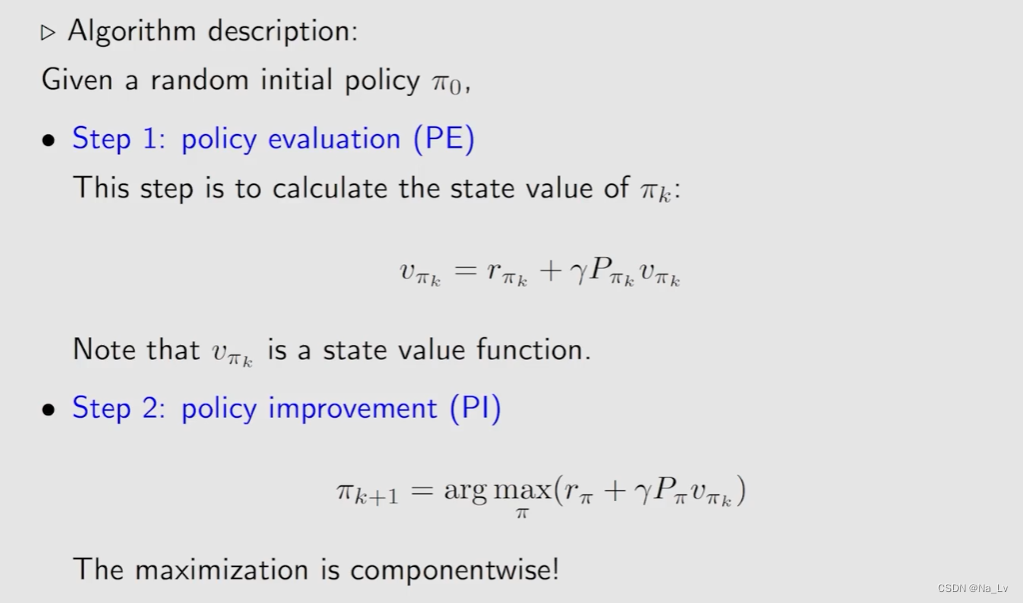

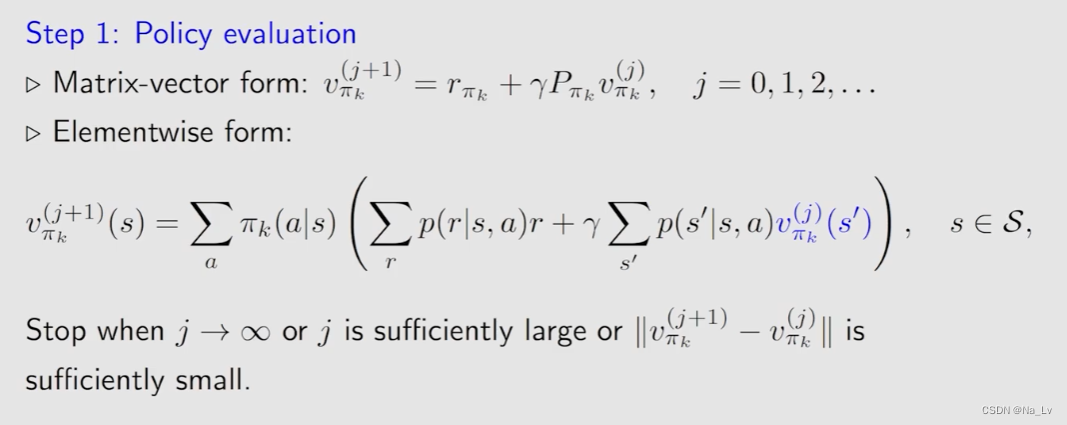

策略迭代policy iteration

对上述过程进行详细说明:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4625

4625

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?