前不久,微软开源了最新的OmniParser v2版本

在新的基础测试基准 Screen Spot Pro 上,使用 OmniParser v2 实现了 39.5% 的最新业界领先结果。

关于omniparser的技术解析可以参考这篇博客屏幕解析工具——OmniParser,这里主要介绍OmniParser v2本地部署

1 创建新的conda环境并激活

conda create -n omni python=3.12

conda activate omni

2 git导入项目、下载依赖

git clone https://github.com/microsoft/OmniParser

会生成一个文件夹

里面有个requirements.txt,是我们所需要的依赖,进入该目录中,直接pip安装依赖

cd ./OmniParser

pip install -r requirements.txt

等待依赖安装

3 下载模型权重

# download the model checkpoints to local directory OmniParser/weights/

for f in icon_detect/{train_args.yaml,model.pt,model.yaml} icon_caption/{config.json,generation_config.json,model.safetensors}; do huggingface-cli download microsoft/OmniParser-v2.0 "$f" --local-dir weights; done

mv weights/icon_caption weights/icon_caption_florence

会在omniparser文件夹下生成一个weights文件夹

4 使用

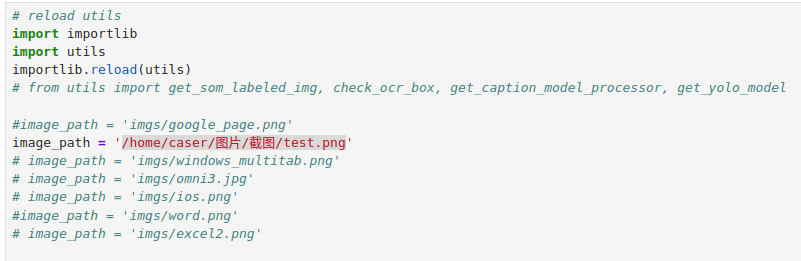

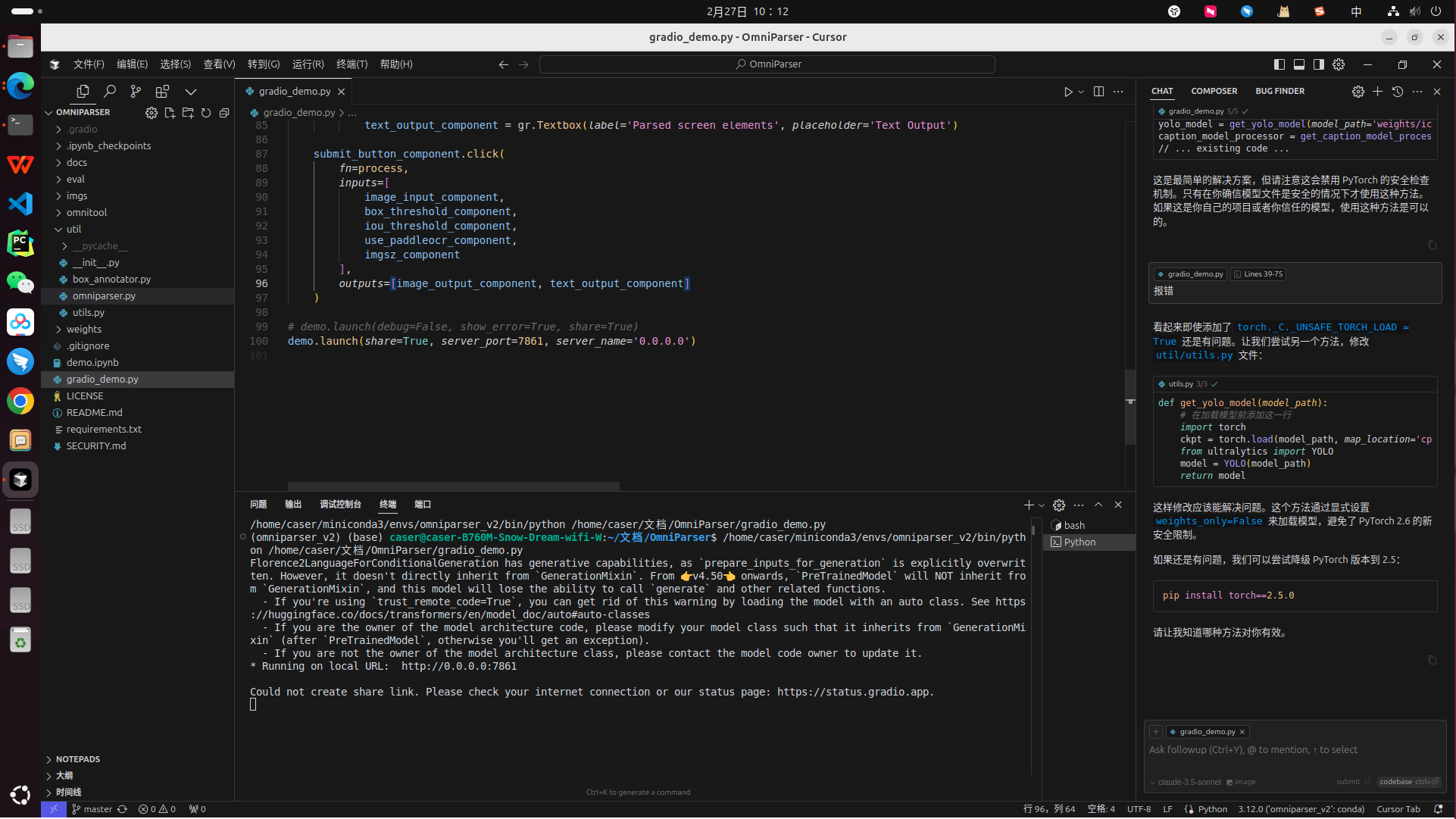

我这里使用的是文件夹里面的demo

可以在这段代码修改需要的图片

我这里选择了一张我的桌面图片

运行所有的单元格,即可获取到标注好的界面图

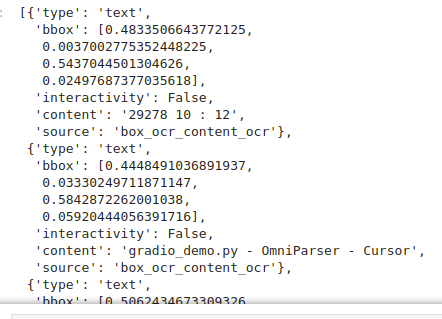

这次相较于v1,还增加了每个元素的位置信息,可交互信息,格式如下

之后我会更新OmniTool的本地部署,OmniTool是一套包含界面元素识别、自动化控制的完整工具,可以基于OmniParser对电脑、手机等设备进行自然语言的自动化操作。

1281

1281

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?