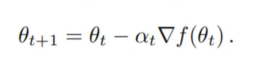

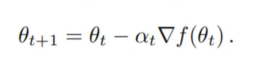

Gradient Descent

核心公式

For instance

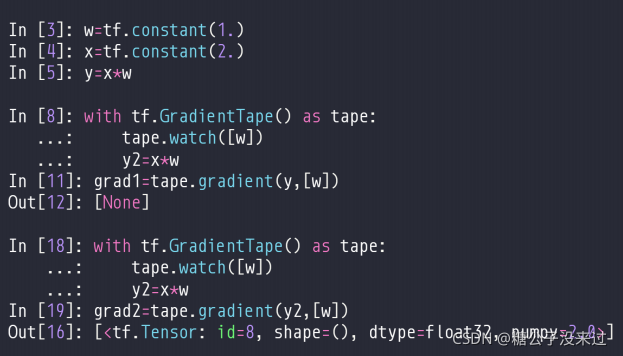

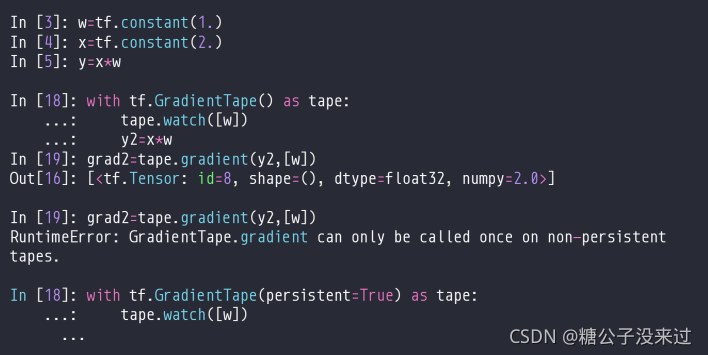

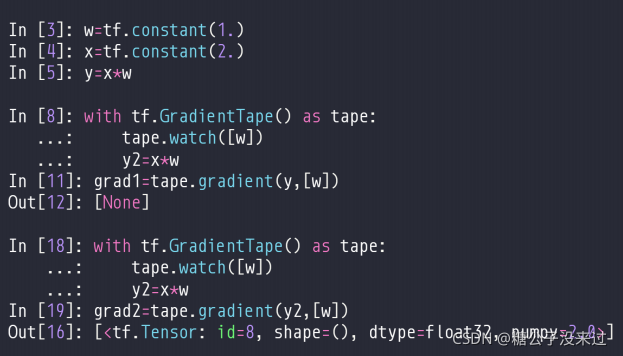

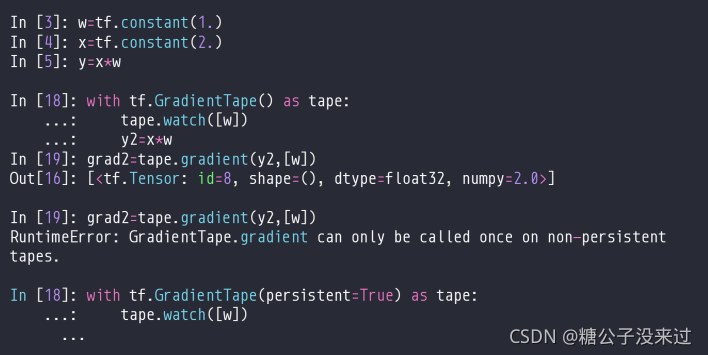

GradientTape

如果不将需要求梯度的 w 放入GradientTape中,就不能自动求 w 的梯度

另外,GradientTape 有一个参数persistent,如果不设置的话,tape.gradient 只能用一次,也就是只能求一次梯度,再用的话就会报错

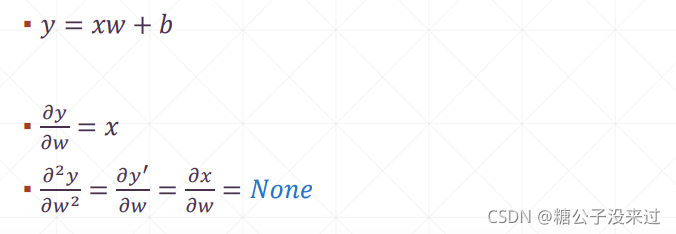

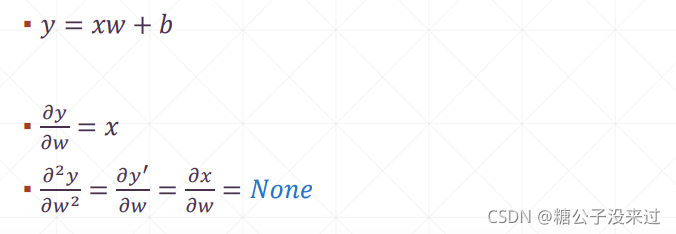

二阶导的求法

例如:

如果不将需要求梯度的 w 放入GradientTape中,就不能自动求 w 的梯度

另外,GradientTape 有一个参数persistent,如果不设置的话,tape.gradient 只能用一次,也就是只能求一次梯度,再用的话就会报错

例如:

145

145

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?