人类在解决一个包含很多细节的具体问题时,先站在更高的层次上解决一些更加抽象的问题,可以拓展一个更宽阔的上下文环境,从而辅助解决这个具体的问题。

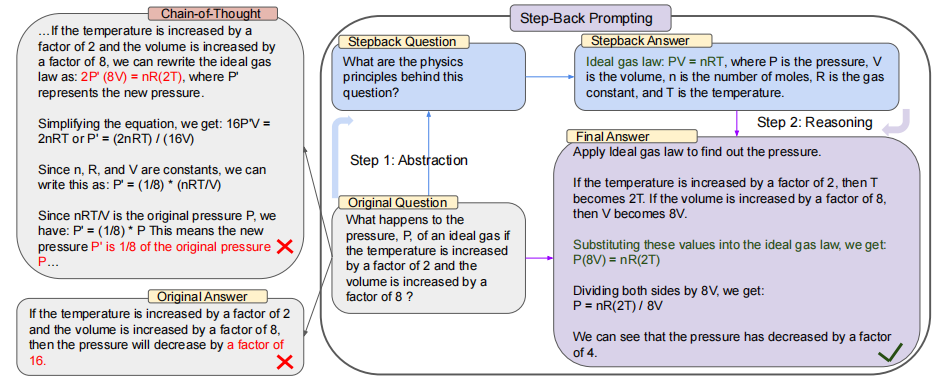

反应到 LLM 中,就是当问 LLM 一个具体的物理题目时,先让 LLM 解决一个更加高层次的抽象问题 这个问题背后用得到物理定律或法则是什么? ,然后再让 LLM 去解决那个包含了很多细节的具体的物理题目,可能效果就会更好,准确率更高。

简而言之,Step-Back Prompting 包含两个简单的步骤:

- Abstraction:先让 LLM 根据 original question 提出一个更高层次概念的 step-back question,并检索这个 step-back question 的相关事实

- Reasoning:基于高层次概念或原则的事实,LLM 就可以去推理原始问题的解决方案了。

如下图所示,original question 是一个具体的物理问题,Step-Back Prompting 先让 LLM 进行抽象得到一个 StepBack Question,也就是“这个物理问题背后的物理定律是什么”,然后再去检索这个 StepBack Question 得到相关事实,然后基于以上信息去让 LLM 做 reasoning 得到 final answer。

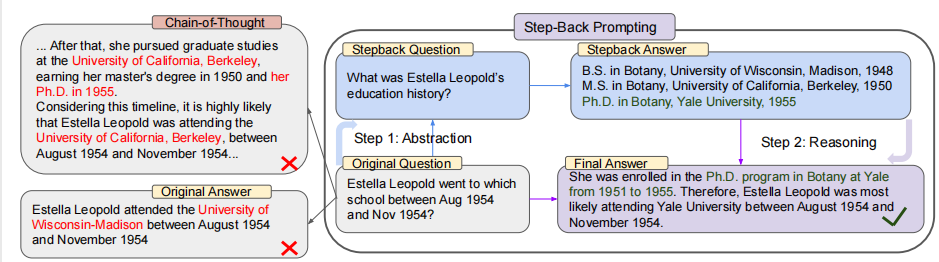

如下图所示,original question 是一个具体的历史问题,询问 Estella 的一段教育经历。Step-Back Prompting 先让 LLM 进行抽象得到一个 StepBack Question,也就是“Estella 的全部教育背景”,然后再去检索这个 StepBack Question 得到相关事实,然后基于以上信息去让 LLM 做 reasoning 得到 final answer。

31

31

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?