DeepSeek 一经发布就引起社会的广泛的关注,因为 DeepSeek 的价格低廉,性能卓越,提供了多种使用方式,满足不同用户的需求和场景。

本文将详细的介绍如何在本地 Windows 上安装部署 Ollama + Open WebUI 来实现用户和 DeepSeek-r1 对话的功能以及利用路由侠内网穿透实现外网访问。

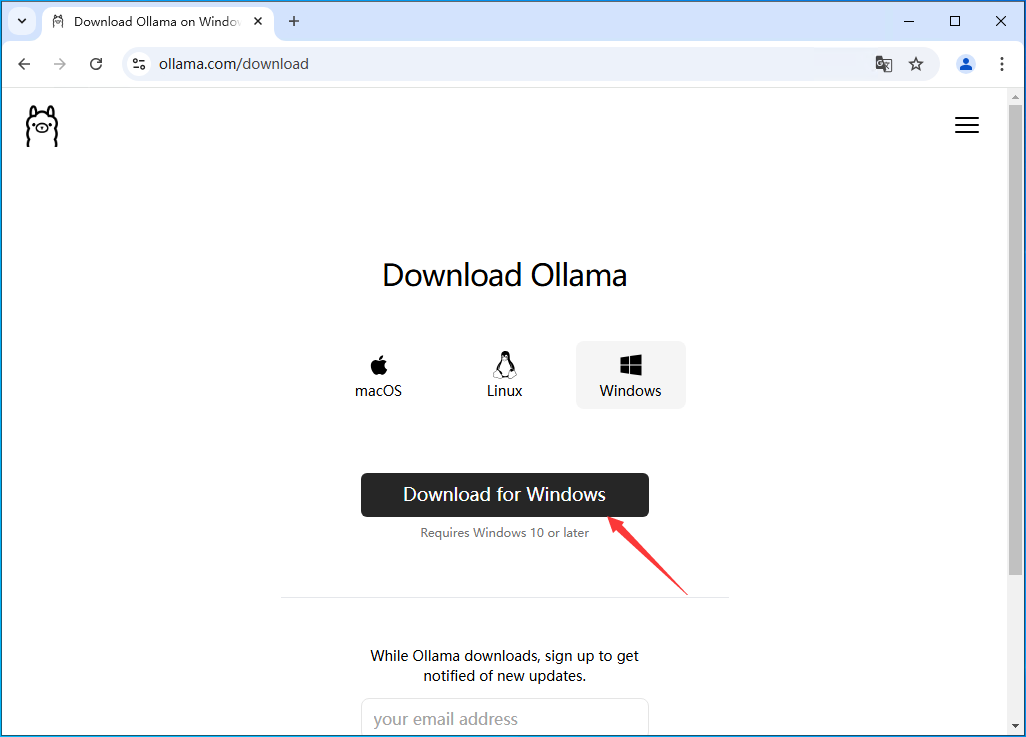

第一步,Ollama 下载与安装

1,首先先进入 Ollama 的下载界面,这里是 windows 演示教程,所以安装 windows 版本就可以了。点此进入下载

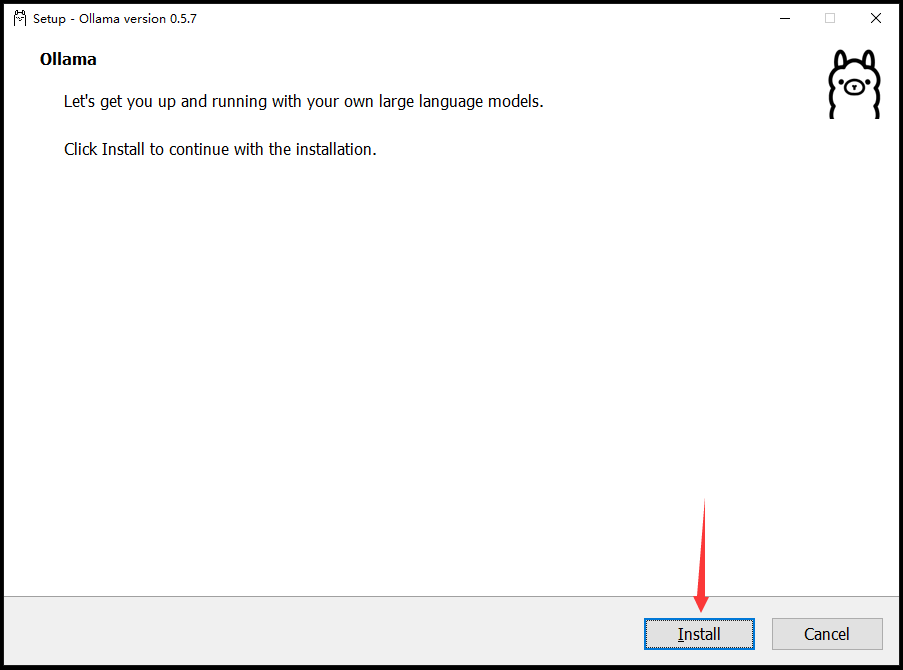

2,下载好后,双击程序,开始安装。

![]()

3,点击【Install】开始安装。

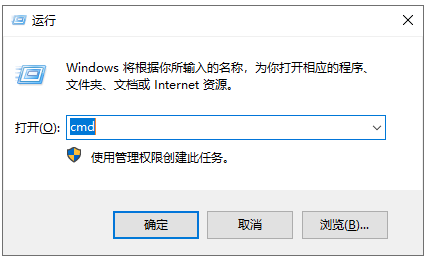

4,安装好后,按住 Win+R 键,在运行框中输入 cmd 打开 Windows 系统自带的终端界面。

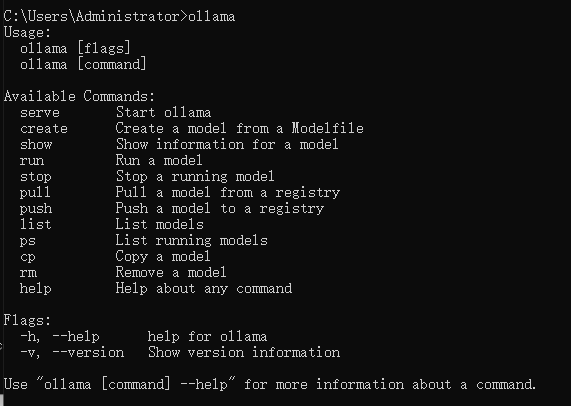

5,在终端界面中输入 ollama 按回车键,看到下图信息代表安装成功。

第二步,Ollma 安装 deepseek-r1 模型

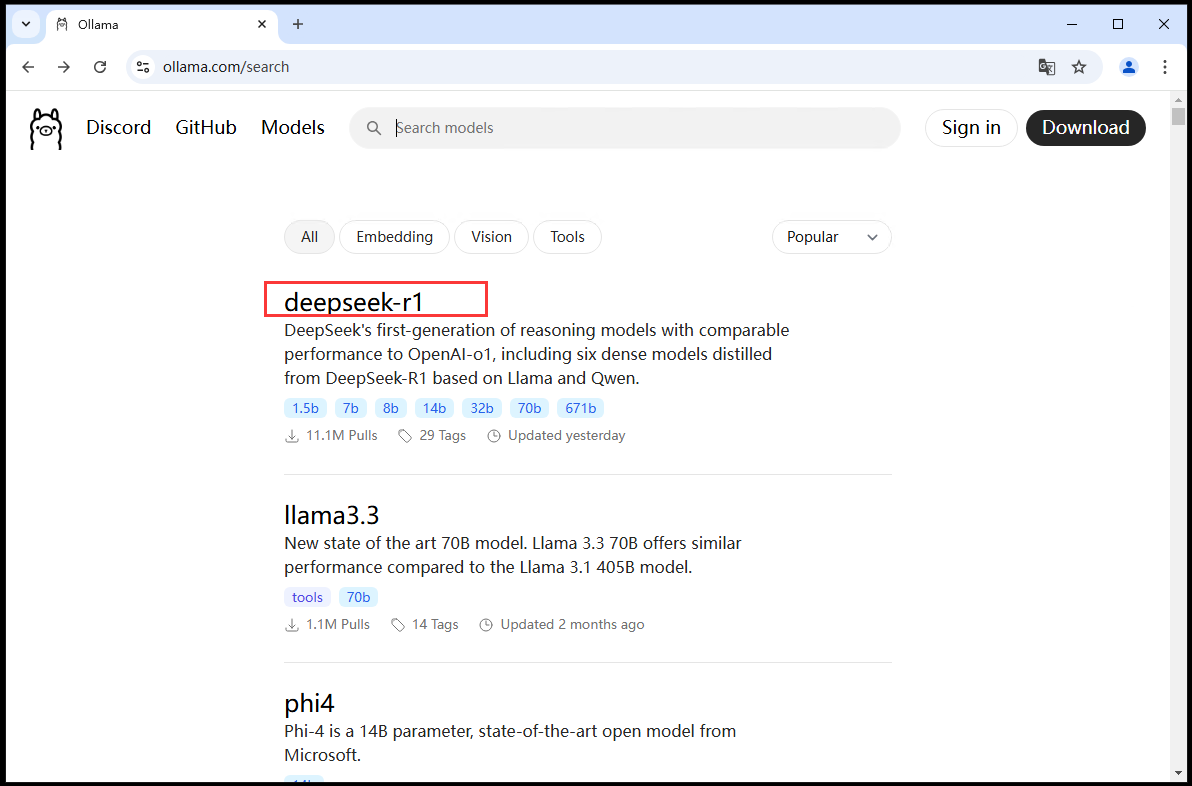

1,从 ollama 官网 查找 deepseek-r1 模型。点此进入

2,根据自己的需求选择想要下载的各种量级的模型,右侧是对应的模型下载命令。这里以 1.5b 进行演示。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6559

6559

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?