一、Parquet概述

Apache Parquet是Hadoop生态系统中任何项目都可以使用的列式存储格式,不受数据处理框架、数据模型和编程语言的影响。Spark SQL支持对Parquet文件的读写,并且可以自动保存源数据的Schema。当写入Parquet文件时,为了提高兼容性,所有列都会自动转换为“可为空”状态。

二、读取和写入Parquet的方法

加载和写入Parquet文件时,除了可以使用load()方法和save()方法外,还可以直接使用Spark SQL内置的parquet()方法

(一)利用parquet()方法读取parquet文件

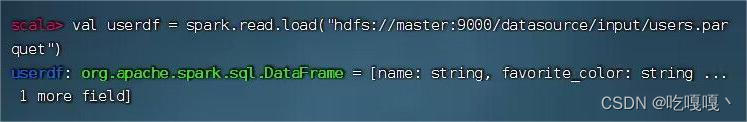

1.读取parquet文件

执行命令:val usersdf = spark.read.parquet("hdfs://master:9000/input/users.parquet")

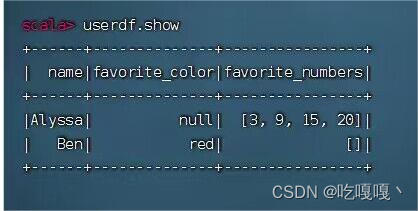

2.显示数据帧内容

执行命令:usersdf.show()

(二)利用parquet()方法写入parquet文件

1、写入parquet文件

执行命令:usersdf.select("name", "favorite_color").write.parquet("hdfs://master:9000/result")

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

825

825

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?