0 前言

🔥这两年开始毕业设计和毕业答辩的要求和难度不断提升,传统的毕设题目缺少创新和亮点,往往达不到毕业答辩的要求,这两年不断有学弟学妹告诉学长自己做的项目系统达不到老师的要求。并且很难找到完整的毕设参考学习资料。

为了大家能够顺利以及最少的精力通过毕设,学长分享优质毕业设计项目提供大家参考学习,今天要分享的是

🚩 毕业设计 深度学习YOLO交通路面缺陷检测系统(源码+论文)

🥇学长这里给一个题目综合评分(每项满分5分)

难度系数:3分

工作量:4分

创新点:5分

🧿 项目分享:见文末!

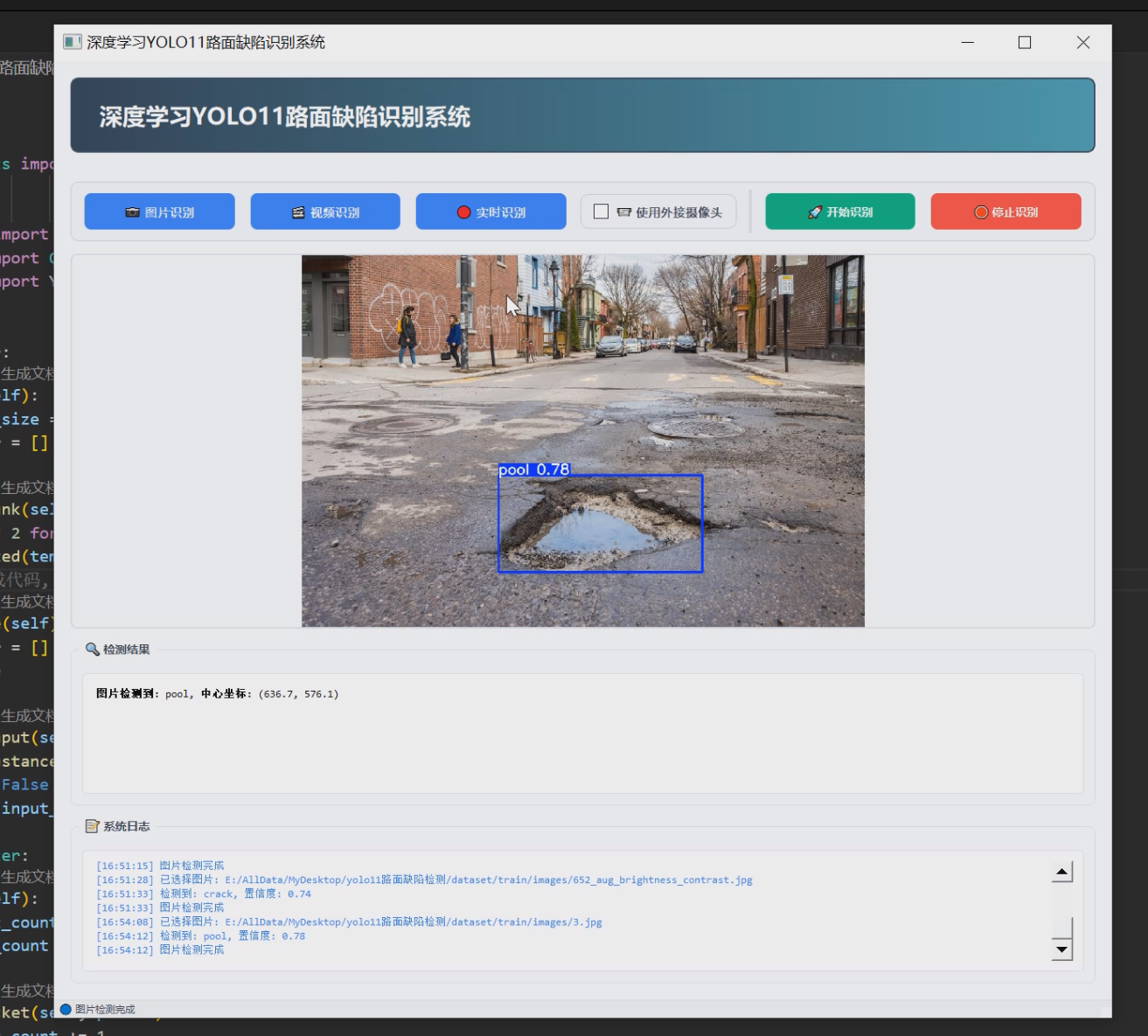

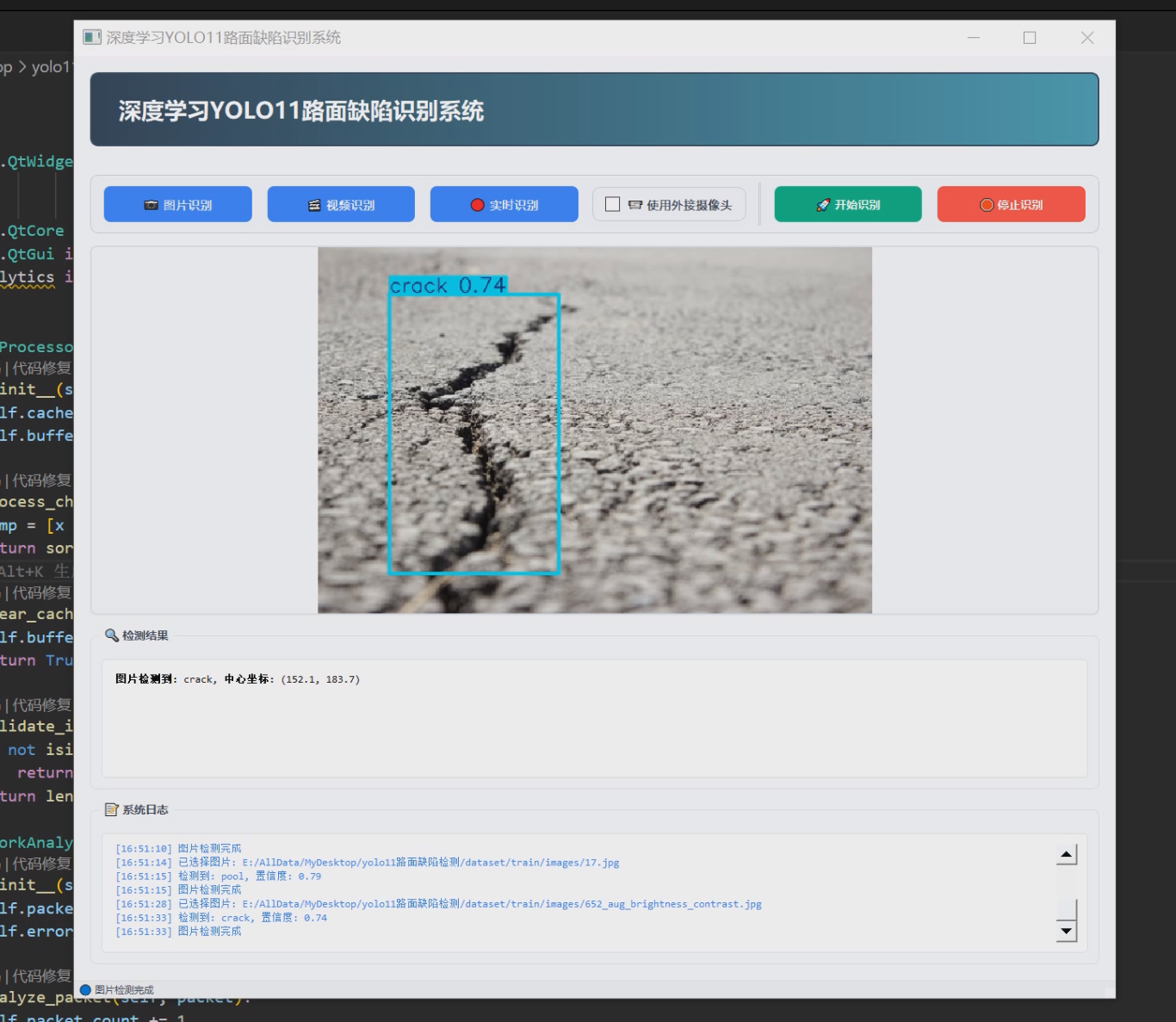

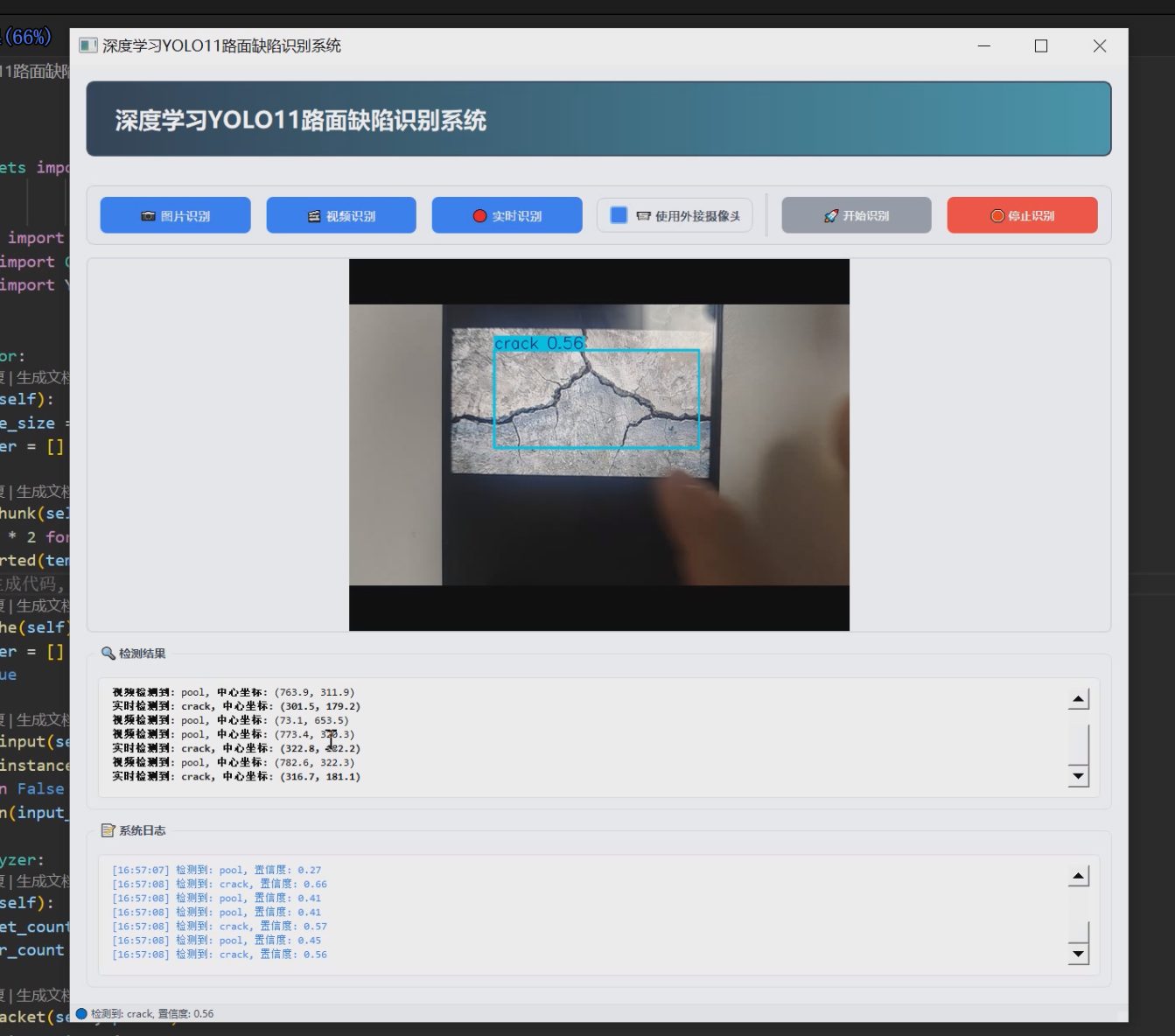

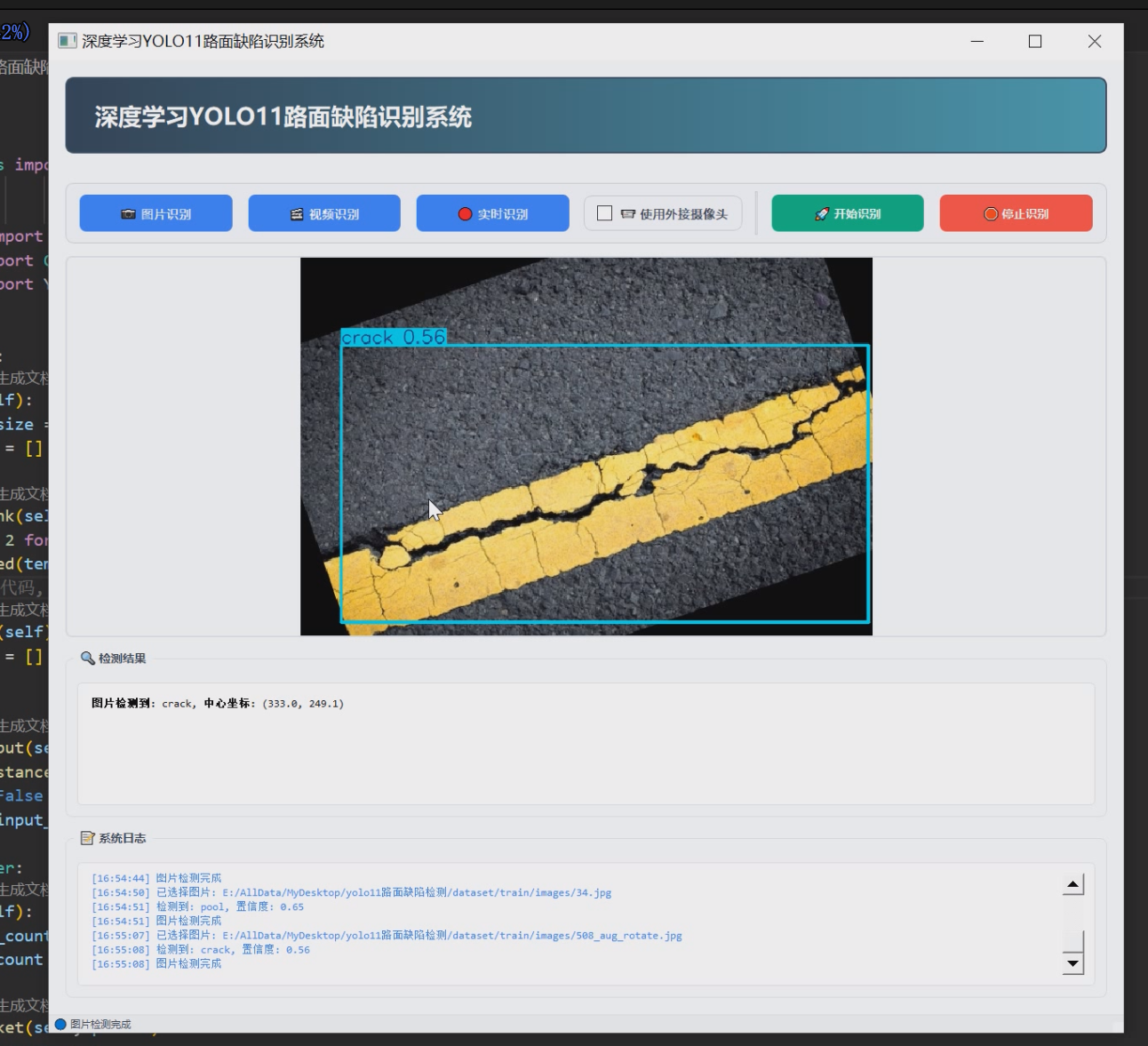

1 项目运行效果

2 课题背景

2.1. 道路基础设施发展现状

随着我国城镇化进程加速和交通强国战略实施,截至2022年底,全国公路总里程已达535万公里,其中高速公路17.7万公里。庞大的路网规模带来了巨大的养护压力,根据交通运输部统计数据,每年因路面损坏导致的直接经济损失超过300亿元。传统人工巡检方式已难以满足现代化道路养护需求,亟需发展智能化检测技术。

2.2. 路面缺陷检测技术演进历程

2.2.1 传统检测方法

早期主要依赖人工目视检查,存在以下局限性:

- 检测效率低下:单人日均检测里程不超过5公里

- 主观性强:检测结果受人员经验影响大

- 安全隐患:巡检人员需近距离接触车流

- 数据难量化:缺乏标准化记录体系

2.2.2 机械化检测阶段

20世纪90年代出现的检测车装备了激光断面仪、高清摄像机等设备,实现了:

- 检测速度提升至60-80km/h

- 部分参数自动化采集

- 初步数字化记录

但仍存在设备昂贵(单台超200万元)、算法识别率低(<70%)等问题。

2.3. 计算机视觉技术突破

2.3.1 传统图像处理技术

基于OpenCV的方法主要采用:

- 边缘检测(Canny算子等)

- 阈值分割(Otsu算法等)

- 形态学处理

在理想条件下可实现80%左右的识别准确率,但对光照变化、复杂背景适应性差。

2.3.2 深度学习革命

2012年AlexNet在ImageNet竞赛中的突破性表现,带动了计算机视觉技术的跨越式发展。特别是YOLO系列算法的发展轨迹:

- 2016年YOLOv1实现端到端检测

- 2018年YOLOv3引入多尺度预测

- 2020年YOLOv5优化训练效率

- 2022年YOLOv7在速度和精度间取得更好平衡

2.4. 路面缺陷检测的特殊性挑战

2.4.1 数据特性

- 尺度差异大:裂缝宽度从毫米级到厘米级

- 形态复杂:不规则几何形状

- 背景干扰:标线、阴影、水渍等干扰因素

- 样本不平衡:缺陷区域占比通常<5%

2.4.2 技术难点

- 小目标检测精度不足

- 实时性要求高(≥25FPS)

- 复杂环境鲁棒性

- 多类别同时检测

2.5. 本项目技术路线创新

2.5.1 算法层面

采用YOLOv11的改进方案:

- 引入BiFPN特征金字塔增强小目标检测

- 改进损失函数解决样本不平衡

- 自适应锚框机制

- 轻量化设计确保实时性

2.5.2 系统集成

构建多模态检测框架:

- 支持图片批量处理(JPEG/PNG)

- 视频流分析(MP4/AVI)

- 实时摄像头输入(USB/RTSP)

- 可视化交互界面(PyQt5)

2.6. 项目应用价值

2.6.1 经济效益

- 检测效率提升20倍以上

- 人力成本降低60%

- 早期发现可节约50%以上维修费用

2.6.2 社会效益

- 提升道路安全水平

- 优化养护资源配置

- 推动基础设施数字化转型

- 为智慧交通建设提供技术支撑

2.7. 技术发展趋势

根据《中国公路学报》最新研究,未来5年路面检测技术将呈现:

- 多传感器融合(光学+激光+红外)

- 边缘计算部署

- 数字孪生应用

- 自动化养护决策

本项目的技术积累将为这些发展方向奠定基础。

3 设计框架

3.1. 系统架构设计

3.1.1 整体架构图

[系统架构图]

┌─────────────────┐ ┌─────────────────┐ ┌─────────────────┐

│ 数据采集模块 │───▶│ 模型训练模块 │───▶│ 应用系统模块 │

└─────────────────┘ └─────────────────┘ └─────────────────┘

▲ ▲ ▲

│ │ │

┌─────────────────┐ ┌─────────────────┐ ┌─────────────────┐

│ 道路巡检设备/摄像头 │ │ 标注数据集管理 │ │ PyQt5交互界面 │

└─────────────────┘ └─────────────────┘ └─────────────────┘

3.1.2 技术栈组成

- 深度学习框架: Ultralytics YOLOv11

- GUI开发: PyQt5

- 图像处理: OpenCV 4.5+

- 并行处理: Python threading/QTimer

- 数据可视化: Matplotlib/QtChart

3.2. 核心模块设计

3.2.1 模型训练模块

3.2.1.1 数据处理流程

3.2.1.2 关键训练参数

# 伪代码示例

model = YOLO('yolov11.yaml') # 模型配置

model.train(

data='road_defect.yaml', # 数据集配置

epochs=300, # 训练轮次

imgsz=640, # 输入尺寸

batch=16, # 批大小

optimizer='AdamW', # 优化器

lr0=0.01 # 初始学习率

)

3.2.2 应用系统模块

3.2.2.1 界面组件架构

MainWindow

├── ControlPanel # 控制面板

│ ├── ModeSelector

│ ├── Start/Stop

│ └── CameraSwitch

├── DisplayArea # 显示区域

│ ├── VideoFeed

│ └── ResultView

└── StatusBar # 状态栏

3.2.2.2 交互状态机

3.3. 关键技术实现

3.3.1 多模态输入处理

# 伪代码示例

class InputHandler:

def handle_image(self, path):

img = cv2.imread(path)

results = self.model(img)

self.display_results(img, results)

def handle_video(self, path):

cap = cv2.VideoCapture(path)

while cap.isOpened():

ret, frame = cap.read()

if not ret: break

results = self.model(frame)

self.display_results(frame, results)

def handle_realtime(self):

self.cap = cv2.VideoCapture(0)

self.timer.start(33) # ~30fps

def process_frame(self):

ret, frame = self.cap.read()

results = self.model(frame)

self.display_results(frame, results)

3.3.2 检测结果可视化

# 伪代码示例

def visualize_detection(frame, results):

# 绘制检测框

for box in results.boxes:

x1, y1, x2, y2 = box.xyxy[0]

cv2.rectangle(frame, (x1,y1), (x2,y2), (0,255,0), 2)

# 添加类别和置信度

cls = self.class_names[int(box.cls)]

conf = float(box.conf)

label = f"{cls} {conf:.2f}"

cv2.putText(frame, label, (x1, y1-10),

cv2.FONT_HERSHEY_SIMPLEX, 0.9, (0,255,0), 2)

# 转换为Qt格式

h, w, ch = frame.shape

bytes_per_line = ch * w

q_img = QImage(frame.data, w, h, bytes_per_line,

QImage.Format_RGB888)

return QPixmap.fromImage(q_img)

3.4. 性能优化方案

3.4.1 实时性保障措施

- 多线程处理:

class DetectionThread(QThread):

def __init__(self, model):

super().__init__()

self.model = model

def run(self):

while self.running:

frame = self.get_next_frame()

results = self.model(frame)

self.signal.emit(results)

- 帧率控制策略:

- 动态调整检测间隔

- 空闲帧跳过机制

- 分辨率自适应

3.4.2 内存管理方案

- 视频流分块处理

- 结果缓存清理机制

- GPU内存监控

3.5. 系统测试方案

3.5.1 测试用例设计

| 测试类型 | 测试内容 | 预期指标 |

|---|---|---|

| 功能测试 | 图片检测 | 准确率≥90% |

| 性能测试 | 实时检测 | FPS≥25 |

| 兼容测试 | 视频格式 | 支持MP4/AVI/MOV |

| 压力测试 | 长时间运行 | 内存泄漏<5MB/h |

3.5.2 评估指标

- 检测精度: mAP@0.5

- 处理速度: FPS

- 资源占用: CPU/GPU利用率

- 用户体验: 操作响应时间

4 最后

项目包含内容

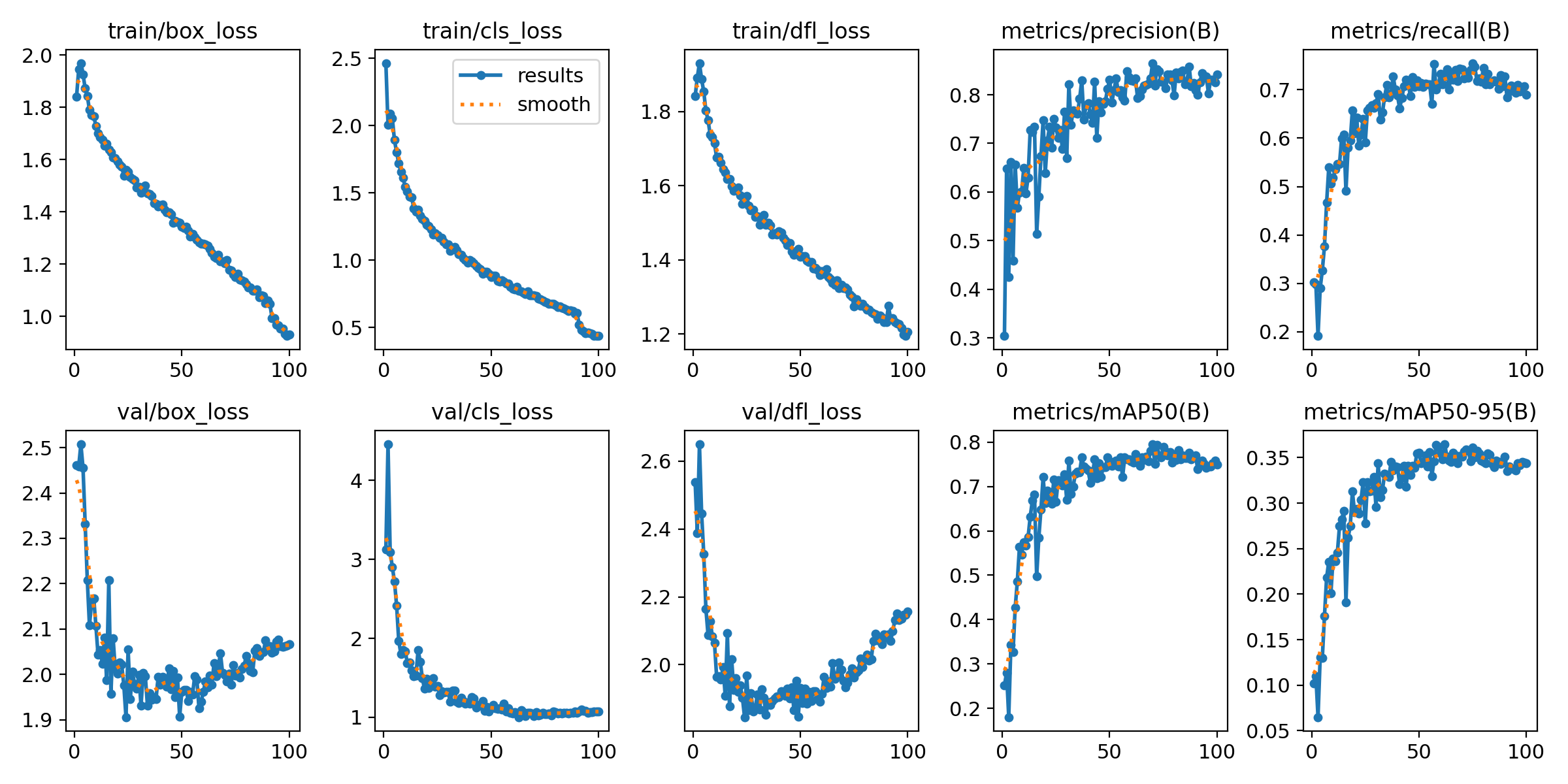

论文摘要

🧿 项目分享:大家可自取用于参考学习,获取方式见文末!

深度学习YOLO交通路面缺陷检测系统毕设分享

深度学习YOLO交通路面缺陷检测系统毕设分享

864

864

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?