在大模型时代,经常听到向量这个词,比如向量检索,相似度计算等。那么要怎样理解自然语言处理NLP(Natural Language Processing)中的向量呢?我们今天通过介绍一个简单的例子来理解向量。相信你看完之后,心里就明白了。本文重点介绍共现矩阵,首先看到矩阵两个字先不用慌,本文对文科生和理科生一样友好而平滑。

共现矩阵

共现矩阵是自然语言处理中一种用来表示词语之间关系的工具。在共现矩阵中,每一行代表一个词语,每一列也代表一个词语,矩阵中的每个元素则表示对应行词语和列词语在一段文本或者一组文本中同时出现的次数。简而言之,共现矩阵告诉我们哪些词语在文本中经常一起出现,从而揭示它们之间的关联性。

举例说明,有下面一个句子:

“小华喜欢吃苹果和橙子,他经常在学校买水果吃。”

将这句话按词语切分为:

“小华”、“喜欢”、“吃”、“苹果”、“和”、“橙子”、“他”、“经常”、“在”、“学校”、“买”、“水果”。

我们设置一个规则,即窗口大小为2,然后,我们对于每个词,看它周围2个词内出现了哪些其他词语,如果出现了就在共现矩阵中对应位置加1。

以"小华"为例,它周围2个词是"喜欢"、“吃”,所以我们在共现矩阵中"小华"行,“喜欢”、"吃"列的位置上加1。

依此类推,我们可以构建出如下的共现矩阵(为了简洁起见,这里只展示部分共现关系):

词向量与相似度计算

有了这个共现矩阵之后,我们就可以用向量来表示词了,比如:

"苹果"这个词的向量可以表示为:

[0, 0, 1, 0, 1, 1, 0, 0, 0, 0, 0, 0]

没错,就是用“苹果”这一行来表示。

"橙子"的向量则表示为:

[0, 0, 0, 1, 1, 0, 1, 0, 0, 0, 0, 0]

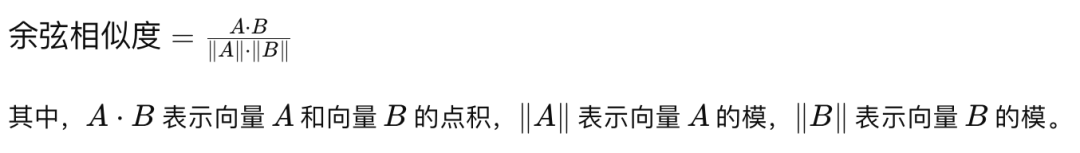

我们来看看,“苹果”和“橙子”之间有多大关联。这里可以用余弦相似度来衡量,即:

计算步骤如下:

已知:

"苹果"的向量 [0, 0, 1, 0, 1, 1, 0, 0, 0, 0, 0, 0]

“橙子"的向量 [0, 0, 0, 1, 1, 0, 1, 0, 0, 0, 0, 0]

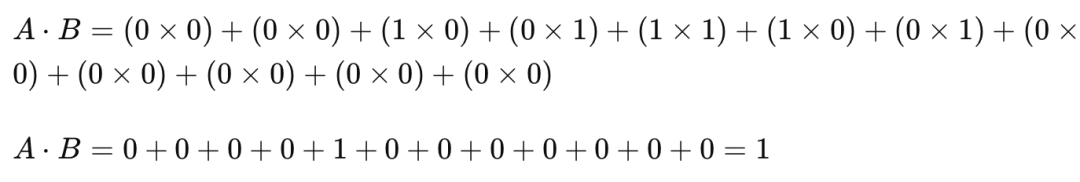

1. 计算”苹果”和”橙子”的点积,即两个向量的对应位相乘,然后相加:

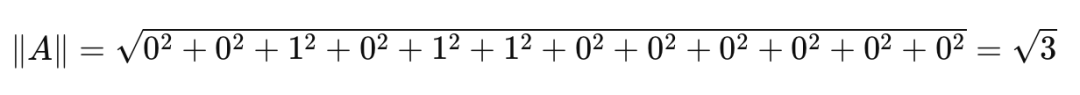

2. 计算"苹果"的模:

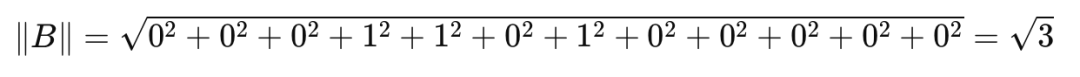

3. 计算”橙子"的模:

4. 计算余弦相似度:

因此,"苹果"和"橙子"之间的余弦相似度为 1/3。

苹果和橙子的向量相似度为1/3。这意味着在给定的上下文中,苹果和橙子有1/3的共现情况,这种相似度反映了苹果和橙子在上下文中的共现模式。

再来看看“苹果”和“喜欢”的相似度:

共现向量(苹果)= [0, 0, 1, 0, 1, 1, 0, 0, 0, 0, 0, 0]

共现向量(喜欢)= [1, 0, 1, 0, 1, 0, 0, 0, 0, 0, 0, 0]

余弦相似度 ≈ 0.577

而“苹果”和“学校”的相似度则为0,这表明它们在共现矩阵中共现的情况很少或根本没有。换句话说,这两个词在文本中很少同时出现在相同的上下文中。因此,它们之间的共现模式非常不同,可以认为它们在语义上没有明显的联系或相关性。

共现矩阵向量表示的局限性

我们来计算一下“他”与“经常”的相似度,结果是1/3,而“小华”与“经常”的相似度为0。而从语义来看,这里的“他”代指“小华”,但从上面的共现矩阵并没有发现这种联系,说明了共现矩阵在捕捉词语语义关系方面的不足。共现矩阵的不足,主要表现在以下几点:

**稀疏性:**共现矩阵会变得非常稀疏,特别是在处理大型语料库时,因为大多数词语只与少数词语共现。这导致大量的维度没有实际的信息,而是被填充为零。

**词序信息丢失:**共现矩阵仅考虑词语共现的频率,忽略了词语在句子或文本中的顺序信息,这在很多情况下是非常重要的,尤其是在理解上下文中的语义关系时。

**无法处理复杂关系:**共现矩阵无法捕捉到更复杂的语义关系,例如词语的多义性、上下位关系等,因为它只关注词语之间的共现频率。

相比之下,机器学习中的词向量具有以下优点:

(1)语义信息丰富,通过大型语料库学习,能更好地捕捉语义信息;

(2)低维稠密表示,相对共现矩阵,更具信息量且易于处理;

(3)考虑词序信息,如RNN和Transformer等模型能够更准确地捕捉语义关系,提高模型性能。

关于机器学习词向量,后面的文章会陆续介绍。

本文介绍了自然语言处理中的向量表示,着重介绍了共现矩阵的概念和应用。共现矩阵是一种用于表示词语之间关系的工具,通过统计词语在文本中的共现情况,揭示词语之间的关联性。文章以一个简单的例子演示了如何构建共现矩阵,并计算了词语之间的相似度。虽然共现矩阵能捕捉词语的共现关系,但在理解语义关系方面存在不足。相比之下,机器学习中的词向量能更准确地捕捉语义信息,具有更丰富的语义表示,对NLP任务更为有效。

题外话

黑客&网络安全如何学习

今天只要你给我的文章点赞,我私藏的网安学习资料一样免费共享给你们,来看看有哪些东西。

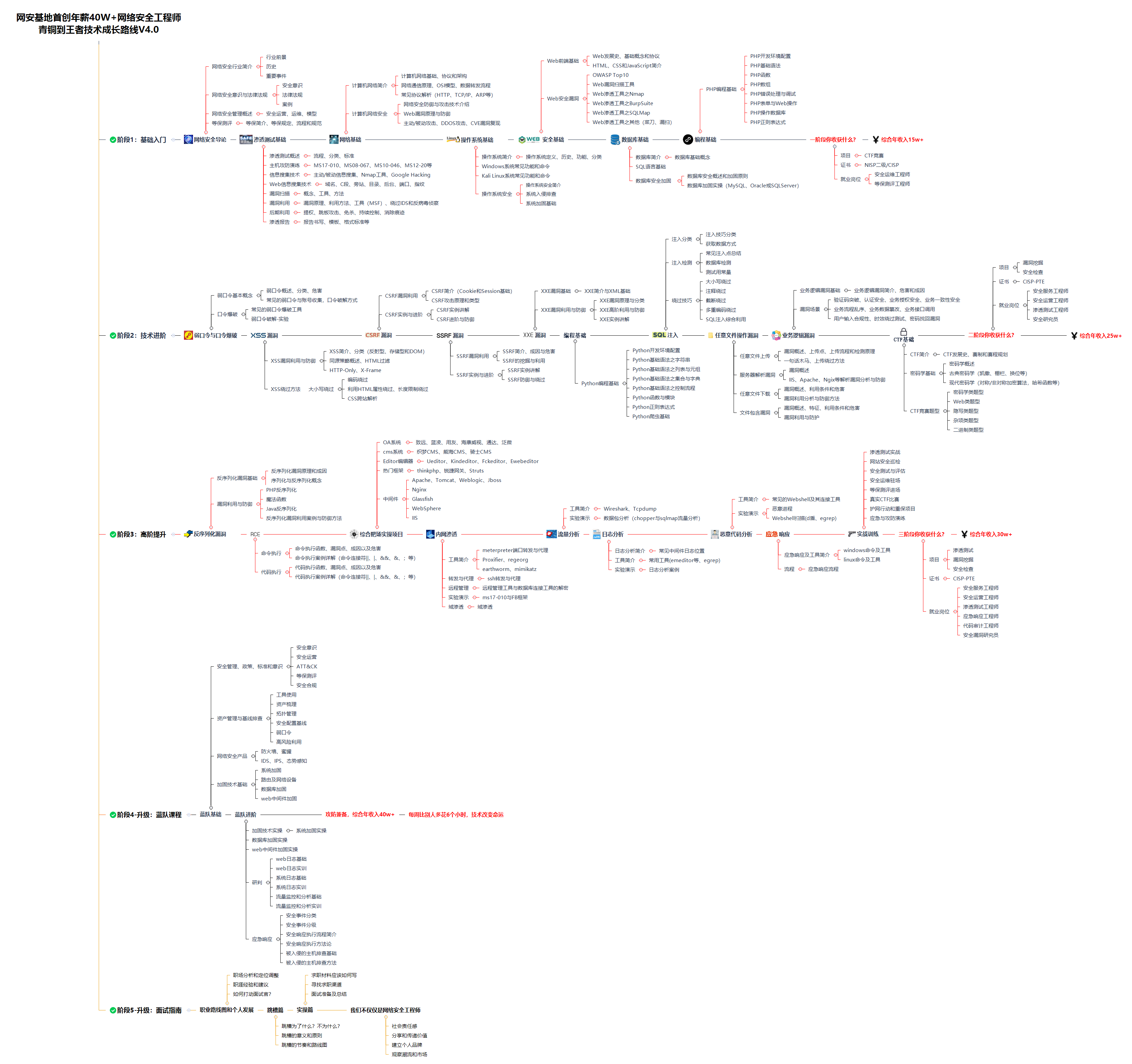

1.学习路线图

攻击和防守要学的东西也不少,具体要学的东西我都写在了上面的路线图,如果你能学完它们,你去就业和接私活完全没有问题。

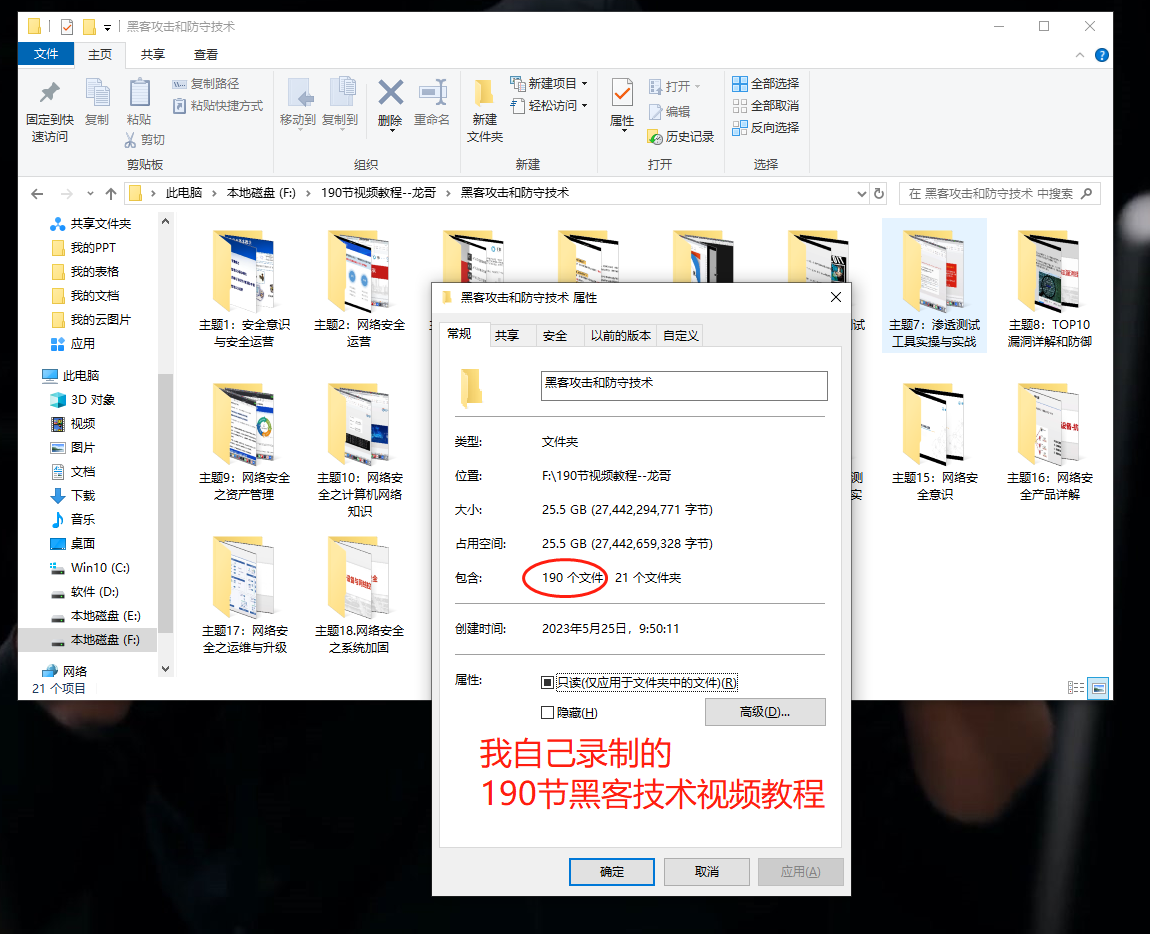

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己录的网安视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

内容涵盖了网络安全法学习、网络安全运营等保测评、渗透测试基础、漏洞详解、计算机基础知识等,都是网络安全入门必知必会的学习内容。

(都打包成一块的了,不能一一展开,总共300多集)

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

🐵这些东西我都可以免费分享给大家,需要的可以点这里自取👉:网安入门到进阶资源

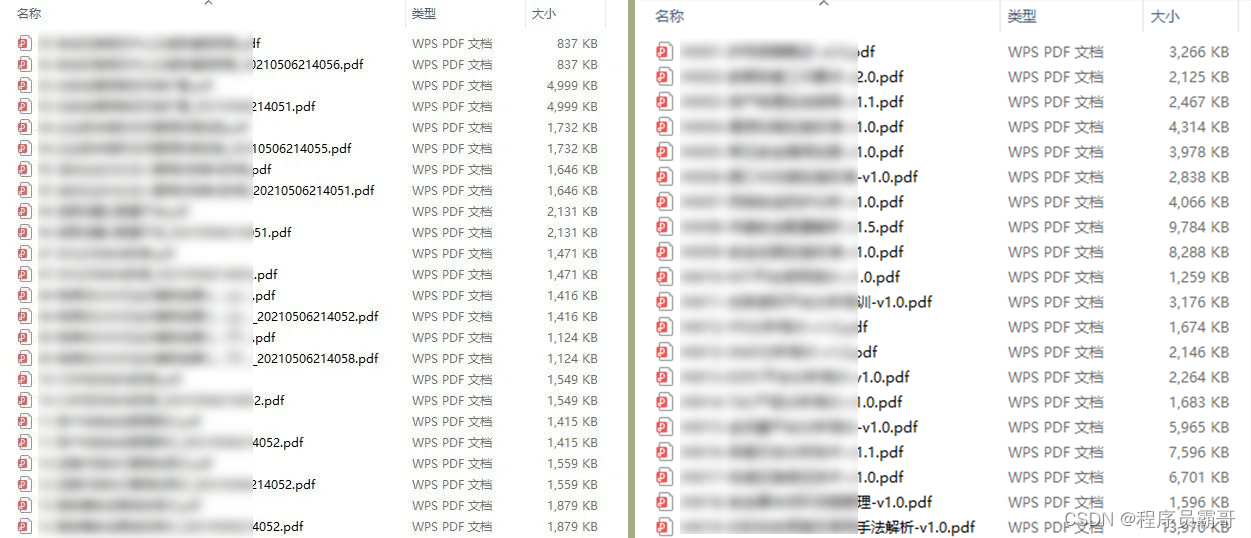

3.技术文档和电子书

技术文档也是我自己整理的,包括我参加大型网安行动、CTF和挖SRC漏洞的经验和技术要点,电子书也有200多本,由于内容的敏感性,我就不一一展示了。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

🐵这些东西我都可以免费分享给大家,需要的可以点这里自取👉:网安入门到进阶资源

4.工具包、面试题和源码

“工欲善其事必先利其器”我为大家总结出了最受欢迎的几十款款黑客工具。涉及范围主要集中在 信息收集、Android黑客工具、自动化工具、网络钓鱼等,感兴趣的同学不容错过。

还有我视频里讲的案例源码和对应的工具包,需要的话也可以拿走。

🐵这些东西我都可以免费分享给大家,需要的可以点这里自取👉:网安入门到进阶资源

最后就是我这几年整理的网安方面的面试题,如果你是要找网安方面的工作,它们绝对能帮你大忙。

这些题目都是大家在面试深信服、奇安信、腾讯或者其它大厂面试时经常遇到的,如果大家有好的题目或者好的见解欢迎分享。

参考解析:深信服官网、奇安信官网、Freebuf、csdn等

内容特点:条理清晰,含图像化表示更加易懂。

内容概要:包括 内网、操作系统、协议、渗透测试、安服、漏洞、注入、XSS、CSRF、SSRF、文件上传、文件下载、文件包含、XXE、逻辑漏洞、工具、SQLmap、NMAP、BP、MSF…

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

🐵这些东西我都可以免费分享给大家,需要的可以点这里自取👉:网安入门到进阶资源

————————————————

版权声明:本文为博主原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。

2891

2891

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?