线性回归

关注公众号“轻松学编程”了解更多。

【关键词】最小二乘法,线性

一、普通线性回归

1、原理

分类的目标变量是标称型数据,而回归将会对连续型的数据做出预测。

应当怎样从一大堆数据里求出回归方程呢?

假定输人数据存放在矩阵X中,而回归系数存放在向量W中。那么对于给定的数据X1, 预测结果将会通过

Y=X*W

给出。现在的问题是,手里有一些X和对应的Y,怎样才能找到W呢?

一个常用的方法就是找出使误差最小的W。这里的误差是指预测Y值和真实Y值之间的差值,使用该误差的简单累加将使得正差值和负差值相互抵消,所以我 们采用平方误差。

最小二乘法

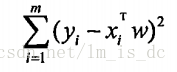

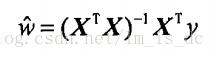

平方误差可以写做:

对W求导,当导数为零时,平方误差最小,此时W等于:

例如有下面一张图片:

本文详细介绍了Python中线性回归的原理和实例,包括普通线性回归、岭回归和Lasso回归。通过实例比较了不同模型的预测效果,展示了如何使用最小二乘法、KNN以及正则化技术优化模型,并探讨了特征对结果的影响。文章还涉及数据归一化处理,以提高模型精度。

本文详细介绍了Python中线性回归的原理和实例,包括普通线性回归、岭回归和Lasso回归。通过实例比较了不同模型的预测效果,展示了如何使用最小二乘法、KNN以及正则化技术优化模型,并探讨了特征对结果的影响。文章还涉及数据归一化处理,以提高模型精度。

订阅专栏 解锁全文

订阅专栏 解锁全文

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?