目录

🎬 攻城狮7号:个人主页

🔥 个人专栏:《AI前沿技术要闻》

⛺️ 君子慎独!

🌈 大家好,欢迎来访我的博客!

⛳️ 此篇文章主要介绍 Wan2.2-S2V开源

📚 本期文章收录在《AI前沿技术要闻》,大家有兴趣可以自行查看!

⛺️ 欢迎各位 ✔️ 点赞 👍 收藏 ⭐留言 📝!

前言

你有没有想过,如果能让相册里那张你最喜欢的宠物照片,开口对你说一句“我爱你”,会是怎样一番奇景?或者,让历史书里的爱因斯坦,亲自为你讲解相对论?

在过去,这或许是好莱坞特效团队才能实现的魔法。但现在,这股“魔力”正从云端飘向我们每个人的指尖。

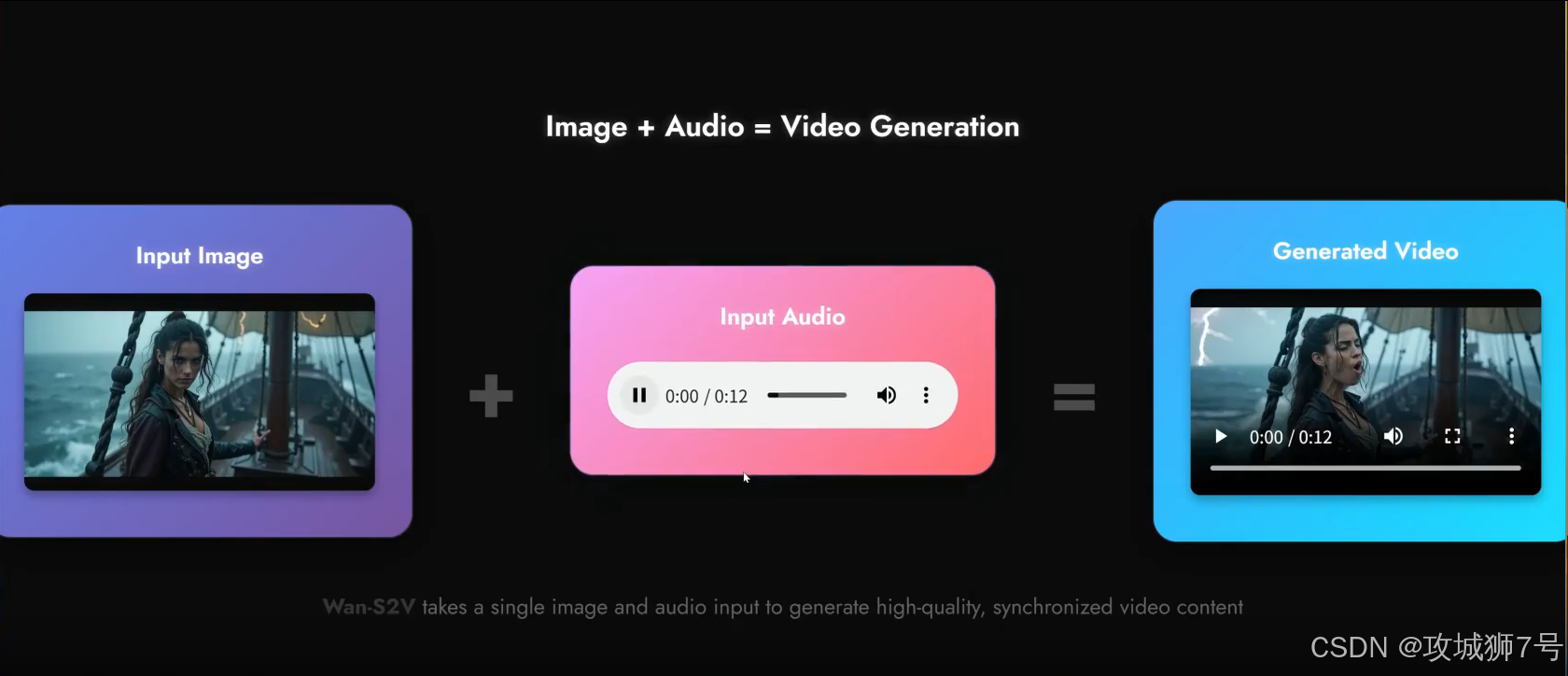

最近,阿里巴巴的通义万相团队向世界开源了一项令人惊叹的新技术——`Wan2.2-S2V`。简单来说,它只做一件事,但却做得出神入化:你给它一张静态图片和一段音频,它就能还你一段主角“活”了过来的视频。

|

S2V音频合成来了!Wan2.2+ComfyUI全能整合包5.1支持S2V音频合成、一键替换主体人物,动作复制等众多功能! |

|---|

这不仅仅是让照片动起来那么简单。`Wan2.2-S2V` 生成的视频,无论是面部表情的细腻变化、与音频完美同步的口型,还是自然流畅的肢体动作,都达到了堪称“电影级”的水准。

那个曾经只会静静待在相框里的形象,现在不仅能开口说话,还能唱歌、表演,甚至可以根据你的文本指令,在特定的场景里与环境互动。一场关于个人视频创作的革命,似乎已经悄然打响。

一、一场“声”与“画”的完美合奏

`Wan2.2-S2V` 的魅力,在于它精准捕捉了“神”与“形”的统一。它不仅仅是让嘴巴跟着声音开合,更是让整个角色的情绪、神态都与音频融为一体。

想象一下,你上传了一张自己偶像的照片,再配上他的一段经典台词录音。模型输出的视频里,偶像不仅口型分毫不差,连眉宇间的神采、说话时头部的轻微晃动,都仿佛是真人亲临。当音频的节奏加快,角色的情绪变得激动时,他的表情也会随之变得更加生动。

这背后,是 `Wan2.2-S2V` 掌握的两项核心“秘技”:

(1)全局与局部的双重控制:模型一方面通过文本指令(Prompt)来理解和控制视频的全局运动,比如“让角色在火车窗边唱歌”,这决定了大的场景和动作。另一方面,它又通过音频来驱动局部的精细动作,比如口型、面部肌肉的牵动、甚至配合节拍的手势。

(2)画面与声音的“死锁”:为了让音画完美同步,研发团队引入了两种强大的控制机制(`AdaIN` 和 `CrossAttention`)。你可以把它们想象成两位顶级的“现场导演”,一位负责实时校对口型,另一位负责确保角色的表情和情绪与声音的情感基调完全一致,两者合力,才实现了这种天衣无缝的效果。

二、如何让AI拥有“长时记忆”?

在AI视频生成领域,一个长期存在的痛点是“短期记忆”。很多模型在生成几秒钟的视频后,就会开始“忘记”角色最初的样子和动作,导致画面出现前后不一致、人物“变形”等问题。

`Wan2.2-S2V` 在这方面取得了重大突破,它单次生成的视频时长可以达到分钟级别,这在开源模型中是相当领先的。

为了实现这一点,它采用了一种聪明的“层次化帧压缩”技术。我们可以把它理解为,AI学会了如何更高效地“记笔记”。在生成视频的每一帧时,它不再需要回头翻看前面所有帧的每一个像素细节,而是参考一个高度浓缩的“历史摘要”。

这个“摘要”包含了过去多达73帧的关键动态信息。正因为有了这份足够长的“记忆”,模型才能在长达一分钟的表演中,始终保持角色的稳定性和动作的连贯性,不会“演着演着就忘了自己是谁”。

三、从“实验室”到“你的电脑”,开源的意义所在

`Wan2.2-S2V` 最大的亮点之一,就是它发布即开源。这意味着,它不再是少数大公司才能使用的“屠龙之技”,而是全世界开发者和创作者都能自由使用的工具。

从数字人直播、影视制作,到AI教育、个性化广告,这项技术的应用前景几乎是无限的。

(1)对于内容创作者:你不再需要真人出镜,只需一张形象照和一段录音,就能生成源源不断的口播视频。

(2)对于教育工作者:可以轻松制作出生动的历史人物讲解视频,让课堂变得前所未有的有趣。

(3)对于普通人:这意味着一种全新的娱乐和社交方式。你可以让家里的猫猫狗狗“唱”生日歌,可以制作专属的动态表情包,甚至可以让泛黄的老照片里许久未见的亲人,动起来对你说一句话。

当然,强大的能力也需要负责任的使用。但 `Wan2.2-S2V` 的开源,无疑是AI技术普惠化的又一个里程碑。它将视频创作的门槛,从需要专业设备和技能,拉低到了只需要想象力和一点点创意。

结语:当每个像素都开始拥有“灵魂”

AI生成视频的赛道,已经变得异常“拥挤”。从国外的 Runway、Pika,到国内的各路高手,技术的迭代速度令人目不暇接。

`Wan2.2-S2V` 的出现,就像是在这场激烈的竞赛中,投下了一颗颇具分量的石子。它专注于“音频驱动”这一细分但极其重要的领域,并将其做到了一个新的高度。

这背后,是旺盛的产业需求和我们每个人对“魔法”的渴望。我们不再满足于AI仅仅能生成图像,我们希望它能讲述故事,传递情感。

`Wan2.2-S2V` 让我们看到了这种可能性。它让我们相信,在不远的未来,我们或许真的只需要写下一段剧本,AI就能为我们自动生成一部包含对话、表演和场景的完整影片。

一个当每个像素都开始拥有“灵魂”的时代,正向我们走来。而你要做的,或许只是打开相册,选一张照片,然后想好,你想让它对这个世界说些什么。

立即体验:

通义万相官网:https://tongyi.aliyun.com/wanxiang/generate

阿里云百炼API:https://bailian.console.aliyun.com/?tab=api#/api/?type=model&url=2978215

开源地址:

Github:https://github.com/Wan-Video/Wan2.2

魔搭社区:https://www.modelscope.cn/models/Wan-AI/Wan2.2-S2V-14B

HuggingFace:https://huggingface.co/Wan-AI/Wan2.2-S2V-14B

看到这里了还不给博主点一个:

⛳️ 点赞☀️收藏 ⭐️ 关注!

💛 💙 💜 ❤️ 💚💓 💗 💕 💞 💘 💖

再次感谢大家的支持!

你们的点赞就是博主更新最大的动力!

1358

1358