目标检测的两个任务,分类和位置回归,本帖将经典的位置回归损失函数总结如下,按发表时间顺序。

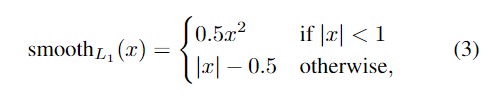

L1、L2、smooth L1 loss

提出smooth L1 loss的论文:

L1最低点是不可导的,所以势必不会收敛到最低点,可能会在最优解附近震荡。而L2损失容易在离群点产生梯度爆炸的问题。smooth L1则集两者的优点于一身。

IoU loss

提出IoU loss的论文:

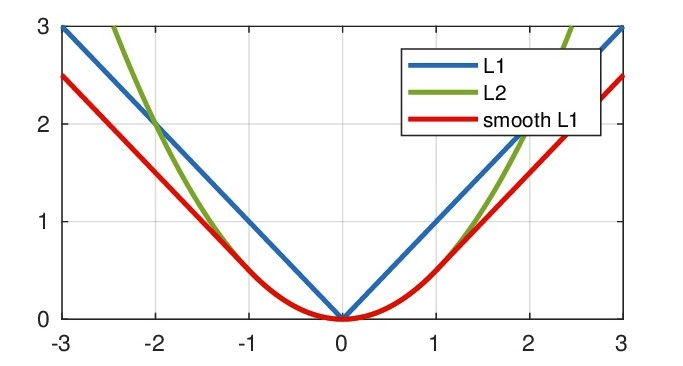

不论是L2还是smooth L1 loss都没有考虑到四个点的关联性和尺度不变性,这个是比较致命的缺点,当两对预测框与GT框的IoU相同时,尺度更大那一对loss会更高,或者如下图,用左下角和右上角点计算损失,L2 loss相同,但IoU却不相同。

IoU损失有两种形式,后一种更为常用:

L I o U = − l n I o U L_{IoU} = -lnIoU LIoU=−lnIoU

本文总结了目标检测中位置回归的任务及各类损失函数的发展历程,包括从经典的L1、L2损失到IoUloss及其改进版GIoU、DIoU、CIoU等,详细解释了每种损失函数的特点与不足。

本文总结了目标检测中位置回归的任务及各类损失函数的发展历程,包括从经典的L1、L2损失到IoUloss及其改进版GIoU、DIoU、CIoU等,详细解释了每种损失函数的特点与不足。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4946

4946

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?