Anthropic 分析了用户与 Claude 3.5 Sonnet 之间的 100 万次匿名对话。研究发现,大多数人使用该模型进行软件开发,同时也发现了故障和越狱。

新功能:Anthropic 构建了一个工具 Clio,以更好地了解用户如何与其大型语言模型交互。该系统挖掘匿名使用数据,以获得洞察力,以提高性能和安全性。

工作原理:Clio 使用 Claude 3.5 Sonnet 本身自动提取用户与模型对话的摘要。然后它将相关主题聚类。为了保护隐私,它会匿名化和汇总数据,只显示有关集群的信息。

• Clio 从对话中提取信息,例如轮次、所讲语言以及所说内容的摘要。

• 它嵌入摘要并根据相似性对其进行聚类。此过程创建了数千个集群。

• 为每个集群提供示例摘要,Clio 会生成集群中信息类型的简短描述。

• 它重复该过程以创建层次结构,对集群的描述进行聚类,生成新描述等等。例如,描述为“打结”和“浇花”的集群本身就聚集在“日常生活技能”中。

结果:Clio 发现了 Claude 3.5 Sonnet 的常见、不常见和不允许的用途。它还检测到系统本身的错误行为。

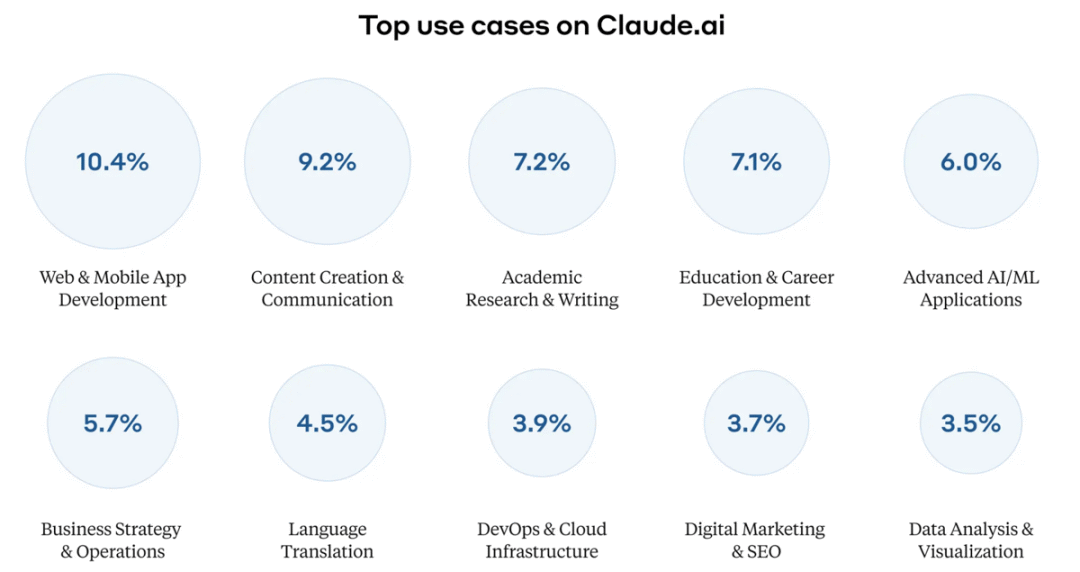

• 最大的单一类别是软件开发。编码占 Claude 对话的 15% 到 25%。Web 和移动应用程序开发占总对话的 10% 以上,AI 和机器学习应用程序占 6%,DevOps 和云基础设施占 4% 左右,数据分析占 3.5%。

• 接下来是与业务相关的用途。文本生成和通信占总对话的约 9%,而学术研究和写作占 7% 以上。商业战略和运营占近 6%。

• 细分用途包括在游戏《龙与地下城》中担任地下城主、解梦、解填字游戏、分析足球比赛和为灾难做准备。

• Clio 发现了大规模违反公司使用政策的行为。例如,大量用户设计了提示,以避开安全分类器,使用 Claude 进行露骨的色情角色扮演。

• 它还突出了 Anthropic 安全分类器的缺陷。例如,它发现了一些对话集群,这些对话集群不应该被标记,而应该被标记却没有被标记。

重要性:了解人们如何使用人工智能的传统方法(例如调查)可能会产生不准确的结果,因为人们通常不会准确报告自己的行为。Clio 提供了一种分析现实世界使用情况的方法,就像 Google Trends 监控搜索行为一样,而不会损害隐私。这种方法可以帮助 AI 构建者发现小众用例,识别缺陷,并定制训练和测试数据以最好地服务于用户。

我们在想:我们都支持自动化地下城主,但我们很高兴看到 AI 辅助编码在 Claude 的实际用途中名列前茅!

(本文系翻译,内容来自DeepLearning.AI,文章内容不代表本号立场)

觉得文章不错,顺手点个“点赞”、“在看”或转发给朋友们吧。

相关阅读:

关于译者

关注公众号看其它原创作品

坚持提供对你有用的信息

觉得好看,点个“点赞”、“在看”或转发给朋友们,欢迎你留言。

1560

1560

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?