部署Ollama

ollama地址:Ollama

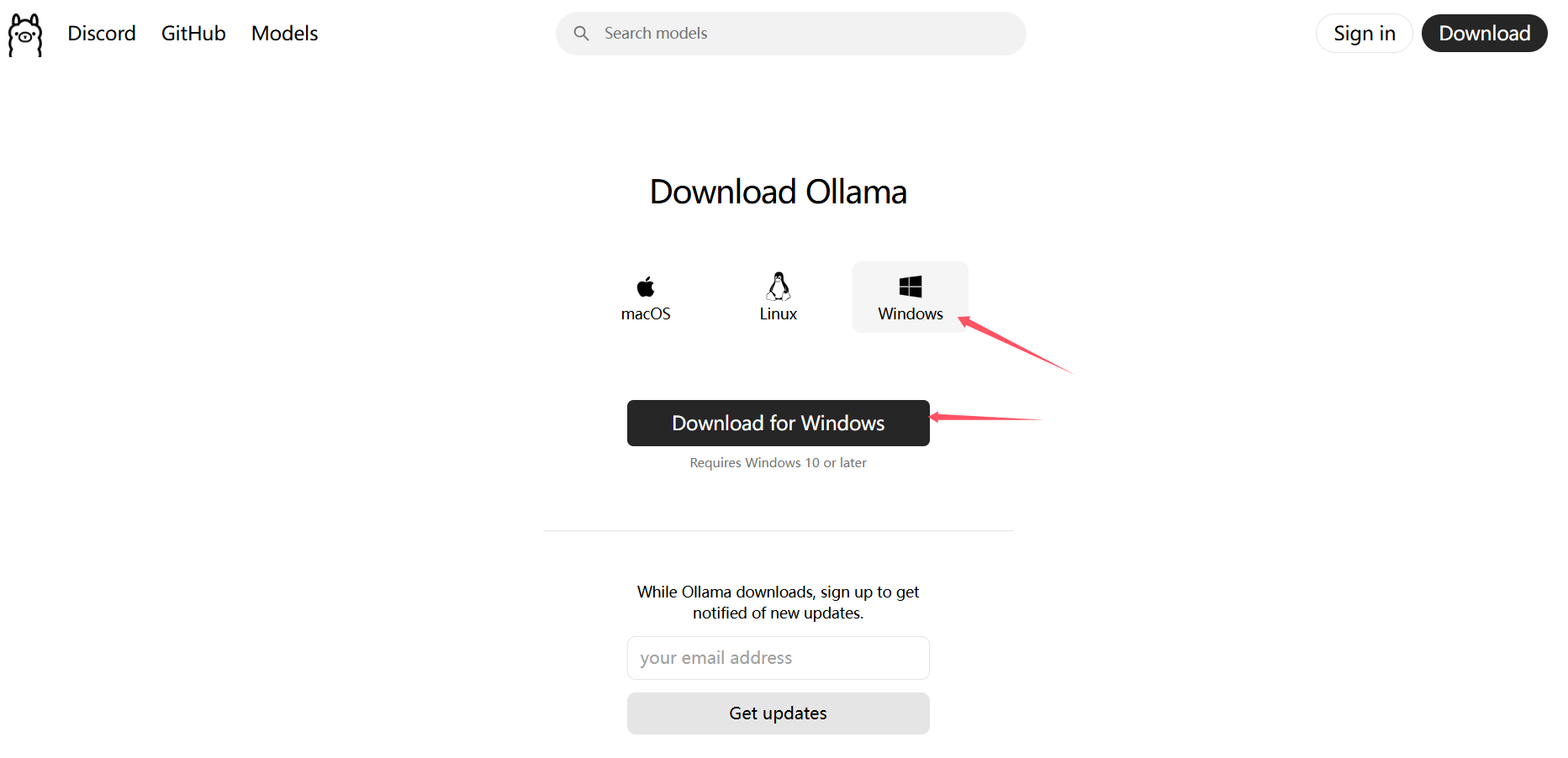

下载Ollama

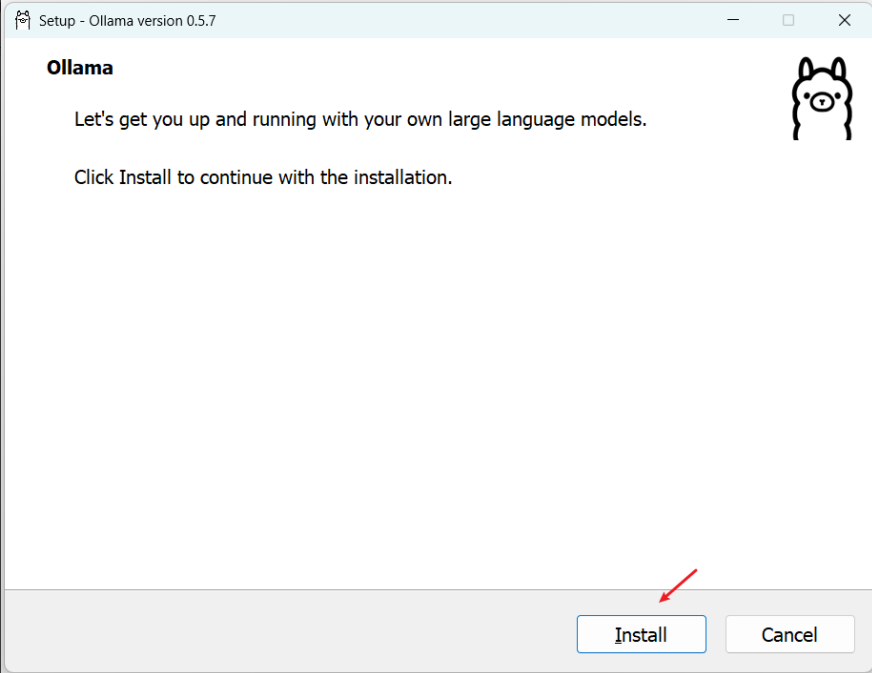

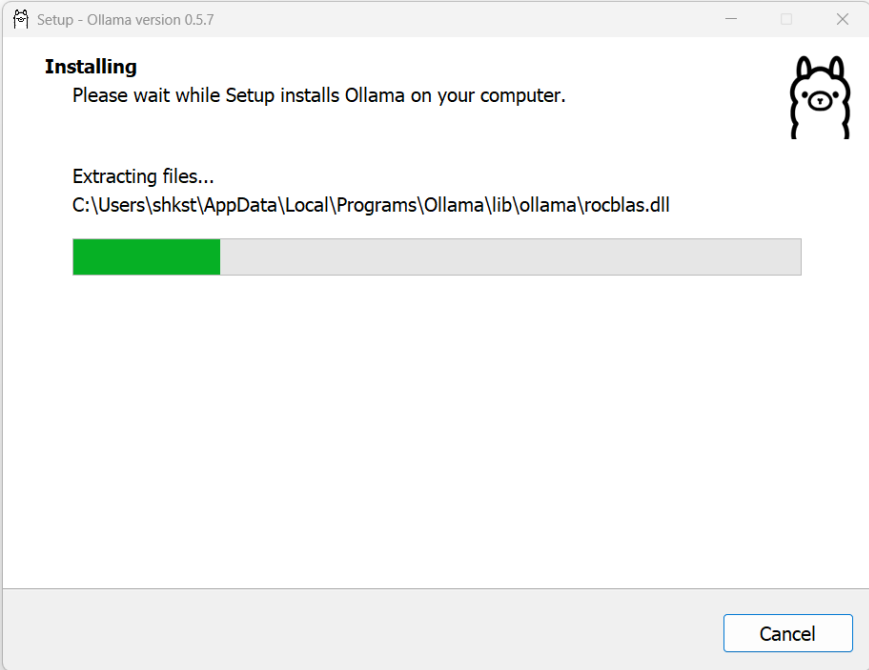

安装Ollama

傻瓜式安装

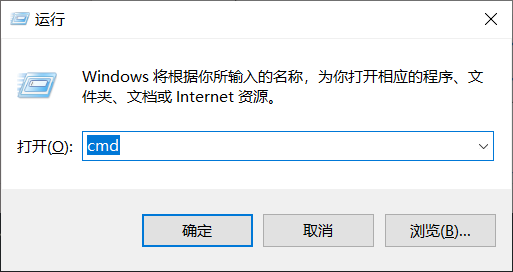

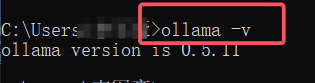

安装完成后,验证是否安装成功:

“win+r”输入cmd

输入命令 ollama -v

能够显示出ollama版本说明安装成功

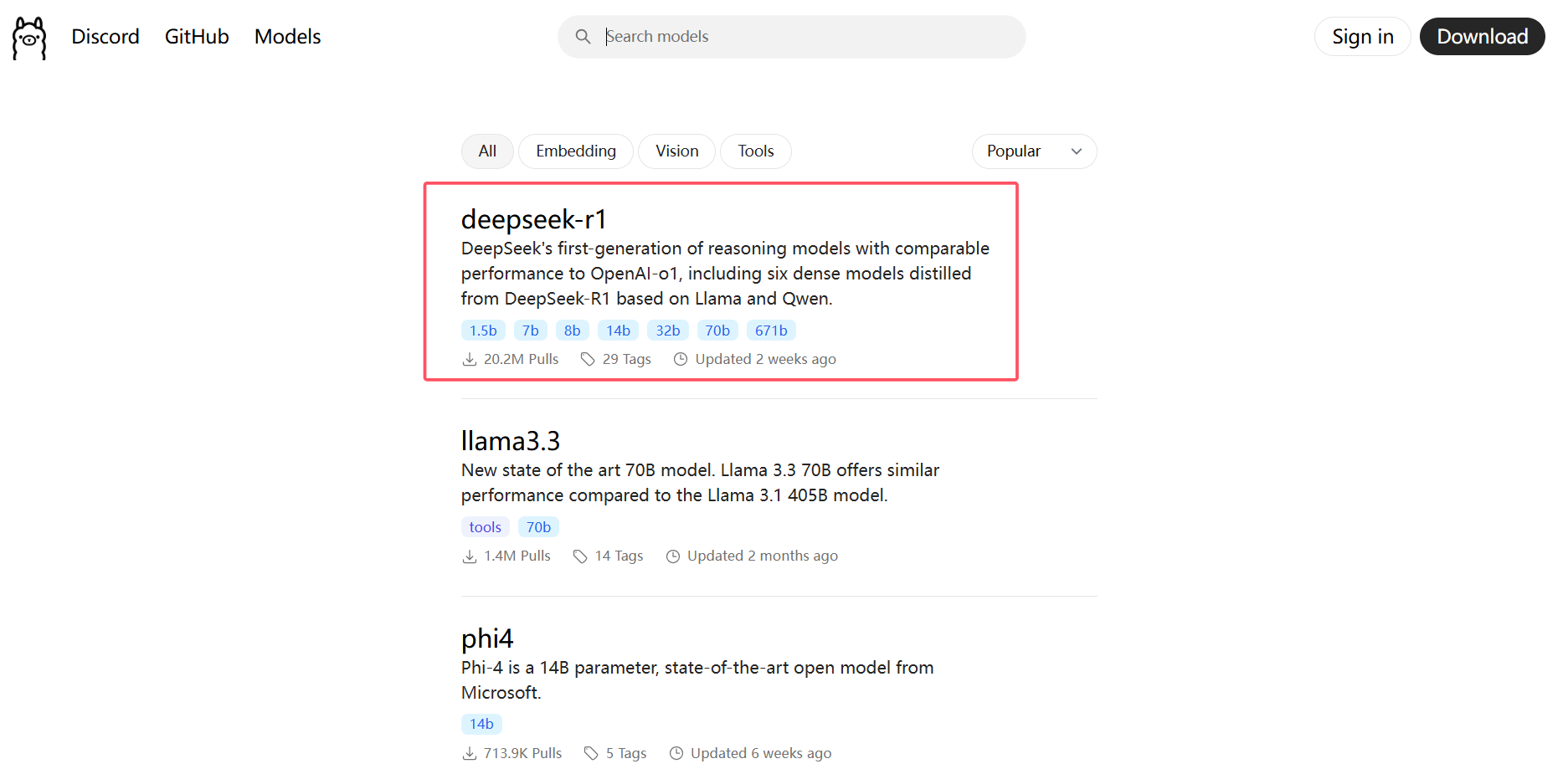

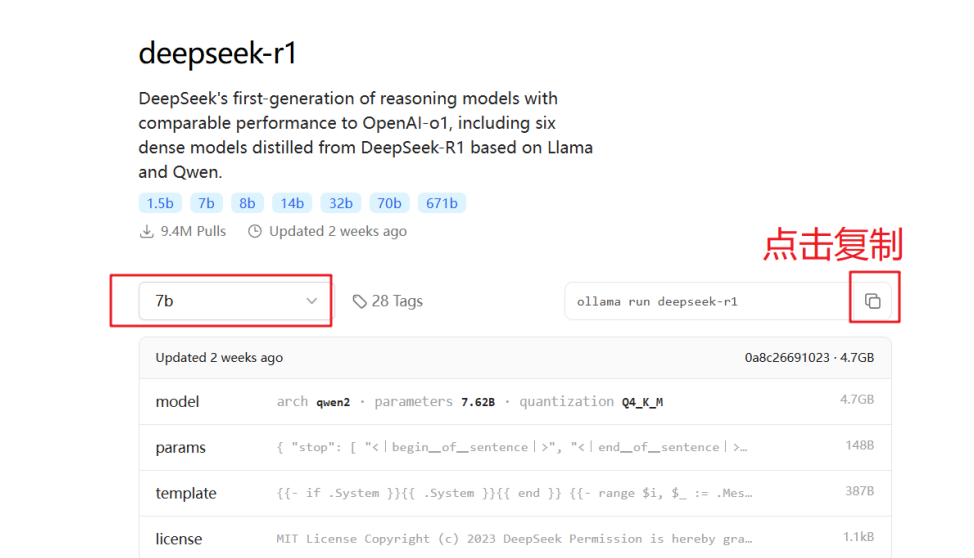

选择r1模型

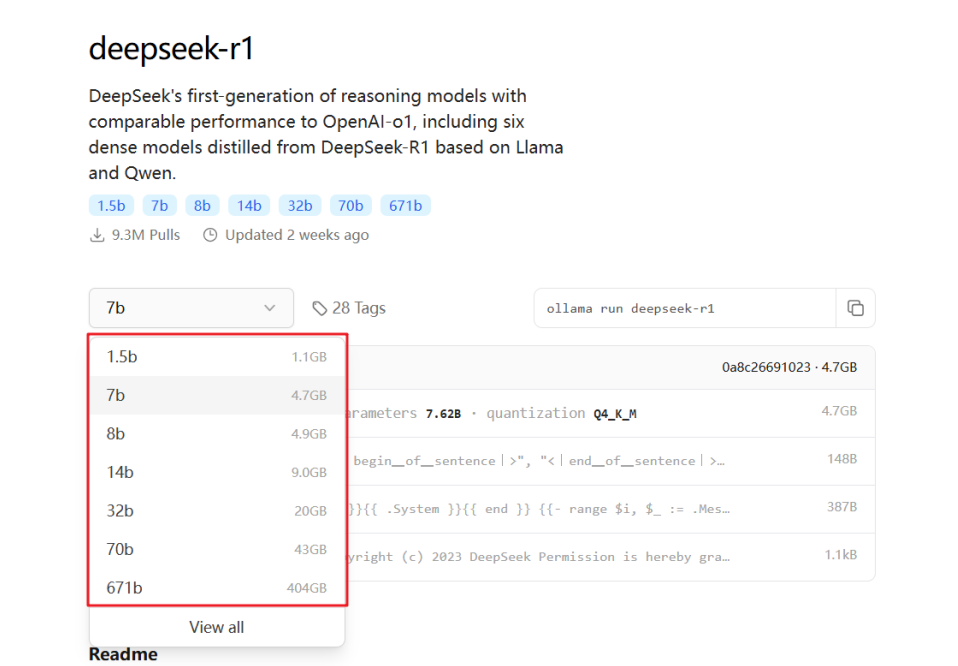

选择版本

b代表10亿参数量,7b就是70亿参数量。这里的671B是HuggingFace经过4-bit标准量化的,所以大小是404GB。

ollama 支持CPU与GPU混合推理。将内存与显存之和大致视为系统的总内存空间。

如果你想运行404GB的671B,建议你的内存+显存能达到500GB以上。

我这里选择下载7B版本

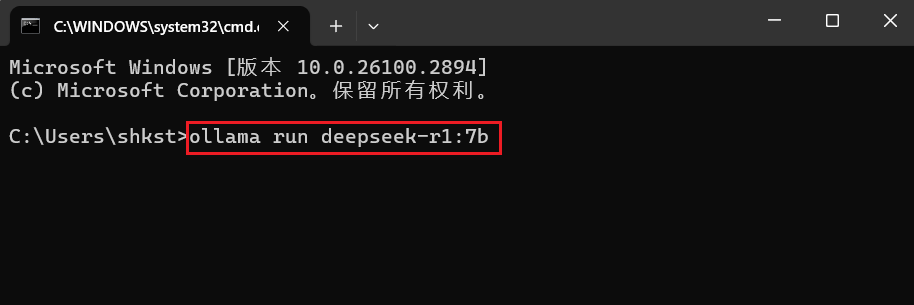

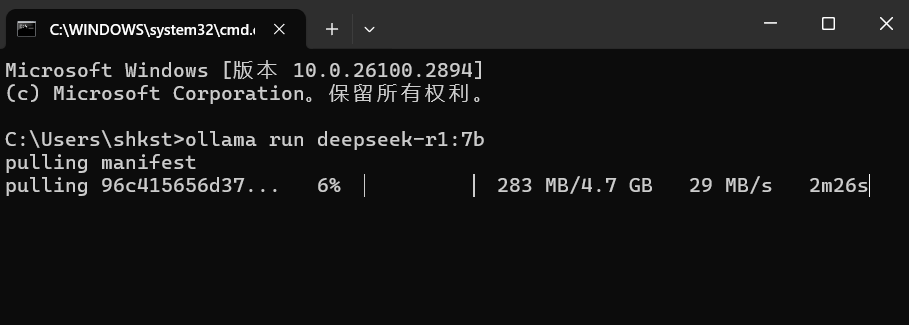

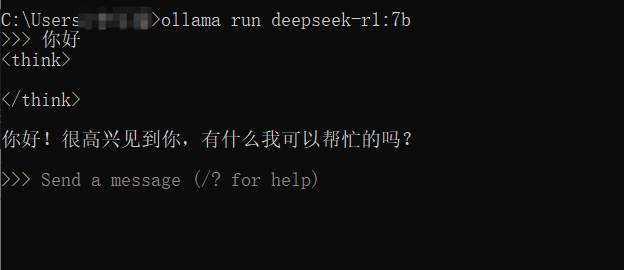

本地运行DeepSeek模型

在命令行中,输入如下命令:

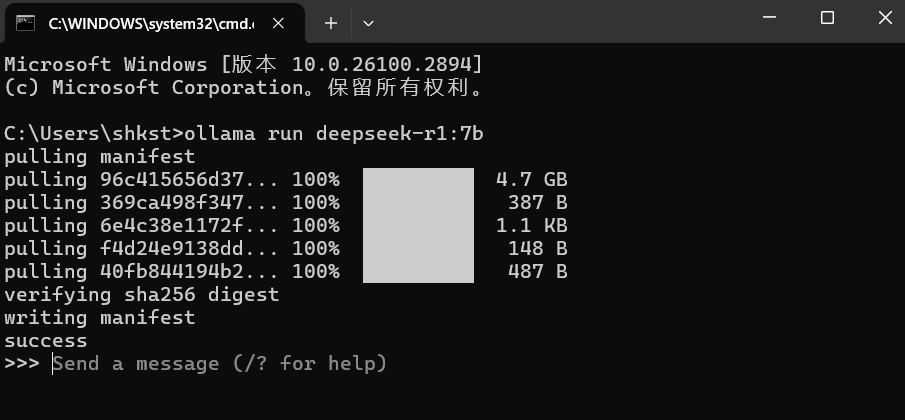

ollama run deepseek-r1:7b

下载完成后,自动进入模型,直接在命令行输入问题,即可得到回复。

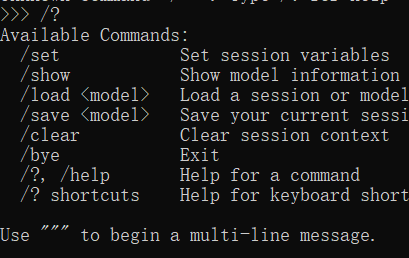

获取帮助:

/?

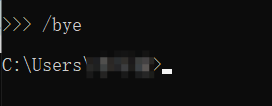

退出对话:

/bye

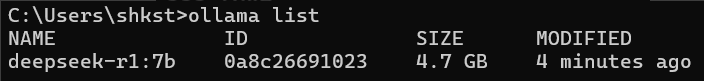

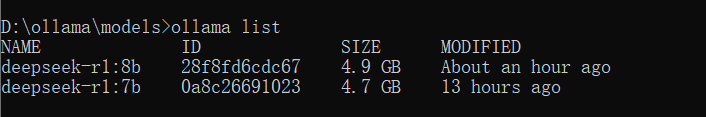

查看已有模型

ollama list

使用客户端工具

CherryStudio的下载地址:https://cherry-ai.com/

CherryStudio同样也是傻瓜式安装,这里省略

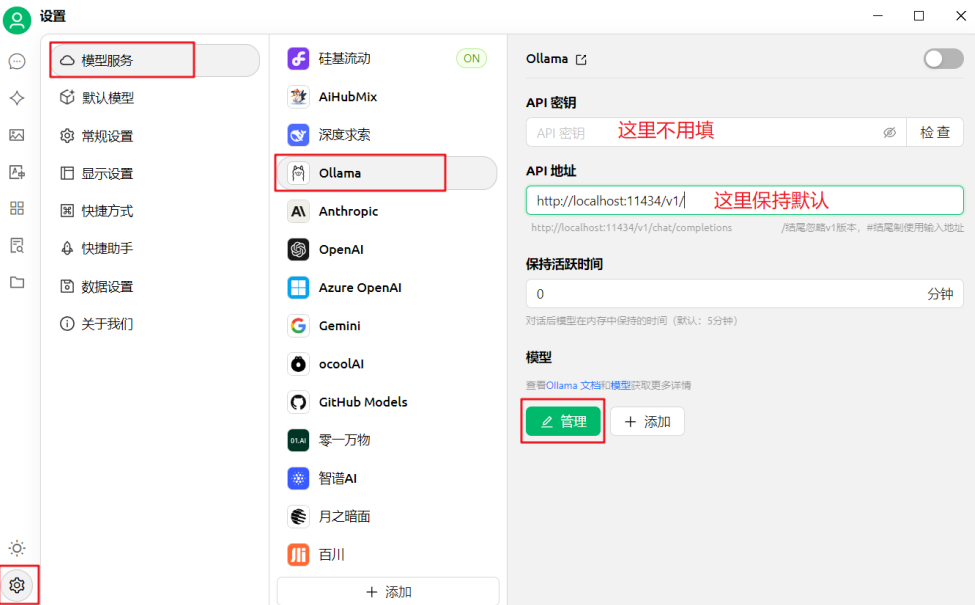

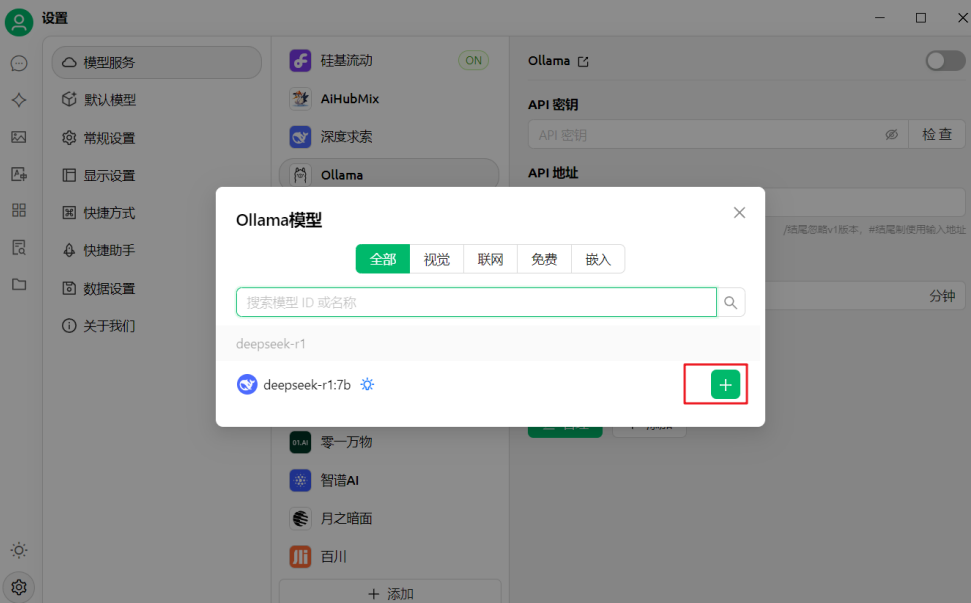

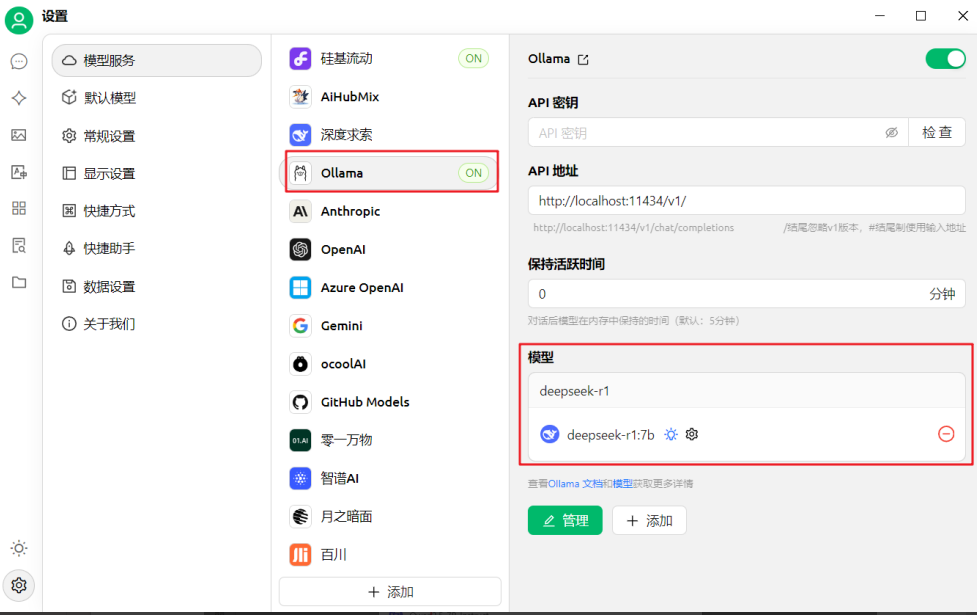

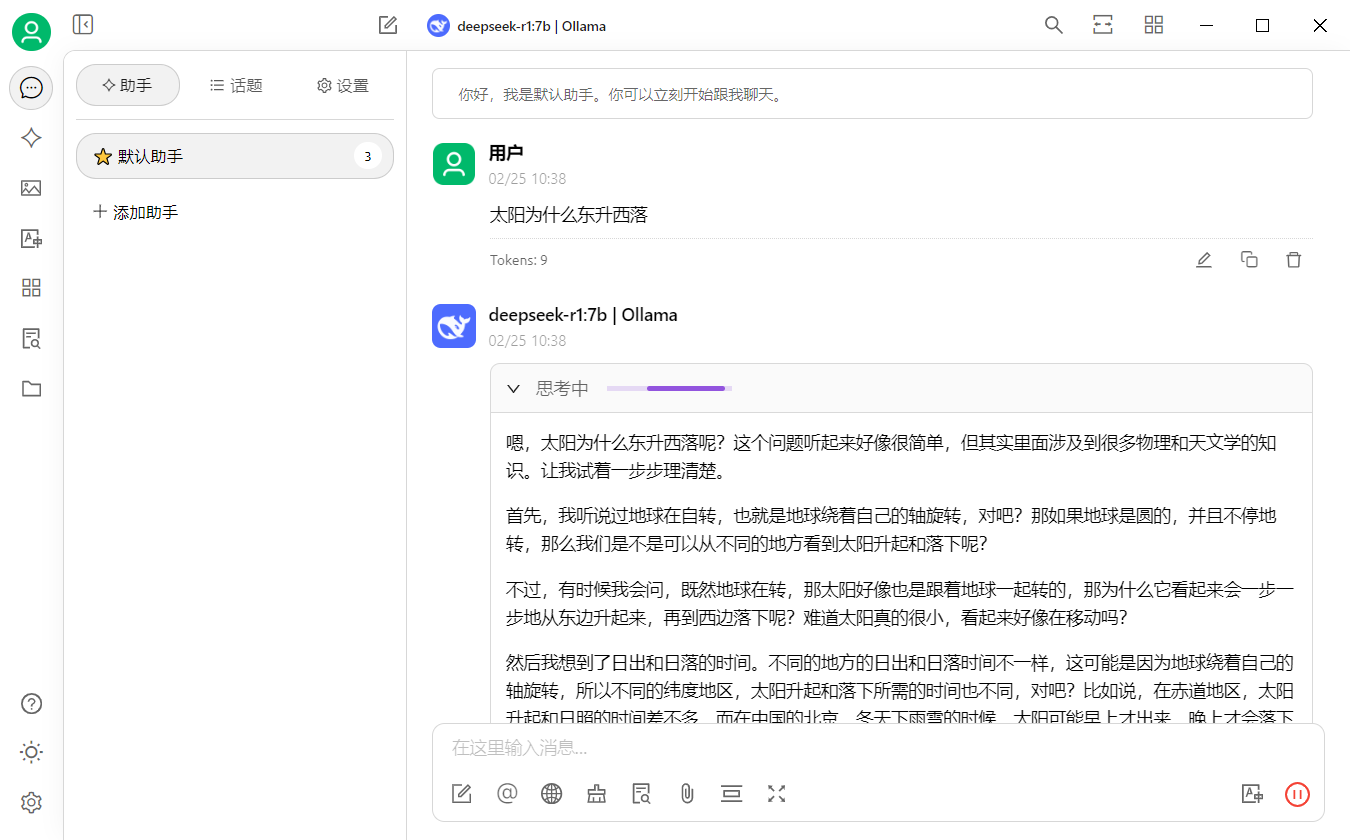

使用CherryStudio访问7b的蒸馏模型:

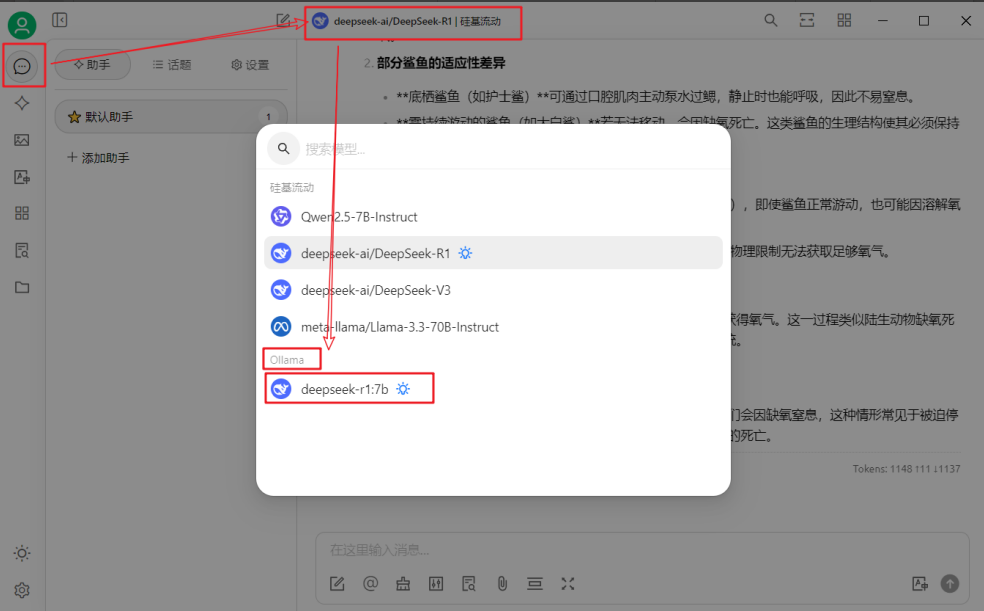

选择模型

**注意:**使用时要确保ollama客户端已启动

修改models文件夹路径(可选)

模型默认会下载到C:\Users\你的用户名\.ollama目录下的models文件夹中

如果想修改模型的存放位置,做如下配置

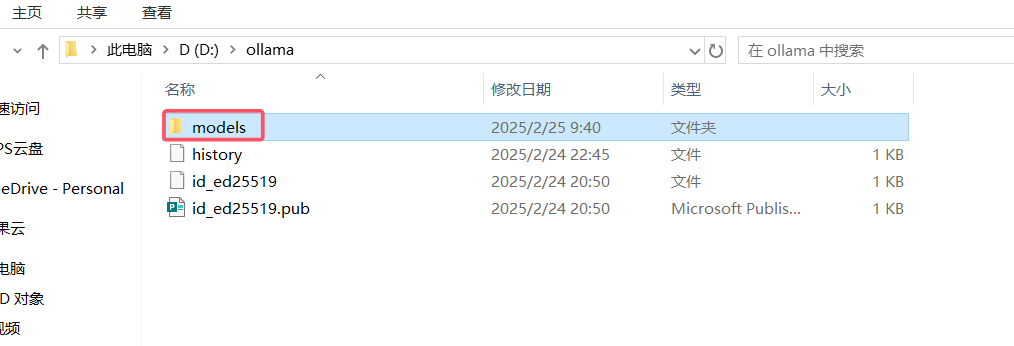

**步骤1:**剪切models文件夹到指定目录下,我这里剪切到了D:\ollama下

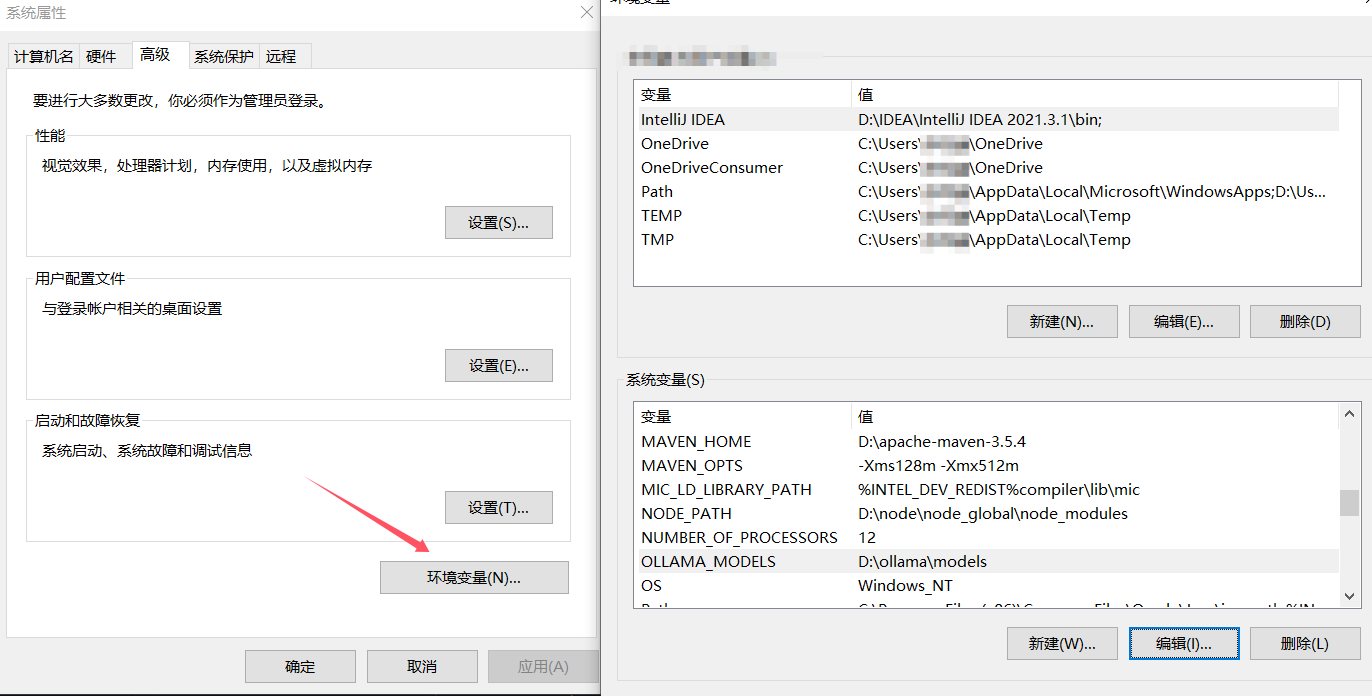

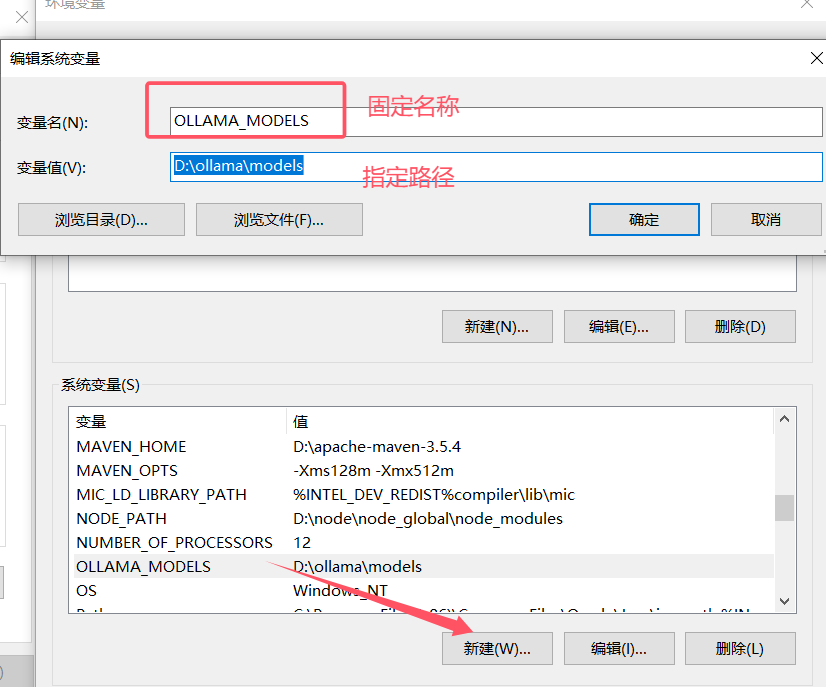

**步骤2:**添加环境变量

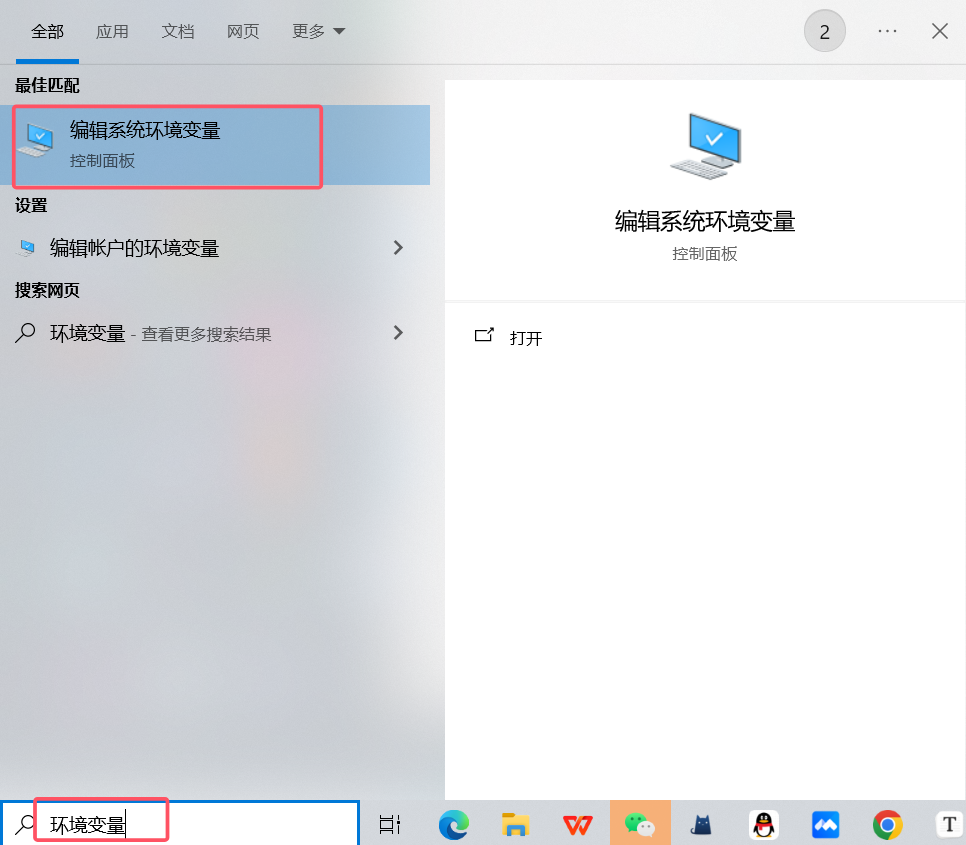

左下角搜索框,输入环境变量

**步骤3:**重启Ollama客户端生效

注意:修改完之后,需要重启Ollama客户端,右键图标,选择退出,重新运行Ollama

验证是否生效:重新运行Ollama之后,重新打开命令行,输入命令ollama list 查看:

如果list显示为空,则表示操作有问题。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?