一、本文介绍

本文给家大家带来的改进机制是iRMB,其是在论文Rethinking Mobile Block for Efficient Attention-based Models种提出,论文提出了一个新的主干网络EMO(后面我也会教大家如何使用该主干,本文先教大家使用该文中提出的注意力机制)。其主要思想是将轻量级的CNN架构与基于注意力的模型结构相结合(有点类似ACmix),同时该注意力机制属于是比较轻量化的参数量比较小,训练速度也很快,后面我会将各种添加方法教给大家,让大家在自己的模型中进行复现。

目录

二、iRMB的框架原理

官方论文地址:官方论文地址点击即可跳转

官方代码地址:官方代码地址点击即可跳转

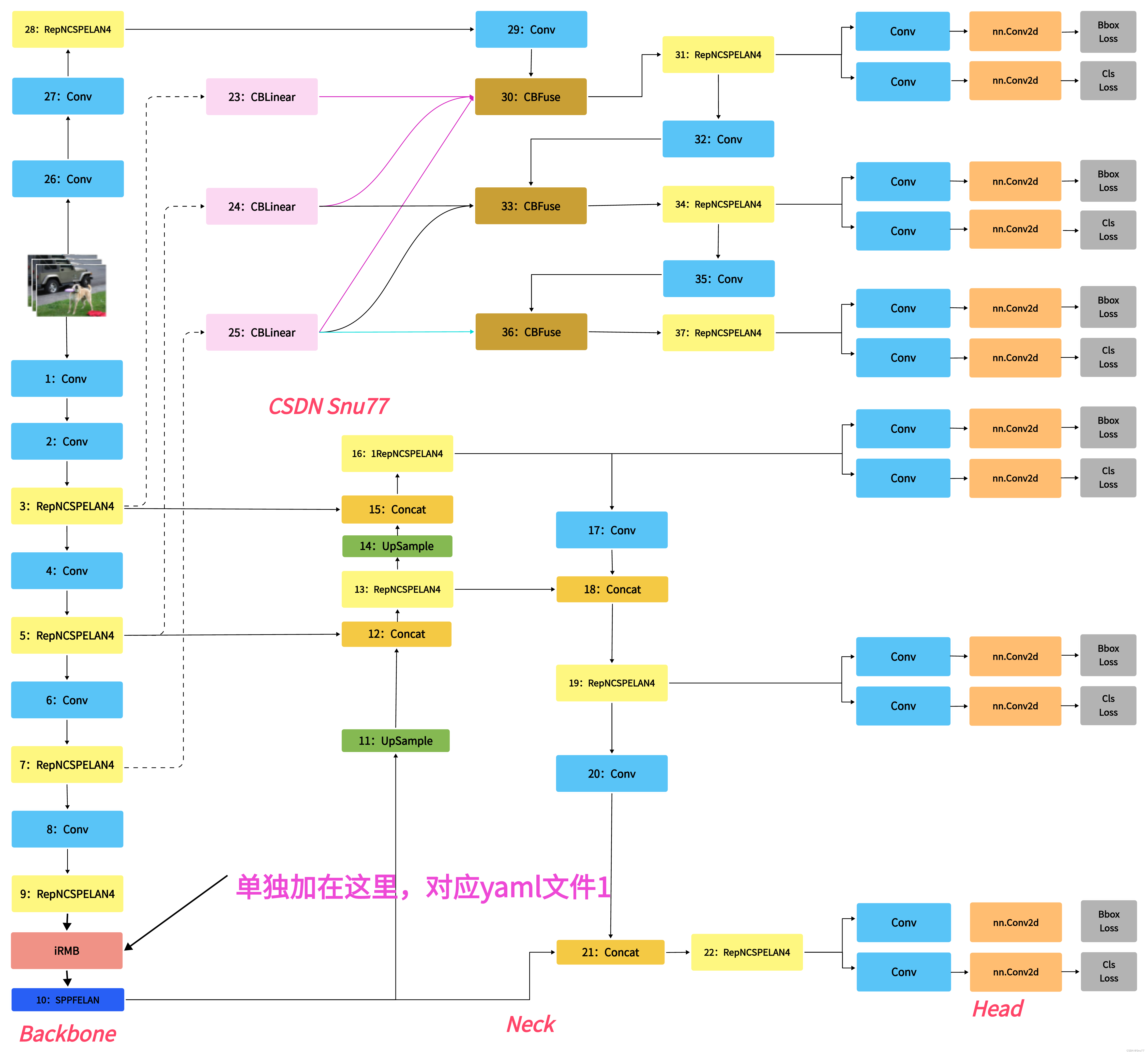

本文介绍了iRMB(Inverted Residual Mobile Block)——一种结合轻量级CNN和注意力机制的新型结构,适用于移动设备的密集预测任务。iRMB通过倒置残差块和元移动块实现模型的轻量化和高效性能,文中详细阐述了iRMB的结构、原理,并提供了添加iRMB到YOLOv9的步骤和代码示例。

本文介绍了iRMB(Inverted Residual Mobile Block)——一种结合轻量级CNN和注意力机制的新型结构,适用于移动设备的密集预测任务。iRMB通过倒置残差块和元移动块实现模型的轻量化和高效性能,文中详细阐述了iRMB的结构、原理,并提供了添加iRMB到YOLOv9的步骤和代码示例。

订阅专栏 解锁全文

订阅专栏 解锁全文

7322

7322

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?