一、本文介绍

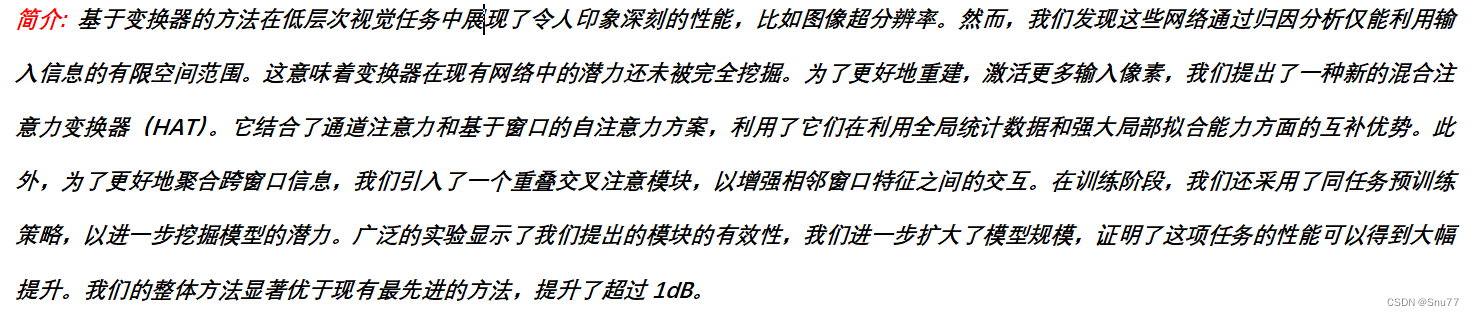

本文给大家带来的改进机制是HAttention注意力机制,混合注意力变换器(HAT)的设计理念是通过融合通道注意力和自注意力机制来提升单图像超分辨率重建的性能。通道注意力关注于识别哪些通道更重要,而自注意力则关注于图像内部各个位置之间的关系。HAT利用这两种注意力机制,有效地整合了全局的像素信息,从而提供更为精确的结果(这个注意力机制挺复杂的光代码就700+行),但是效果挺好的也是10月份最新的成果非常适合添加到大家自己的论文中。

推荐指数:⭐⭐⭐⭐⭐(最新的改进机制)

目录

二、HAttention框架原理

官方论文地址:官方论文地址

官方论文地址:官方论文地址

官方代码地址:官方代码地址

这篇论文提出了一种新的混合注意力变换器

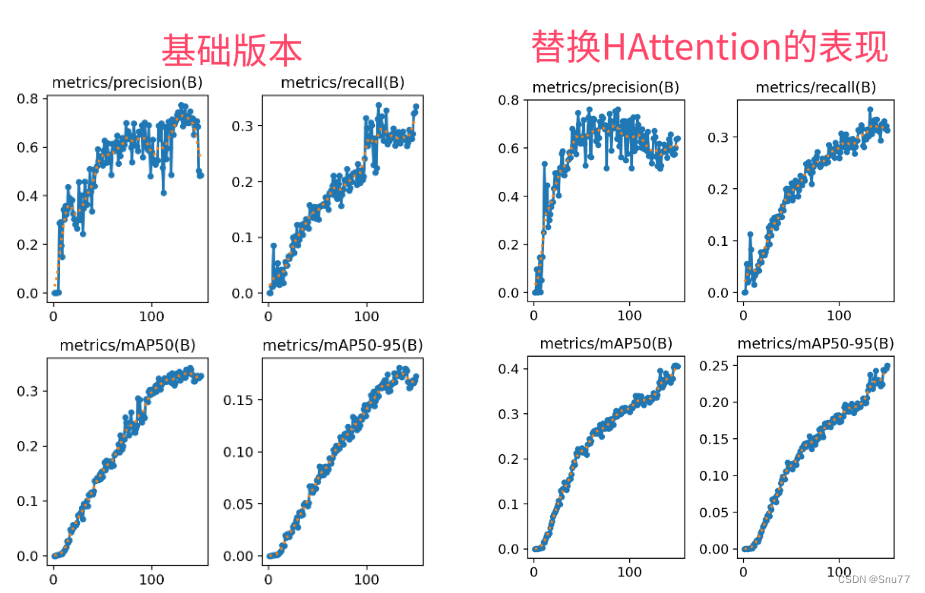

本文介绍了HAttention(混合注意力变换器)的原理和实现,这是一种结合通道注意力和自注意力的超分辨率重建方法。通过在YOLOv8目标检测模型中应用HAttention,能有效提升小目标检测的性能。文章包含HAttention的代码实现和训练过程,是深度学习和计算机视觉领域的最新研究进展。

本文介绍了HAttention(混合注意力变换器)的原理和实现,这是一种结合通道注意力和自注意力的超分辨率重建方法。通过在YOLOv8目标检测模型中应用HAttention,能有效提升小目标检测的性能。文章包含HAttention的代码实现和训练过程,是深度学习和计算机视觉领域的最新研究进展。

订阅专栏 解锁全文

订阅专栏 解锁全文

6839

6839