一.什么是Ollama

1.Ollama是简化大型语言模型在本地机器上的部署、管理和运行过程

2.Ollama适用于各种需要利用大型语言模型进行自然语言处理任务的场景

2.1.如文本生成、问答系统、对话机器人等

3.特别是在需要保护数据隐私或希望避免依赖云服务的情况下,提供高效、安全的本地部署方案

二.如何使用

1.Ollama官方网站:https://ollama.com/

2.点击下载ollama安装包

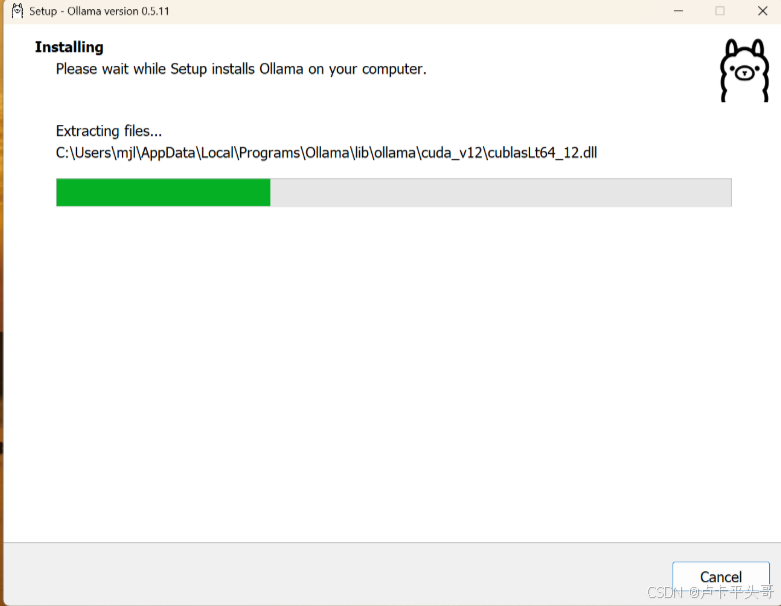

3.根据默认选项进行安装

4.安装成功

5.打开命令提示符(win+r接cmd接回车)

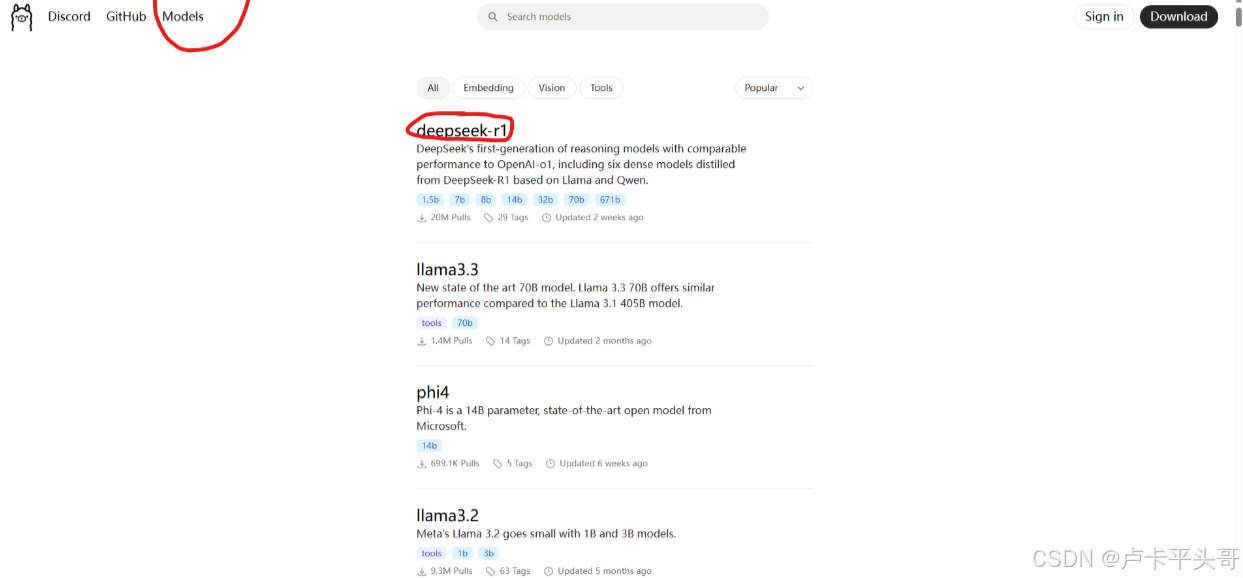

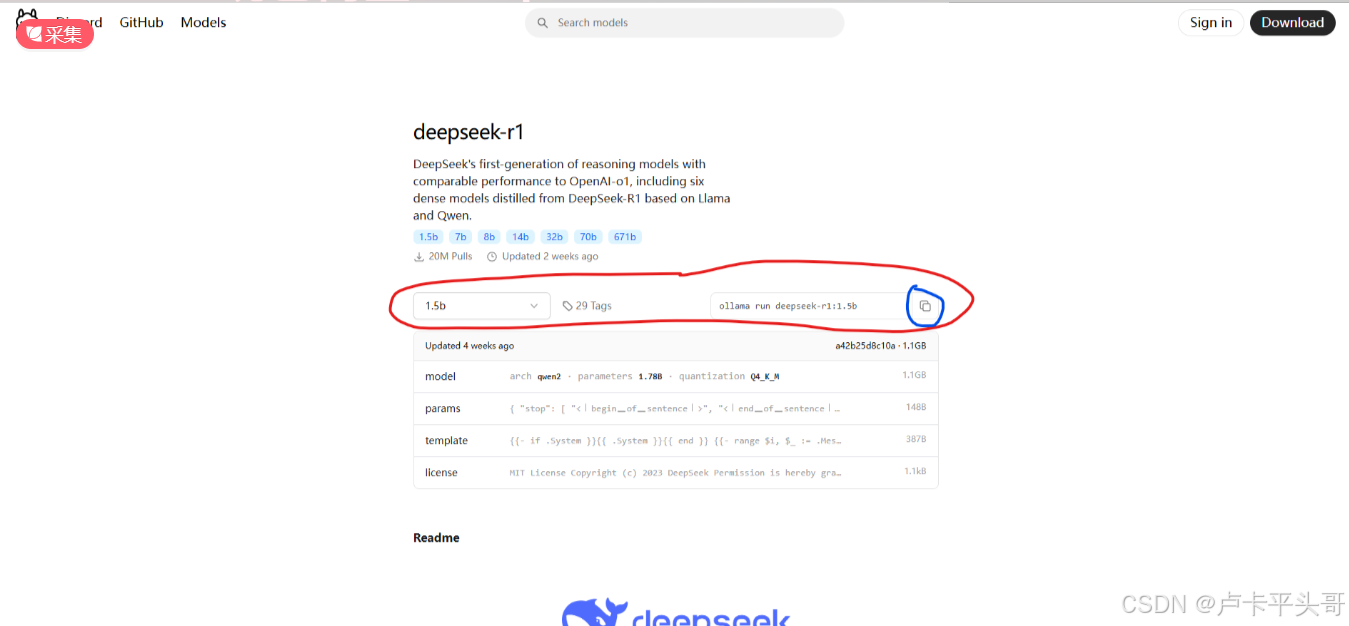

6.根据ollama官网的选择模型下载命令

7.选择内存最小且不需要GPU的1.5b根据命令进行下载

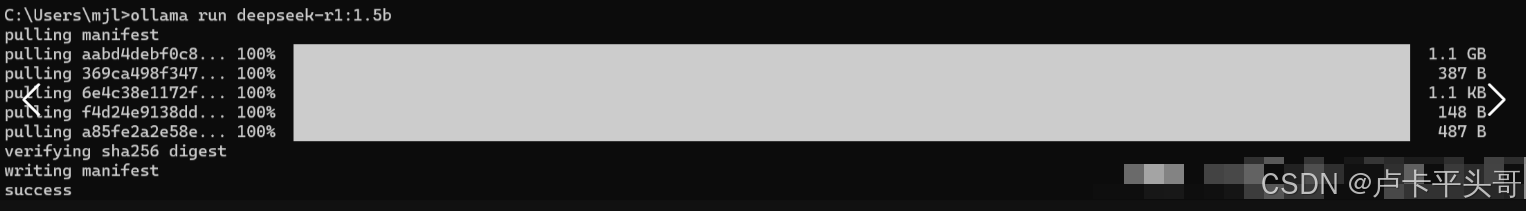

8.在命令提示符运行上述命令:ollama pull deepseek-r1:7b

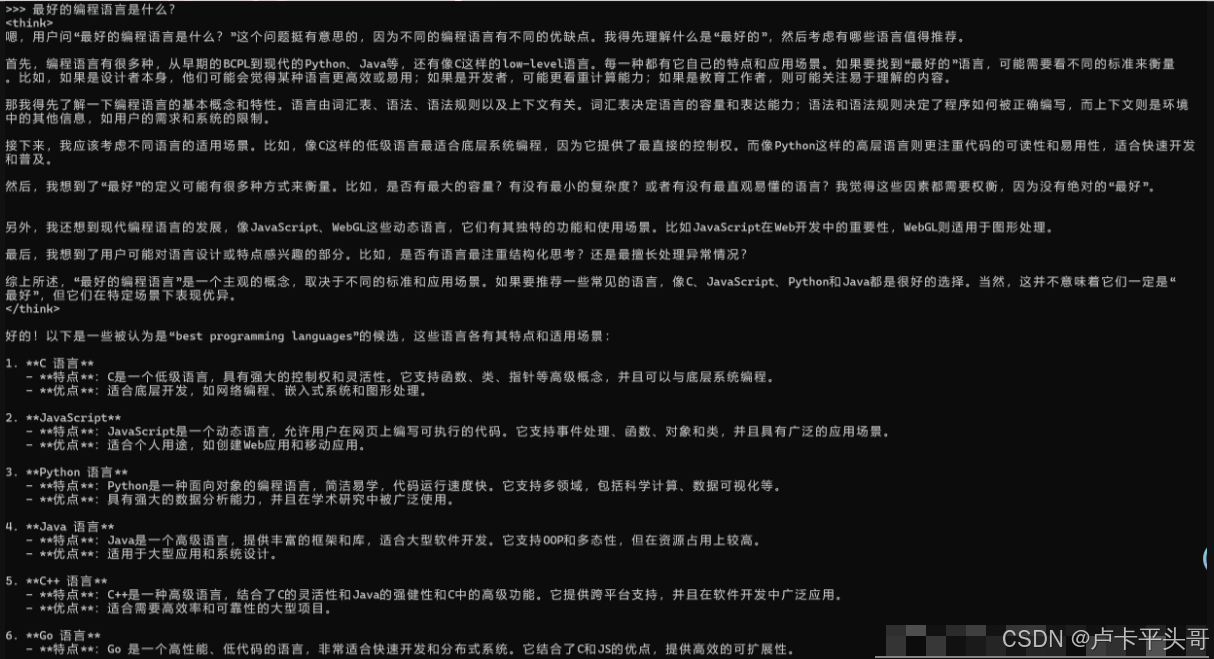

9.上述操作后就可以在命令提示符页面发送信息进行询问

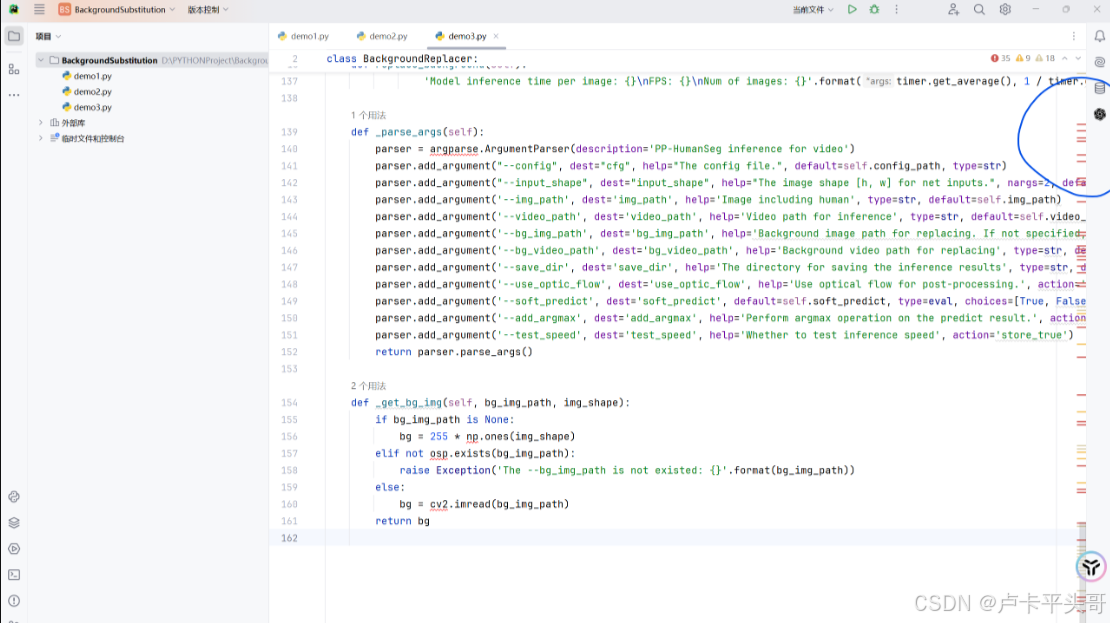

三.Pycharm安装CodeGPT插件并嵌入本地部署的DeepSeek-R1模型

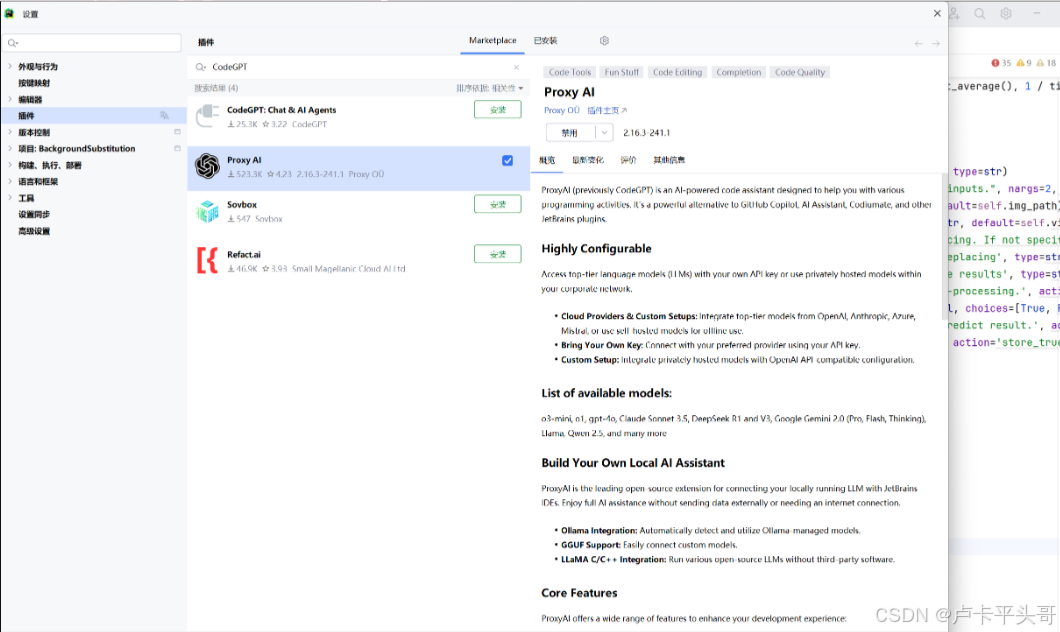

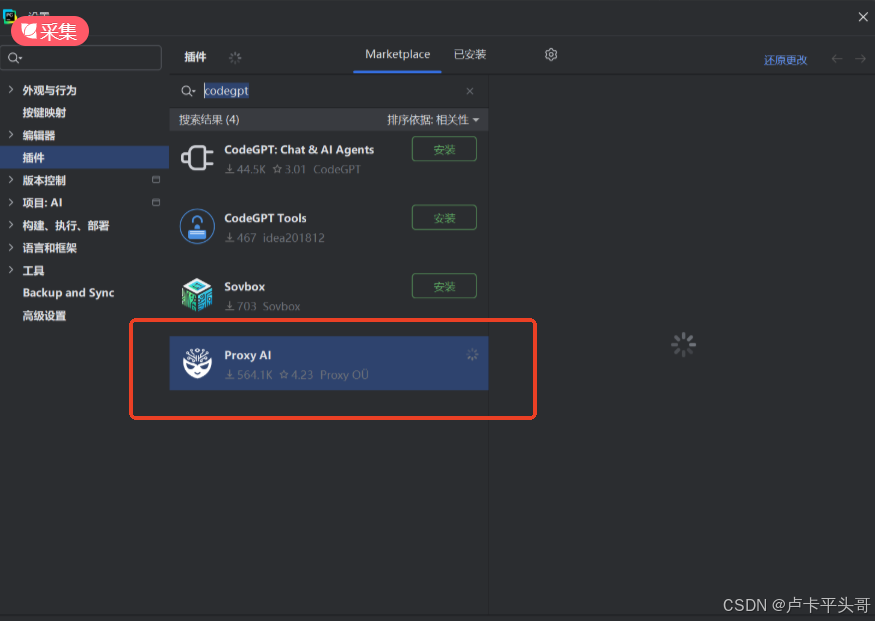

1.在插件市场中搜索CodeGPT/Proxy AI

2.选择Proxy AI进行安装

2.1.ProxyAI(以前的CodeGPT)是人工智能驱动的代码助手,旨在帮助进行各种编程活动

2.2.它是GitHub Copilot、AI Assistant、Codiumate和其他JetBrains插件的强大替代品

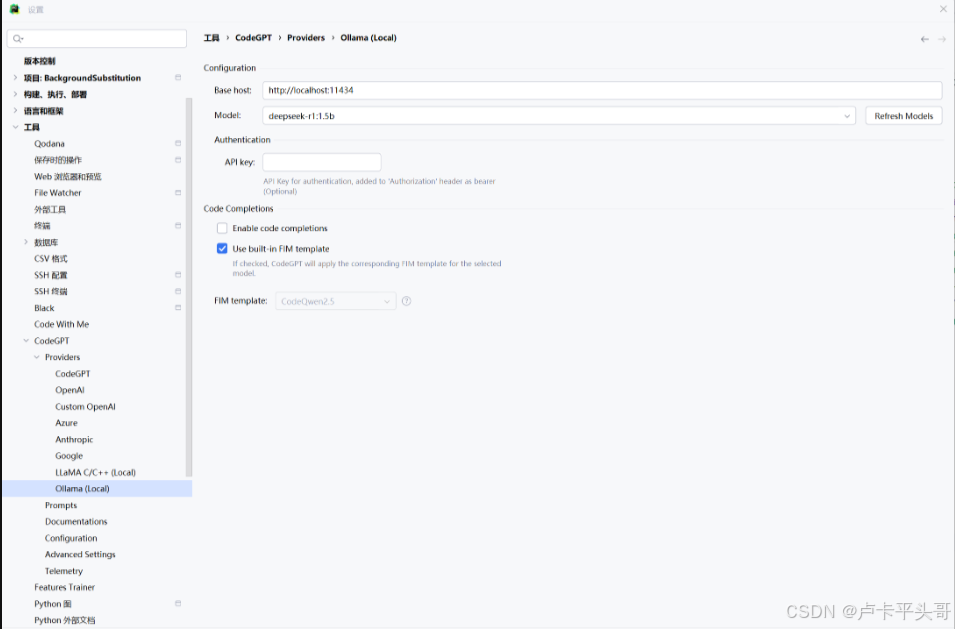

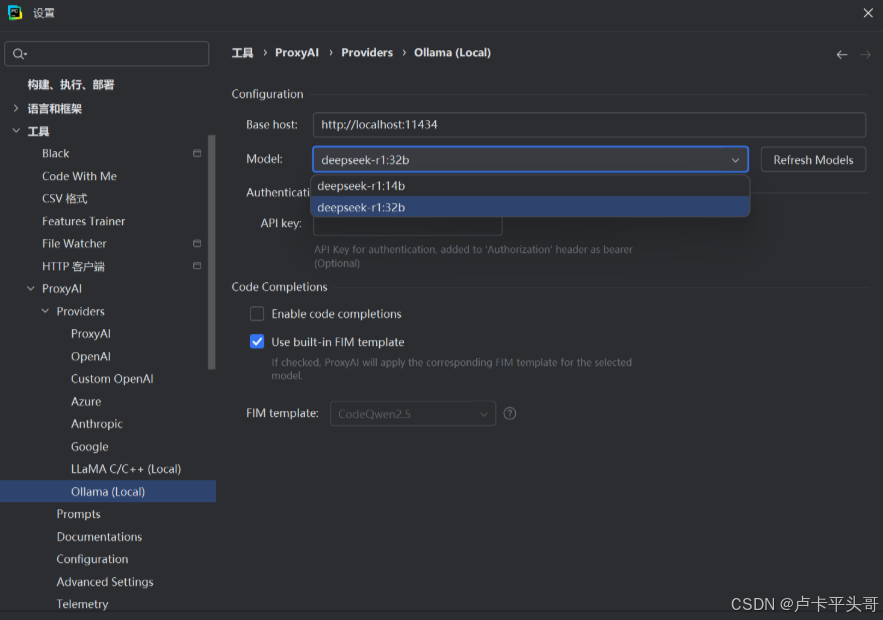

3.安装后进行配置

3.1.点击设置-工具-CodeGPT-Providers-ollama(Local)会出现亲切的deepseek-r1:1.5b

3.2.点击应用和确定

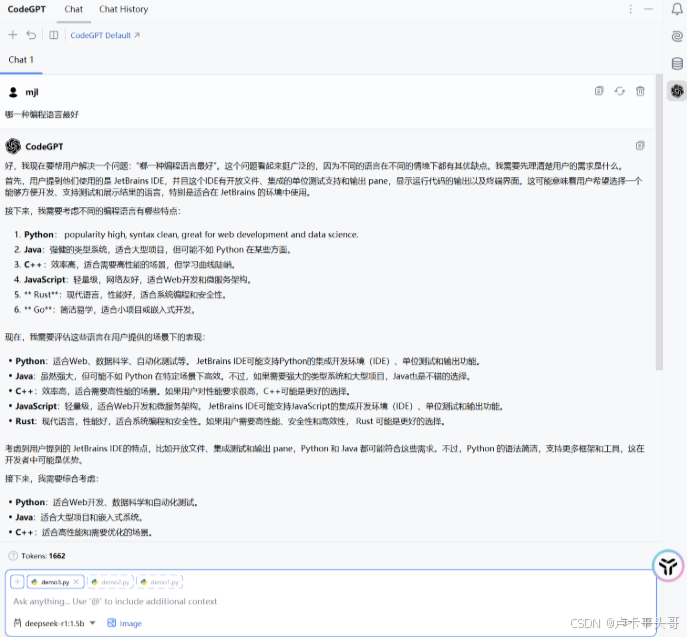

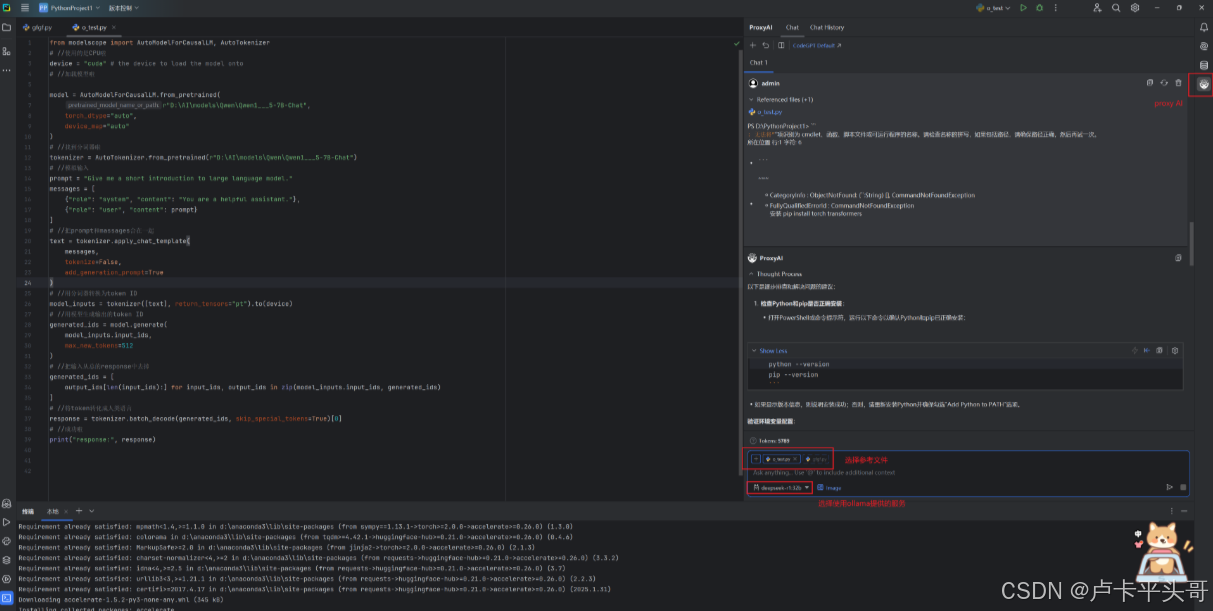

4.使用

4.1.右边栏(也可以根据喜好进行调整)出现CodeGPT的图标点击就可以使用

5.Proxy AI默认是英文,提问时带有中文字符,该工具即会用中文进行回复

8138

8138

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?