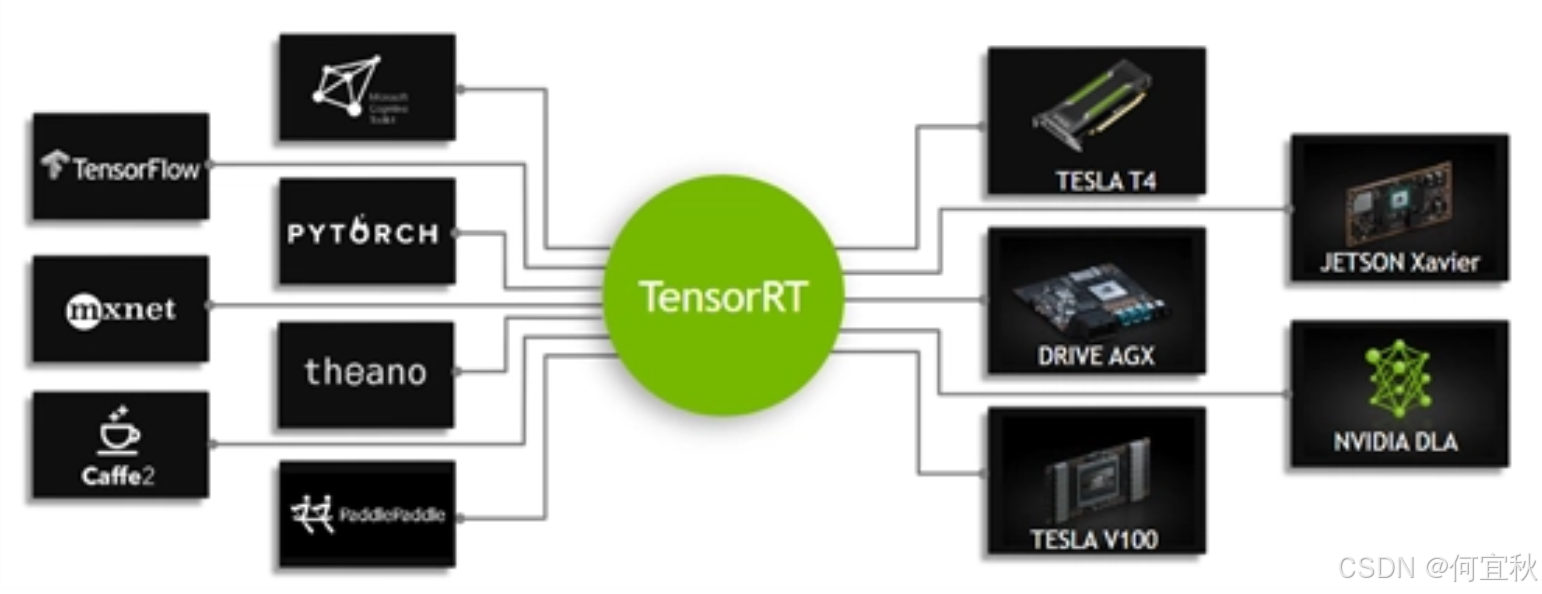

TensorRT 是由 Nvidia 发布的一个机器学习框架,用于在其硬件上运行机器学习推理。它能针对 Nvidia 系列硬件进行优化加速,实现最大程度的利用 GPU 资源,提升推理性能。在训练了神经网络之后,TensorRT 可以对网络进行压缩、优化以及运行时部署,支持当前多种深度学习框架(TensorFlow, Pytrch,Mxnet,Caffe2,Theano, PaddlePaddle)。

以下操作在Linux系统进行(如Ubuntu)

下载安装TensorRT

TensorRT需要和Linux系统版本、CUDA、cuDNN 的版本对应

查看Ubuntu版本

$ lsb_release -a

No LSB modules are available.

Distributor ID: Ubuntu

Description: Ubuntu 22.04.4 LTS

Release: 22.04

Codename: jammy

查看CUDA版本

$ nvcc -V

nvcc: NVIDIA (R) Cuda compiler driver

Copyright (c) 2005-2023 NVIDIA Corporation

Built on Tue_Aug_15_22:02:13_PDT_2023

Cuda compilation tools, release 12.2, V12.2.140

Build cuda_12.2.r12.2/compiler.33191640_0

上面cuda版本为 12.2

Nvidia官网地址:

https://docs.nvidia.com/deeplearning/tensorrt/archives/index.html#overview

在这个页面

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1695

1695

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?