这个实验我使用的是Jupyter Notebook交互式环境~

这篇文章接学习笔记(一)

在我们刚才创建的虚拟环境中安装jupyter并新建一个kernel:

(在cmd下运行以下代码)

pip3 install jupyter

python3 -m ipykernel install -- user -- name=venv

贴图:

- 查看当前有多少kernel:

jupyter kernelspec list

- 打开jupyter notebook:

jupyter notebook

输入以上命令后,会自动弹出一个网页,就是jupyter notebook.

在jupyter notebook中的右上方upload打开我们本来写好的.ipynb文件

选择该文件,然后选择上方的kernel,选择venv我们创建好的虚拟环境

接下来直接上代码~~

from __future__ import print_function

# 导入 MNIST 数据集

from tensorflow.examples.tutorials.mnist import input_data

mnist = input_data.read_data_sets("/tmp/data/", one_hot=True)

import tensorflow as tf

# 超参数

learning_rate = 0.1

num_steps = 500

batch_size = 128

display_step = 100

# 神经网络参数

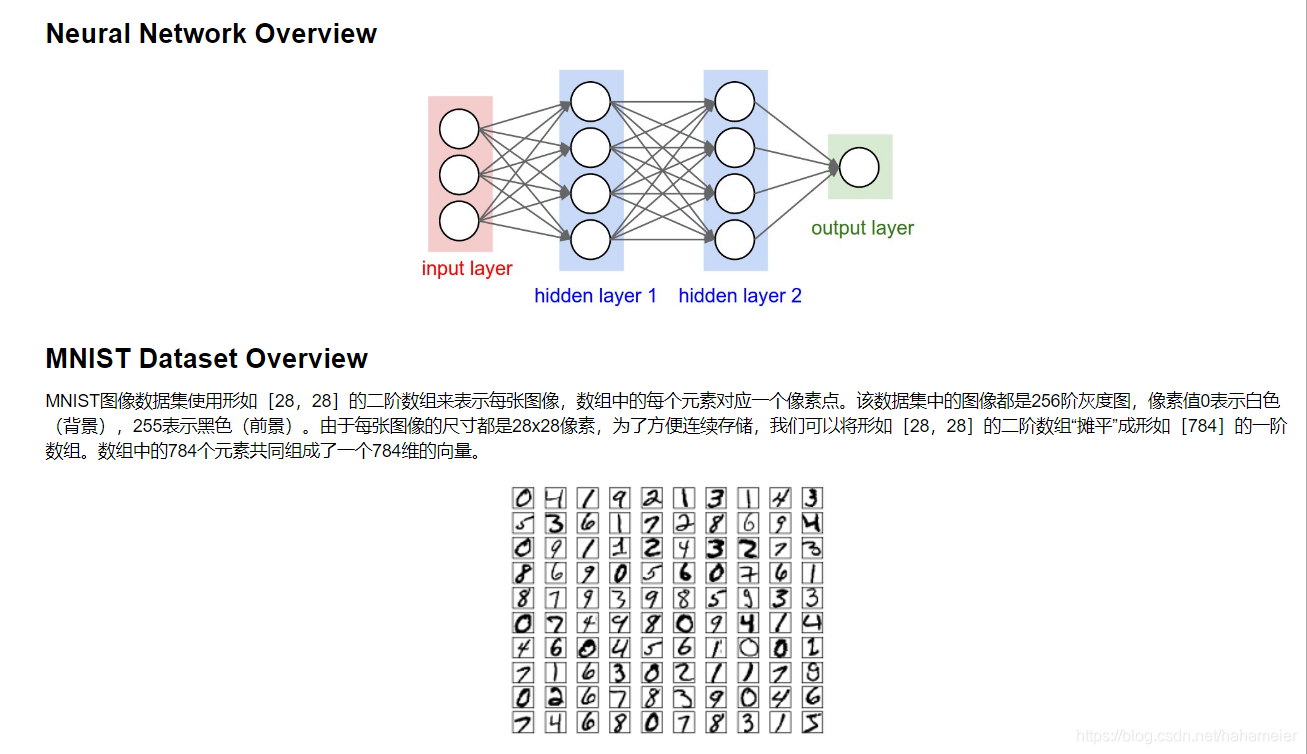

n_hidden_1 = 256 # 第一层神经元个数

n_hidden_2 = 256 # 第二层神经元个数

num_input = 784 # MNIST 输入数据(图像大小: 28*28)

num_classes = 10 # MNIST 手写体数字类别 (0-9)

# 输入到数据流图中的训练数据

X = tf.placeholder("float", [None, num_input])

Y = tf.placeholder("float", [None, num_classes])

# 权重和偏置

weights = {

'h1': tf.Variable(tf.random_normal([num_input, n_hidden_1])),

'h2': tf.Variable(tf.random_normal([n_hidden_1, n_hidden_2])),

'out': tf.Variable(tf.random_normal([n_hidden_2, num_classes]))

}

biases = {

'b1': tf.Variable(tf.random_normal([n_hidden_1])),

'b2': tf.Variable(tf.random_normal([n_hidden_2])),

'out': tf.Variable(tf.random_normal([num_classes]))

}

# 定义神经网络

def neural_net(x):

# 第一层隐藏层(256个神经元)

layer_1 = tf.add(tf.matmul(x, weights['h1']), biases['b1'])

# 第二层隐藏层(256个神经元)

layer_2 = tf.add(tf.matmul(layer_1, weights['h2']), biases['b2'])

# 输出层

out_layer = tf.matmul(layer_2, weights['out']) + biases['out']

return out_layer

# 构建模型

logits = neural_net(X)

# 定义损失函数和优化器

loss_op = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(

logits=logits, labels=Y))

optimizer = tf.train.AdamOptimizer(learning_rate=learning_rate)

train_op = optimizer.minimize(loss_op)

# 定义预测准确率

correct_pred = tf.equal(tf.argmax(logits, 1), tf.argmax(Y, 1))

accuracy = tf.reduce_mean(tf.cast(correct_pred, tf.float32))

# 初始化所有变量(赋默认值)

init = tf.global_variables_initializer()

# 开始训练

with tf.Session() as sess:

# 执行初始化操作

sess.run(init)

for step in range(1, num_steps+1):

batch_x, batch_y = mnist.train.next_batch(batch_size)

# 执行训练操作,包括前向和后向传播

sess.run(train_op, feed_dict={X: batch_x, Y: batch_y})

if step % display_step == 0 or step == 1:

# 计算损失值和准确率

loss, acc = sess.run([loss_op, accuracy], feed_dict={X: batch_x,

Y: batch_y})

print("Step " + str(step) + ", Minibatch Loss= " + \

"{:.4f}".format(loss) + ", Training Accuracy= " + \

"{:.3f}".format(acc))

print("Optimization Finished!")

# 计算测试数据的准确率

print("Testing Accuracy:", \

sess.run(accuracy, feed_dict={X: mnist.test.images,

Y: mnist.test.labels}))

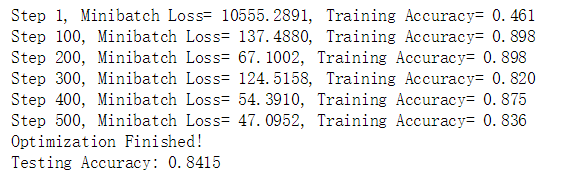

测试结果图:

好啦~ 今天学习到此结束 已经2019.1.14-00.20了

若文章有需要改进的地方,可以提出来,一定虚心接受积极改正。

本文通过Jupyter Notebook介绍TensorFlow进行数字识别的实践过程。首先在虚拟环境中安装jupyter并创建kernel,接着上传.ipynb文件,选择对应的虚拟环境运行代码。文章展示了实验的测试结果,并欢迎读者提出改进建议。

本文通过Jupyter Notebook介绍TensorFlow进行数字识别的实践过程。首先在虚拟环境中安装jupyter并创建kernel,接着上传.ipynb文件,选择对应的虚拟环境运行代码。文章展示了实验的测试结果,并欢迎读者提出改进建议。

1007

1007

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?