论文地址:https://arxiv.org/abs/1605.04711

TWN和BWN类似,只对权重进行量化,只是量化后的值多了个0。其实就是BWN虽然模型压缩率高,但精度不够,于是在全精度和二值化之间取平衡,才有了TWN。

对比BWN,TWN的0并不增加乘法运算,而且表达能力更强。但是由于是三值量化,需要2bit的内存,但是这样就浪费了一位,这一点可能需要改进。

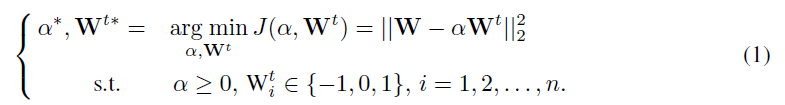

TWN思想也和BWN类似,要用三值的权重WtW^tWt近似全精度的权重WWW,就有最小化二者之间的欧式距离,产生下列最优化问题:

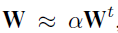

权重估计为:

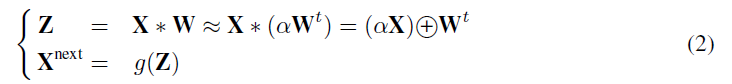

前向传播公式为:

其中,*是卷积操作,⊕\oplus⊕是无乘法的卷积操作。

对于公式(1)的优化问题,可以展开进行求导得到最优解(BWN),但是这样得到的两个最优参数相互独立,也就不存在确定性的解。因此采取另一种方法。

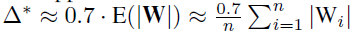

该方法简单点说,就是假设WIW_IWI是均匀分布或正态分布,根据经验公式计算出阈值:

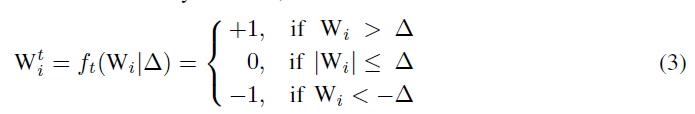

然后可以得到三元阈值函数:

放缩因子α\alphaα计算公式为:

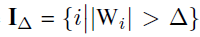

其中,

而∣IΔ∣|I_{\Delta}|∣IΔ∣为IΔI_{\Delta}IΔ中元素的个数。

最后利用上述的前向传播公式进行传播。

TWN(三值权重网络)作为一种模型压缩技术,在BWN的基础上引入了0值,提高了模型表达能力和压缩率,同时减少了乘法运算。通过优化权重量化过程,TWN在全精度和二值化间取得平衡,提升模型精度。

TWN(三值权重网络)作为一种模型压缩技术,在BWN的基础上引入了0值,提高了模型表达能力和压缩率,同时减少了乘法运算。通过优化权重量化过程,TWN在全精度和二值化间取得平衡,提升模型精度。

949

949

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?