1.闲言

在正式的学习之前,我喜欢先放飞一下自我。我觉得技术就是用来聊的,找个酒馆,找些大神,咱们听着音乐一起聊起来。所以我特别希望能把自己的文字口语化,就像玩一样。就像古代那些说书人一样,萧远山和慕容博相视一笑,王图霸业,血海深仇,尽归尘土。这是我向往的一种表达方式,但是我现在还达不到那个境界,只能尽力而为吧。

2.YOLOV2

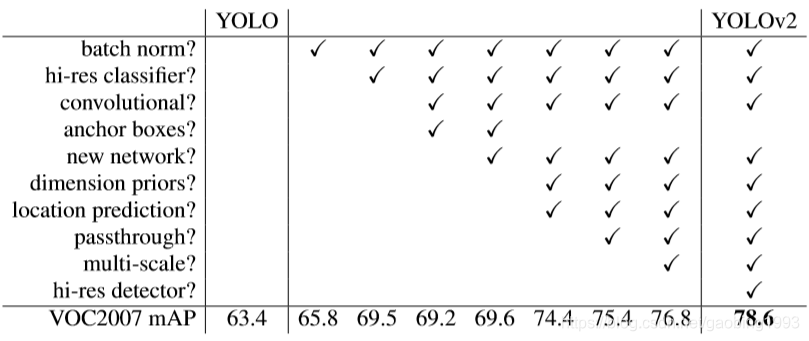

1.十个改造点

yolov1提升了目标检测的速度,但是在MAP方面却掉了上去。所以说铁打的大神,流水的模型,他们自然会想尽各种办法来解决这个问题。在我看来这就好像程序员写bug一样,到头来总是要改的。所以yolov2可以分为两个部分,第一部分是对MAP提升所做的努力,第二部分是对原来模型的优化,当然是在保证检测速度的前提下。

下面的10个点,是V2的大神们做出的努力。这意味着什么,速度的提升?准确率的提升?模型的泛化能力提升?对,但是更重要的我觉得是工作量的体现,年终的结算。有时候看paper的时候,我们觉得这些大神们都跟圣人一样。他们做出的所有努力都是要造福社会,都是为了推动AI视觉的进一步发展。其实他们也是人,也会有来自各方面的限制,也会有自己的私心,一些小小的任性和种种生而为人而不能的无奈。所以读paper就是在和大神们对话,一边说着你真牛逼,一边在心里面想着我一定要超越你。

下来我们来解释一下,如果说模型预测出来的结果不是很令人满意,那么一般从下面三个方面寻找原因:数据、模型、训练策略。如果还不行,那么就再仔细找找!

1. 数据

1)batch norm:数据经过卷积处理之后,其均值和分布情况会发生变化,我们使用这种方式把中间层的数据拉回到跟原始数据差不多的同分布

本文详细介绍了YOLOV2在目标检测领域的改进,包括数据处理、模型优化和训练策略,如BN、darkenet19、全卷积、anchor boxes等。此外,文章还探讨了YOLO9000如何通过wordtree解决类别依赖问题,实现9000种类别的预测。虽然在某些性能指标上仍落后于SSD,但YOLO系列模型以其速度优势持续发展。

本文详细介绍了YOLOV2在目标检测领域的改进,包括数据处理、模型优化和训练策略,如BN、darkenet19、全卷积、anchor boxes等。此外,文章还探讨了YOLO9000如何通过wordtree解决类别依赖问题,实现9000种类别的预测。虽然在某些性能指标上仍落后于SSD,但YOLO系列模型以其速度优势持续发展。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?