Paper : MobileNets: Efficient Convolutional Neural Networks for Mobile Vision

Applications

Code : unofficial

摘要

与Xception一样都是以depthwise separate convolution作为核心扩展开的网络结构,MobileNet更倾向于低算力,有关depthwise separate convolution和Xception的内容见blog。

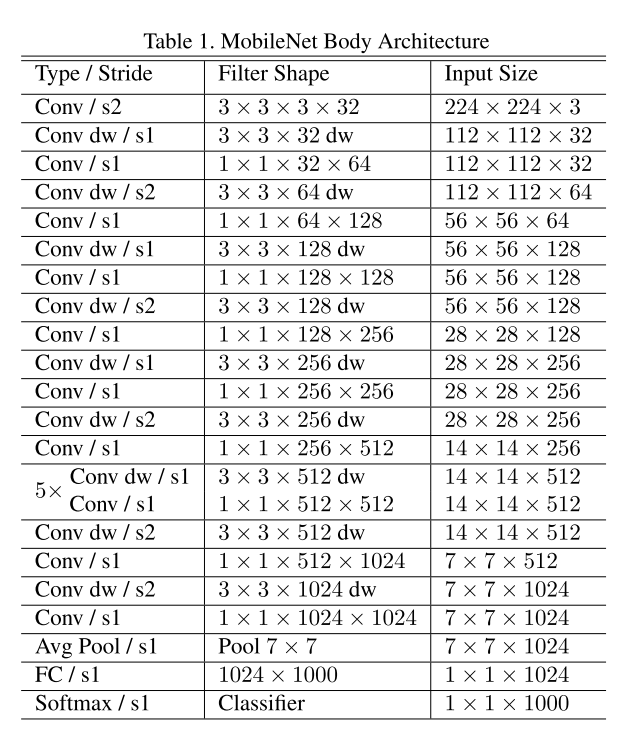

网络结构

MobileNet 网络结构,网络的第一层是一个普通的卷积层,其他是depthwise separate conv

该网络结构中,每一个Conv均表示Conv-BN-ReLU结构

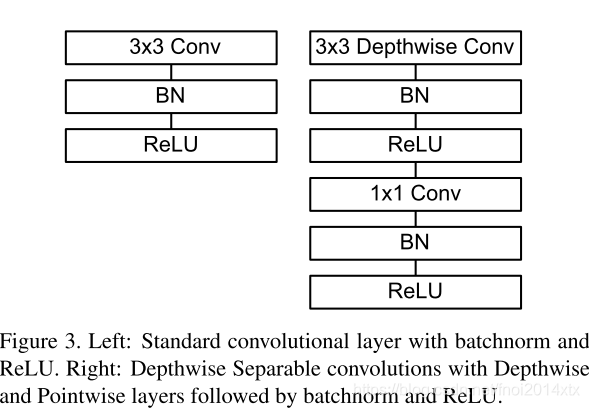

普通卷积核和separate conv

宽度缩放因子 α \alpha α:使用 α \alpha α将网络宽度降低,即对于输入输出通道数分别为 c in , c out \text{c}_{\text{in}},\text{c}_{\text{out}} cin,cout的网络层,新的通道数为 α ⋅ c in , α c out \alpha \cdot \text{c}_{\text{in}},\alpha \text{c}_{\text{out}} α⋅cin,αcout。 α = 1 \alpha = 1 α=1即为原始MobileNet

分辨率缩放因子 ρ \rho ρ:使用 ρ \rho ρ将网络分辨率降低,即对于输入输出为 w in × h in , w out × h out \text{w}_{\text{in}}\times\text{h}_{\text{in}},\text{w}_{\text{out}}\times \text{h}_{\text{out}} win×hin,wout×hout的网络层,新的输入输出宽度为 ρ w in × ρ h in , ρ w out × ρ h out \rho\text{w}_{\text{in}}\times\rho\text{h}_{\text{in}},\rho\text{w}_{\text{out}}\times\rho \text{h}_{\text{out}} ρwin×ρhin,ρwout×ρhout

核心观点

- 放弃池化层直接采用stride = 2的卷积,节约计算量

- depthwise separate conv的使用

- 引入宽度缩放因子和分辨率缩放因子用于减小参数量,降低计算量

1625

1625

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?