1.How can we perform efficient inference and learning in directed probabilistic models, in the presence of continuous latent variables with intractable posterior distributions, and large datasets?

keyword intractable posterior distributions

reference:https://www.cs.toronto.edu/~rsalakhu/talks/talk_inference.pdf

学单词系列,我寻思这论文intractable能表达的意思比hard要多多少?

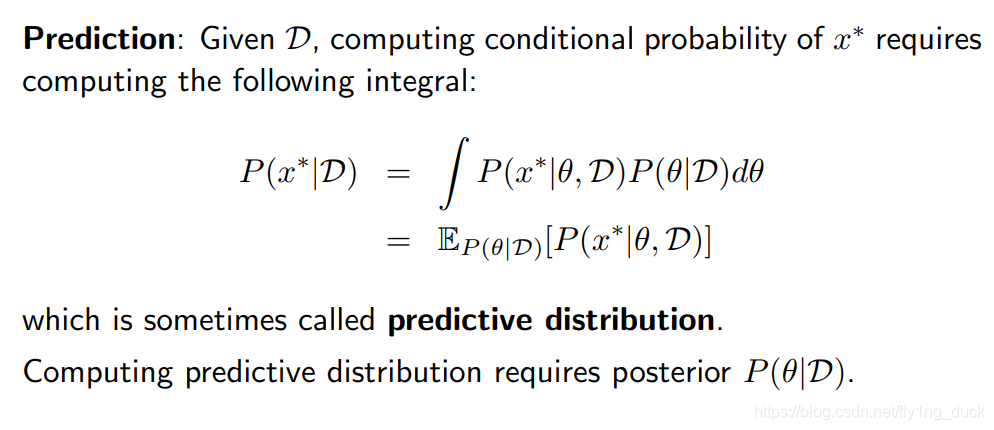

这就是一个简单的贝叶斯推断,然而这个贝叶斯推断需要后验概率,这个在现实世界是很难得到的。

We introduce a stochastic variational inference and learning algorithm that scales to large datasets and, under some mild differentiability conditions, even works in the intractable case.

keyword stochastic variational inference

本文探讨了在处理连续隐藏变量和大型数据集的定向概率模型时,如何进行有效推断和学习。重点介绍了变分推断的概念,特别是随机变分推断,用于解决后验概率计算困难的问题。变分推断通过找到一个易于处理的分布来逼近难以计算的后验分布,而最大似然估计和贝叶斯估计在统计学中有不同的视角和计算复杂度。文章还对比了变分推断与马尔可夫链蒙特卡洛方法在大数据集场景下的适用性。

本文探讨了在处理连续隐藏变量和大型数据集的定向概率模型时,如何进行有效推断和学习。重点介绍了变分推断的概念,特别是随机变分推断,用于解决后验概率计算困难的问题。变分推断通过找到一个易于处理的分布来逼近难以计算的后验分布,而最大似然估计和贝叶斯估计在统计学中有不同的视角和计算复杂度。文章还对比了变分推断与马尔可夫链蒙特卡洛方法在大数据集场景下的适用性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

801

801

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?