作者|GUEST 编译|VK 来源|Analytics Vidhya

介绍

目标检测是计算机视觉中一个非常重要的领域,对于自动驾驶、视频监控、医疗应用和许多其他领域都是必要的。

我们正在与一场规模空前的传染病作斗争。全世界的研究人员都在试图开发一种疫苗或治疗COVID-19的方法,而医生们却在努力阻止这场传染病席卷全世界。另一方面,许多国家发现了社会距离的疏远,使用口罩和手套可以稍微遏制这种局面。

我最近有一个想法,用我的深度学习知识来帮助目前的情况。在这篇文章中,我将向你介绍RetinaNet的实现,背景知识不多。

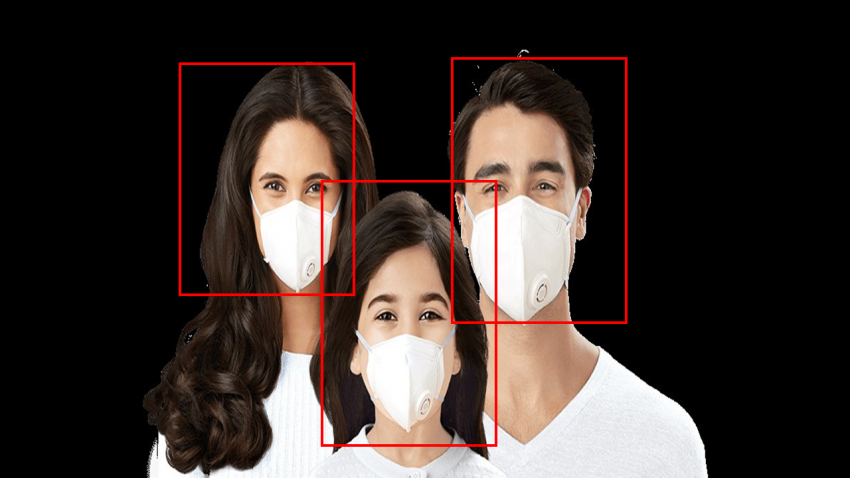

我们将使用RetinaNet建立一个“口罩探测器”来帮助我们应对这场持续的传染病。你可以推断出同样的想法来为你的智能家居构建一个支持人工智能的解决方案。这个人工智能的解决方案只对戴着口罩和手套的人敞开大门。

随着无人机的成本随着时间的推移而降低,我们看到空中数据的生成出现了一个大的峰值。因此,你可以使用这个RetinaNet模型在航空图像甚至卫星图像中检测不同的对象,如汽车(自行车、汽车等)或行人,以解决不同的业务问题。

所以,你看目标检测模型的应用是无穷无尽的。

目录

- 什么是RetinaNet

- RetinaNet的需求

- RetinaNet的架构

- 骨干网

- 对象分类子网

- 对象回归子网

- Focal Loss

- 利用RetinaNet模型建立口罩检测器

- 收集数据

- 创建数据集

- 模特训练

- 模型测试

- 最后说明

什么是RetinaNet

RetinaNet是一种最好的单目标检测模型,已被证明能很好地处理密集和小尺度的物体。由于这个原因,它已经成为一个流行的目标检测模型。

RetinaNet的需求

RetinaNet是由Facebook人工智能研究所(Facebook-AI-Research)引入的,旨在解决密集检测问题。在处理极端前景-背景类时,需要弥补YOLO和SSD等单步目标检测器的不平衡和不一致。

RetinaNet的架构

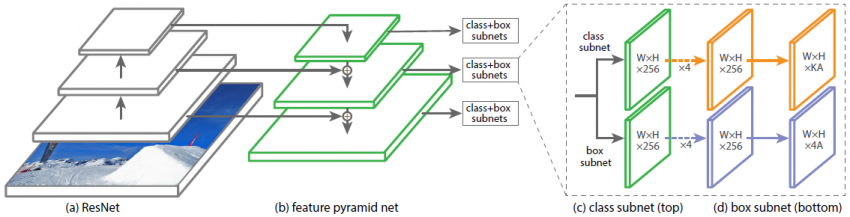

从本质上讲,RetinaNet是一个复合网络,由以下部分组成:

主干网络(自底向上的路径和具有横向连接的自上而下的路径)

目标分类子网

目标回归子网

为了更好地理解,让我们分别了解架构的每个组件

1.主干网络

自底向上路径:自底向上路径(例如,ResNet)用于特征提取。因此,它计算不同比例的特征图,而不考虑输入图像的大小。

具有横向连接的自上而下的路径:在自上而下的路径上,从更高的金字塔级别对空间上较粗糙的特征图进行上采样,横向连接将具有相同空间大小的自顶向下和自底向上的层合并在一起。较高层次的特征图往往具有较小的分辨率,但语义上更强。因此,更适合于检测较大的物体;相反,来自较低级特征图的网格单元具有高分辨率,因此更擅长检测较小的对象。因此,结合自上而下的路径及其与自底向上的路径的横向连接,不需要太多额外的计算,因此生成的特征图的每个级别在语义和空间上都可以很强。 因此,该体系结构是规模不变的,并且可以在速度和准确性方面提供更好的性能。

2.目标分类子网

每个FPN层都附加一个全卷积网络(FCN)进行对象分类。如图所示,该子网包含3*3个卷积层,256个滤波器,然后是3*3个卷积层,K*A滤波器,因此输出的feature map大小为W*H*KA,其中W和H与输入特征图的宽度和高度成比例,K和A分别为对象类和锚盒的数量。

最后利用Sigmoid层(而不是softmax)进行目标分类。

而最后一个卷积层之所以有KA滤波器是因为,如果从最后一个卷积层得到的特征图中的每个位置都有很多锚盒候选区域,那么每个锚盒都有可能被分类为K个类。所以输出的特征图大小将是KA通道或过滤器。

3.目标回归子网

回归子网与分类子网并行附着在FPN的每个特征图上。回归子网的设计与分类子网相同,只是最后一个卷积层大小为3*3,有4个filter,输出的特征图大小为W*H*4A。

最后一个卷积层有4个过滤器的原因是,为了定位类对象,回归子网络为每个锚定盒产生4个数字,这些数字预测锚定盒和真实框锚盒之间的相对偏移量(根据中心坐标、宽度和高度)。因此,回归子网的输出特征图具有4A滤波器或通道。

Focal Loss

Focal Loss(FL)是Cross-Entropy Loss(CE)的改进版本,它通过为困难的或容易错误分类的示例(即具有嘈杂纹理或部分对象或我们感兴趣的对象的背景)分配更多权重来尝试处理类不平衡问题 ,并简化简单的示例(即背景对象)。

因此,“Focal Loss”减少了简单示例带来的损失贡献,并提高了纠正错误分类的示例的重要性。 焦点损失只是交叉熵损失函数的扩展,它将降低简单示例的权重,并将训练重点放在困难样本上。

所以为了实现这些研究人员提出了

1- pt代表交叉熵损失,可调聚焦参数≥0。 RetinaNet物体检测方法使用焦距损失的α平衡变体,其中α= 0.25,γ= 2效果最佳。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

357

357

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?