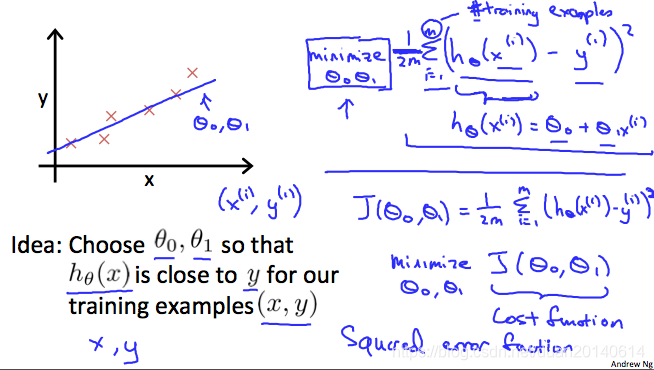

1、上一篇中我们提到了假设函数hθh_{\theta}hθ,该函数的作用根据输入变量xxx输出预测相应的输出变量hθ(x)h_{\theta}(x)hθ(x),那么该假设函数的预测效果该怎么度量呢?

2、我们可以使用代价函数(cost function)来度量估计假设函数的预测效果。代价函数,就是用来度量假设函数对样本目标变量的预测值与真实值之间差异的一个函数。

3、不同模型使用的代价函数不一定相同(后续我们会谈到),在这里我们只以线性回归的代价函数为例来简单介绍下:

线性回归问题的代价函数称之为均方误差函数,其具体形式:

J(θ)=12∗1m∑i=1m(y(i)→−y(i))2=12∗1m∑i=1m(hθ(x(i))−y(i))2J(\theta)={\frac{1}{2}*\frac{1}{m}\sum_{i=1}^{m}}(\overrightarrow{y^{(i)}}-y^{(i)})^{2}={\frac{1}{2}*\frac{1}{m}\sum_{i=1}^{m}}(h_{\theta}(x^{(i)})-y^{(i)})^{2}J(θ)=21∗m1i=1∑m(y(i)−y(i))2=21∗m1i=1∑m(hθ(x(i))−y(i))2

从公式中我们可以看出,均方误差是预测值与真实值之差的平方和的均值的一半,其中,θ=[θ0,θ1]\theta =[\theta_{0},\theta{1}]θ=[θ0,θ1],平均值乘以1/2是为了在计算梯度下降时方便,因为对平方项进行求导后可以抵消。

- 有监督学习模型的目的就是最小化代价函数,即

minimizeJ(θ)minimize{J(\theta)}minimizeJ(θ)

本文介绍了机器学习中假设函数的预测效果度量方式——代价函数,特别是聚焦于单变量线性回归的均方误差函数。均方误差是预测值与真实值之差的平方和的均值的一半,模型的目标是通过最小化代价函数来提高预测准确性。

本文介绍了机器学习中假设函数的预测效果度量方式——代价函数,特别是聚焦于单变量线性回归的均方误差函数。均方误差是预测值与真实值之差的平方和的均值的一半,模型的目标是通过最小化代价函数来提高预测准确性。

472

472

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?