声明:本文档撰写过程中,参考过其他博文,如盗用过2张图,由于文章久远,就不特别说明出处了,如有侵权,可以联系删除或者作出说明。

1概念

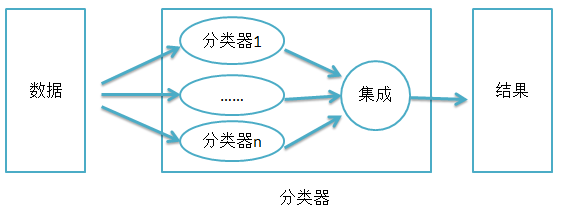

集成学习(Ensemble Learning)指将多个弱分类器构成一个强分类器。跟一般分类算法比,集成学习获得的分类器其精度比较高。

其思想可表达如下

【数据】

相比于其他分类算法,集成学习对于数据集过大或过小的情形有妙用!

数据集较大时,可以分为不同的子集,分别进行训练,然后再合成分类器。

数据集过小时,可使用自举技术(bootstrapping),从原样本集有放回的抽取m个子集,训练m个分类器,进行集成。

此外,如果数据可以(人工)分为不同类别的训练集,需要分开训练(可能不同训练集抽取的特征也不一样),这时候也需要集成学习。(下文中的嫁接法可能是将人工分类别变为模型分类别,即把数据的分类别做到了极致。)

【弱分类器】

不同弱分类器可以是不同的算法,也可以是同一个算法但是参数不一样。另外,一般要求每个弱分类器的错误率不能高于0.5。(高于0.5可以舍去。)

&n

集成学习通过结合多个弱分类器创建强分类器,包括Bagging、Boosting和Stacking等方法。Bagging使用Bootstrap抽样,常用于随机森林;Boosting通过调整数据权重迭代构建模型,如AdaBoost和Gradient Boosting;Stacking则是用多个模型的预测结果作为新数据训练一个组合模型。此外,嫁接法是初步概念,可能涉及初步分类后的线性模型应用。

集成学习通过结合多个弱分类器创建强分类器,包括Bagging、Boosting和Stacking等方法。Bagging使用Bootstrap抽样,常用于随机森林;Boosting通过调整数据权重迭代构建模型,如AdaBoost和Gradient Boosting;Stacking则是用多个模型的预测结果作为新数据训练一个组合模型。此外,嫁接法是初步概念,可能涉及初步分类后的线性模型应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5236

5236

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?