Per-Pixel Classification is Not All You Need for Semantic Segmentation

NeurIPS 2021

原文链接

掩码分类具有足够的通用性,可以使用完全相同的模型、损失函数和训练过程,以统一的方式解决语义级和实例级的分割任务。

本文提出MaskFormer,一个掩码分类模型。预测一组二进制掩码,每个掩码都与一个单个全局类标签预测相关联。简化了语义分割和全景分割任务,当类的数量很大时,MaskFormer比逐像素分类表现得更好。

掩码分类:

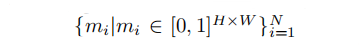

1. 1. 1.将图像分成 N N N个区域( N N N不需要等于类别数),用二进制掩码表示。

NeurIPS 2021会议上提出的MaskFormer模型创新性地将语义分割任务从逐像素分类转换为掩码分类。这种方法通过预测一组与全局类标签相关的二进制掩码,简化了语义和实例分割任务,尤其在大量类别情况下表现出色。掩码分类损失由交叉熵分类损失和二元掩码损失组成,使得模型能够处理多个相同类别的掩码预测。MaskFormer作为模块可以应用于任何逐像素分类模型,以实现掩码分类功能。

NeurIPS 2021会议上提出的MaskFormer模型创新性地将语义分割任务从逐像素分类转换为掩码分类。这种方法通过预测一组与全局类标签相关的二进制掩码,简化了语义和实例分割任务,尤其在大量类别情况下表现出色。掩码分类损失由交叉熵分类损失和二元掩码损失组成,使得模型能够处理多个相同类别的掩码预测。MaskFormer作为模块可以应用于任何逐像素分类模型,以实现掩码分类功能。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

494

494

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?