作者 | 岳京杭

责编 | 胡巍巍

华为、阿里、头条等公司的加班是出了名的,当然回报也给力。有个朋友去年去了某金服。配了3万股期权,35岁左右,按内部公允价200RMB/股,这部分期权值600万,四年兑现。

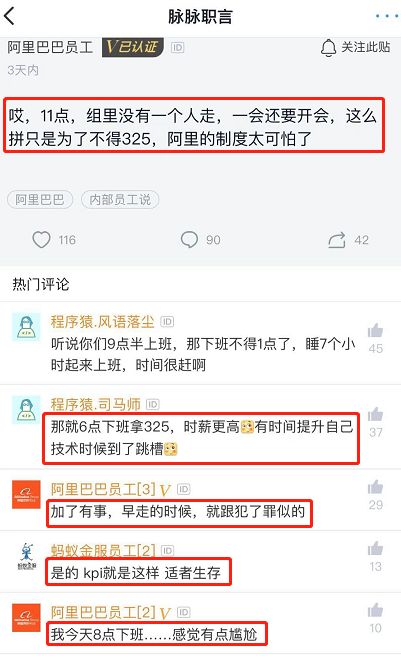

有次跟他聊天,问他在那边怎样,他说太累,同事之间氛围也不好,部门之间,同事之间相互抢活内斗,很不习惯。加班强度也大,晚上11点下班算早的。保温杯枸杞成了标配,不然一天根本撑不下来。

他说现在的策略是:不敢奢求升职,保住饭碗,混满4年,兑现全部期权,就谢天谢地了。哪怕不被裁,为了多活几天,4年之后自己也要撤。

前几天水木上有个帖子,如下:

发信人: kanji0430 (子持年华), 信区: WorkLife

标 题: 蚂蚁金服和今日头条

发信站: 水木社区 (Tue Dec 18 10:00:32 2018), 站内

30+,有必要从蚂蚁金服去今日头条么?

蚂蚁太累了,今日头条应该不会更累。但是去了蚂蚁的期权就拿不全,只能卖给公司。头条据说周末也要上班。而且头条路程单程要1小时,蚂蚁单程30分钟内。好处就是可能压力小一点,钱多一点。

发信人: kanji0430 (子持年华), 信区: WorkLife

标 题: Re: 蚂蚁金服和今日头条

发信站: 水木社区 (Tue Dec 18 10:19:23 2018), 站内

主要是蚂蚁加班太厉害了,早上8,9点干到凌晨1点普遍情况。

【 在 xiaoweiwang 的大作中提到: 】

: 你去今日头条是为了钱,还是为了实现自我价值?

: 如果为了钱就算了。真没必要。

发信人: kanji0430 (子持年华), 信区: WorkLife

标 题: Re: 蚂蚁金服和今日头条

发信站: 水木社区 (Tue Dec 18 10:56:18 2018), 站内

9,1,周末在家加班。

【 在 touchsoul219 的大作中提到: 】

: 蚂蚁据说996,是真的吗

总结一下:发帖人30多岁,在蚂蚁金服上班,早上9点上班,晚上1点下班,工作日上班时长16小时(包括午饭、午休、晚餐时间),周末还要在家里加班。他提到期权,应该是个P7,一年期权差不多150万。

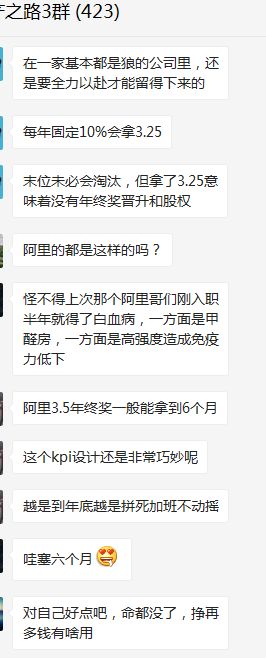

同样是P7,期权数量差别很大。去年入职的P7,最高可以给到3万股,今年年初是2万股左右,现在社招的P7,不到9000股。从金钱回报的角度看,同样是P7,对加班的忍受程度很定是不一样的。

社招P7以下级别,没有期权,加班强度和手握期权的P7一样,从这个角度看,蚂蚁真不是个好出去。

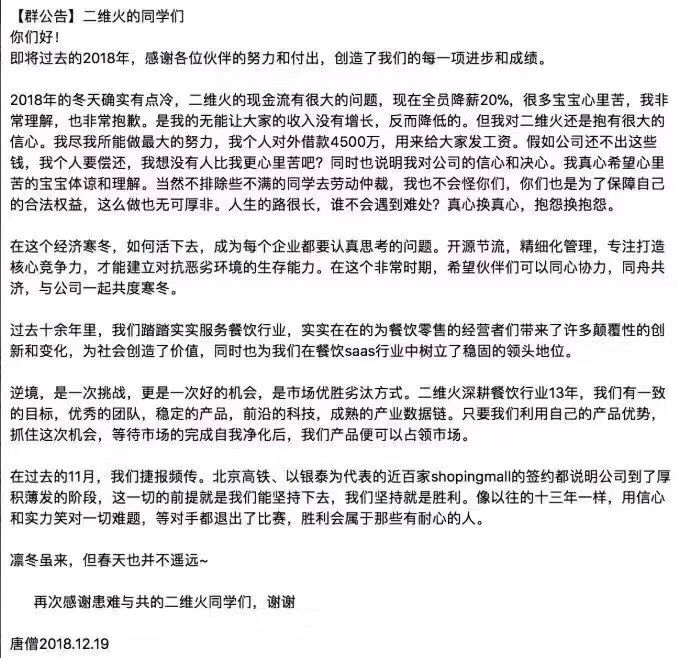

现在大多数企业经营成本高昂,盈利困难,小厂关门大吉,大厂裁员。一般来说,不到万不得已,大厂不会轻易裁员。裁员毕竟会上新闻,对企业商誉造成伤害,所以有些企业会变着法子裁员。

比如说全员降薪,年终奖减半。有些人受不了主动离职,省了赔偿又实现了减员,完美。这么一来可能造成逆淘汰,有能力的走了,混子老白兔留下来。你猜老板会不会跟业务骨干提前打好招呼?

还有一种是疯狂加班,目的可能并不是降成本,而是洗掉老白兔。比如某金服,新老板上位,push团队疯狂加班,晚上11点下班改到1点下班,加班一方面能出业绩,另一方面洗掉不能加班的老白兔,招新人,实现团队的新陈代谢,一举两得。

对于刚上班的年轻人,适当的加班是有好处的,但一定注意休息,身体是革命的本钱吗,来日方长。大疆25岁猝死,入职半年的应届硕士就是一个警醒。

上了年纪的老员工,一是有了家庭牵绊,时间上不再像年轻人富裕。二是高强度的加班,身体真的扛不过来。最后,多年积累也有了一些其他选择,主动或无奈,逐渐就退出了游戏。所以就有了XX公司员工平均年龄28岁,连续多年不变,永远是一家年轻的公司。

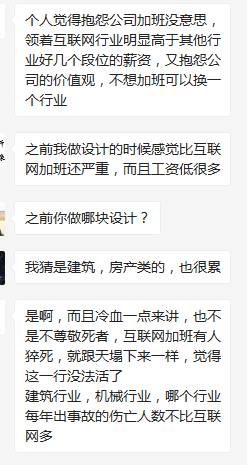

中国IT公司的加班风气,不是一天两天形成的,剧场效应,作为一个玩家,你改变不了,要走忍要么滚。

针对阿里的加班,有人是这么认为的。

公司不是家,不做没有回报的加班。

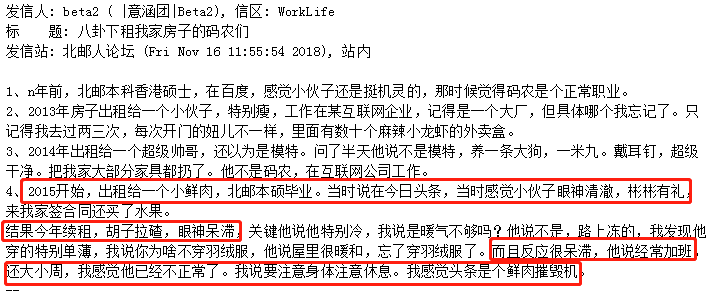

什么样的回报值得加班,就看个人情况来了。下文帖子中的小哥,京杭君认为他的加班强度是完全可以忍受的,毕竟好几千万的回报呢,如果是真的话。

作者简介:岳京杭,湖南人、北邮硕士。曾北漂8年,后跑路杭州,通信从业多年、后转行互联网,先后经历三星电子、百度等公司,目前从事人工智能相关开发工作。

本文系作者投稿,版权归公众号「中产之路」所有,「中产之路」以技术人的角度,探讨行业动态、职场见闻、转行路径、工资外收入、中产中年等实际话题。

热 文 推 荐

☞别说创业维艰,16岁开发者从辍学歧视死亡威胁, 到开发出爆款应用, 她的人生远非成人想象

print_r('点个好看吧!');

var_dump('点个好看吧!');

NSLog(@"点个好看吧!");

System.out.println("点个好看吧!");

console.log("点个好看吧!");

print("点个好看吧!");

printf("点个好看吧!\n");

cout << "点个好看吧!" << endl;

Console.WriteLine("点个好看吧!");

fmt.Println("点个好看吧!");

Response.Write("点个好看吧!");

alert("点个好看吧!")

echo "点个好看吧!";

点击“阅读原文”,打开 优快云 App 阅读更贴心!

点击“阅读原文”,打开 优快云 App 阅读更贴心!

喜欢就点击“好看”吧!

喜欢就点击“好看”吧!

互联网大厂的加班文化

互联网大厂的加班文化

85

85

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?