这里我用一个实例来实现以下BP神经网络计算的过程:

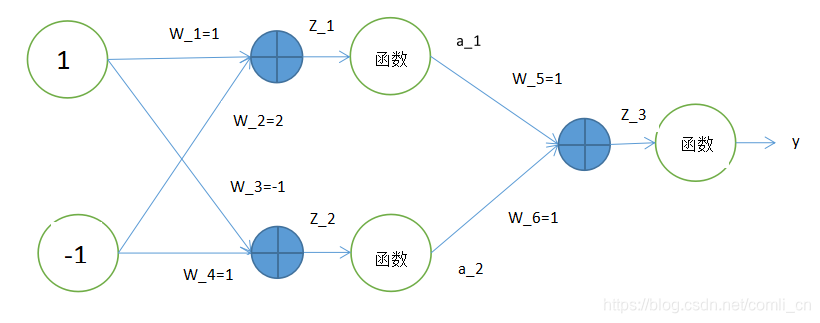

这个实例中输入x1=1x_1=1x1=1,x2=−1x_2=-1x2=−1,输出y=0.5y=0.5y=0.5,w1w_1w1到w6w_6w6为参数。

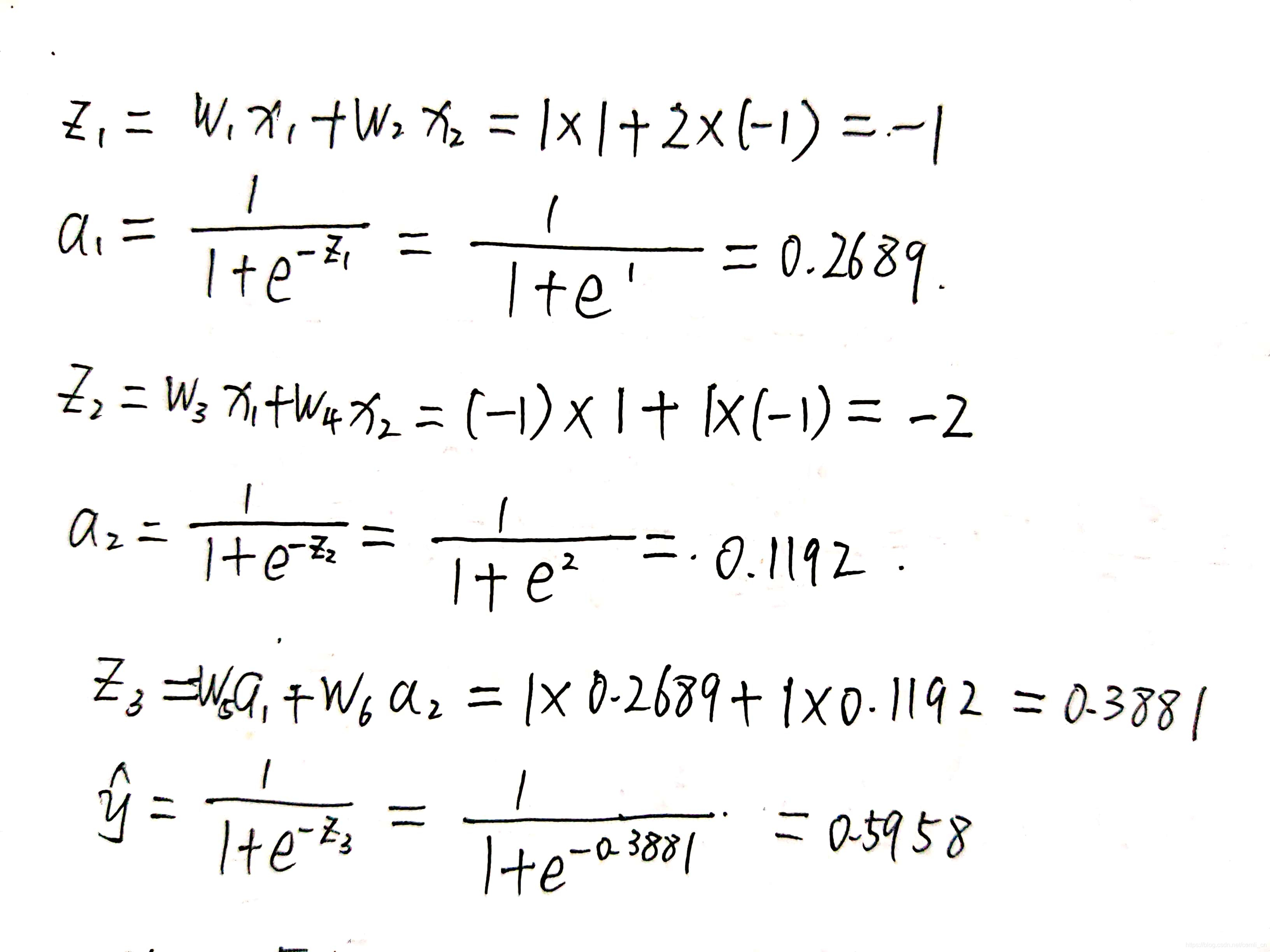

先通过上述模型计算出各个神经元的输入与输出:

构造损失函数,这里我们使用交叉熵损失函数C=−ylny^C=-yln\hat yC=−ylny^,yyy为标签值,y^\hat yy^为计算出来的值。

构造损失函数,这里我们使用交叉熵损失函数C=−ylny^C=-yln\hat yC=−ylny^,yyy为标签值,y^\hat yy^为计算出来的值。

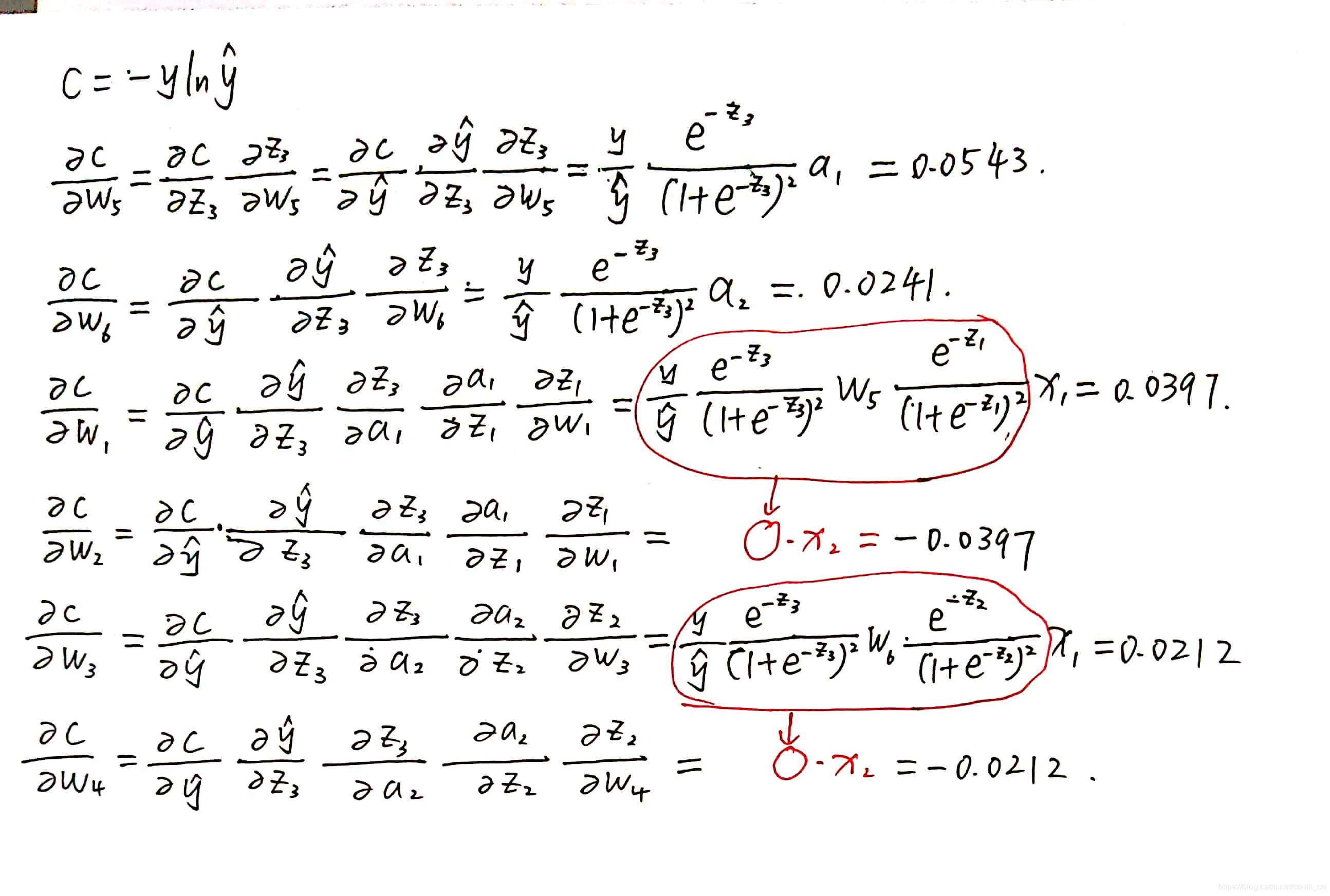

接下来用反向传播来求解偏导数:

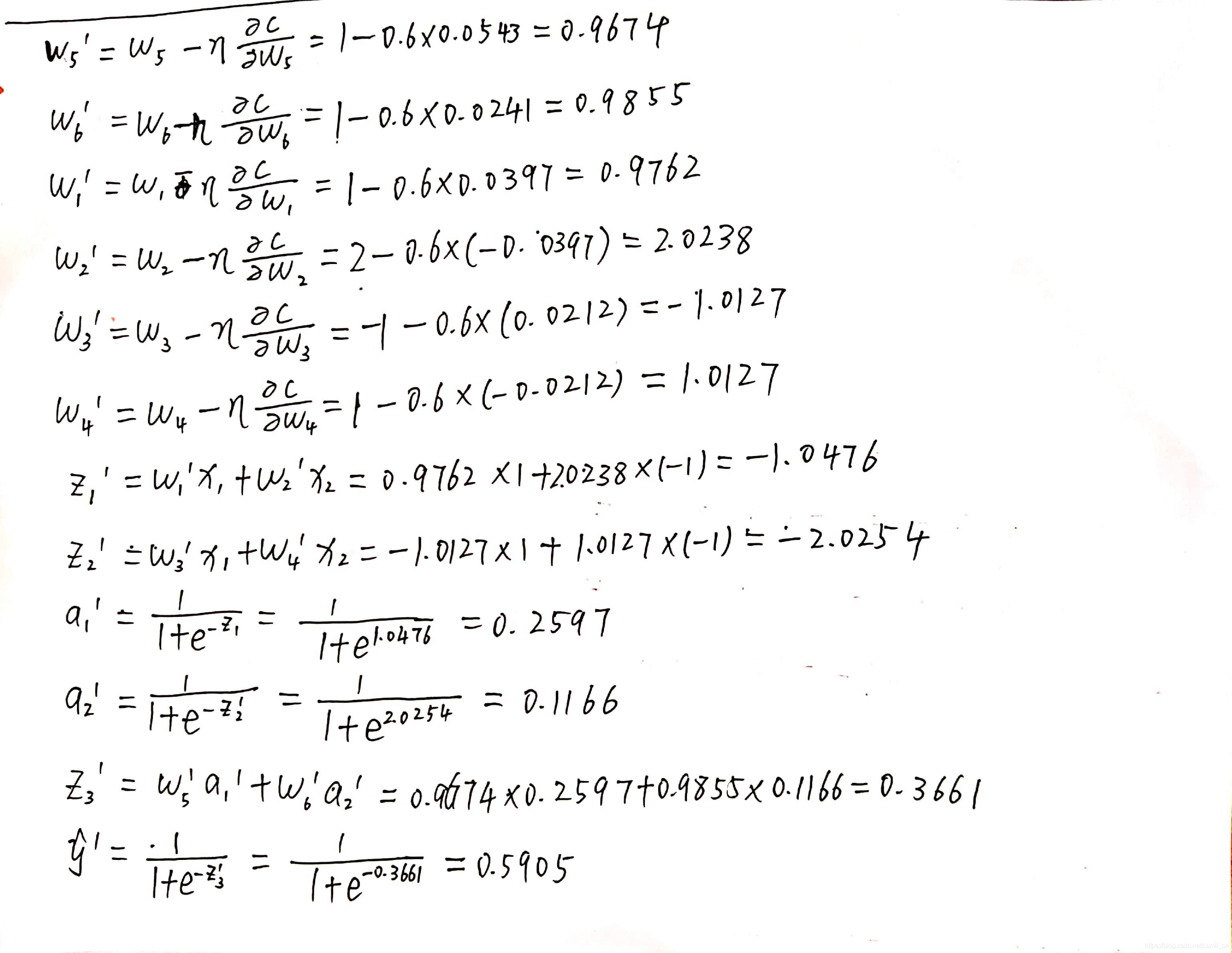

到这一步我们已经求出了各个参数的偏导数了,下一步就是更新参数了,我们设学习率η\etaη为0.6

可以看到更新参数之后算得的y^′\hat y'y^′比原来的y^\hat yy^更接近0.5了,接下来只要按照上述的步骤一遍一遍进行操作就可以了。结束更新的操作可以是循环了k次或者y^\hat yy^与yyy之间的距离足够小。

李宏毅深度学习笔记(九)BP(Back propagation)神经网络计算详解(手算)

最新推荐文章于 2025-08-01 23:50:29 发布

本文通过一个具体实例,详细解析了BP神经网络的计算过程,包括前向传播、损失函数计算、反向传播求解偏导数及参数更新,展示了神经网络训练的基本流程。

本文通过一个具体实例,详细解析了BP神经网络的计算过程,包括前向传播、损失函数计算、反向传播求解偏导数及参数更新,展示了神经网络训练的基本流程。

部署运行你感兴趣的模型镜像

您可能感兴趣的与本文相关的镜像

TensorFlow-v2.15

TensorFlow

TensorFlow 是由Google Brain 团队开发的开源机器学习框架,广泛应用于深度学习研究和生产环境。 它提供了一个灵活的平台,用于构建和训练各种机器学习模型

6585

6585

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?