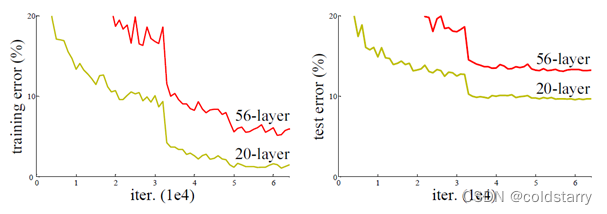

非常非常深的神经网络,网络发生了退化(degradation)的现象:随着网络层数的增多,训练集loss逐渐下降,然后趋于饱和,当你再增加网络深度的话,训练集loss反而会增大。注意这并不是过拟合,因为在过拟合中训练loss是一直减小的。

网络退化:在增加网络层数的过程中,training accuracy (精度)逐渐趋于饱和,继续增加层数,training accuracy 就会出现下降的现象,而这种下降不是由过拟合造成的。实际上较深模型后面添加的不是恒等映射,而是一些非线性层。

退化问题的实质:通过多个非线性层来近似恒等映射可能是困难的(恒等映射亦称恒等函数:是一种重要的映射,对任何元素,象与原象相同的映射)。神经网络在反向传播过程中要不断传播梯度,而当层数加深,梯度在传播过程中逐渐消失【而梯度消失则是导致网络退化的一个重要因素】,导致无法对前面网络的权重进行有效调整(这里大家可以想一下一条很长的绳子从头抖一下,有时候是不能影响末端的。

跳跃连接(Skip connection),它可以从某一层网络层获取激活,然后迅速反馈给另外一层,甚至是神经网络的更深层。我们可以利用跳跃连接构建能够训练深度网络的ResNets,有时深度能够超过100层

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1050

1050

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?