在面试中,当被问到“RAG的检索模块如何优化”时,不少测试工程师会下意识觉得:“这应该是算法团队负责的吧?”

但恰恰相反。RAG系统的检索质量,直接决定了回答的准确性、响应稳定性,以及整个优化过程能否被有效验证和量化——而这正是测试开发能够深度参与、发挥价值的关键环节。

一、RAG 检索模块到底在干嘛?

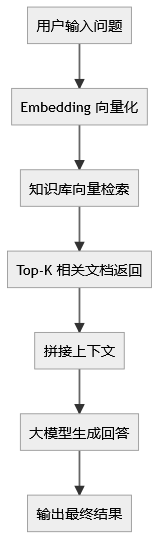

简单来说,RAG 是“先检索,再生成”: 用户提问后,系统先去知识库里找资料(Retrieval),再让大模型基于资料生成回答(Generation)。

从测试视角看,这个过程最容易出问题的地方有三处:

-

检索不准(答非所问)

-

检索不全(漏掉关键信息)

-

检索太慢(性能瓶颈)

所以检索模块优化的目标是三件事:提质、降噪、提速。

二、检索模块优化:从测试角度看五大方向

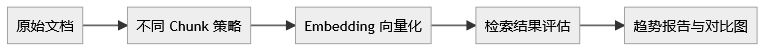

1️⃣ 向量化模型优化:Embedding 的质量是天花板

不同 embedding 模型(text-embedding-3、bge-large、E5)在语义理解上的精度差异很大。 测试开发该做的,是用自动化评测而不是“主观感觉”去验证模型优劣。

-

构建一组标准问答集(golden set);

-

计算不同模型的 Top-K 命中率、Recall@K、MRR;

-

输出自动对比报告。

✅ 关键实践:建立“评测基线(Baseline Evaluation)” 固定一组模型 + chunk 策略 + 索引配置作为基线组合, 每次升级 embedding 模型或数据库参数,都与基线自动对比,只有各指标全面提升才允许替换。

2️⃣ Chunk 策略优化:粒度决定匹配的灵敏度

Chunk(文档切分)太小会导致语义碎片化,太大又容易召回噪声。 测试优化可通过参数扫描找到最佳平衡点:

chunk size = [200, 400, 600, 800],overlap = [0%, 10%, 20%] 自动评估 Recall@K 和性能曲线。

⚙️ 建议: 将评测流程集成进 CI/CD,通过自动化趋势图对比,让优化有数据支撑,而不是“凭感觉改”。

3️⃣ 检索参数调优:算法性能与稳定性并行

检索引擎(如 FAISS、Milvus、Qdrant)支持多种参数:

-

TopK(返回结果数)

-

相似度算法(余弦、内积、欧式)

-

索引结构(HNSW 的 efSearch、M)

测试开发该验证的,不只是“相关性”,还包括:

-

一致性:重复请求结果稳定;

-

性能:QPS、P95、P99 延迟;

-

资源消耗:索引构建时间与内存占用。

这就引出了第二件真正该测的事:

性能与语义的联合验证。

优化不仅要 Recall 提升,也要保证延迟在可接受范围,否则就是“更准但更慢”的失败优化。

4️⃣ 混合检索(Hybrid Search):语义与关键词的平衡术

纯语义检索在专业词或低频词上容易翻车。 很多系统采用 Hybrid(BM25 + Embedding)融合检索。

测试关注点:

-

融合排序算法是否合理;

-

去重逻辑是否可靠;

-

Hybrid 模式是否拖慢响应。

最佳实践是做 A/B 实验: A 组用纯向量检索,B 组用 Hybrid 检索, 对比前 5 条结果的人工相关性得分或 GPT 自动评分。

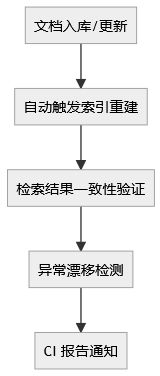

5️⃣ 知识库更新与一致性验证:优化的最后一公里

RAG 系统再聪明,也得靠“新鲜数据”。 一旦索引没更新,就会出现“模型说的还是旧答案”的情况。

测试开发可构建知识库验证流水线:

验证点包括:

-

新文档能否被命中;

-

删除替换后旧索引是否清理;

-

索引更新是否影响性能;

-

检索结果是否出现“漂移”。

这就是检索优化的第三件真活儿:

自动化回归评估闭环(Regression Evaluation Loop)。 优化不能一次性,要能自动发现退化、回滚旧版本。

三、如何判断优化是否成功?

优化必须“可量化”,不能凭主观。

| 指标 | 含义 | 测试方法 |

|---|---|---|

| Precision@K | 前K结果准确率 | 标注集对比 |

| Recall@K | 检索覆盖度 | 召回评估 |

| MRR | 排序质量 | 平均倒数排名 |

| Latency | 检索响应时延 | 性能压测 |

| Stability | 结果一致性 | 重复对比 |

通过自动化流水线,每次优化后自动评估这些指标,结合历史趋势,就能清楚地看到:

— 模型是否真的变好?

— 性能是否退化?

— 系统是否更稳?

四、换模型不等于优化

如某企业升级了 embedding 模型,结果检索效果变差。 原因不是模型不行,而是 chunk 策略没改——新模型更懂语义,但被旧分块策略打断。

调整后:

-

chunk size 从 300 调为 600;

-

overlap 增加到 20%;

-

Recall@3 提升 12%,命中率从 68% → 79%。

有了评测基线与回归评估体系,这种问题几分钟就能定位。

五、测试开发,让 RAG 优化更“科学”

RAG 检索模块优化,不是单纯的算法调参,而是一场系统性工程。 测试开发的角色,不是“验证对错”, 而是通过 评测基线 + 自动回归 + 性能与语义联合验证, 让优化过程变得可度量、可溯源、可复现。

未来的 AI 测试开发,不只是写 case, 而是要打造完整的 Evaluation Pipeline(智能评测流水线)。 那将是测试开发工程师的全新主场。

测试开发全景图:AI测试、智能驱动、自动化、测试开发、左移右移与DevOps的持续交付

你怎么看?你是否在项目中测试过 RAG 系统? 你觉得检索优化优先看“相关性”还是“性能”? 评论区聊聊你的经验 👇

7041

7041

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?