著名 AI 学者、斯坦福大学教授吴恩达提出了 AI Agent 的四种设计方式后,Agentic Workflow(智能体工作流)立即火爆全球,多个行业都在实践智能体工作流的应用,并推动了新的 Agentic AI 探索热潮。

吴恩达总结了 Agent 设计的四种模式:

Reflection - 自我反思

Tool Use - 工具调用

Planning - 规划设计

Multi-agent collaboration - 多智能体协同

吴恩达教授在介绍 Agentic Workflow 时,认为它是与 LLM 交互和完成任务的一种方法,可以将任务分解成多个步骤,在不同环节进行迭代,指导最终生成期望的结果。并将 Agentic Workflow 的设计模式总结为反思、工具使用、规划和多智能体协作四种。前两者比较普遍被熟知,后两者相对较新还在兴起。正是后两者把 Agent 的使用模式,从基于某个单一大模型的单体 Agent 使用,跨越到多个大模型多个智能体协同配合完成端到端业务的流程。这么做才能称为 Agentic Worflow.

以 Botnow 智能体开发平台为例,工作流支持可视化的方式,对大语言模型、条件判断、插件工具等功能进行组合,从而实现复杂、稳定的业务流程编排,例如旅行规划、报告分析等。 当目标任务场景包含较多的步骤,且对输出结果的准确性、格式有严格要求时,适合配置工作流来实现。

1. 定义

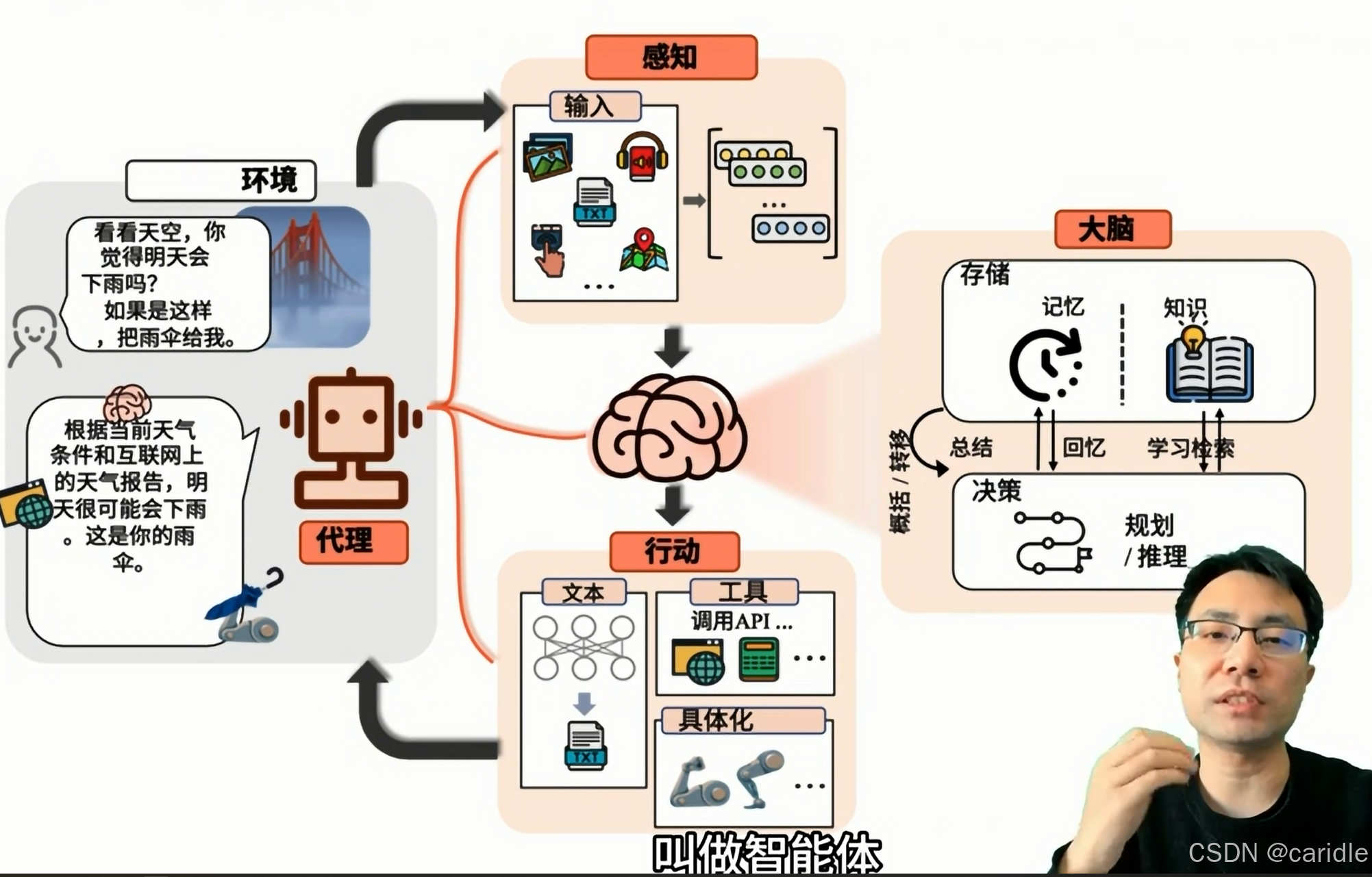

AI智能体(Artificial Intelligence Agent),简称AI Agent,是一种能够执行任务、解决问题或提供决策支持的软件系统。它通常被设计成模拟人类智能行为,以实现自动化和增强人类工作能力。AI智能体可以是简单的,如基于规则的系统,也可以是复杂的,如基于机器学习的系统。

2. 工作原理

AI智能体的工作原理可以分解为以下几个关键部分:

2.1 感知(Perception)

感知是智能体与环境交互的第一步。智能体通过传感器或数据输入来感知外部世界的状态。这些输入可以是文本、图像、声音或任何其他形式的数据。

2.2 推理(Reasoning)

推理是智能体处理感知数据并做出决策的过程。这涉及到逻辑推理、规划、问题解决和学习。智能体使用算法和模型来分析数据,识别模式,并预测结果。

2.3 行动(Action)

行动是智能体对环境做出响应的过程。基于推理的结果,智能体会选择一个或多个行动来执行。这些行动可以是发送消息、控制机器人、生成报告等。

2.4 学习(Learning)

学习是智能体改进其性能的能力。通过机器学习算法,智能体可以从经验中学习,优化其决策过程,并适应新的情况。

案例:Agent预定餐厅

假设你需要与朋友在附近吃饭,需要AI智能体帮你预订餐厅。智能体会按照以下步骤进行操作:

第一步:获取当前位置

- 推理:智能体意识到,为了推荐餐厅,它需要知道你的当前位置以及附近的餐厅信息。

- 行动:智能体使用地图工具(Tools)来获取你的当前位置。

- 结果:智能体得出了附近餐厅的列表。

第二步:确定匹配餐厅

- 推理:智能体需要确定预订哪个餐厅,这需要知道你的饮食偏好以及其他细节(比如:吃饭的时间、人数)。

- 行动:智能体从它的记忆中(Memory)获取你的饮食偏好、人数、时间等信息。

- 结果:智能体确定了最匹配的餐厅。

第三步:预订餐厅

- 推理:基于前两步的结果,智能体评估当前所拥有的工具能否完成餐厅预订。

- 行动:智能体使用相关插件工具进行餐厅预订(Action)。

- 结果:任务完成,餐厅预订成功。

在这个案例中,智能体通过感知(使用地图工具获取位置)、推理(根据位置和用户偏好确定餐厅)和行动(使用插件工具预订餐厅)三个核心环节来完成任务。这个过程展示了智能体如何通过与环境的交互来实现目标,即智能体的工作原理。

3. 设计思维

设计AI智能体时,需要考虑以下几个设计思维原则:

3.1 用户中心设计(User-Centered Design)

用户中心设计强调以用户需求和体验为中心。设计智能体时,需要考虑用户的目标、能力和限制,确保智能体能够满足用户的实际需求。

3.2 模块化设计(Modular Design)

模块化设计允许智能体的不同组件(如感知、推理、行动)独立开发和测试,然后集成在一起。这有助于提高系统的可维护性和可扩展性。

3.3 可解释性(Explainability)

可解释性是指智能体的决策过程和结果能够被人类理解和解释。这对于建立用户信任和确保智能体的道德合规至关重要。

3.4 适应性(Adaptability)

适应性是指智能体能够适应不断变化的环境和用户需求。这通常通过机器学习算法实现,使智能体能够从经验中学习并优化其行为。

3.5 鲁棒性(Robustness)

鲁棒性是指智能体在面对错误、异常和不确定性时能够保持性能的能力。设计时需要考虑错误处理和异常管理,确保智能体的稳定性和可靠性。

4. AI智能体的类型

AI智能体可以根据其功能和复杂性分为几种类型:

4.1 简单反射智能体(Simple Reflex Agents)

这类智能体仅基于当前感知到的环境状态做出决策。它们没有记忆,不能从经验中学习。

案例:家用自动扫地机器人。这种智能体仅根据当前感知到的环境状态做出决策,没有记忆功能,不能从经验中学习。当扫地机器人遇到障碍物时,它会根据预设的程序改变方向,但不会记忆之前的路径或优化未来的清洁路线。

4.2 模型驱动反射智能体(Model-Driven Reflex Agents)

这类智能体能够维护一个内部状态,这个状态是环境的简化模型。它们可以根据这个模型和当前的感知做出决策。

案例:智能机器人在室内导航。它通过传感器感知周围环境,并在内部构建一个地图模型。当遇到新的障碍物时,它可以根据地图模型和过去的导航经验,预测出绕过障碍物的最佳路径。

4.3 基于目标的智能体(Goal-Based Agents)

这类智能体有一个或多个目标,并能够采取行动以实现这些目标。它们能够评估不同行动的优劣,并选择最有可能实现目标的行动。

案例:物流机器人在仓库中搬运货物。它的目标是将货物从存储区搬运到指定的发货区。它会规划出一条从起始位置到目标位置的最优路径,避开障碍物和其他正在工作的机器人。在这个过程中,它会不断评估自己的位置和动作是否有助于接近目标,如果发现当前路径被阻塞,它会重新规划路径以继续朝着目标前进。

4.4 基于效用的智能体(Utility-Based Agents)

这类智能体不仅考虑实现目标,还考虑行动的“效用”或总体价值。它们会评估每个可能行动的长期后果,并选择具有最高预期效用的行动。

案例:股票交易算法。这种智能体不仅考虑实现目标,还考虑行动的“效用”或总体价值。它们会评估每个可能行动的长期后果,并选择具有最高预期效用的行动。例如,一个交易算法可能会评估不同的买卖策略,并选择预期利润最高且风险最低的策略。

4.5 学习智能体(Learning Agents)

这类智能体能够从经验中学习,并根据过去的交互调整其行为。它们可以使用各种机器学习算法来改进其决策过程。

案例:抖音的推荐系统。这类智能体能够从经验中学习,并根据过去的交互调整其行为。它们可以使用各种机器学习算法来改进其决策过程。抖音的推荐系统会根据用户的行为反馈(如点赞、评论、观看时间)来优化推荐算法,从而提供更符合用户偏好的内容。

5. AI智能体的应用领域

AI智能体在许多领域都有应用,包括但不限于:

5.1 客户服务(Customer Service)

智能客服系统可以自动回答用户问题,处理订单和提供技术支持。

Ivy.ai:这是一个多语言支持和全渠道客户服务功能的AI Agent,使用AI技术通过多种渠道(如短信、电子邮件、语音命令等)提供自动化响应。

5.2 医疗健康(Healthcare)

智能体可以辅助诊断疾病,推荐治疗方案,并管理患者数据。

医者AI(Healthy Care Agents):由清华创业团队创建的公司,基于最前沿的自研MoE架构大模型,构建了健康管理Agent,聚焦亚健康管理领域。

5.3 金融服务(Financial Services)

智能投资顾问可以提供个性化的投资建议,监控市场趋势,并执行交易。

AI Agent + Blockchain:在加密货币交易领域,AI Agent结合区块链技术,重塑加密货币交易服务,包括价格预测、成交策略、借贷等。

5.4 交通物流(Transportation and Logistics)

智能体可以优化路线规划,监控货物流动,并管理交通网络。

联汇科技智能体:打造了空间运营智能体和知识服务智能体两大智能体产品体系,已面向零售、酒店、景区、政务等数行业落地了数十种智能体应用,助力企业数字化转型。

5.5 教育(Education)

智能教育助手可以提供个性化学习计划,评估学生表现,并提供反馈。

- GPT Researcher:一个Autonomous Agent,旨在对各种任务进行全面的在线研究,可以生成详细、事实和公正的研究报告,并提供自定义选项。

- DRUID AI:一款对话式AI平台,旨在通过简化学生生活、为教授赋能以及优化运营,来推动高等教育的转型。

- 海事超级智能体:上海海事大学构建的智能体,采取自建大模型+引用AI服务模式,能够根据人的要求,自主判断、决策、分解子任务,自行与业务系统、专业知识库、海事垂直大模型及互联网交互分析。

6. 伦理和法律问题

在设计和部署AI智能体时,需要考虑伦理和法律问题,包括:

6.1 隐私保护(Privacy Protection)

智能体处理的数据可能包含敏感信息,需要确保这些信息的安全和隐私。

6.2 偏见和歧视(Bias and Discrimination)

智能体的决策可能会受到训练数据中偏见的影响,需要采取措施减少这种影响。

6.3 责任归属(Accountability)

当智能体造成损害时,需要明确责任归属,确保有适当的法律框架来处理这些问题。

6.4 透明度和可解释性(Transparency and Explainability)

智能体的决策过程应该是透明的,用户应该能够理解智能体的工作原理和决策依据。

7. 结论

AI智能体是AI领域的一个重要分支,它们通过模拟人类智能行为来执行任务和提供决策支持。理解AI智能体的定义、工作原理和设计思维对于开发和部署有效的智能体至关重要。随着技术的进步,AI智能体将在越来越多的领域发挥重要作用,同时也需要我们持续关注其伦理和法律问题。

912

912

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?