主要内容

- 研究背景与问题:语言模型在多种任务中表现出色,但实现强大的多步推理能力仍是挑战。通过监督微调增强推理存在依赖专家演示、可能导致浅层模仿等问题;强化学习虽能让模型灵活学习,但资源消耗大。本文聚焦于如何通过高效的强化学习在语言模型中经济高效地赋予推理能力。

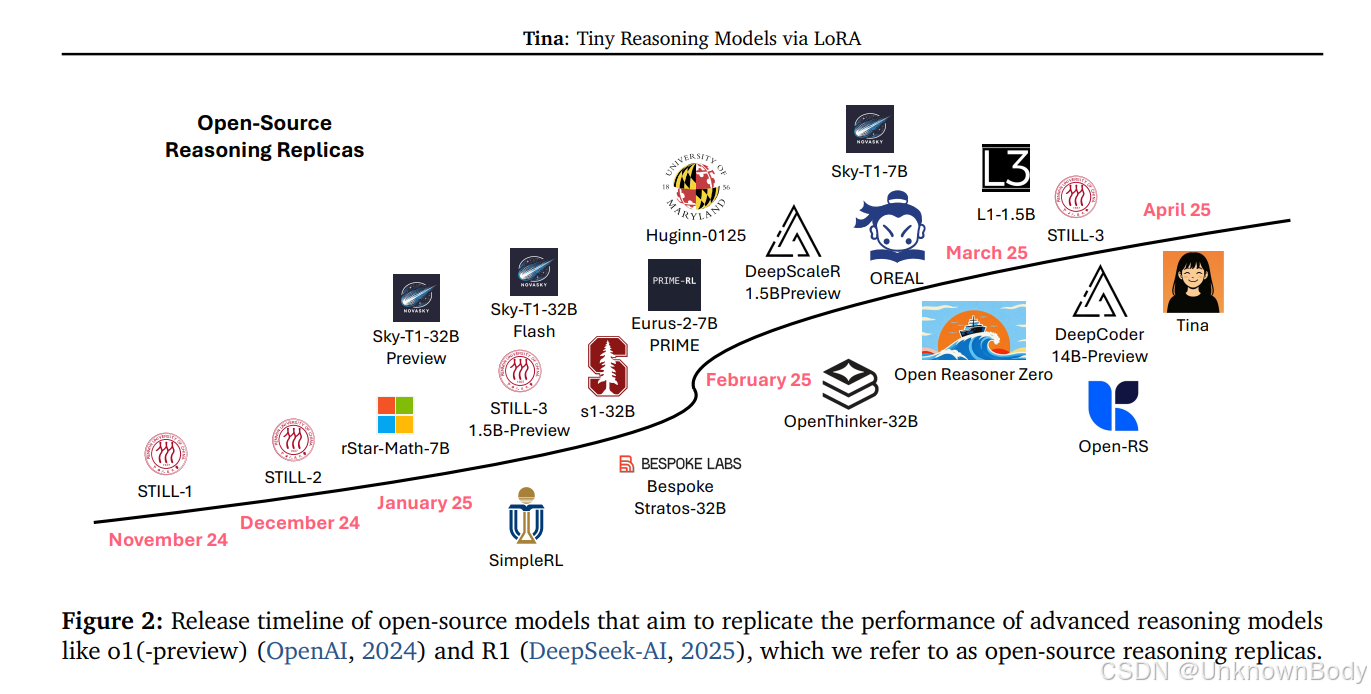

- 相关工作:介绍了开源推理模型的发展,如STILL、Sky - T1等旨在复制或超越先进推理模型能力;阐述了强化学习在推理任务中的应用,包括引入辅助奖励模型、基于规则的验证等方法;还介绍了低秩适应(LoRA)技术,其可在较少参数更新下修改模型行为。

- Tina模型:利用LoRA在强化学习阶段对15亿参数的DeepSeek - R1 - Distill - Qwen - 1.5B基础模型进行后训练得到Tina模型系列。训练过程使用公开数据集和开源代码,采用GRPO - 风格算法,在仅使用两个NVIDIA L40S GPU的低成本硬件配置下进行,总训练和评估成本低。

- 实验评估:重新评估基线模型,使用统一方法在多个推理基准测试中进行。Tina模型在多个任务上表现出色,推理性能与全参数训练的基线模型相当甚至超越,且训练时间短。通过消融实验研究了训练数据集、学习率、LoRA秩和强化学习算法等因素对模型性能的影响。

- LoRA的

订阅专栏 解锁全文

订阅专栏 解锁全文

8182

8182

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?