摘要

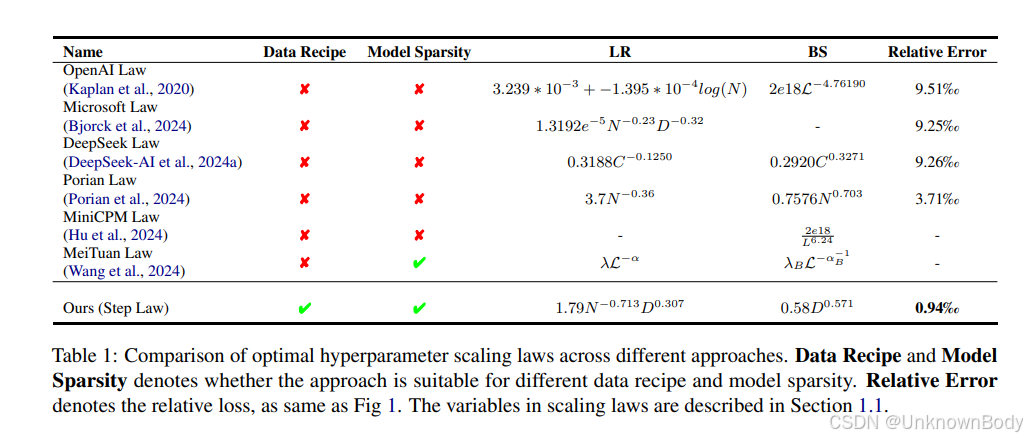

大语言模型(LLMs)在各种任务中展现出令人瞩目的能力,然而,要有效部署这些模型,需要对超参数进行仔细优化。通过对多种配置进行广泛的网格搜索实证研究,我们发现了适用于这些超参数的通用缩放定律:最优学习率与模型参数和数据规模均呈幂律关系,而最优批量大小主要随数据规模变化。我们的分析表明,在固定模型和数据规模条件下,超参数的优化景观是凸的。这种凸性意味着存在一个最优超参数平台。我们为社区贡献了一种通用的、即插即用的最优超参数工具。在测试集上,其估计值与通过穷举搜索得到的全局最优LLM性能仅相差0.09%。这些定律在模型稀疏度、训练数据分布和模型形状的变化中表现出显著的稳健性。据我们所知,这是第一项统一不同模型形状和结构(如专家混合模型和密集Transformer模型),并建立不同数据分布下最优超参数缩放定律的工作。这个详尽的优化过程需要大量计算资源,使用近100万个NVIDIA H800 GPU小时从头开始训练3700个不同规模和超参数的LLM,总共消耗约100万亿个token。为了便于复现和进一步研究,我们将通过指定的存储库https://steplaw.github.io/逐步发布所有损失测量结果和模型检查点。

引言

最先进的大语言模型(LLMs)(Brown等人,2020;Jin等人,2023;Biderman等人,2023;S

订阅专栏 解锁全文

订阅专栏 解锁全文

543

543

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?