目录

1 深层神经网络

深层神经网络就是包含更多隐藏层的神经网络 ,一般来说我们在命名神经网络时,层数只参考隐藏层和输出层,下面引入一个四层神经网络的例子。

上图有三个隐藏层,每层的神经元数目分别为5,5,3。用L表示层数,用0表示输入层,则L=4,则有。

2 深层神经网络的正向传播

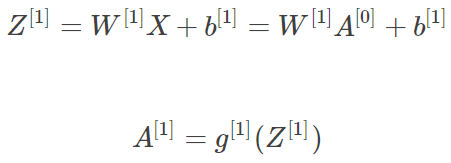

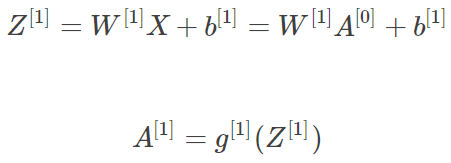

假设存在m个训练样本,其向量化迭代过程如下所示:

第一层:l=1:

第二层:l=2:

目录

深层神经网络就是包含更多隐藏层的神经网络 ,一般来说我们在命名神经网络时,层数只参考隐藏层和输出层,下面引入一个四层神经网络的例子。

上图有三个隐藏层,每层的神经元数目分别为5,5,3。用L表示层数,用0表示输入层,则L=4,则有。

假设存在m个训练样本,其向量化迭代过程如下所示:

第一层:l=1:

第二层:l=2:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?