(鉴定为水文,over)

摘要:联邦学习已经成为一项有前景的隐私保护机器学习技术,使多个客户能够共同训练一个全局模型,而无需共享原始数据。随着联邦学习在物联网场景中的日益普及,对安全和隐私的担忧变得至关重要。特别是,梯度反转攻击和毒化攻击对全局模型的完整性和效果构成了重大威胁。为此,我们提出了一种基于区块链的全面防御机制,有效保护联邦学习系统免受此类攻击。我们采用了一种新颖的技术组合,包括公共区块链级别的保护和私有区块链级别的保护,二者协同工作,防止攻击者利用获得的梯度重构数据。这种独特的方法组合为联邦学习物联网场景中的梯度反转攻击提供了强大的防御。我们进行了大量实验证明了我们提出的方法对梯度反转和毒化攻击的有效性。实验结果表明,在毒化攻击下,我们的方法能够实现更高的准确性和稳定的训练损失收敛,说明我们的方法可以应用于广泛的联邦学习物联网场景,增强分布式机器学习系统的安全性和隐私性。

关键词—区块链,物联网,联邦学习,梯度反转攻击,毒化攻击,安全,隐私

INTRODUCTION:

物联网(IoT)的快速发展引入了一个新时代的互联设备和数据生成,涵盖了各个领域的无数应用,包括医疗保健、交通运输、智能家居和农业[1]。数据的指数级增长促使了先进的机器学习技术的发展,以分析并从这些数据中提取可操作的见解。由于传统的集中式机器学习模型在数据隐私、通信开销和可扩展性方面面临挑战,联邦学习(FL)已经成为一种有前景的分散式方法来解决这些问题[2]。联邦学习通过保留数据在本地设备上并仅共享模型更新的方式,使得能够使用来自各种设备的数据来训练机器学习模型,同时保护用户隐私[3]。这种方法在物联网场景中变得越来越流行,其中许多连接的设备在边缘生成和处理数据。联邦学习不仅减少了将大量数据传输到中央服务器相关的通信开销,而且在确保敏感信息安全的同时,促进了边缘设备之间的协作学习[4]。

然而,联邦学习的分布式特性使其容易受到各种攻击,这些攻击可能危及学习过程、模型性能和整个系统的安全性[5]。其中,梯度反转攻击(GIA)和毒化攻击(PA)尤为具有破坏性。梯度反转攻击涉及对手以一种破坏学习过程的方式操纵梯度更新,最终损害模型的性能[6]。这些攻击难以检测,因为对手可以巧妙地改变梯度更新,导致模型性能随时间逐渐下降。

另一方面,毒化攻击(PA)是由对手注入恶意数据样本到训练过程中精心策划的[7]。这些数据样本经过精心设计,以操纵模型的行为,导致在面对特定输入时产生不正确或恶意的输出[8]。这些恶意数据样本通常看似合法,使其难以识别和防止此类攻击。毒化攻击的后果可能严重,导致模型性能和完整性下降,如果在关键应用中部署,可能会造成重大损害。

鉴于在物联网(IoT)和联邦学习(FL)中数据安全和隐私的重要性,开发有效的防御机制以抵御这些类型的攻击至关重要。区块链技术以其固有的去中心化和防篡改性质,已经成为增强物联网场景中FL安全性的有前景的解决方案[9]。通过利用区块链技术提供的加密功能、共识算法和智能合约,我们可以确保FL过程中使用的梯度更新和数据样本的完整性和真实性。

针对这些威胁,我们提出了一个创新的框架,结合了区块链技术和差分隐私,以抵御联邦学习中的梯度反转攻击和毒化攻击。为了防范梯度反转攻击,我们的框架采用了双重手段。首先,它使用公共区块链通过智能合约保护客户上传的梯度信息,并应用**差分隐私随机梯度下降(DPSGD)**以加强保护。其次,它整合了一个私有区块链,在联邦学习过程中,客户直接集成DPSGD以保护梯度。为了防范毒化攻击,我们的框架充分利用区块链技术提供的可追溯性,以识别并将攻击者从学习过程中排除。

本文介绍了所提出的防御框架的设计和实施,详细说明了其组成部分和对抗梯度反转攻击(GIA)和毒化攻击(PA)的基本机制。该框架旨在确保在联邦学习过程中使用的数据的安全性和隐私,提高训练模型的整体可靠性和性能,并为各种攻击场景提供强大的保护。

我们的贡献如下:

1、我们开发了一个基于区块链的防御系统,针对联邦学习物联网应用中的梯度反转和毒化攻击,直接解决了关键的安全和隐私问题。这一创新性的解决方案缓解了对全局模型完整性和效果的威胁,值得考虑在广泛范围内推广采用。

2、我们的方法独特地结合了公共和私有区块链层级,确保了梯度的强大保护同时保持模型性能和效用。这种平衡和全面的方法相较于现有技术具有显著的优势,因为它能够应对更广泛的攻击向量,而不损害模型的质量。

3、大量实验证实了我们方法的有效性,揭示了在攻击场景中准确性的提高和稳定的训练损失收敛。这些发现展示了我们的方法在增强各种物联网应用的安全性和隐私性方面的潜力,从而证明了其在联邦学习研究社区中的相关性和价值。

本文的结构组织如下:第二部分介绍了联邦学习、区块链、梯度反转攻击(GIA)和毒化攻击(PA)的基本概念。第三部分详细说明了问题定义和系统模型。在第四部分,概述了所提出的框架,而第五部分深入探讨了隐私和安全性的影响。第六部分呈现了实验结果,第七部分回顾了相关文献。最后,第八部分讨论了潜在的研究方向,并总结了该研究。

II. PRELIMINARY

在本节中,我们介绍构成我们所提出的防御框架基础的基本概念和技术。我们概述了联邦学习、区块链、梯度反转攻击和毒化攻击,讨论它们的基本原理、特征以及对联邦学习系统的安全性和性能的影响。

A. Federated Learning

联邦学习是一种分散式机器学习方法,允许多个设备协作训练一个全局模型,同时保留它们的原始数据[10]。假设有n个客户端(C1、C2、…、Cn)和它们各自的数据集(D1、D2、…、Dn)希望训练一个模型。传统的方法是收集所有数据并进行总和Msum的训练。然而,在联邦学习中,包含了三个阶段:

1、中央服务器确定参与当前训练轮次的客户端,并传播现有的全局模型MFed。

2、每个参与的客户端Ci都独立计算一个本地模型,利用其本地数据集Di,包含ni个样本。随后,本地模型被传递到中央服务器。

3、中央服务器汇编来自每个参与客户端的本地模型并生成更新的全局模型MFed。如果这个新的全局模型的准确性满足预定的阈值,训练过程停止;否则,过程将继续进行到下一轮训练。

此外,被表示为VSum的MFed的准确性应该接近于Msum的准确性VSum。如果我们有

那么我们说联邦学习算法具有ϵ-准确性损失。

B. Blockchain

区块链是一种去中心化、分布式账本技术,它能够在节点网络上实现数据的安全、透明和防篡改存储[11]。区块链技术由一系列区块组成,每个区块包含一组交易或记录,与前一个区块进行了密码学链接。这种结构确保了数据的不可变性和完整性,因为要修改一个区块的内容,就需要修改所有后续的区块,这在计算上是不可行的。区块链技术的关键组成部分和特征包括:

1、共识算法:这些算法用于在参与节点之间就交易的有效性和分布式账本的状态达成一致[12]。常见的共识算法包括工作证明(PoW)、权益证明(PoS)和实用拜占庭容错(PBFT)。共识算法的选择对区块链网络的可扩展性、安全性和能源效率有重要影响。

2、密码学技术:区块链采用各种密码学技术,如哈希函数、数字签名和公钥基础设施(PKI),以确保数据的安全性、机密性和不可否认性[13]。这些技术在保护存储在区块链上的数据的隐私和完整性方面起着至关重要的作用。

3、智能合约:这些是具有协议条款直接编写成代码的自执行合约。智能合约在区块链网络上运行,实现了预定义规则和条件的去中心化、无信任执行[14]。它们可以用于以安全、透明的方式自动化各种流程,如验证、认证和数据共享。

4、公共和私有区块链:公共区块链,如比特币和以太坊,对任何人开放,允许透明和去中心化的数据存储和验证[15]。相比之下,私有区块链是有权限的,意味着只有经过授权的实体可以加入和参与网络。与公共区块链相比,私有区块链通常提供更高的可扩展性、隐私性和控制性。

由于区块链技术具有可追溯性、安全性和去中心化等内在特性,因此特别适用于保护联邦学习系统。通过利用区块链技术,我们的防御框架能够有效地保护学习过程中使用的数据和模型更新的隐私和完整性,确保训练模型的整体可靠性和性能。

C. Gradient Inversion Attack in Federated Learning

在联邦学习中,梯度反转攻击(GIA)是一种复杂的对抗性攻击,其主要目标不仅是降低模型的性能,更关键的是从梯度中逆向工程原始训练数据[16]。这个过程被称为“反转”,因为其目标是从共享的梯度中重构私有数据。

在联邦学习期间,客户端根据其本地数据计算梯度更新 (∇L) 并将其传输到中央服务器。在梯度反转攻击中,攻击者的目标是利用这些梯度重构原始训练数据,从而侵犯隐私。这与仅仅反转学习过程或为了其他对抗性目标而操纵梯度是根本不同的。攻击者对于这种反转的方法可以被表示为一个寻求从梯度中推导数据近似的函数,超越了一般梯度或模型攻击中的简单操作。攻击者可以通过以下方式执行这种操作

其中,∇LA代表攻击者提交的恶意梯度更新,α和β是控制反转强度的攻击参数,而∇A是攻击者制作的额外对抗性梯度。

抵御梯度反转攻击需要实施强大的机制,以确保在参与设备之间共享的梯度更新的真实性和完整性。

D. Poison Attack in Federated Learning

毒化攻击是另一种针对联邦学习系统的对抗性攻击[7],攻击者会将经过精心设计的恶意数据样本(x∗,y∗)注入到训练过程中。这些毒化样本可以对全局模型的性能产生负面影响,并导致模型产生不正确的预测。

攻击者的目标是最大化损失函数 L(x∗, y∗, w),其中 w 是模型参数,以影响训练过程:

其中,λ是控制毒化效果强度的攻击参数,而 (x, y) 代表原始训练数据。

抵御毒化攻击需要开发方法来检测和排除贡献恶意数据样本的攻击者,并维护训练过程的完整性。

III. PROBLEM DEFINITION AND SYSTEM MODEL

在本节中,我们定义了我们所提出的防御框架旨在解决的问题,并呈现了支撑我们方法的系统模型。问题定义侧重于在联邦学习系统中防御梯度反转攻击和毒化攻击,而系统模型则提供了构成所提框架的组件和相互作用的概述。

A. Problem Definition

我们防御框架的主要目标是在物联网(IoT)背景下保护联邦学习系统免受梯度反转攻击(GIA)和毒化攻击(PA)。具体而言,我们致力于:

• 阻止对手通过操纵其设备提交的梯度更新来逆转学习过程,从而导致全局模型性能的恶化,并危及整个系统的安全性。

• 识别并排除将恶意数据样本引入训练过程的攻击者,从而导致全局模型生成不准确的预测,进而影响其性能。

存在众多客户端 < C1, C2, …, Cn >,每个客户端最初在区块链网络中注册。在从区块链网络中获取模型后,它们开始联邦学习训练过程以获取结果集 ⟨C_ID, epoch, Gradient, ID⟩。CID代表客户端的ID,而epoch和Gradient是更新全局模型的关键组件。术语ID指的是区块ID。

然而,正如先前提到的,一些在区块链网络内的攻击者将尝试使用梯度反转攻击从梯度中提取私人信息。此外,可能有一些攻击者利用毒化攻击并上传毒化集 ⟨CID, epoch, A(Gradient), ID⟩。

为了实现这些目标,我们采用了区块链技术和差分隐私技术的组合,以确保在联邦学习过程中使用的梯度更新和数据样本的完整性和真实性。

B. System Model

我们提出的防御框架由多个组件和相互作用组成,共同为联邦学习系统提供强大的防护,抵御梯度反转攻击和毒化攻击。系统模型包括以下元素:

• Clients(客户端):参与联邦学习过程的物联网设备集合,本地生成和处理数据。每个客户端根据其本地数据计算梯度更新,并与区块链网络共享集合 ⟨CID, epoch, Gradient, ID⟩。

• Smart Contract(智能合约):在区块链网络的背景下,智能合约是一个程序,旨在在网络上独立执行预定义的逻辑。本研究提出了一个启用智能合约的系统,其中客户端可以使用智能合约使用差分隐私随机梯度下降(DPSGD)训练本地模型,同时在上传集合 ⟨CID, epoch, Gradient, ID⟩ 时也整合了 DPSGD。此外,智能合约可以检测试图进行毒化攻击的攻击者。

• Public Blockchain(公共区块链):一个去中心化且透明的账本,用于通过智能合约保护由客户端上传的梯度信息。公共区块链对梯度更新进行完整性和真实性检查,确保其有效性。

• Private Blockchain(私有区块链):在联邦学习过程中使用的一个受权限控制和安全的账本,直接保护梯度。与公共区块链相比,私有区块链提供了额外的隐私和安全保障。

• Differential Privacy Stochastic Gradient Descent(差分隐私随机梯度下降,DPSGD):一种应用于梯度更新的隐私保护技术,旨在保护其免受梯度反转攻击(GIA)的影响。DPSGD向梯度更新引入校准的噪音,确保强大的隐私保护同时维持模型性能。

• 公共和私有区块链集成:我们的框架采用了双区块链方法,整合了公共和私有区块链,以加强联邦学习(FL)过程中的隐私和安全性。公共区块链在安全上传梯度信息方面发挥关键作用。利用智能合约确保了由客户端传输的梯度数据的完整性和真实性。这些智能合约被设计成能够自动执行安全策略,从而保护梯度信息免受未经授权的访问和操纵。

相反,私有区块链直接用于联邦学习过程。其主要功能是为梯度提供额外的隐私和安全层。通过受限的访问控制,确保只有在FL过程中得到授权的参与者才能访问或修改梯度数据。私有区块链的受权限控制性质允许更多受控制并且安全的数据处理,与公共区块链的更广泛可访问性相辅相成。

这种双区块链结构促进了信息、控制和安全机制在两个链之间的无缝流动。公共区块链提供了梯度数据的透明度和广泛验证,而私有区块链为在FL过程中处理敏感数据提供了安全和私密的环境。通过整合这两种类型的区块链,我们的框架实现了透明性、安全性和隐私性的平衡,这对于实现有效且安全的联邦学习至关重要。

这些组件的相互作用建立了我们防御框架的基础,其目标是在联邦学习系统中提供全面的梯度反转攻击和毒化攻击防护。通过整合区块链技术和差分隐私方法,我们的框架确保了参与学习过程中的数据和梯度更新的安全性和隐私性,最终提高了训练模型的整体可靠性和性能。

IV. PROPOSED SYSTEM

A. Overview

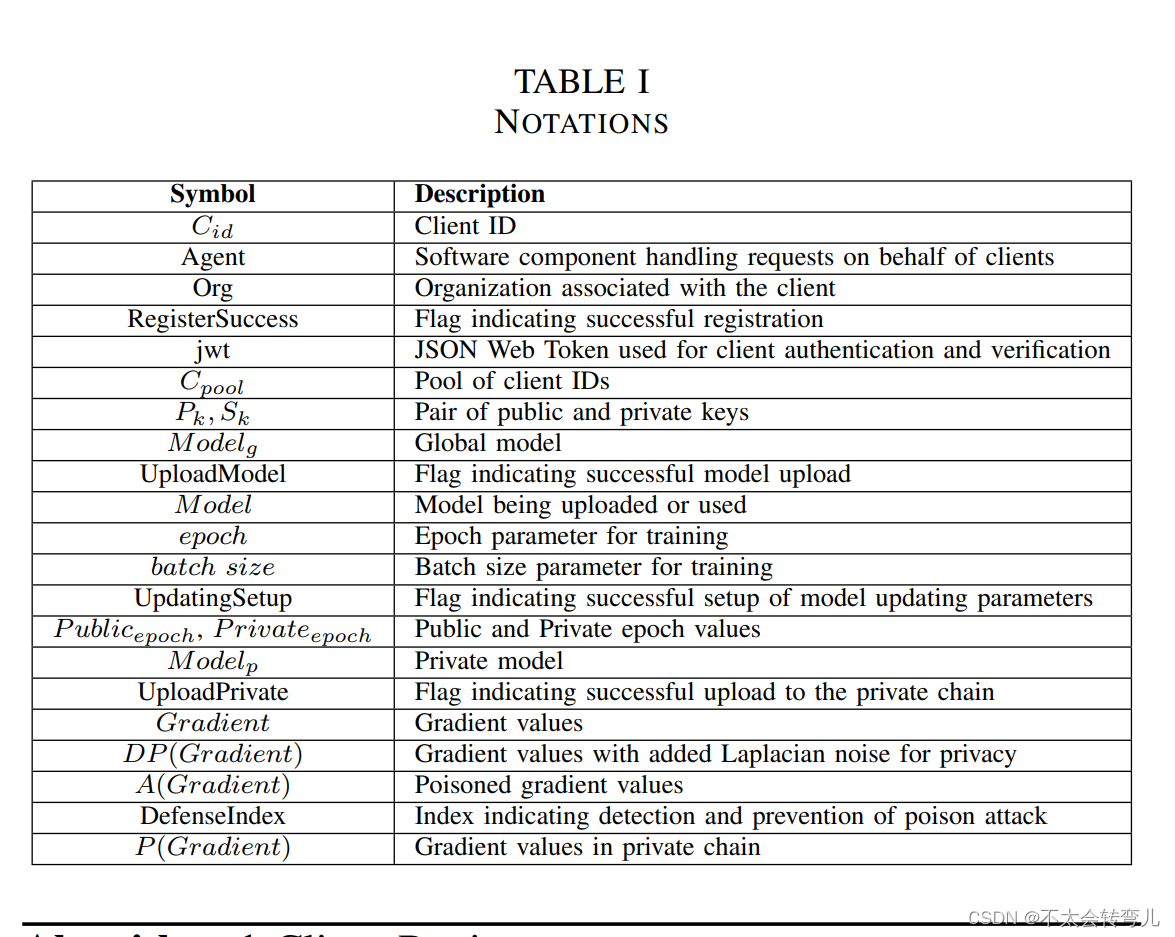

所提出的隐私保护联邦学习框架旨在促进安全高效的模型更新和训练,同时保持敏感数据的机密性和隐私性。该系统同时使用公共区块链和私有区块链来抵御恶意攻击,并确保结果集的安全存储和跟踪。多个算法协同操作,创建一个强大而高效的基于区块链的联邦学习系统。图1展示了我们提出的系统的综合概览。我们的系统中有两种不同类型的区块链网络,即公共区块链和私有区块链。在我们提出的系统中,使用了不同级别的隐私保护。有关算法的更多详细信息将在第IV-B节中提供。表I中总结了一些必要的符号。

B. Implementation of our designed system

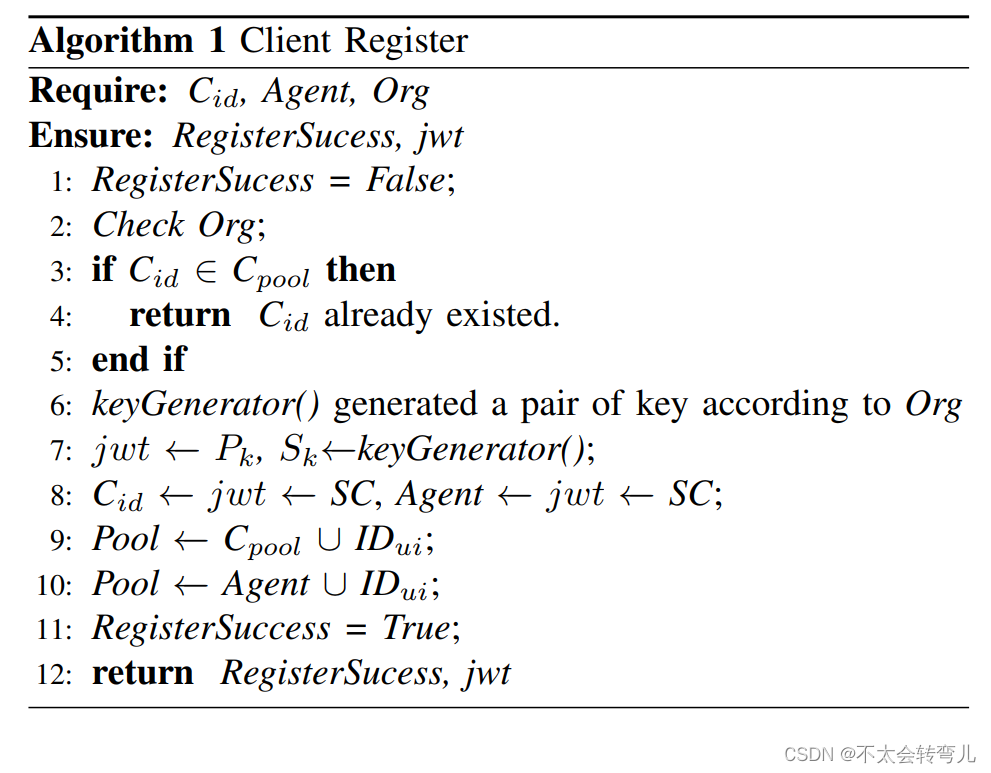

(1)、注册:客户端和Agent(处理客户请求的软件组件)必须最初在区块链网络中注册,以参与公共区块链。算法1概述了客户端注册过程,该过程允许客户端和Agent 加入网络。

最初,RegisterSuccess标志被设置为false,智能合约(SC)验证组织(Org)是否存在。如果Cid已经存在于客户端ID池(Cpool)中,该算法返回错误消息。否则,keyGenerator使用Org生成一对公钥和私钥。JSON Web Token(JWT)是一种数字签名,用于对客户端进行身份验证和验证其身份,通过将生成的公钥和私钥分配给Agent和Cid来创建。客户端ID和Agent被添加到注册客户池中,并将RegisterSuccess标志设置为true。然后,该算法返回RegisterSuccess标志和JWT。这个过程通过采用适当的身份验证措施,实现了客户端的安全注册。

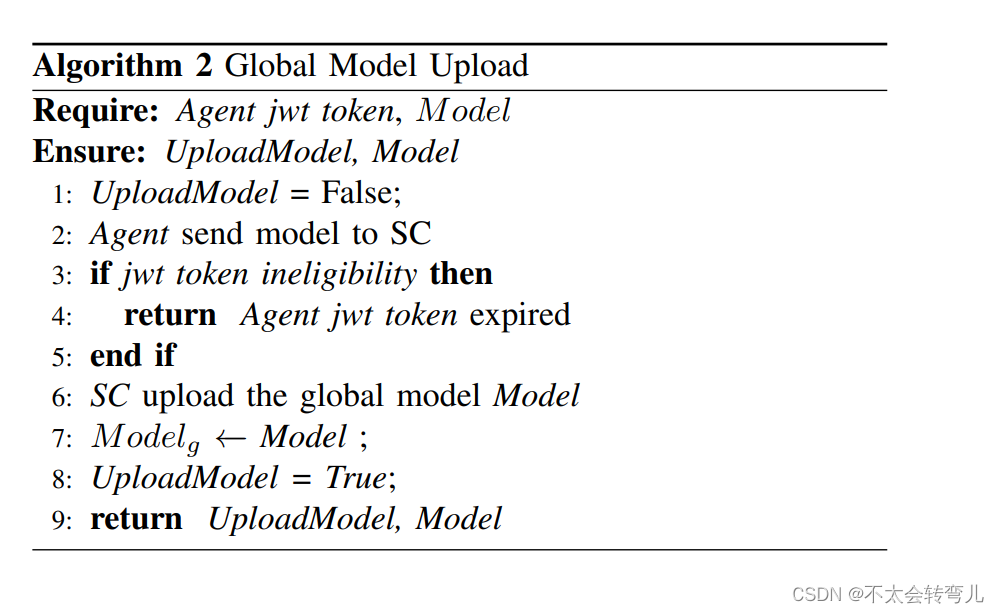

(2)、全局模型上传:在区块链网络中成功注册后,Agent 可以上传全局模型。算法2描述了全局模型上传过程,使 Agent 能够将全局模型上传到网络。算法的输入参数包括 Agent 的JWT令牌和要上传的全局模型(Modelg)。算法的输出包括成功标志UploadModel和已上传的全局模型(Model)。

最初,UploadModel标志被设置为false,Agent 将全局模型提交给智能合约(SC)进行上传。如果 Agent 提供的JWT令牌无效,算法将返回一个错误消息,指示代理的JWT令牌已过期。如果JWT令牌有效,则SC将全局模型上传到网络。然后将全局模型存储为Modelg,并将UploadModel标志设置为true。最后,算法返回UploadModel标志和已上传的全局模型。该过程确保了在采取适当的身份验证措施的情况下,将全局模型安全地上传到网络。

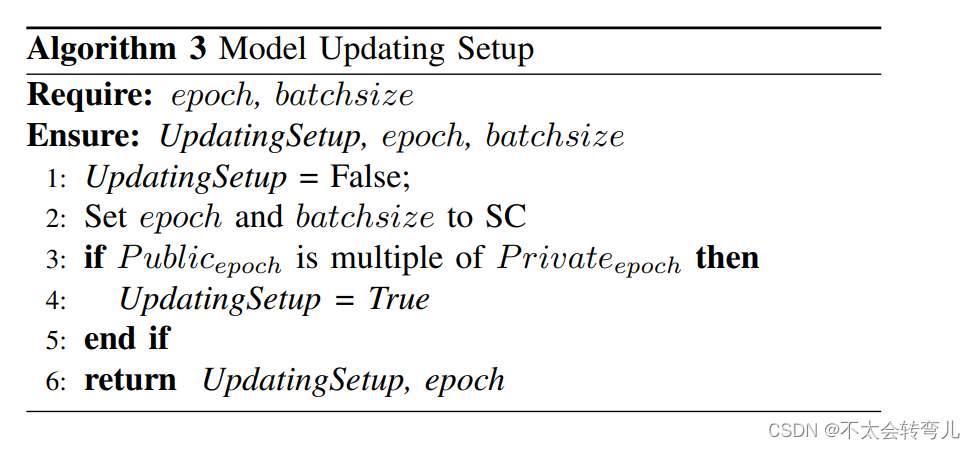

(3)、模型更新设置:在完成全局模型设置后,建立联邦学习训练过程的 epoch 设置是至关重要的。算法3概述了模型更新设置过程,确定了模型训练所需的 epoch 和 batch size 参数。算法的输入参数包括 epoch 和 batch size,输出包括成功标志UpdatingSetup和时代参数。

在步骤1中,UpdatingSetup标志被设置为false。然后在智能合约(SC)中建立epoch 和batch size参数。如果 Public epoch value 是 Private epoch value 的倍数,则将UpdatingSetup标志设置为true。通过验证此条件,确保Private epoch value除以Public epoch value 时没有余数,表示私有模型训练与全局模型更新同步。最后,算法返回UpdatingSetup标志和时代参数。这个过程通过保持私有和公共epoch值之间的同步,有助于确保模型训练的准确性和一致性。

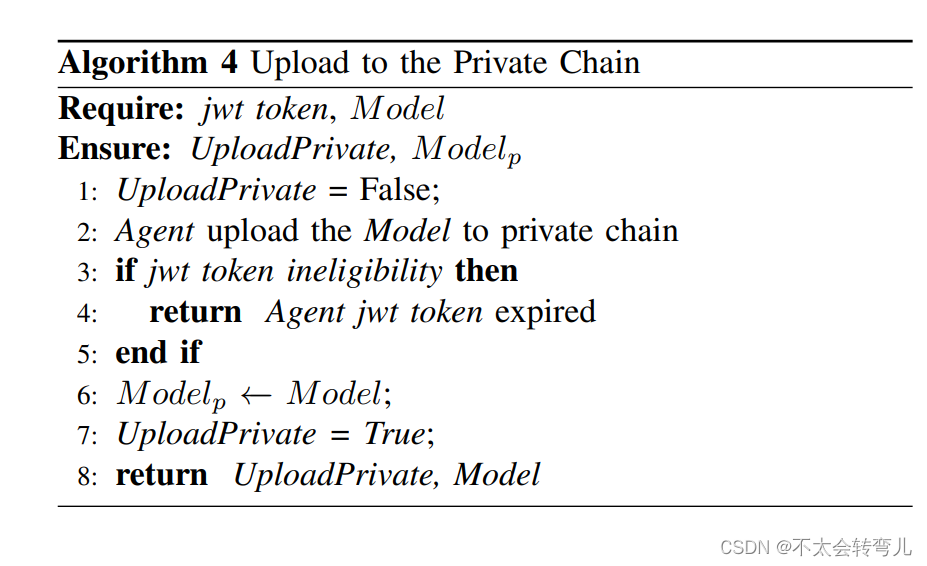

(4)、私有链的建立:算法4描述了创建私有链并将模型上传到其中的过程。算法的输入参数包括 Agent 的JWT令牌和要上传的私有模型(Model)。算法的输出包括成功标志UploadPrivate和已上传的私有模型(Modelp)。

最初,UploadPrivate指示器被设置为false,Agent 将模型上传到私有链(步骤1-2)。在此过程中还需要进行身份验证过程(步骤3-5)。如果JWT令牌有效,则模型将存储为私有链中的Modelp。随后,将UploadPrivate指示器设置为true,算法返回UploadPrivate标志和已上传的私有模型。这个过程有助于在私有链上安全存储私有模型,确保机密性和数据隐私。

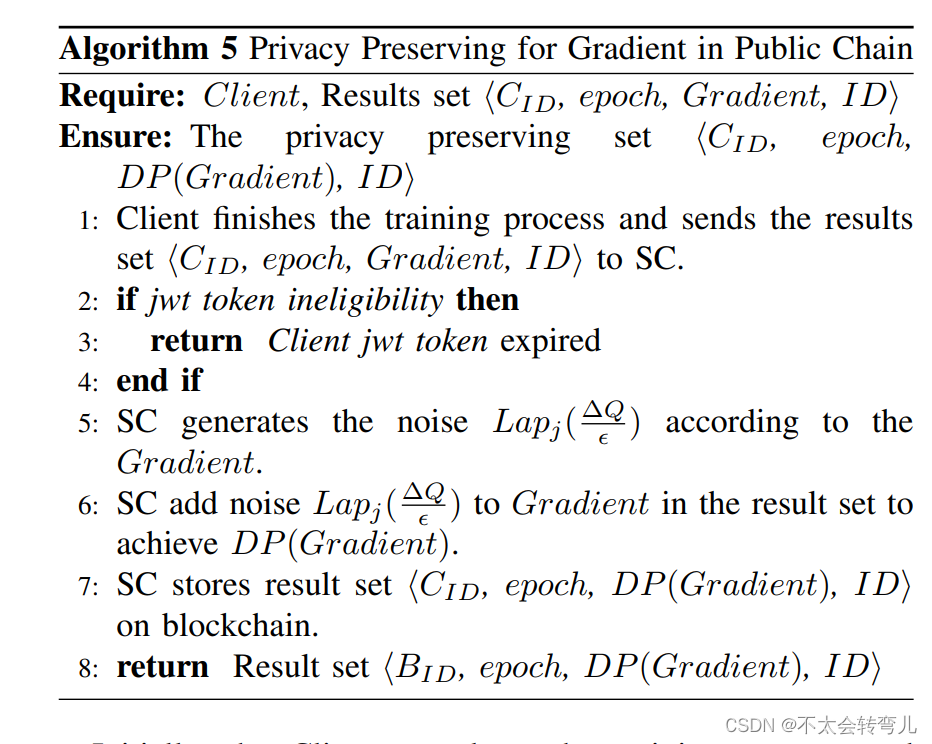

(5)、在公共链中的隐私保护:为了防范梯度反转攻击,我们提出了算法5,详细介绍了我们如何在公共链级别对抗这种攻击。算法的输入参数包括客户端和包含梯度值的结果集⟨CID,epoch,Gradient,ID⟩。算法的输出包括隐私保护结果集⟨CID,epoch,DP(Gradient),ID⟩,其中DP(Gradient)表示为了隐私保护而添加了拉普拉斯噪声的梯度值。

最初,客户端完成训练过程并将结果集⟨CID,epoch,Gradient,ID⟩发送到智能合约(SC)。然后启动身份验证过程。如果JWT令牌有效,则SC基于梯度值生成Laplacian噪声Lapj(∆Q/ϵ),并将其添加到结果集中的梯度值,以实现DP(Gradient)(步骤5-6)。SC将隐私保护结果集⟨CID,epoch,DP(Gradient),ID⟩存储在区块链上进行安全存储和跟踪。最后,算法返回隐私保护的结果集⟨BID,epoch,DP(Gradient),ID⟩。该过程确保在公共链中对梯度值进行隐私保护,保护敏感数据的机密性和隐私。

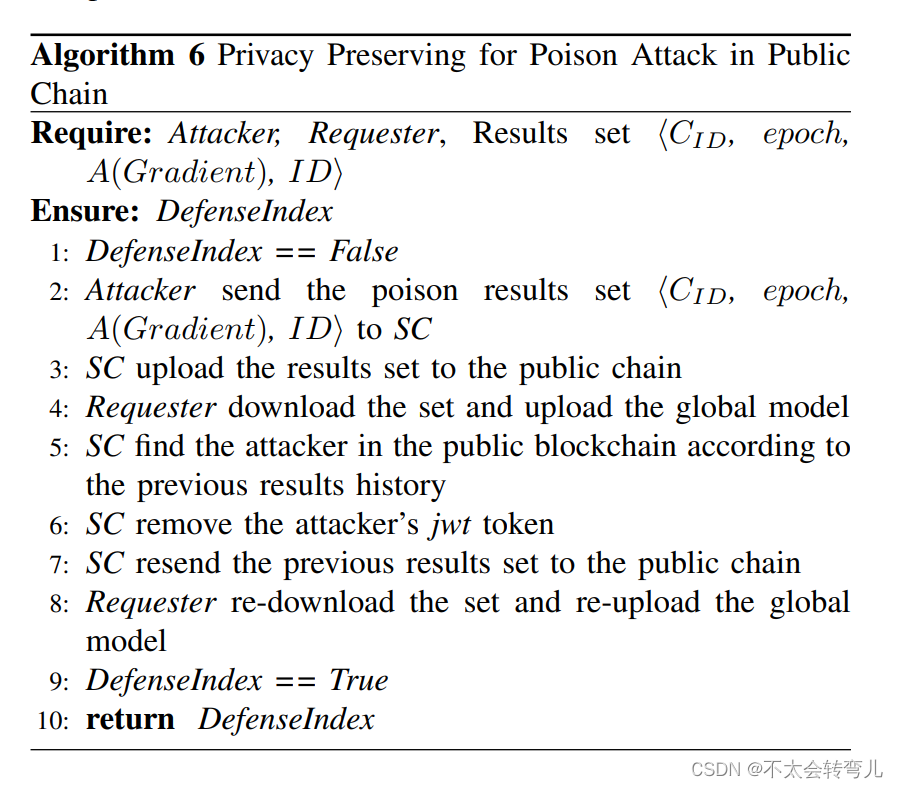

(6)、对抗投毒攻击的隐私保护:算法6概述了在公共链中对投毒攻击进行隐私保护的过程。我们利用区块链的可追溯性来防御投毒攻击。算法的输入参数包括攻击者、请求者和包含毒性梯度值的结果集⟨CID,epoch,A(Gradient),ID⟩。算法的输出是一个DefenseIndex,指示是否成功检测和阻止了毒性攻击。

最初,DefenseIndex被设置为false。攻击者发送包含A(Gradient)的毒性结果集到智能合约(SC),后者将结果集上传到公共链。请求者下载结果集并上传全局模型。随后,SC检查公共区块链上的先前结果历史以识别攻击者。如果攻击者被识别,SC将删除攻击者的JWT令牌并重新将先前的结果集发送到公共链。然后,请求者重新下载结果集并重新上传全局模型。

如果检测到并阻止了毒性攻击,DefenseIndex将被设置为true,并且算法将返回DefenseIndex。该过程确保检测和阻止毒性攻击,保护数据的安全性和完整性,阻止恶意行为。

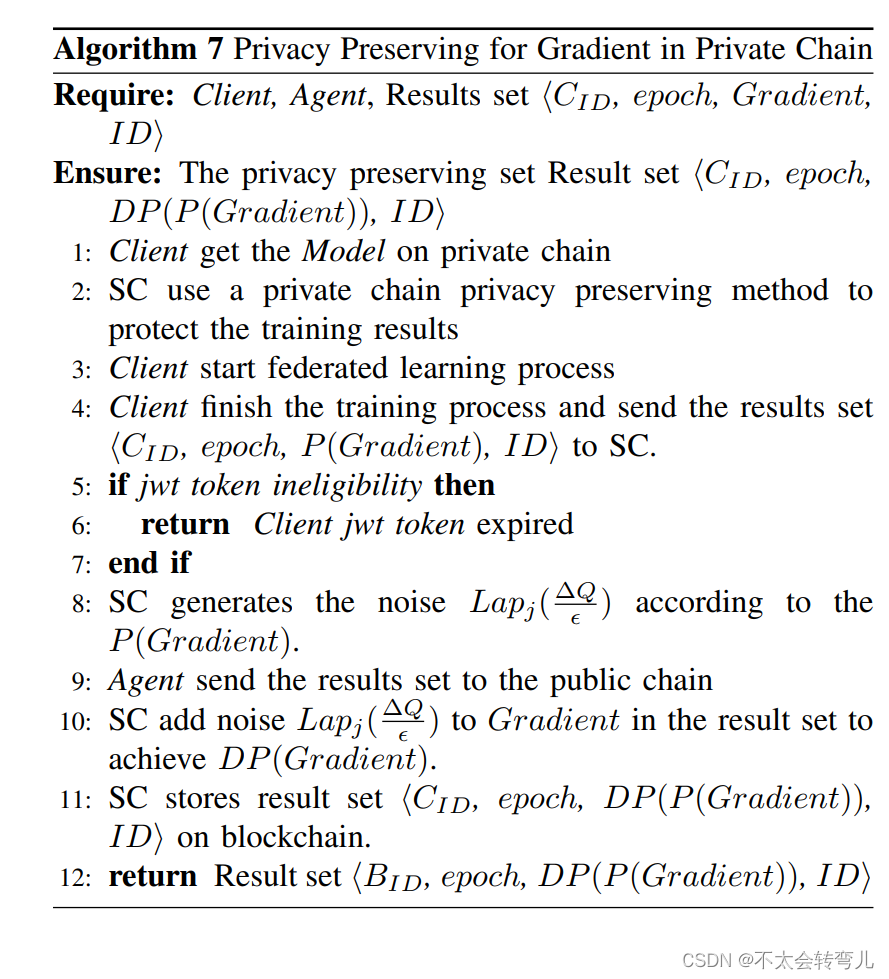

(7)在私有链级别进行梯度的隐私保护:算法7概述了在私有链级别对梯度进行隐私保护的过程。算法的输入参数包括客户端和Agent,以及包含梯度值的结果集⟨CID,epoch,Gradient,ID⟩。算法的输出是一个隐私保护结果集⟨CID,epoch,DP(P(Gradient)),ID⟩,其中DP(P(Gradient))表示添加了拉普拉斯噪声以进行隐私保护的梯度值。

起初,客户端从私有链中检索模型并开始联邦学习过程。在训练过程完成后,客户端将包含梯度值的结果集⟨CID,epoch,P(Gradient),ID⟩发送到智能合约(SC)。如果客户端提供的jwt令牌无效,算法将返回一个错误消息,说明客户端的jwt令牌已过期。如果jwt令牌有效,SC将基于P(Gradient)生成Laplacian噪声Lapj (∆Q/ϵ)。

随后,Agent 将结果集发送到公共链。SC将拉普拉斯噪声添加到结果集中的梯度值,得到DP(Gradient)。SC将隐私保护的结果集⟨CID,epoch,DP(P(Gradient)),ID⟩存储在区块链上,以实现安全存储和跟踪。

总之,该算法返回隐私保护的结果集⟨BID,epoch,DP(P(Gradient)),ID⟩。这个过程确保了在私有链中的梯度值的隐私保护,保护了敏感数据的机密性和隐私。

V. PRIVACY, SECURITY AND TIME ANALYSIS

A. Privacy Analysis

在本节中,我们对提出的基于区块链和差分隐私的框架进行了全面的隐私分析,以防范在联邦学习(FL)中的梯度反转攻击(GIA)和投毒攻击(PA)。我们的分析侧重于评估该框架在保护FL过程中使用的数据的隐私方面的能力,并评估实施的隐私保护技术在防止数据泄漏和未经授权的访问方面的有效性。

(1)、在联邦学习中的数据隐私:联邦学习通过确保原始数据保留在本地设备上,并且只有梯度更新在参与设备之间共享,从而天生地保护数据隐私。我们的框架在这种天生的隐私保护特性的基础上进行了进一步的增强,通过实施以下额外的措施来进一步保护数据隐私:

• 安全和私密的梯度更新:在提议的框架中,我们采用差分隐私随机梯度下降(DPSGD)来保护梯度更新。DPSGD通过向更新添加精心校准的噪声,确保在设备之间共享的梯度更新是安全和私密的,从而提供了强有力的隐私保证。这种技术在不显著损害模型性能的情况下保护了联邦学习过程中使用的数据的隐私。

• 公共和私有区块链集成:我们的框架利用公共和私有区块链的组合来增强隐私。公共区块链用于通过智能合约安全地上传梯度信息,而在联邦学习过程中,私有区块链用于直接保护梯度。这种双区块链方法增强了联邦学习过程中使用的数据的隐私和安全性。

(2)、基于区块链的框架中的隐私保护:除了固有于FL的隐私保护技术之外,我们提出的框架还整合了利用区块链技术和差分隐私特性的附加隐私增强机制:

• 智能合约的保密性:智能合约在我们的框架中自动执行安全策略的任务至关重要。为了保护智能合约处理的敏感信息的隐私,我们采用了加密技术,如零知识证明(ZKPs),以确保智能合约的执行不会向未经授权的方披露任何敏感数据。

• 匿名性和不可链接性:为防止对手将梯度更新与特定设备或用户关联起来,我们的框架利用了匿名化技术和安全聚合协议。这些机制确保了在FL过程中参与设备的身份保持匿名,使对手难以根据梯度更新推断出有关个体用户的敏感信息。

• 数据存储和访问控制:我们的框架通过实施分散化和加密的数据存储解决方案,如分布式哈希表(DHTs)或加密数据片段,来解决与数据存储和访问控制相关的隐私问题。此外,我们利用属性基加密(ABE)方案来执行细粒度的访问控制策略,确保只有授权的设备能够访问存储的数据。

总的来说,隐私分析表明我们提出的基于区块链和差分隐私的框架有效地保护了在联邦学习中使用的数据的隐私。通过利用加密技术、保护隐私的共识算法、安全的数据存储解决方案和差分隐私的结合,该框架确保敏感信息在整个联邦学习过程中免受未经授权的访问和数据泄露的威胁,从而最终提升了训练模型的整体安全性和可信度。

B. Security Analysis

在本节中,我们对提出的基于区块链和差分隐私的框架进行了深入的安全性分析,以应对联邦学习中的梯度反演攻击(GIA)和毒性攻击(PA)。我们的分析侧重于评估该框架在各种攻击场景下的强健性和抗击性,以及评估实施的防御机制在确保联邦学习过程中使用的梯度更新和数据样本的完整性和真实性方面的有效性。

(1)、Gradient Inversion Attack (GIA) 防御:我们的框架对抗 GIA 的安全性依赖于在 FL 过程中整合差分隐私随机梯度下降(DPSGD)以及使用公共和私有区块链。为了评估这一防御机制的有效性,我们考虑以下攻击场景:

• 对手提交篡改的梯度更新:在这种情景中,对手试图通过提交恶意修改的梯度更新来破坏学习过程。我们的框架使用 DPSGD 添加校准噪声到梯度更新,使得对手很难在不被检测到的情况下成功地篡改更新。此外,该框架利用公共区块链和智能合约确保上传的梯度信息的完整性和真实性。

• 对手尝试绕过 DPSGD:为了绕过 DPSGD 的保护,对手可能尝试通过利用添加的噪声来推断有关原始梯度的敏感信息。然而,DPSGD 提供了强大的隐私保证,使得对手极其困难地在不违反隐私约束的情况下恢复原始梯度。

(2)、毒性攻击(PA)防御:我们的框架对抗毒性攻击(PA)的防御得到了极大的加强,这是通过区块链技术支持的先进可追溯机制实现的。该机制不仅仅是安全的被动层面,而且是一个主动、动态的系统,能够准确追踪数据样本的来源,特别是那些被怀疑被恶意篡改或注入到训练过程中的样本。

该基于可追溯性的检测系统的关键组成部分包括:

• 数据来源跟踪:通过在区块链上记录每个数据样本的交易历史,我们的系统维护了一个不可变的记录,记录了数据样本从产生客户端到集成到全局模型的整个过程。这使得能够确定可能引入恶意数据的确切点。

• 算法检测机制:我们采用复杂的算法分析数据流和梯度中的模式,寻找可能表示毒性攻击的异常或不规律的迹象。这些算法设计用于识别篡改的明显和微妙迹象,确保在检测方面具有高度的敏感性。

• 排除过程:一旦检测到潜在的攻击,系统会自动启动一系列响应。这包括隔离受影响的数据,通知网络管理员,并在必要时排除相关客户端,阻止其继续参与学习过程。排除是通过智能合约协议实现的,无需手动干预。

• 持续学习和适应:可追溯性机制不是静态的,它随着每次交互而发展。利用机器学习技术,它不断改进其检测能力,适应新类型的毒性攻击和不断演变的威胁。

这种增强的基于可追溯性的检测系统在保持联邦学习过程的完整性方面至关重要。它确保迅速识别和中和通过毒性攻击企图损害模型的行为,从而保护受训模型的整体可靠性和安全性。

C. Time Complexity Analysis

在本节中,我们对我们提出的基于区块链的联邦学习IoT场景防御机制进行时间复杂性分析,考虑到在公共链和私有链上都使用DPSGD对梯度进行加密。

设n为参与联邦学习过程的客户端数量,t为全局模型收敛所需的迭代次数。对于每次迭代,每个客户端都会计算其本地模型更新,这涉及到O§的时间复杂性,其中p是模型参数的数量。

在计算完本地模型更新后,客户端使用DPSGD对其梯度进行加密。对于每个客户端,DPSGD的时间复杂性为O§,因为它涉及向每个梯度分量添加噪声。由于有n个客户端,对所有客户端应用DPSGD的总时间复杂性为O(n∗p)。

接下来,客户端将其加密的梯度提交到公共链和私有链。将交易提交到区块链的时间复杂性通常与交易数量成正比。然而,通过并行化交易的提交和处理,我们可以将此步骤的时间复杂性降低到O(1)而不是O(n)。

最后,使用来自公共链和私有链的聚合梯度更新全局模型。通过采用高效的聚合机制,我们可以保持此步骤的时间复杂性为O§。

综合考虑所有步骤并考虑并行化和优化策略,我们提出的每次迭代的防御机制的总体时间复杂性为O(np)。在t次迭代中,总时间复杂性为O(t(np)),这表明我们的方法与客户端数量、模型参数和迭代次数呈线性关系,为在IoT场景中保护联邦学习系统提供了实际而高效的解决方案。

VI. PERFORMANCE EVALUATION

进行了实证评估,以调查在物联网(IoT)应用的联邦学习环境中使用区块链技术的差分隐私方法的有效性。我们的研究考察了所提出系统在防御梯度反转和毒性攻击方面的性能。实验设置、获得的结果以及它们的分析分别在第 VI-A 和 VI-B 节中呈现。

A. Experiment Configuration

这项研究旨在模拟在物联网网络环境中利用区块链平台进行差分隐私联邦学习培训过程。我们的实验设置侧重于边缘计算环境,在这里,物联网系统通常由有限但特定数量的边缘设备(节点)组成。在这种情境下,我们的方法涉及较少的边缘节点,与面向公众的区块链系统相比,反映了物联网应用中更现实的部署场景。

• Gradient Inversion Attack Setup: 梯度反转攻击(GIA)的设置旨在测试防御机制对复杂对抗攻击的效果。在这个设置中,我们让32个用户参与联邦学习过程,这个数字反映了物联网网络中的一个现实场景。初始学习率设为0.05,以促进平衡的模型更新过程。学习率减小的因子也是0.05,确保学习率的逐渐和受控的调整。通过设置批处理大小为128,我们旨在在计算效率和梯度准确性之间取得平衡。实验运行200个epochs,为模型有效学习提供充分的迭代次数。我们采用ResNet18模型,以测试其在图像分类中的效率,为GIA提供相关而具有挑战性的测试平台。

• Poison Attack Setup: 对于投毒攻击设置,我们涉及100个用户来模拟一个更大规模的攻击场景,这在公共区块链环境中是典型的。这个设置旨在评估框架检测和对抗数据篡改的能力。参与投毒攻击的客户比例设置为0.1,表示对抗性参与的现实比例。I.I.D状态设置为true,确保客户之间有均匀的数据分布。对于MNIST,epoch范围为10到100,而对于CIFAR-10,epoch范围为10到200。选择这些范围是为了在不同的训练持续时间下测试框架。我们使用MLP模型进行MNIST,使用CNN模型进行CIFAR-10,与这些数据集的标准保持一致,以确保我们的发现的相关性。

• 软硬件配置: 软件和硬件选择对于准确模拟联邦学习和区块链环境至关重要。我们选择Hyperledger Fabric Version 2.X,因为它在区块链应用中表现出色。硬件设置是Intel® Xeon® Gold 6238R CPU @ 2.20GHz,带有86 GB的LPDDR4内存,被选择是因为它能够有效处理联邦学习过程和区块链操作的计算需求。

这些详细的配置提供了对我们实验设置的清晰而全面的了解,提高了我们研究的透明度和可重复性。它们还为在我们提出的框架内理解和验证实验结果提供了深入的基础。

B. Gradient Inversion Attack Defense Performance

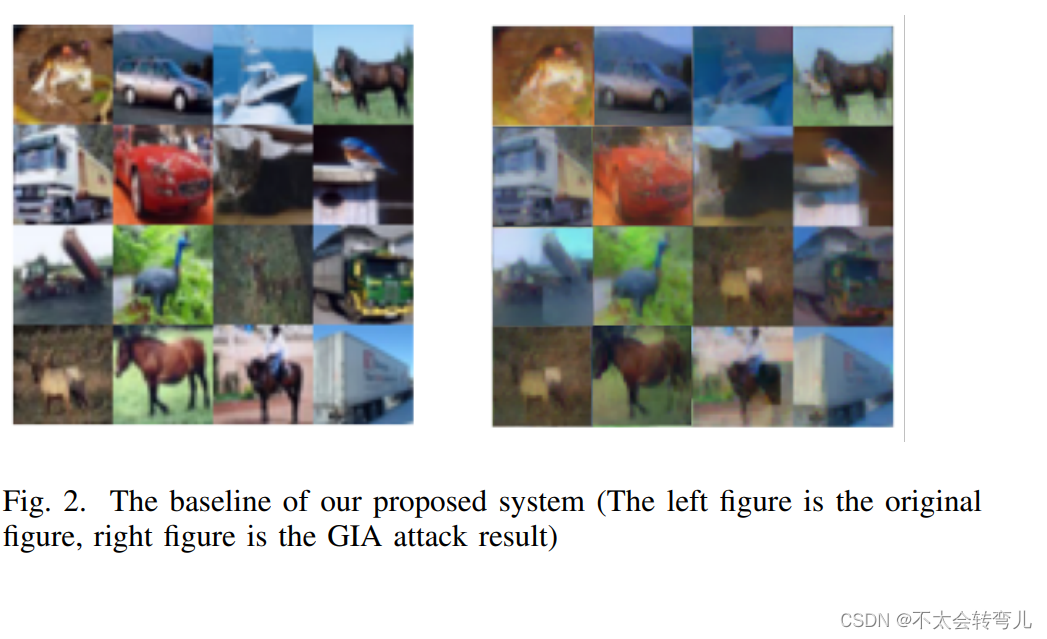

在这一部分,我们使用CIFAR10数据集评估我们提出的系统。图2展示了我们提出的系统的基线架构。如图所示,在没有任何保护和防御机制的情况下,攻击者可以通过梯度逆转攻击轻松恢复数据集。

然而,当我们提出的系统被实施用于抵御梯度攻击时,结果显著不同。这可以归因于我们提出的系统中采用的两个不同级别的隐私保护,即公共链级别和私有链级别。我们在研究中分别呈现了这两个保护级别的结果。此外,我们的分析假设攻击者不知道受害者批次的私有BatchNorm统计信息或私有标签,并考虑攻击者具有这些信息的情况[17]。

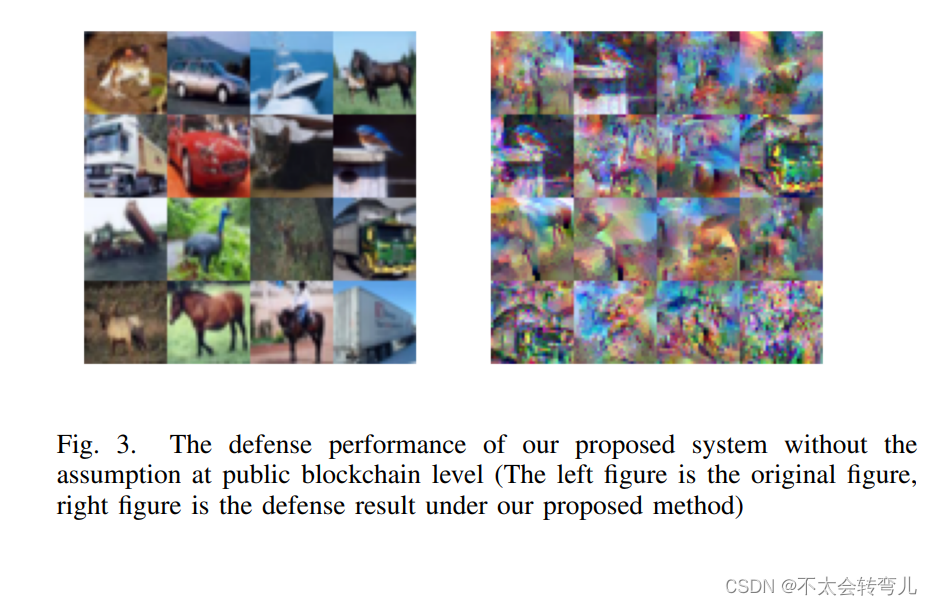

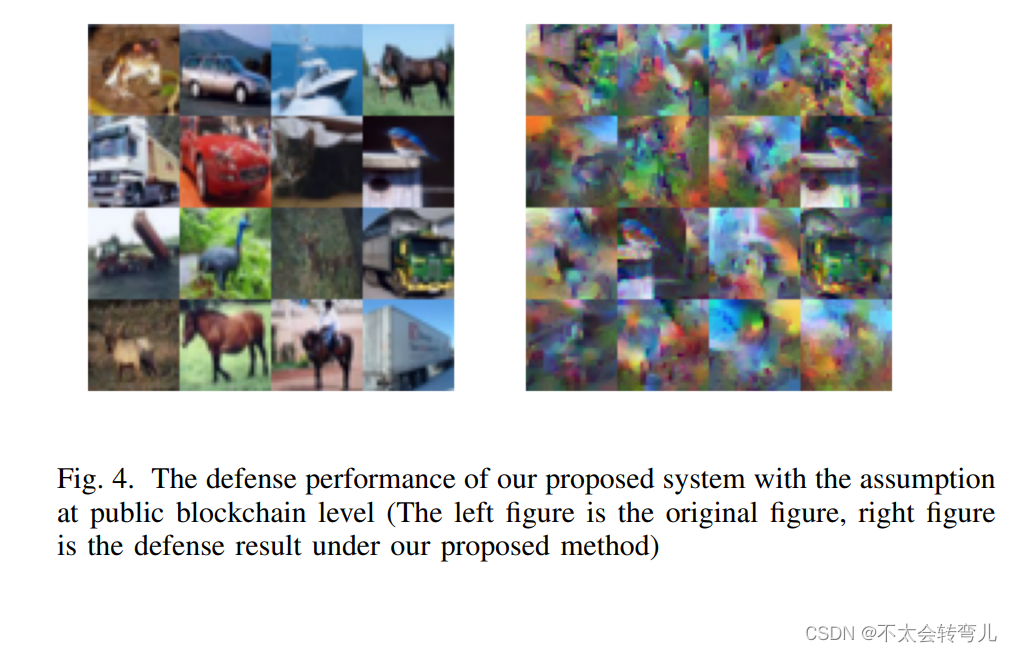

• 公共区块链级别的保护:公共区块链级别的保护采用算法5来抵御梯度反转攻击。在这个情境中,智能合约旨在保护客户提交到公共区块链的结果集。

图3展示了当攻击者缺乏对受害者批次的私有BatchNorm统计信息或私有标签的了解时的结果。该图展示了我们的公共区块链级别保护的有效性,因为攻击者几乎无法从中恢复原始数据。只有卡车的图像与原始数据集相似。

相反,图4说明了攻击者了解底层假设的情况。此图中的结果更为可辨认;然而,攻击者仍然无法从梯度中恢复数据。只有鸟的图像与原始图像相似。因此,我们提出的系统似乎成功地在公共区块链级别抵御了梯度攻击,无论攻击者是否了解受害者批次的私有标签。

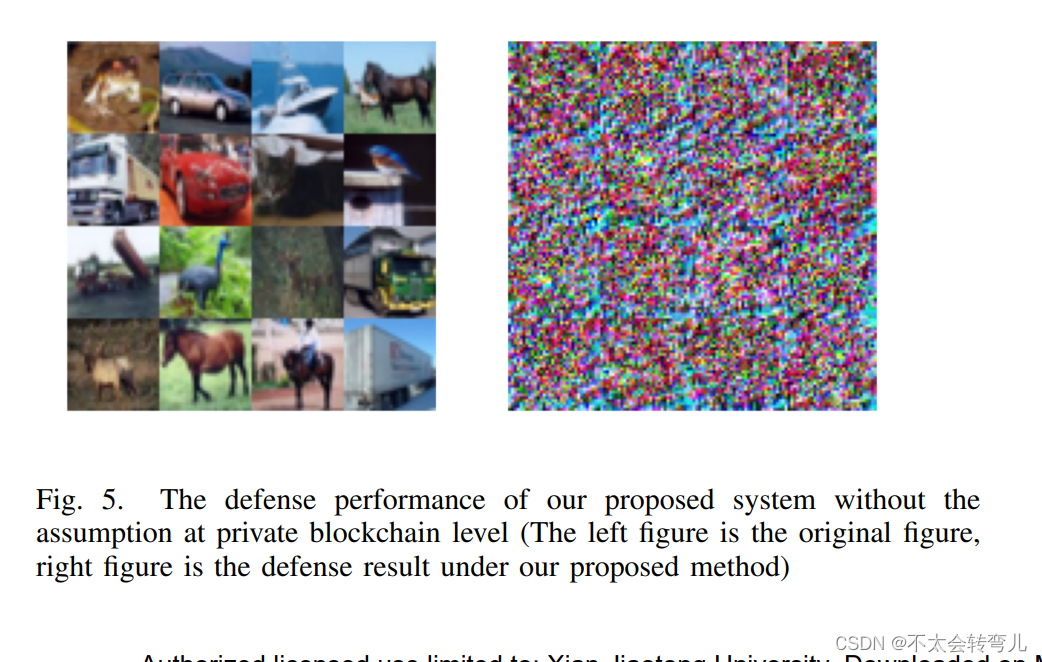

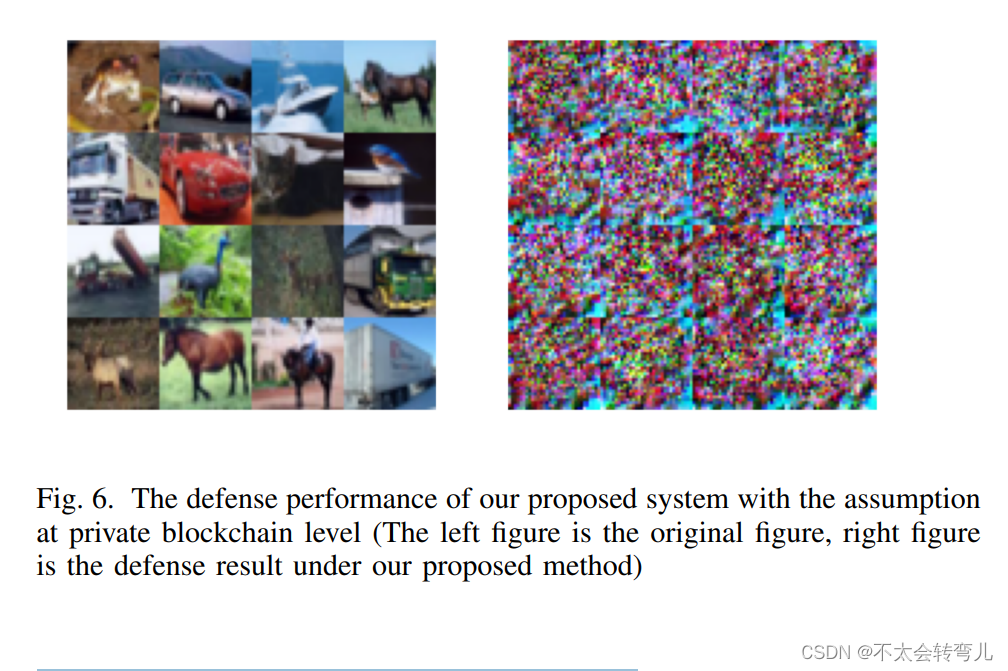

• 私有区块链级别的保护:关于私有区块链级别的保护,智能合约不仅采用公共链隐私保护机制,还在客户进行联邦学习训练过程时整合了DPSGD保护方法。类似于公共链级别的保护,图5展示了在攻击者对假设一无所知的情况下的结果。该图显示攻击者无法从梯度中重建图像。图6展示了当攻击者了解底层假设时的结果。该图表明,无论攻击者是否了解受害者批次的私有BatchNorm统计信息和私有标签,从梯度中重建原始数据仍然具有挑战性。这是由于私有链保护方法提供的保护效果。

C. Poison Attack Defense Performance

在本节中,我们展示了我们提出的系统在防御投毒攻击方面的功效。分析采用了两个不同的数据集,即MNIST和CIFAR10,如前所述。我们根据两个方面对我们的系统进行评估:每个epoch 的训练损失和最终结果的准确性。

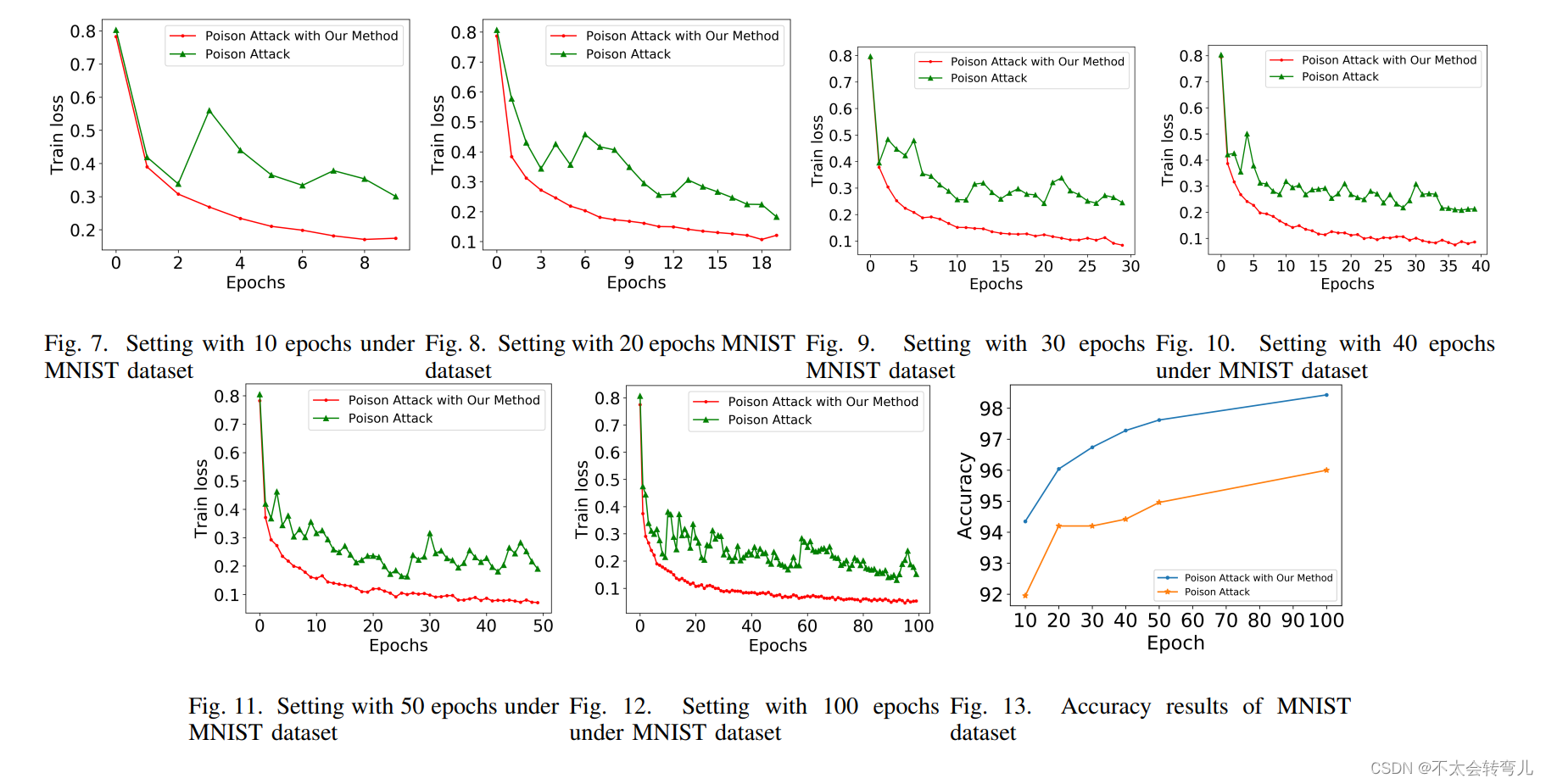

• MNIST数据集:对于MNIST数据集,我们检查第10、30、40、50和100个epoch,以显示每个epoch的训练损失。图中的红线代表了在毒性攻击下正常系统的结果,而绿线对应于集成了我们提出的区块链防御方法的系统。如图7-12所示,无论epoch数是10还是100,训练损失都发生了显著波动。即使在100个epoch之后,原始系统的训练损失也没有降到0.2以下,主要是由于联邦学习中的毒性攻击导致训练损失波动。从图13中可以得到更多关于准确性的见解。

在图13中,我们观察到我们提出的方法和原始系统在第10和20个epoch之间的准确性迅速提高。然而,在20个epoch之后,两种方法的准确性增长速率减缓。在第20到30个epoch期间,普通方法甚至呈现出准确性下降的趋势。经过100个epoch后,我们提出的方法实现了98.43的准确性,而正常系统记录了96的准确性。

• CIFAR10数据集:对于CIFAR10数据集,我们考虑了第10、20、30、40、50、100和200个epoch,展示了每个epoch的训练损失。与MNIST数据集的结果相比,在图14-20中,原始系统表现出更强烈的波动。从这些图中可以明显看出,我们提出的方法在第10到200个epoch之间具有更快的收敛速度、更低的训练损失和更少的波动。特别是在图19和图20中,随着epoch数的增加,普通系统在训练损失结果中显示出显著的波动,仅有有限的下降。与前一个数据集类似,我们为CIFAR10数据集提供了准确性图,以提供更详细的结果。

在图21中,我们注意到我们提出的系统的准确性趋势逐渐增加,而原始系统的准确性波动。在第50和150个epoch时,原始系统的准确性显著下降。在第50个epoch时,我们提出的系统的准确性达到了55.91,而原始系统的准确性仅为35.12。在第150个epoch时,我们提出的系统的准确性达到了62.58,而原始系统的准确性仅为36.16。最终,在第200个epoch时,我们提出的系统的准确性达到了65.2,而原始系统的准确性为49.59。

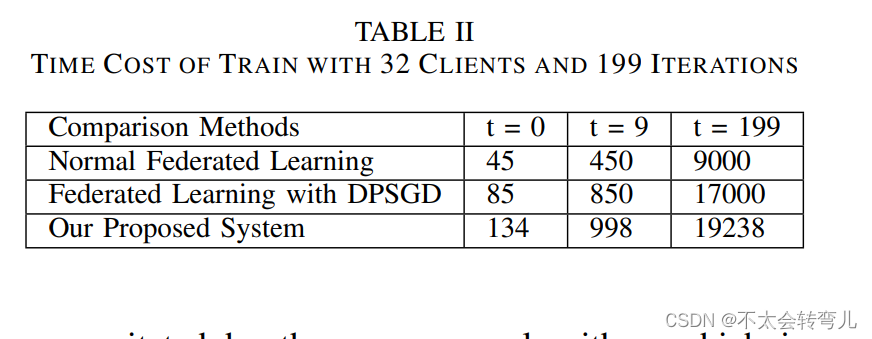

D. Blockchain Platform Time Cost

在本节中,我们呈现了区块链平台时间成本的实验结果,该结果评估了我们提出的基于区块链的联邦学习IoT场景防御机制在使用Hyperledger Fabric 2.X时的效率。我们的实验得出了以下观察结果:

• 区块链网络建立时间:建立整个区块链网络,包括通道、节点和排序节点的初始化,大约需要35秒。这个设置时间是系统初始化的一次性成本,对于实际的联邦学习IoT应用来说是可以接受的。

• 共识过程:与共识过程相关的时间取决于区块链平台中实现的特定共识算法。在我们的研究中,在建立了区块链网络之后,共识算法需要所有节点的认可,这产生了大约3秒的时间成本。我们的研究结果表明,在我们的联邦学习IoT场景中,共识过程产生的时间成本是相当可接受的。

• 事务处理时间:处理和提交交易的时间,包括在公共链和私有链上进行本地模型更新和梯度聚合,大约为2秒。这表明Hyperledger Fabric 2.X在处理我们提出的防御机制中的交易方面非常高效。

• 梯度更新加密时间:使用DPSGD对梯度更新进行加密的时间成本约为1秒。这表明我们的防御机制在不给学习过程增加显著开销的情况下有效地整合了隐私保护技术。

表II呈现了时间成本分析的结果,包括普通联邦学习、带有DPSGD防御的联邦学习以及我们提出的方法的比较。在第一次迭代完成后,普通联邦学习的时间成本记录为45秒,带有DPSGD防御的联邦学习产生85秒的时间成本,而我们提出的系统报告的时间成本为134秒。与带有DPSGD防御的联邦学习相比,我们提出的系统观察到的增加的时间成本归因于我们的时间成本包括了建立区块链网络和对所有节点进行认可所需的时间。在t = 10时,分析结果表明我们提出的方法的时间成本更接近于普通联邦学习,后者的时间成本为998秒,而与带有DPSGD防御的联邦学习相比,后者产生850秒的时间成本。(这里有问题吧)

与Hyperledger Fabric 2.X区块链平台相关的时间成本在实际联邦学习IoT应用中处于可接受的范围内,即使客户数量和模型参数较多。这表明我们基于区块链的防御机制为保护联邦学习系统免受梯度反演和毒害攻击提供了一种高效且可扩展的解决方案,而不会显著影响学习过程的整体性能。

E. Analysis Conclusion

总的来说,我们提出的基于区块链的防御机制在联邦学习IoT场景中展现出对梯度反演攻击和毒害攻击的强大防御能力。对于梯度反演攻击,公共和私有区块链层面的保护与使用DPSGD加密梯度更新的结合,有效阻止了攻击者基于获取的梯度重构图像。至于毒害攻击,我们的系统展示了卓越的准确性结果和更稳定的训练损失收敛。

此外,我们的实验结果表明,与Hyperledger Fabric 2.X区块链平台相关的时间成本,包括网络设置、事务处理和梯度更新的加密,在实际联邦学习IoT应用中处于可接受的范围内。这表明我们的防御机制为保护联邦学习系统免受梯度反演和毒害攻击提供了一种高效且可扩展的解决方案,而不会显著影响学习过程的整体性能。

VII. RELATED WORK

A. Gradient Inversion Attack when Combing Federated Learning with Blockchain Networ(梯度反演攻击在将联邦学习与区块链网络结合时)

许多研究已经对梯度反演攻击及其潜在后果进行了深入研究。Geng等人[18]开发了一个通用的梯度反演攻击框架,用于FedSGD和FedAVG,提出了在不牺牲效用的情况下的防御策略。然而,我们的防御框架集成了区块链技术和差分隐私,为物联网场景提供了更全面和强大的解决方案。我们的方法解决了现有研究的局限性,确保在联邦学习过程中的安全性和隐私性,最终提高了经过训练的模型的可靠性和性能。

Madni等人[19]在使用基于区块链的Swarm Learning框架中解决了联邦学习中的数据隐私和梯度泄露问题。作者使用基于区块链的智能合约在经过身份验证的训练节点之间共享原始梯度。虽然Swarm Learning提出了一种有希望的解决方案,但我们提出的防御框架通过将差分隐私与区块链技术集成,进一步增强了安全性和隐私性。我们的方法在保护物联网场景中的梯度反演和毒化攻击的同时,通过向梯度添加噪音保护隐私,为保护联邦学习系统提供了更全面和实用的解决方案。

Fang等人[20]提出了一种基于区块链的隐私保护和可验证的联邦学习方法,以实现在不受信任的网络中完全分散和可靠的联邦学习。作者引入了一种安全的聚合协议来保证梯度的机密性,并采用了一种新颖的区块链结构进行全局梯度验证。尽管该研究为隐私保护的联邦学习提供了有价值的贡献,但我们提出的防御框架更进一步,通过整合差分隐私来更有效地保护梯度。此外,我们的方法在物联网场景中防御梯度反演和毒化攻击,确保在联邦学习过程中全面的安全性和隐私性。

Lu等人[21]提出了一种基于区块链的加密梯度审计方法,利用行为链记录加密梯度并使用审计链评估其质量。他们引入了一种隐私保护同态噪声机制,确保了聚合梯度的可用性,并设计了一种联合审计算法,能够在不解密个体梯度的情况下定位恶意数据所有者。尽管基于区块链的审计方法为评估加密梯度提供了有价值的解决方案,但我们提出的防御框架通过整合差分隐私来进一步增强梯度安全性。我们的方法还在物联网场景中防御梯度反演和毒化攻击,为联邦学习系统提供全面的安全性和隐私性。

Ji等人[22]提出了一种轻量级的区块链启用的联邦学习系统身份验证机制,名为LAFED。LAFED引入了一个轻量级的身份验证框架,一个具有零知识证明的灵活共识算法来验证参与者的身份,以及一个基于模型质量和节点贡献的自适应模型聚合算法,以提高性能。尽管LAFED为联邦学习提供了一种创新的轻量级身份验证框架,但我们提出的防御框架通过整合差分隐私进一步增强了隐私和安全性。我们的方法在物联网场景中防御梯度反演和毒化攻击,并对梯度添加噪声,为保护联邦学习系统提供了更全面和实用的解决方案。

Shayan等人[23]提出了Biscotti,这是一种完全去中心化、点对点的多方机器学习方法,利用区块链和密码原语协调对等客户端之间的隐私保护机器学习过程。他们旨在通过创建一个可扩展、容错的系统来解决与集中式基础设施相关的信任问题,该系统抵御已知攻击,包括毒化攻击。我们提出的防御框架也利用区块链技术来确保在物联网场景中的隐私和安全性,但引入了差分隐私等额外措施,以防范梯度反演和毒化攻击。通过向梯度添加噪声,我们的框架为保护联邦学习系统提供了更全面和实用的解决方案。

Khowaja等人[24]提出了一种近端梯度分割学习(PSGL)方法,以抵御在医疗物联网(IoMT)生态系统中的模型反演攻击。他们解决了现有方法的局限性,这些方法涉及向原始IoMT数据或模型参数添加噪声,因为这些技术通常会降低整体性能,并且对来自梯度的深层泄漏无效。相比之下,我们的防御框架将区块链技术与差分隐私相结合,以保护物联网场景中的梯度反演和毒化攻击。通过向梯度添加噪声,我们的方法为保护联邦学习系统提供了一种实用且全面的解决方案。虽然PSGL侧重于在IoMT生态系统中防御模型反演攻击,但我们的框架将保护扩展到更广泛的物联网场景,并抵御多种类型的攻击,为保护联邦学习过程提供更强大和多功能的解决方案。

B. Poison Attack when Combining Federated Learning with

Blockchain Network

也有大量研究致力于利用区块链技术防御毒化攻击。例如,Shinde等人[25]对区块链技术如何增强基于人工智能系统安全性进行了全面的文献计量和文献分析。他们强调了区块链和人工智能的互补性,区块链可以减轻人工智能中的漏洞,而人工智能则可以提高区块链的性能。该论文探讨了区块链在各个领域(如医疗保健、金融、能源、政府和国防)中保护智能应用的适用性。我们的工作与这项研究不同,我们提供了一个具体的防御框架,将区块链技术与差分隐私相结合,以防范物联网场景中的梯度反演和毒化攻击。

Unal等人[26]提出了一种将区块链技术与物联网系统中的联邦学习(FL)集成,以进行隐私保护和安全大数据分析的方法。作者提出使用模糊哈希来检测FL训练模型中的变化和异常,以防止模型毒化攻击。然而,我们的方法不仅确保训练模型的完整性,还解决了与共享梯度信息相关的隐私问题。通过广泛的实验证明了我们的方法的有效性,我们为在物联网场景中保护联邦学习过程提供了一个完整的解决方案,涵盖了更广泛的攻击类型。

Qi等人[27]提出了一种基于联盟区块链的联邦学习框架,用于在交通流预测中进行分散、可靠和安全的联邦学习,而无需中央模型协调器。该框架验证来自分布式车辆的模型更新,防止不可靠的更新,并将其存储在区块链上。为增强模型隐私性,该框架应用了带有噪声添加机制的差分隐私方法。我们的工作在将区块链技术和差分隐私结合以保护联邦学习系统方面与该研究有相似之处。然而,我们的框架处理梯度反演和毒化攻击,并设计用于更广泛的物联网应用。

Huang等人[28]提出了一种针对基于物联网的数字药丸健康监测系统中毒性攻击的防御方案,该方案利用联邦学习。所提出的方案结合了多个可信平台模块(TPM)和一个区块链预言机,以克服现有区块链和基于硬件的方法的局限性。分布式区块链预言机从多个TPM获得链下验证结果,使智能合约能够识别毒性攻击并维护非威胁物联网设备的白名单,这些设备作为联邦学习参与者。然而,我们的方法侧重于保护梯度更新免受反演和毒性攻击,并设计用于更广泛的物联网应用。通过为联邦学习系统提供全面的保护并通过广泛的实验证明其有效性,我们的方法展示了在超出健康监测范围的各种联邦学习应用的安全性和隐私性的潜力。

Chen等人[29]提出了一种动态异步防毒性联邦深度学习框架,以解决联邦学习中的效率和安全问题。该论文引入了一种轻量级的动态异步算法,该算法控制平均频率和参数选择以加速模型平均和提高效率。该算法允许联邦学习自适应地删除计算能力低、信道条件差或参数异常的落后者。然而,我们的方法侧重于基于区块链的解决方案,以保护梯度更新免受反演和毒性攻击,为各种物联网应用提供全面的保护。通过广泛的实验证明我们的方法的有效性,我们展示了其提升各种联邦学习应用的安全性和隐私性的潜力。

VIII. SUMMARY AND FUTURE WORK

总的来说,我们提出了一个强大的基于区块链的解决方案,用于防御联邦学习物联网场景中的梯度反演攻击和毒性攻击。通过结合公共和私有区块链层面的保护,我们的系统有效地缓解了这些攻击,确保了梯度更新的隐私和安全。我们的实验结果表明,我们的方法显著阻止了攻击者使用他们获取的梯度重建图像,并在毒性攻击下提供了更高的准确性和稳定的收敛性。

在未来的工作中,我们的目标是将我们的框架扩展到涵盖更广泛的攻击,并在大规模物联网部署中提高其可扩展性。此外,我们计划探索整合先进的密码学技术和机器学习方法,如同态加密和安全多方计算,以进一步提高联邦学习系统的隐私和安全性的潜力。我们相信我们提出的方法,以及这些未来的研究方向,可以为增强联邦学习应用在各种物联网场景中的安全性和隐私性奠定基础,为构建更可靠和值得信赖的分布式机器学习系统铺平道路。

联邦学习在物联网场景日益普及,但面临梯度反转和毒化攻击威胁。本文提出基于区块链的防御机制,结合公共和私有区块链保护,采用差分隐私技术。大量实验证明该方法能有效抵御攻击,提高准确性和训练损失收敛稳定性,增强系统安全性和隐私性。

联邦学习在物联网场景日益普及,但面临梯度反转和毒化攻击威胁。本文提出基于区块链的防御机制,结合公共和私有区块链保护,采用差分隐私技术。大量实验证明该方法能有效抵御攻击,提高准确性和训练损失收敛稳定性,增强系统安全性和隐私性。

1190

1190