🔔 NVIDIA之CUDA 相关技术、疑难杂症文章合集(掌握后可自封大侠 ⓿_⓿)(记得收藏,持续更新中…)

运行效果

由于cuda进行运算是非常快的。本文介绍通过C++调用自定义的cuda类接口,将耗时运算操作交由cuda进行计算。

正问

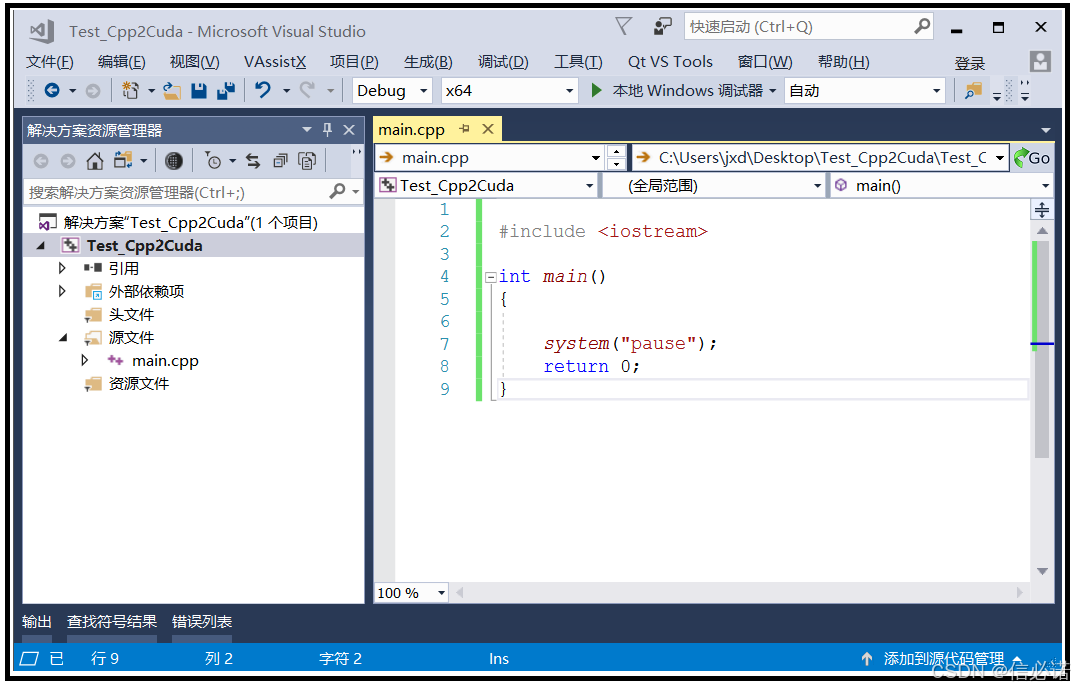

1、打开vs2017,创建C++空项目,并创建main.cpp写入部分代码

2、创建cuda文件与头文件

(1)、右键项目名称 - 添加 - 新建

由于cuda进行运算是非常快的。本文介绍通过C++调用自定义的cuda类接口,将耗时运算操作交由cuda进行计算。

1、打开vs2017,创建C++空项目,并创建main.cpp写入部分代码

2、创建cuda文件与头文件

(1)、右键项目名称 - 添加 - 新建

1647

1647

3409

3409

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?