---------------------------------------------------------------------------------------------------------------------------------

版权所有 © [2025] [刘丹(笔名)]。

本文的全部内容(包括文字、插图、表格、图表、代码示例等)受版权法保护。未经版权所有者书面明确许可,任何单位或个人不得以任何形式(包括但不限于复印、转载、摘编、影印、扫描、改编、录入计算机检索系统、互联网传播、网络下载或以其他方式使用)复制、传播或改编本文的全部或任何部分。

违者将依法追究法律责任。

如需转载或引用本书内容进行教学、研究或出版,请通过以下联系方式申请许可:

联系人:[刘丹];电子邮件:[3549233510@qq.com]。

---------------------------------------------------------------------------------------------------------------------------------

本章以严格的数学推导为主线,覆盖离散卷积与其频谱视角、卷积层作为线性算子的谱分解、残差网络(ResNet)的数学解释与稳定性分析(含 ODE 视角)、高效架构(MobileNet、EfficientNet)中卷积变体与缩放律的精确公式、归一化/正则化的数学影响,以及从频谱角度分析残差块并给出一个简短(理论上可执行)的频谱实验设计。

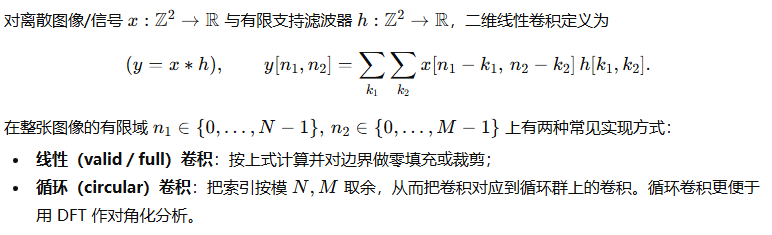

9.1 离散卷积的定义与卷积定理(离散/周期性情形)

9.1.1 线性卷积(离散二维)

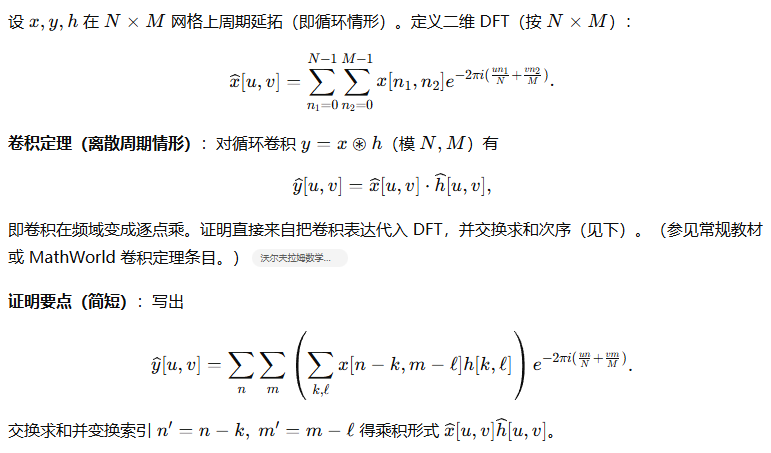

9.1.2 离散傅里叶变换(DFT)与卷积定理(周期性)

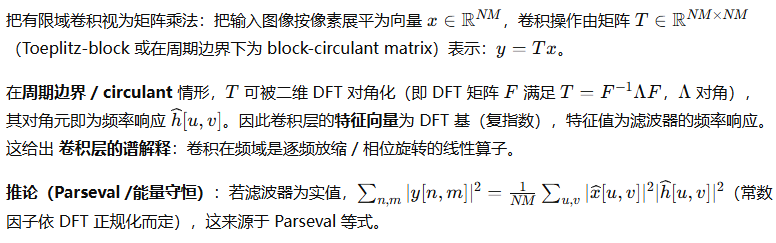

9.1.3 卷积层作为线性算子(Toeplitz/Block-circulant 结构)

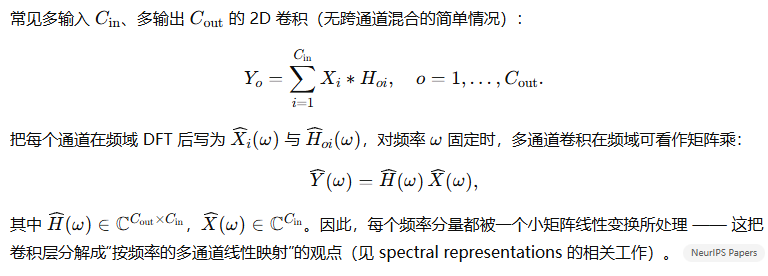

9.2 滤波器的频率响应、设计与多通道卷积

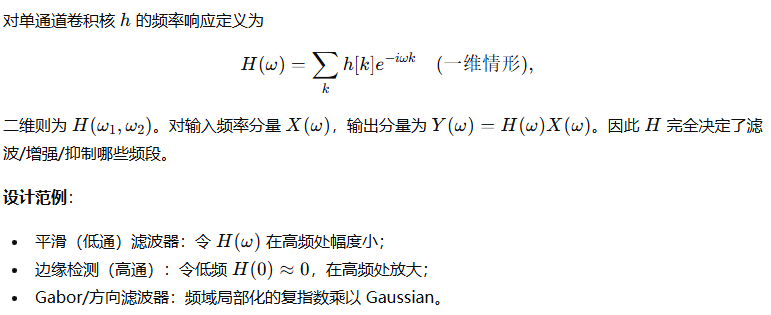

9.2.1 频率响应与传递函数

9.2.2 多通道卷积的线性算子结构

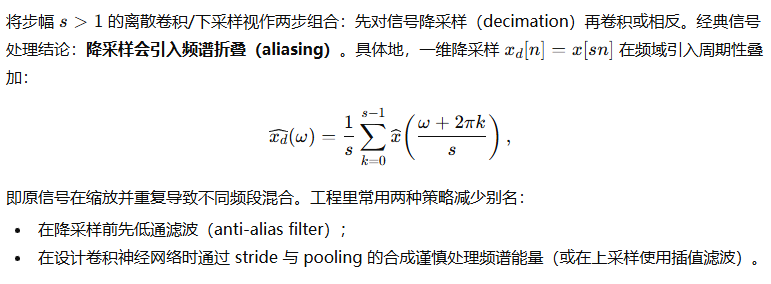

9.3 步幅(stride)、下采样与别名(aliasing)分析

9.4 深度可分离卷积(Depthwise separable)与参数/计算量解析

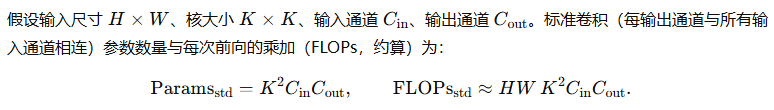

9.4.1 标准卷积的参数与 FLOPs

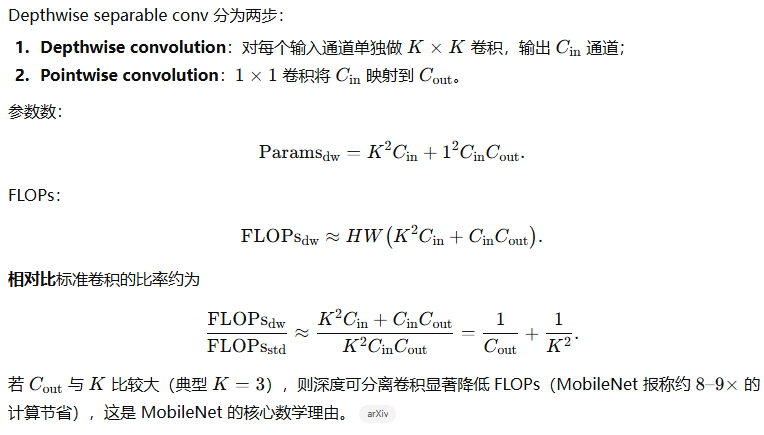

9.4.2 Depthwise separable convolution(MobileNet)的分解与复杂度

9.5 Residual 网络(ResNet):残差块的微分方程视角与稳定性分析

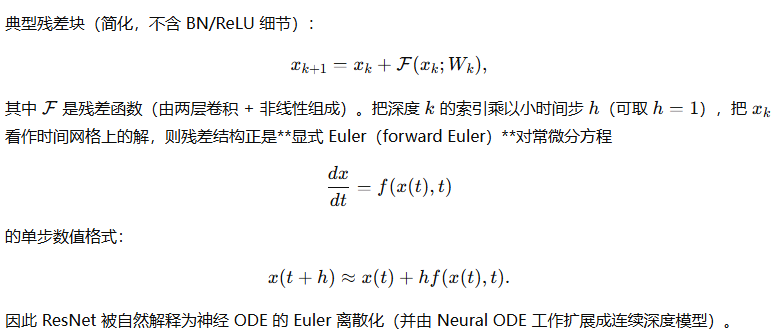

9.5.1 ResNet 的基本块与 Euler 映射解释

9.5.2 局部线性化与稳定性(Jacobian 分析)

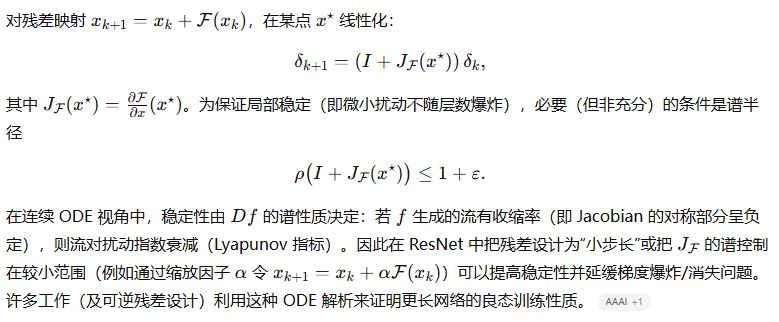

9.5.3 隐式残差(implicit ResNet)与稳定化

9.6 现代高效架构的数学设计原则:MobileNet 与 EfficientNet

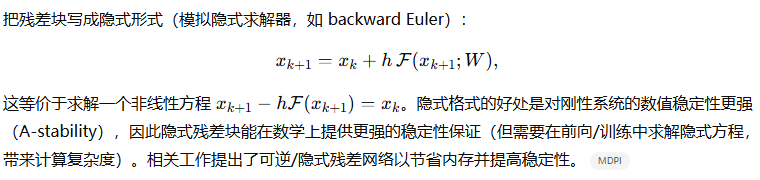

9.6.1 MobileNet(复述与严格度量)

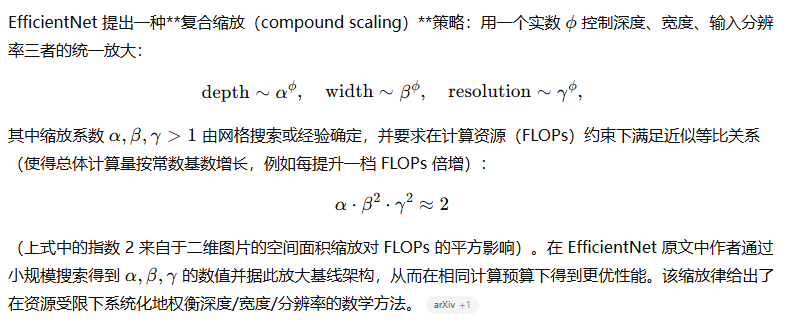

9.6.2 EfficientNet 的 compound scaling(严格公式)

9.7 归一化(BatchNorm / LayerNorm / GroupNorm):数学影响与梯度流

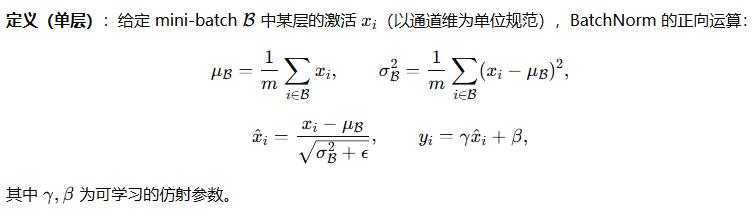

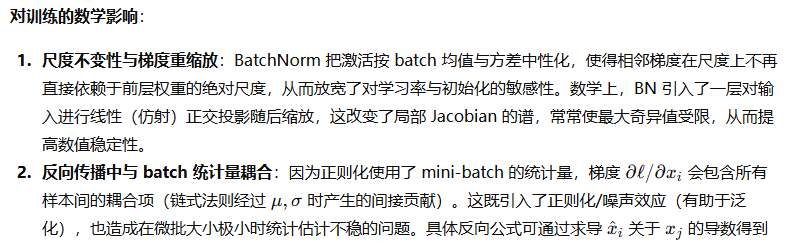

9.7.1 Batch Normalization 的数学定义与反向传播影响

9.7.2 LayerNorm 与 GroupNorm(作用与差别)

-

LayerNorm(在单样本维度上对特征做均值/方差归一化)不依赖 mini-batch,因此在变长序列或批大小为 1 时表现稳定(Transformer 中广泛使用)。数学上 LayerNorm 的 Jacobian 不涉及跨样本耦合,只有通道内部的重缩放。arXiv

-

GroupNorm 把通道分成若干组并在每组内计算均值/方差,是在 BatchNorm 与 LayerNorm 之间的折衷方案:在小批量训练时保持统计稳定同时能保留部分跨通道协作结构。GroupNorm 在目标检测/分割任务中对小批量训练尤为有效。arXiv

数学结论(影响梯度的量化):归一化层从数值上改变了网络的 Jacobian 结构(零均值、单位方差的预条件化),从而间接影响训练过程中的有效步长(梯度在参数空间的投影尺度)。可以把归一化视为一种数据依赖的线性预条件器(依赖于 batch/层/组统计),从而改善 Hessian 的条件数,利于优化。

9.8 残差块的频谱行为(谱解释)与短实验设计(理论)

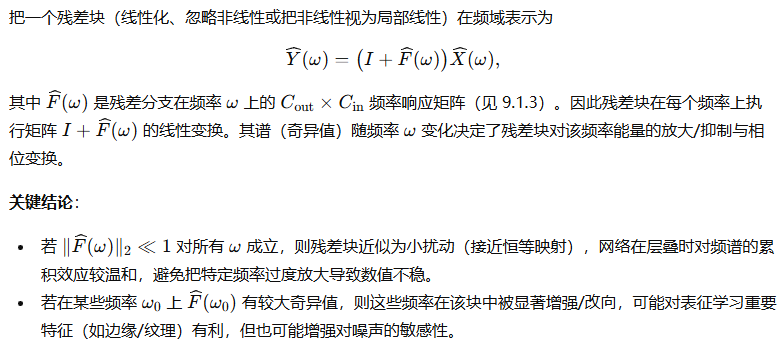

9.8.1 频谱视角:残差块对频率的传递

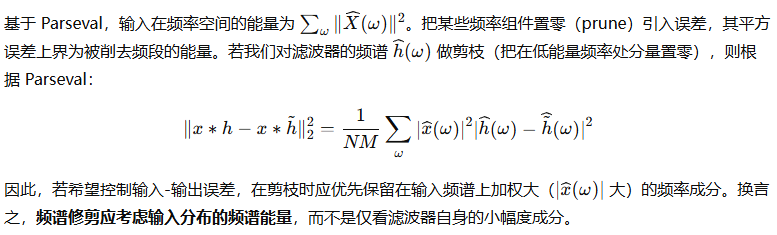

9.8.2 频谱修剪(spectral pruning)与能量保全界

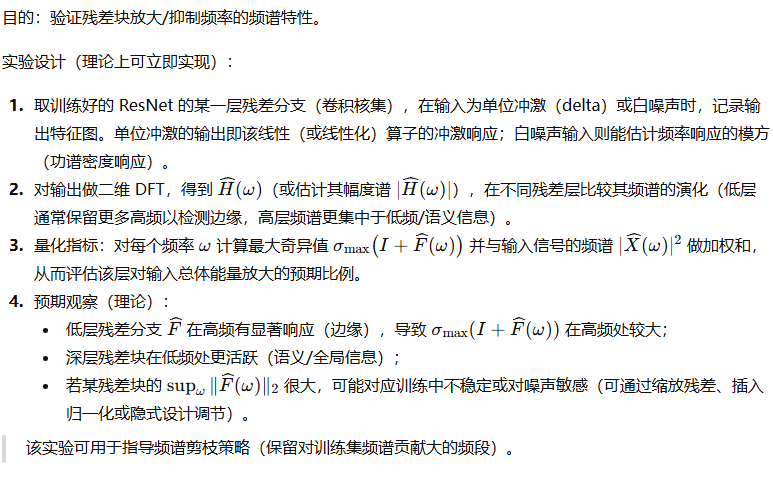

9.8.3 简短实验(理论方案,不运行代码)

该实验可用于指导频谱剪枝策略(保留对训练集频谱贡献大的频段)。

9.9 卷积 + 注意力混合架构与可解释的频谱剪枝(方法论)

9.9.1 卷积与注意力的互补性(算子观点)

-

卷积:固定或可学的局部线性滤波器,具有平移不变性与稀疏局部连接,频谱上可解释为乘子算子(固定或可学习频率响应)。

-

自注意力:输入依赖的核/加权算子(非线性且位置耦合),频谱上不再是固定乘子,但在局部线性化下可近似为频率依赖的矩阵映射(见 6.4 的算子视角)。注意力擅长在空间上进行全局信息整合(特别是长距离依赖),补足了卷积对全局结构的局限。

混合架构(Conv + Attention)典型策略:

-

在网络前层使用卷积提取局部谱/纹理特征(有效且计算廉价);

-

在中后层插入注意力模块处理通道间/位置间的全局交互(在频域上等价于对特定频率分组的耦合变换),从而实现“谱选择性”的重分配。

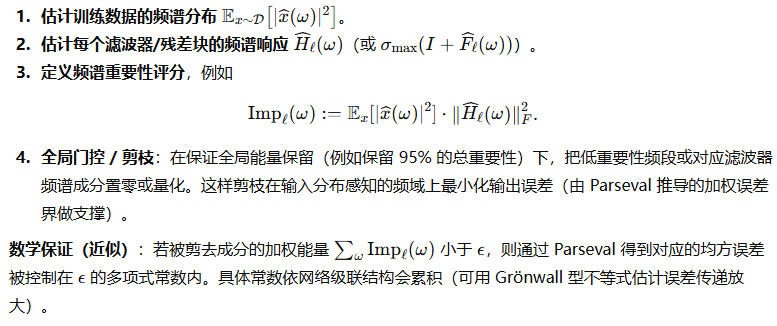

9.9.2 可解释的频谱剪枝流程(理论步骤)

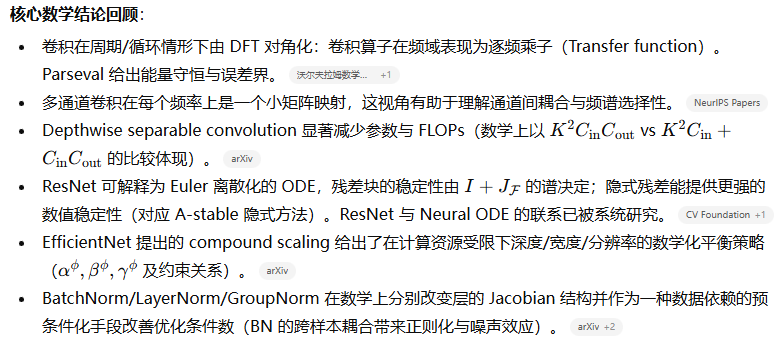

9.10 本章结论与参考路线

参考文献

-

卷积与频谱方法:经典信号处理教材 & Rippel & Adams, Spectral Representations for CNNs. NeurIPS Papers+1

-

ResNet 原始论文:He et al., Deep Residual Learning(CVPR 2016)。CV Foundation

-

Neural ODE:Chen et al., Neural ODE(NeurIPS 2018)。NeurIPS Papers

-

MobileNet:Howard et al., MobileNets(2017)。arXiv

-

EfficientNet:Tan & Le, EfficientNet(2019)。arXiv

-

BatchNorm/LayerNorm/GroupNorm:Ioffe & Szegedy (2015), Ba et al. (2016), Wu & He (2018)。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?